ChatGPT, cioè Chat Generative Pretrained Transformer, è un modello di pari livello di InstructGPT e progettato per fornire una risposta dettagliata a un’istruzione in un prompt.

ChatGPT risponde a domande di follow-up, ammette i propri errori, sfida premesse errate e rifiuta richieste inappropriate.

Con la versione GPT-4o, dove la o sta per omni – parola latina che significa tutto – l’AI ha compiuto un ulteriore passo in avanti verso l’umanizzazione.

Per saperne di più: GPT-4o di OpenAI: l’AI che parla, vede ed è gratis

Poi, ad agosto 2025, è arrivato il tanto atteso GPT‑5. Una delle novità più rilevanti di questo nuovo modello di OpenAI riguarda l’autonomia nel decidere quando usare il ragionamento. Il modello, e non l’utente, decide se applicare il ragionamento a ogni richiesta; questo facilita molto chi non segue da vicino i progressi nei modelli linguistici.

Non è più necessario che l’utente sappia quale tipo di modello usare o come formulare la domanda perfetta: è l’AI a decidere quando serve un ragionamento profondo e quando basta una risposta diretta.

Per saperne di più:

Ecco GPT-5, il modello di OpenAI “più veloce di sempre” (e gratuito) – AI4Business

Indice degli argomenti:

Cos’è ChatGPT e quando nasce

ChatGPT nasce a novembre 2022 ad opera della startup OpenAI, la società sostenuta da Microsoft che sta dietro AlphaFold e GPT-3.

ChatGPT è un modello di linguaggio di grandi dimensioni che si basa sul modello linguistico GPT-3.5 e si distingue per la sua capacità di interagire con gli utenti in modo conversazionale, rispondendo alle domande in modo completo e informativo, anche se aperte, impegnative o strane.

Per saperne di più: OpenAI: cos’è, quando è nata e di cosa si occupa – AI4Business

ChatGPT può anche essere utilizzato per eseguire il debug del codice.

Cosa si può chiedere a ChatGPT

Oltre a rispondere alle domande, ChatGPT può essere utilizzato per:

- Generare diversi formati di testo creativi, come poesie, codice, script, brani musicali, e-mail, lettere, ecc.

- Tradurre lingue.

- Scrivere diversi tipi di contenuti creativi.

- Rispondere alle tue domande in modo informativo, anche se aperte, impegnative o strane.

- Seguire le tue istruzioni e completare le tue richieste con attenzione.

In sostanza possiamo usarlo sia per avere informazioni in modo diretto (più diretto rispetto a un motore di ricerca) sia per aiutarci a scrivere qualcosa.

Esempi di utilizzo:

- Richiesta di informazioni di base – ChatGPT può aiutarci a ottenere informazioni di base su qualsiasi cosa

- Scrivere:

- un saggio o un riassunto su qualsiasi argomento

- una canzone o poesia su qualsiasi argomento

- una e-mail in uno stile definito

- una sceneggiatura cinematografica

- un codice.

- Eseguire il debug del codice.

GPT-4o, la sfida di OpenAI: umanizzare il chatbot

GPT-4o, presentato da OpenAI il 13 maggio 2024, rappresenta un passo significativo verso un’interazione uomo-computer più naturale e intuitiva.

Questo modello di intelligenza artificiale abilita una comunicazione fluida e versatile attraverso la combinazione di testo, audio, immagini e video. In più riesce a riconoscere le emozioni umane e a interagire in maniera naturale. Ed è gratuito per tutti.

Per saperne di più: GPT-4o di OpenAI: l’AI che parla, vede ed è gratis

ChatGPT nel 2025

Il 1° ottobre ChatGPT introduce i progetti condivisi per i piani Business, Enterprise ed Education. Si tratta di spazi digitali dove i membri di un team possono inserire file, note e istruzioni comuni, guidando così le risposte dell’AI in modo coerente e allineato agli obiettivi.

Il 7 agosto, OpenAI ha rilasciato un nuovo modello che rappresenta un salto di grado: GPT-5. Anche questo modello viene offerto in una versione gratuita, oltre che a pagamento.

Per saperne di più:

Leggi tutto: Ecco GPT-5, il modello di OpenAI “più veloce di sempre” (e gratuito) – AI4Business

Leggi tutto: GPT-5, tutto quello che sappiamo sul prossimo modello di OpenAI

Leggi tutto: Altman a sorpresa: “a breve distribuiremo GPT-4.5 e GPT-5” – AI4Business

Il 16 aprile OpenAI aveva annunciato il rilascio di o3 e o4-mini, i modelli più recenti della serie o, progettati per riflettere più a lungo prima di fornire una risposta. Si tratta dei modelli più intelligenti sviluppati finora, che rappresentano un vero salto di qualità nelle capacità di ChatGPT.

Il 28 febbraio OpenAI ha rilasciato un’anteprima di ricerca del suo modello più avanzato di sempre: GPT-4.5. Questo modello rappresenta un passo avanti nell’espansione della capacità di apprendimento pre e post-training.

I primi test indicano che l’interazione con GPT-4.5 risulta più naturale, grazie a una base di conoscenza più ampia e a una maggiore capacità di seguire l’intento dell’utente. Migliorata anche l’intelligenza emotiva, rendendo il modello utile per attività come il miglioramento della scrittura, la programmazione e la risoluzione di problemi pratici. Ci si aspetta anche una riduzione delle allucinazioni.

Sempre a febbraio 2025, OpenAI ha annunciato di aver distribuito alcuni aggiornamenti a 1-800-CHATGPT, ampliando le modalità di accesso e interazione con ChatGPT all’interno di WhatsApp. Gli utenti potranno:

- caricare direttamente le immagini come avviene su ChatGPT;

- parlare con ChatGPT su WhatsApp usando i messaggi vocali e ChatGPT risponderà con un testo.

Inoltre, OpenAI ha introdotto la possibilità di collegare l’account ChatGPT Plus, Free o Pro su WhatsApp per favorire un maggiore utilizzo.

Ancora, OpenAI ha lanciato una chain of tought aggiornata di o3-mini per gli utenti free e a pagamento, e di o3-mini-high per gli utenti a pagamento.

Con i modelli “o”, OpenAI già consente di visualizzare una sintesi della catena di pensiero (CoT) generata dal modello. L’azienda ha introdotto una CoT aggiornata per o3-mini, progettato per rendere più facile per le persone capire come pensa il modello. Tutto ciò è disponibile in o3-mini per gli utenti free e a pagamento, e in o3-mini-high per gli utenti a pagamento.

A gennaio 2025 OpenAI ha aggiornato ChatGPT in Europa. Gli utenti possono indicare al chatbot le caratteristiche desiderate, come per esempio il modo di dialogare o le regole da seguire. Inoltre, possono avere accesso alle funzioni di video e condivisione schermo in modalità Advanced Voice.

Deep research in ChatGPT: come funziona

Sempre a febbraio 2025, OpenAI ha introdotto la ricerca approfondita, o deep research, in ChatGPT, una nuova funzionalità agenziale che conduce ricerche in più fasi su Internet per compiti complessi. In poche decine di minuti si può fare ciò che a un essere umano richiederebbe molte ore.

ChatGPT nel 2024

GPT-4o mini

A marzo 2023 OpenAI ha pubblicato GPT 4 (la quarta versione di GPT) e di conseguenza ChatGPT 4, oltre a fornire le Api di GPT4 per altri servizi e altre aziende. Bing ha integrato già la quarta versione.

Per saperne di più:

GPT-4o di OpenAI: l’AI che parla, vede ed è gratis

ChatGPT 4 è un aggiornamento significativo rispetto alla versione precedente del modello. In particolare, è stato addestrato su un set di dati molto più grande e diversificato. Ciò significa che il modello è in grado di comprendere una gamma più ampia di domande e risposte rispetto alla versione precedente.

Scrive Open AI:

Abbiamo impiegato 6 mesi per rendere GPT-4 più sicuro e allineato. Nelle nostre valutazioni interne, GPT-4 ha l’82% in meno di probabilità di rispondere a richieste di contenuti non ammessi e il 40% in più di probabilità di produrre risposte fattuali rispetto a GPT-3.5.

Una delle maggiori migliorie di GPT-4 è la sua capacità di generare testi più precisi e di qualità superiore rispetto a GPT-3.

Consigli per l’uso di ChatGPT

- Meglio essere specifici. Come spiega Bloomberg, se chiediamo a ChatGPT “Che cos’è il marxismo?”, per esempio, avremo risposta passabile, probabilmente non migliore di quella su Wikipedia o Google. Invece, rendete la domanda più specifica: “Quali sono stati gli sviluppi importanti del marxismo francese nella seconda metà del XIX secolo?”. ChatGPT farà molto meglio, ed è anche il tipo di domanda a cui è difficile rispondere con Google e Wikipedia.

- ChatGPT farà ancora meglio se gli farete domande una dopo l’altra, per approfondire o spiegare meglio punti specifici. Chiedetegli informazioni sugli specifici marxisti francesi che cita, su cosa facevano e su come si differenziavano dalle loro controparti tedesche.

- ChatGPT è particolarmente bravo nel “confronto e nella contrapposizione”. In sostanza, ChatGPT ha bisogno lo indirizziamo bene. Una domanda ben fatta gli dà più punti di riferimento fissi. Dovete impostare l’atmosfera, il tono e il livello intellettuale della vostra domanda, a seconda del tipo di risposta che desiderate.

- Un altro modo per affinare le capacità di ChatGPT è quello di chiedere risposte con la voce di una terza persona. Se chiediamo: “Quali sono i costi dell’inflazione?”, potreste ottenere risposte che non sono esattamente sbagliate, ma nemmeno tanto interessante. Più interessante: “Quali sono i costi dell’inflazione? Rispondete utilizzando le idee di Milton Friedman”.

Le allucinazioni del modello linguistico GPT

A volte, i modelli GPT di OpenAI hanno quelle che gli esperti chiamano “allucinazioni”, confondendo realtà con fantasia. GPT coglie infatti, come detto, i rapporti statistici tra le parole; ma non ha contezza dei rapporti tra parole e il mondo. Non conosce né capisce insomma, davvero, ciò che scrive.

Può alimentare così la disinformazione, ad esempio in ambito medico o politico, come rilevato da molti esperti, nonostante i filtri presenti. Questa anomalia è stata ampiamente corretta nell’ultimo modelli GPT-5.

ChatGPT: i dodici giorni che hanno rinnovato il modello di OpenAI

5 dicembre 2024: OpenAI annuncia la release ufficiale di OpenAI o1 in anteprima in ChatGPT, accessibile per tutti gli utenti di ChatGPT con un piano a pagamento a livello globale.

L’azienda ha pubblicato le valutazioni di o1 rilasciate a seguito dell’annuncio iniziale e, rispetto a o1-preview, ora gli utenti possono aspettarsi un modello di ragionamento più veloce, potente e accurato, migliorato anche nel coding e nella matematica.

Per saperne di più:

OpenAI lancia il nuovo modello o1 e ChatGPT Pro – AI4Business

È stato anche introdotto ChatGPT Pro per i professionisti, un nuovo abbonamento – al costo di 200 dollari – che abilita l’accesso su scala al meglio dei modelli e degli strumenti di OpenAI: include accesso illimitato a OpenAI o1, GPT-4 e Advanced Voice. Inoltre, include anche una versione di o1, esclusiva per gli utenti Pro, che utilizza più calcoli per fornire la migliore risposta possibile ai problemi più difficili.

Infine, è stato anche annunciato il programma di Grant ChatGPT Pro per promuovere l’innovazione in campi utili alla società: 10 borse di studio di ChatGPT Pro a ricercatori e medici di importanti istituzioni, con l’obiettivo di implementare ulteriori borse di studio in varie discipline.

6 dicembre 2024: Reinforcement Fine-tuning (RFT), una nuova tecnica di personalizzazione per i modelli di ragionamento della serie “o”.

Cos’è: Reinforcement Fine-Tuning consente agli sviluppatori e agli ingegneri del machine learning di creare modelli su misura per compiti complessi e domain-specific. A differenza del tradizionale fine-tuning supervisionato, che addestra i modelli a imitare le risposte desiderate, RFT aumenta le capacità di ragionamento di un modello attraverso il miglioramento iterativo. Fornendo un set di dati e un classificatore per compiti specifici, i modelli possono ottimizzare i propri processi di ragionamento per ottenere migliori performance in aree specializzate.

Perché è importante: per la prima volta gli sviluppatori e gli ingegneri del machine learning possono utilizzare il reinforcement learning per creare modelli esperti, ottimizzati per eccellere in compiti specifici del loro dominio. Questo rappresenta un importante progresso nella personalizzazione dei modelli, in quanto i modelli di intelligenza artificiale possono così raggiungere nuovi livelli di ragionamento e di risoluzione dei problemi in campi specializzati come il coding, la ricerca scientifica o il finance.

- Applicazione nel mondo reale: durante i test OpenAI ha collaborato con Justin Reese, un ricercatore computazionale del Berkeley Lab, che sta utilizzando RFT per far progredire la ricerca sulle malattie generiche rare, e con Thomson Reuters, che ha utilizzato il reinforcement fine-tuning per costruire un modello esperto di o1-mini per il suo assistente AI CoCounsel, che supporta i professionisti legali nell’esecuzione di alcuni dei flussi di lavoro più analitici

- Accessibilità delle tecniche avanzate: RFT porta per la prima volta agli sviluppatori esterni gli stessi metodi di reinforcement learning utilizzati internamente da OpenAI per modelli avanzati come GPT-4o e la serie o1, democratizzando in questo modo l’accesso a tecniche di addestramento dell’IA all’avanguardia

- Facilità d’uso per gli sviluppatori: gli sviluppatori devono solo fornire un set di dati e un classificatore per il loro compito specifico. La piattaforma di OpenAI gestisce il reinforcement learning e lo stack dell’apprendimento, rendendo semplice la messa a punto dei modelli senza la necessità di una vasta esperienza nel reinforcement learning

- Disponibilità e next step: Reinforcement Fine-Tuning sarà rilasciato al pubblico all’inizio del prossimo anno. Nel frattempo, OpenAI sta ampliando l’accesso alpha attraverso il Reinforcement Fine-Tuning Research Program.

9 dicembre 2024: Sora – il modello in grado di creare video realistici a partire da un testo – è disponibile non più in sola versione anteprima.

Per saperne di più:

Sora OpenAI, cos’è come funziona la generazione di video da testo – AI4Business

10 dicembre 2024: OpenAI annuncia che canvas è disponibile – non più in preview – per tutte le offerte di ChatGPT, compresa quella Free. Canvas è un’interfaccia dedicata per lavorare con ChatGPT su progetti di scrittura e codifica che vanno oltre la semplice chat (per saperne di più è possibile consultare il blogpost).

OpenAI ha migliorato canvas rispetto alla versione beta e ha aggiunto nuove funzionalità per migliorare le attività di scrittura e coding, tra cui:

- Integrazione con GPT-4o: da ora, canvas è integrato direttamente in GPT-4o quindi non sarà più necessario selezionarlo separatamente

- Esecuzione di codice Python: è possibile eseguire il codice Python direttamente in canvas e far sì che ChatGPT suggerisca dei miglioramenti e corregga i bug

- Copia&incolla del testo: è possibile inserire i propri testi o contenuti di codice in canvas. Quando si incollerà il contenuto in ChatGPT, verrà mostrata l’opzione per aprirlo in un canvas

- Compatibilità con i GPT: canvas è compatibile con i GPT personalizzati

- Mostra le modifiche: durante la fase beta, OpenAI ha lanciato la funzione “Mostra modifiche”, in modo che gli utenti possano vedere cosa viene modificato nel testo e nel codice

Disponibilità: canvas è disponibile per tutti gli utenti web su chatgpt.com e per gli utenti Windows su desktop. Inoltre, OpenAI ha in programma di continuare ad apportare miglioramenti e lanciare nuove funzionalità di canvas nel prossimo futuro.

La condivisione di video e schermo per Advanced Voice

- Di cosa si tratta: OpenAI aggiunge la condivisione di video e schermo all’interno di Advanced Voice sull’app mobile di ChatGPT. Sarà possibile condividere il proprio video o lo schermo per conversazioni in tempo reale senza dover descrivere dove ci si trova o caricare foto.

- Disponibilità: la condivisione di schermo e video saranno disponibili per gli utenti ChatGPT Plus e Pro nella maggior parte dei Paesi, e per tutti gli utenti Team – con l’intenzione di estendere l’accesso agli utenti ChatGPT Plus e Pro nell’UE, Svizzera, Islanda, Norvegia e Liechtenstein a breve. L’azienda prevede di lanciare questa funzione per gli utenti Enterprise ed Edu a gennaio.

- Come utilizzare video & screenshare: su ChatGPT in versione mobile, basta toccare l’icona vocale accanto alla barra della chat. Una volta attivata la modalità vocale, toccare l’icona video in basso a sinistra per avviare il video. Per condividere lo schermo, toccare il menu con tre punti e selezionare “Condividi schermo”.

13 dicembre 2024: Durante la livestream OpenAI ha annunciato il rollout di Progetti, una nuova funzionalità per organizzare le chat che condividono argomenti o contesti comuni.

Per saperne di più: OpenAI aggiorna la funzione Progetti di ChatGPT, il nuovo spazio di lavoro intelligente – AI4Business

- 16 dicembre 2024: ChatGPT search diventa:

Search per gli utenti Free: OpenAI sta integrando la funzionalità di ricerca anche per gli utenti Free e sarà disponibile a livello globale su ogni piattaforma ChatGPT.

Search arriva su Advanced Voice: gli utenti saranno in grado di usare la funzione di ricerca mentre dialogano con ChatGPT. OpenAI ha, infatti, aggiunto alcune nuove funzionalità, come quella video, con la modalità Advanced Voice, che ora integrerà la ricerca. Questa funzionalità sarà accessibile nei Paesi dov’è disponibile la modalità Advanced Voice.

17 dicembre 2024: l’azienda ha dedicato la livestream a una serie di annunci per gli sviluppatori.

Maggiori dettagli nel blog.

OpenAI introduce modelli più capaci, nuovi strumenti per la customizzazione e aggiornamenti per migliorare performance, flessibilità ed efficienza degli sviluppatori in ambiente AI.

Le novità riguardano:

- OpenAI o1 nell’API, che include il supporto alle funzioni di chiamata, sviluppo di messaggi, Structured Output e funzionalità di visione

- Aggiornamenti API in tempo reale, che include una più semplice integrazione WebRTC, il supporto – per la prima volta – a GPT-4o mini e una riduzione del 60% del prezzo per GPT-4o

- Fine-Tuning sulla base delle preferenze, un nuovo modello per la customizzazione che semplificherà la personalizzazione dei modelli sulla base delle preferenze degli utenti e degli sviluppatori

- New Go e Java SDKs disponibili ai primi accessi.

18 dicembre 2024: OpenAI condivide un nuovo numero da salvare nei contatti di WhatsApp: 1-800-242-8478 o 1-800-CHATGPT.

- Che cos’è: è possibile inviare messaggi a ChatGPT tramite WhatsApp utilizzando il numero 1-800-CHATGPT (oppure 1-800-242-8478) in tutto il mondo.

- Disponibilità: ChatGPT su WhatsApp è disponibile per coloro che vivono dove ChatGPT è disponibile. È sufficiente aggiungere il numero 1-800-242-8478 ai contatti e inviare un messaggio a ChatGPT direttamente tramite WhatsApp.

Ecco il link all’articolo del centro assistenza di OpenAI con maggiori informazioni.

Per rivedere la livestream, clicca qui.

19 dicembre 2024: OpenAI ha condiviso tre aggiornamenti, progettati per rendere l’uso di sul computer più facile e intuitivo dopo aver annunciato il funzionamento di ChatGPT con le app.

- ChatGPT ora funziona anche con Apple Notes, Notion e Quip

- Possibilità di utilizzare la modalità Advanced Voice quando si lavora con altre applicazioni desktop. Si può chiacchierare e ottenere risposte mentre si lavora

Tutti gli aggiornamenti sono disponibili per gli utenti Plus, Pro, Team, Enterprise ed Edu.

Gli utenti Enterprise ed Edu, per poter attivare le funzionalità, devono collaborare attraverso Enterprise.

Per rivedere la livestream, clicca qui.

20 dicembre 2024: presentati i modelli, o3 e o3-mini e l’accesso anticipato ai ricercatori in materia di sicurezza e protezione.

Per saperne di più:

OpenAI presenta o3 e o3-mini: regolano il tempo dedicato al ragionamento – AI4Business

L’impegno per la sicurezza

OpenAI ha pubblicato una ricerca sull’allineamento deliberativo, una tecnica all’avanguardia che è stata fondamentale per l’allineamento di o1, il nostro modello più robusto e allineato fino a oggi.

Cosa ne pensano di ChatGPT gli esperti di AI

Come per ogni nuova versione di modello, la comunità AI ha reagito in modi molto diversi. Alcuni hanno chiesto a ChatGPT di generare prompt per generatori di testo-immagine, come MidJourney o Stable Diffusion, e li hanno utilizzati su questi modelli.

Emily M. Bender, direttrice del Computational Linguistics Laboratory dell’Università di Washington, ha ricordato che ChatGPT: ”è ancora solo un modello linguistico: solo una macchina di sintesi testuale / generatore casuale di BS”.

Pochi giorni dopo il rilascio del modello, StackOverflow, il sito di domande e risposte dei programmatori, ha temporaneamente vietato agli utenti di pubblicare risposte generate da ChatGPT, dicendo che il volume di risposte errate ma plausibili era troppo grande.

Al WAICF 2023, l’evento annuale dedicato all’intelligenza artificiale che si tiene a Cannes, alcuni scienziati hanno criticato ChatGPT, ridimensionandone la portata e parlando addirittura di “illusione”.

Come usare gratuitamente ChatGPT

Si può provare ChatGPT gratuitamente. Per accedere al modello, si deve creare un account OpenAI e dichiarare di avere più di 18 anni.

Con la versione gratuita è possibile accedere al nuovo modello, con un limite di utilizzo orario e alcune funzioni bloccate (come la generazione di immagini).

Come iniziare a usare ChatGPT: un breve corso

ChatGPT a pagamento

La versione a pagamento si chiama ChatGPT Plus costa 20 dollari al mese. Per un uso senza attesa e senza limiti di caratteri.

ChatGPT e Bing di Microsoft, come funziona

ChatGPT può essere utilizzato per rispondere in modo sintetico alle query di ricerca nel motore di ricerca Bing di Microsoft, invece di mostrare semplicemente i collegamenti.

Microsoft ha incorporato la tecnologia di OpenAI anche in Edge, il suo browser web, come una sorta di assistente di scrittura superpotenziato. Gli utenti possono ora aprire un pannello in Edge, digitare un argomento generico e ottenere un paragrafo, un post sul blog, un’e-mail o un elenco di idee generati dall’AI e scritti in uno dei cinque toni disponibili (professionale, informale, informativo, entusiasta o divertente).

L’integrazione di ChatGPT – come dichiarato dall’azienda – è estesa a tutti i prodotti Microsoft Office, tra cui Word, PowerPoint e Outlook per consentire agli utenti di generare contenuti da prompt di testo.

Una prima integrazione è in Outlook, il suo servizio di posta elettronica, con uno strumento che aiuta i venditori a scrivere e-mail personalizzate.

In precedenza, Microsoft ha integrato un sistema OpenAI in uno dei suoi prodotti: DALL-E, lo strumento text-to-image utilizzato come base per Microsoft Designer, una piattaforma di progettazione grafica text-to-image AI destinata a rivaleggiare con Canva.

Anche Copilot, basato su GPT-3, è uno strumento Microsoft e serve per assistere nella programmazione.

Come si è arrivati a ChatGPT: la storia tecnologica

Il successo di OpenAI non è arrivato dal nulla. Il chatbot è l’iterazione più raffinata di una serie di modelli linguistici di grandi dimensioni che risalgono ad anni fa. Ecco come siamo arrivati a questo punto.

Anni ’80-’90: reti neurali ricorrenti

ChatGPT è una versione di GPT-3, un modello linguistico di grandi dimensioni sviluppato da OpenAI. I modelli linguistici sono un tipo di rete neurale che è stata addestrata su moltissimi testi. (Le reti neurali sono software ispirati al modo in cui i neuroni nel cervello degli animali si segnalano a vicenda). Poiché il testo è composto da sequenze di lettere e parole di lunghezza variabile, i modelli linguistici richiedono un tipo di rete neurale in grado di dare un senso a questo tipo di dati.

Le reti neurali ricorrenti, inventate negli anni ’80, possono gestire sequenze di parole, ma sono lente da addestrare e possono dimenticare le parole precedenti in una sequenza.

Nel 1997, gli informatici Sepp Hochreiter e Jürgen Schmidhuber hanno risolto questo problema inventando le reti LTSM (Long Short-Term Memory), reti neurali ricorrenti con componenti speciali che consentono di conservare più a lungo i dati passati di una sequenza di input. Le LTSM potevano gestire stringhe di testo lunghe diverse centinaia di parole, ma le loro capacità linguistiche erano limitate.

2017: Trasformatori

La svolta che ha portato all’attuale generazione di modelli linguistici di grandi dimensioni è arrivata quando un team di ricercatori di Google ha inventato i trasformatori, un tipo di rete neurale in grado di tracciare la posizione di ogni parola o frase in una sequenza. Il significato di una parola dipende spesso dal significato di altre parole che la precedono o la seguono. Tenendo traccia di queste informazioni contestuali, i trasformatori possono gestire stringhe di testo più lunghe e catturare il significato delle parole con maggiore precisione. Ad esempio, “hot dog” ha un significato molto diverso nelle frasi “Agli hot dog va data molta acqua” e “Gli hot dog vanno mangiati con la senape”.

2018-2019: GPT e GPT-2

I primi due grandi modelli linguistici di OpenAI sono arrivati a pochi mesi di distanza l’uno dall’altro. L’azienda vuole sviluppare un’intelligenza artificiale polivalente e generica e ritiene che i modelli linguistici di grandi dimensioni siano un passo fondamentale verso questo obiettivo. GPT (acronimo di Generative Pre-trained Transformer) ha fatto scuola, battendo i benchmark più avanzati dell’epoca per l’elaborazione del linguaggio naturale.

GPT combinava i trasformatori con l’apprendimento non supervisionato, un modo per addestrare i modelli di apprendimento automatico su dati (in questo caso, moltissimi testi) che non sono stati annotati in precedenza. In questo modo il software è in grado di individuare da solo gli schemi nei dati, senza che gli venga detto cosa sta guardando. Molti successi precedenti nel campo dell’apprendimento automatico si sono basati sull’apprendimento supervisionato e su dati annotati, ma l’etichettatura manuale dei dati è un lavoro lento che limita le dimensioni dei set di dati disponibili per l’addestramento.

Ma è stato il GPT-2 a creare il maggior scalpore. OpenAI ha dichiarato di essere così preoccupata che le persone possano usare GPT-2 “per generare un linguaggio ingannevole, distorto o abusivo” che non avrebbe rilasciato il modello completo. Come cambiano i tempi.

2020: GPT-3

GPT-2 era notevole, ma GPT-3 ha colpito davvero la comunità scientifica.

La sua capacità di generare testi simili a quelli umani ha rappresentato un grande balzo in avanti. GPT-3 può rispondere a domande, riassumere documenti, generare storie in diversi stili, tradurre tra inglese, francese, spagnolo e giapponese e molto altro ancora. Il suo mimetismo è sorprendente.

Uno dei risultati più notevoli è che i guadagni di GPT-3 sono stati ottenuti grazie al sovradimensionamento di tecniche esistenti piuttosto che all’invenzione di nuove. GPT-3 ha 175 miliardi di parametri (i valori di una rete che vengono regolati durante l’addestramento), rispetto agli 1,5 miliardi di GPT-2. Inoltre, è stato addestrato su un numero molto maggiore di reti. Inoltre, è stato addestrato su un numero molto maggiore di dati.

Ma l’addestramento su testi presi da Internet comporta nuovi problemi. GPT-3 ha assorbito gran parte della disinformazione e dei pregiudizi che ha trovato online e li ha riprodotti su richiesta. Come ha riconosciuto OpenAI: “I modelli addestrati su Internet hanno pregiudizi su scala Internet”.

Dicembre 2020: “testo tossico”

Mentre OpenAI era alle prese con i pregiudizi di GPT-3, il resto del mondo tecnologico stava affrontando una resa dei conti di alto profilo sull’incapacità di contenere le tendenze tossiche dell’IA. Non è un segreto che i modelli linguistici di grandi dimensioni possano emettere testi falsi o addirittura odiosi, ma i ricercatori hanno scoperto che la risoluzione del problema non è sulla lista delle cose da fare per la maggior parte delle aziende Big Tech. Quando Timnit Gebru, co-direttore del team di etica dell’AI di Google, è stato coautore di un documento che evidenziava i potenziali danni associati ai modelli linguistici di grandi dimensioni (tra cui gli elevati costi di calcolo), non è stato accolto con favore dai dirigenti dell’azienda. Nel dicembre 2020, Gebru è stata allontanata dal suo posto di lavoro.

Gennaio 2022: InstructGPT

OpenAI ha cercato di ridurre la quantità di disinformazione e di testo offensivo prodotto da GPT-3 utilizzando l’apprendimento per rinforzo per addestrare una versione del modello sulle preferenze dei tester umani. Il risultato, InstructGPT, è stato migliore nel seguire le istruzioni delle persone che lo utilizzano – noto come “allineamento” nel gergo dell’intelligenza artificiale – e ha prodotto meno linguaggio offensivo, meno disinformazione e meno errori in generale. In breve, InstructGPT è meno tossico, a meno che non gli venga chiesto di esserlo.

Maggio-luglio 2022: OPT, BLOOM

Una critica comune ai modelli linguistici di grandi dimensioni è che il costo del loro addestramento rende difficile per tutti i laboratori, tranne quelli più ricchi, costruirne uno. Ciò solleva il timore che un’intelligenza artificiale così potente venga costruita da piccoli team aziendali a porte chiuse, senza un adeguato controllo e senza il contributo di una comunità di ricerca più ampia. In risposta, una manciata di progetti collaborativi ha sviluppato modelli linguistici di grandi dimensioni e li ha rilasciati gratuitamente a tutti i ricercatori che vogliono studiare e migliorare la tecnologia. Meta ha costruito e regalato OPT, una ricostruzione di GPT-3. Hugging Face ha guidato un consorzio di circa 1.000 ricercatori volontari per costruire e rilasciare BLOOM.

Dicembre 2022: ChatGPT

Persino OpenAI è sbalordita dal modo in cui ChatGPT è stato accolto. Nella prima dimostrazione che l’azienda ha fornito il giorno prima del lancio online, ChatGPT è stato presentato come un aggiornamento incrementale di InstructGPT. Come quel modello, ChatGPT è stato addestrato usando l’apprendimento per rinforzo sul feedback di tester umani che hanno valutato le sue prestazioni come interlocutore fluido, accurato e inoffensivo. In effetti, OpenAI ha addestrato GPT-3 a padroneggiare il gioco della conversazione e ha invitato tutti a giocare. Da allora, milioni di persone stanno giocando.

A cosa serve ChatGPT in pratica

Strumenti come ChatGPT possono creare grandi opportunità per le aziende che sfruttano la tecnologia in modo strategico. L’intelligenza artificiale basata su chat può aumentare il modo in cui gli esseri umani lavorano automatizzando le attività ripetitive e fornendo interazioni più coinvolgenti con gli utenti.

Ecco alcuni dei modi in cui le aziende possono utilizzare strumenti come ChatGPT:

- Compilazione di ricerche

- Idee di brainstorming

- Scrittura di codice informatico

- Automatizzare parti del processo di vendita

- Fornire servizi post-assistenza quando i clienti acquistano prodotti

- Fornire istruzioni personalizzate

- Razionalizzazione e miglioramento dei processi utilizzando l’automazione

- Traduzione di testo da una lingua all’altra

- Facilitare il processo di onboarding dei clienti

- Aumentare il coinvolgimento dei clienti, con conseguente miglioramento della fidelizzazione e della fidelizzazione

Il servizio clienti è una grande area di opportunità per molte aziende. Le aziende possono utilizzare la tecnologia ChatGPT per generare risposte per i propri chatbot del customer care in modo da poter automatizzare molte attività tipicamente svolte dagli esseri umani e migliorare radicalmente i tempi di risposta.

ChatGPT, i settori aziendali in cui esprime il meglio delle potenzialità

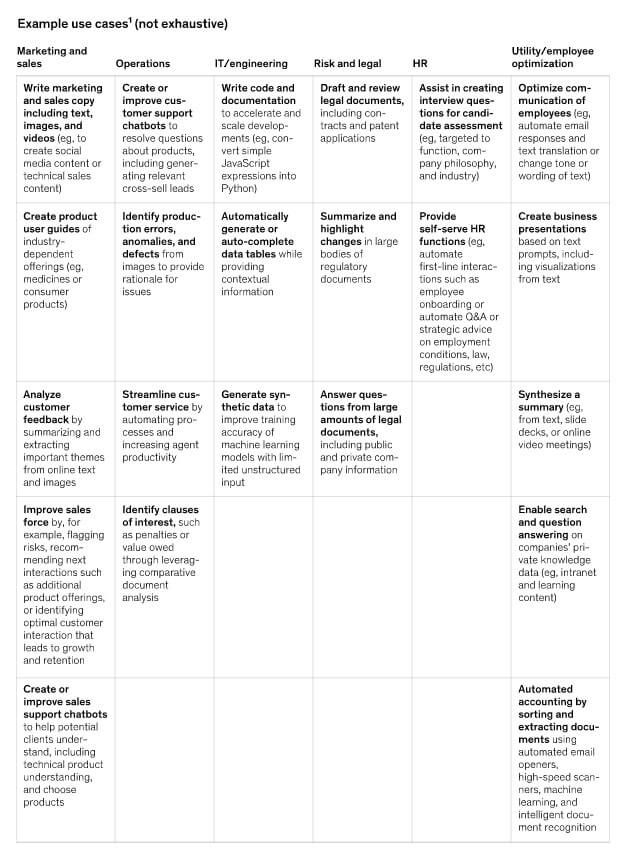

Secondo McKinsey & co., le funzioni in cui modelli come ChatGPT potrebbero essere usati sono:

- Marketing e vendite: creazione di contenuti di marketing, social media e di vendita tecnici personalizzati (inclusi testo, immagini e video); Creazione di assistenti allineati ad attività specifiche, come la vendita al dettaglio

- Generazione di elenchi di attività per l’esecuzione efficiente di una determinata attività

- IT/ingegneria: scrittura, documentazione e revisione del codice

- Rischio e legale: rispondere a domande complesse, attingere da grandi quantità di documentazione legale e redigere e rivedere relazioni annuali

- R&S: accelerare la scoperta di farmaci attraverso una migliore comprensione delle malattie e la scoperta di strutture chimiche.

A questo possiamo aggiungere tra le altre cose:

- un uso ora fatto da Morgan Stanley: supporto alle decisioni manageriali usando l’analisi big data del proprio capitale informativo interno (documenti).

- sintesi di (video) call

Un team interfunzionale per rispondere alle principali domande

Per McKinsey, nelle aziende che considerano l’AI generativa, i dirigenti vorranno identificare rapidamente le parti del loro business in cui la tecnologia potrebbe avere l’impatto più immediato e implementare un meccanismo per monitorarla, dato che si prevede che si evolverà rapidamente.

Una mossa è quella di riunire un team interfunzionale, inclusi professionisti della Data science, esperti legali e leader aziendali funzionali, per riflettere su domande di base, come queste:

- In che modo la tecnologia potrebbe aiutare o interrompere il nostro settore e / o la catena del valore della nostra attività?

- Quali sono le nostre politiche e la nostra posizione? Ad esempio, stiamo aspettando attentamente di vedere come si evolve la tecnologia, investendo in progetti pilota o cercando di costruire un nuovo business? La postura dovrebbe variare tra le aree dell’azienda?

- Dati i limiti dei modelli, quali sono i nostri criteri per selezionare i casi d’uso da targetizzare?

- Come perseguiamo la costruzione di un ecosistema efficace di partner, comunità e piattaforme?

- A quali standard legali e comunitari dovrebbero aderire questi modelli in modo da poter mantenere la fiducia con i nostri stakeholder?

Nel frattempo, è essenziale incoraggiare un’innovazione ponderata in tutta l’organizzazione, posizionando guardrail insieme ad ambienti sandbox per la sperimentazione, molti dei quali sono prontamente disponibili tramite il cloud, con più probabilità all’orizzonte.

ChatGPT per i professionisti

Il modello di AI generativa di OpenAI offre una serie di opportunità per aumentare l’efficienza e la produttività. È possibile utilizzarlo per generare risposte automatiche per le e-mail, anche personalizzate. Come traduttore, aiuto nella scrittura di articoli, racconti, brevi narrazioni, aiuto nella scrittura di codice, debug e riconoscimento/ricerca di errori.

Leggi la mini-guida ChatGPT per professionisti: come sfruttare al massimo la piattaforma di OpenAI.

Cronologia dello sviluppo e delle vicende di ChatGPT di OpenAI

ChatGPT e Cina

Il governo di Pechino fornirà supporto finanziario alle aziende cinesi che sviluppano le proprie versioni di ChatGPT. Baidu, Alibaba, NetEase e JD.com sono tra i primi a mostrare interesse nello sviluppo di strumenti di intelligenza artificiale generativa. Intanto, OpenAI ha vietato agli utenti cinesi di accedere a ChatGPT.

ChatGPT allarma il mondo del lavoro

Dicembre 2022: lo staff dell’American Writers and Artists Institute, organizzazione che riunisce i copywriter, si rende conto della portata di ChatGPT, delle sue capacità, che rientrano perfettamente nella sfera di competenza di coloro che generano contenuti, come testi pubblicitari e post di blog, e lo fanno per vivere. Secondo un sondaggio condotto dal sito web di ricerca di lavoro ZipRecruiter, il 62% delle persone in cerca di lavoro si è detto preoccupato che l’intelligenza artificiale possa ostacolare le loro carriere.

Anche OpenAI ammette, dopo aver condotto una ricerca, che ChatGPT può mettere a rischio posti di lavoro. In particolare, rivela che l’80% della forza lavoro statunitense potrebbe vedere almeno il 10% delle proprie attività lavorative influenzate da GPT. Per la sua ricerca OpenAI utilizza il suo ultimo modello linguistico di apprendimento automatico (LLM), GPT-4, nonché l’esperienza umana. Ecco quali sono i lavori più a rischio.

Per ChatGPT arrivano i plugin…

23 marzo 2023: OpenAI annuncia di avere iniziato il supporto per i plugin in ChatGPT, che aiutano il chatbot ad accedere a informazioni aggiornate, eseguire calcoli o utilizzare servizi di terze parti. Expedia, FiscalNote, Instacart, KAYAK, Klarna, Milo, OpenTable, Shopify, Slack, Speak , Wolfram e Zapier sono tra i primi a crearli.

…e i rischi per la cybersecurity

Alla stessa data, la divisione threat intelligence di Check Point Software Technologies Ltd., fornitore di soluzioni di cybersecurity a livello globale, rende pubblica una prima analisi facendo emergere cinque scenari che potrebbero consentire ai criminali informatici di sfruttare il tool di OpenAI in modo più rapido e preciso. CPR avverte sul potenziale di ChatGPT 4 nell’accelerazione dell’esecuzione di crimini informatici.

In Italia il Garante della privacy dà lo stop a ChatGPT: raccolta illecita di dati personali

31 marzo 2023: L’Autorità contesta a OpenAI l’assenza di una base giuridica che giustifichi la raccolta e la conservazione massiccia di dati personali, allo scopo di “addestrare” gli algoritmi e di sistemi per la verifica dell’età dei minori. Il 20 marzo il chatbot aveva subito una perdita di dati riguardanti le conversazioni degli utenti e le informazioni relative al pagamento degli abbonati al servizio a pagamento.

Il Garante della privacy detta a OpenAI le condizioni per la rimozione del blocco italiano

11 aprile 2023: l’Autorità dà tempo alla società fino al 30 aprile per mettersi in regola. La limitazione provvisoria sarà sospesa se OpenAI adotterà le misure richieste: rendere disponibile sul proprio sito un’informativa trasparente, in cui siano illustrate modalità e logica alla base del trattamento dei dati necessari al funzionamento di ChatGPT nonché i diritti attribuiti agli utenti e agli interessati non utenti e un age gate che escluda, sulla base dell’età dichiarata, gli utenti minorenni.

Preoccupazioni per la privacy non soltanto in Italia

ChatGPT: i Garanti della privacy europei lanciano una task force

Dopo GPT arriva Auto-GPT

Basato sulle versioni di GPT 3.5 e 4 permette di creare agenti autonomi basati su AI, in grado, dato un obiettivo, di arrivare a una soluzione attraverso una serie di passaggi, come la ricerca sul Web o l’esecuzione di codice

OpenAI annuncia la versione Business di ChatGPT

ChatGPT torna accessibile dall’Italia

Dal pomeriggio di venerdì 28 aprile 2023, ChatGPT è di nuovo accessibile anche gli utenti italiani, dopo 28 giorni di blocco in seguito al provvedimento dell’Autorità Garante della Privacy italiana.

I primi firewall per proteggere i dati

Ai primi di maggio 2023 vengono presentati Arthur Shield, un firewall per i dati di AI e NeMo Guardrails di Nvidia, che fornisce un linguaggio di policy per aiutare a proteggere gli LLM dalla perdita di dati sensibili o da risposte errate cosiddette “allucinate”. Sono i primi strumenti messi a disposizione per garantire la perdita dei dati, o data breach, con sistemi di AI generativi come ChatGPT.

ChatGPT sull’app store di Apple

ChatGPT per iPhone disponibile anche in Italia

Statement on AI Risk

30 maggio 2023: Oltre 350 personalità del mondo hi-tech firmano una breve dichiarazione in cui chiedono regole per “mitigare il rischio di estinzione dell’umanità” a causa dell’intelligenza artificiale

OpenAI annuncia aggiornamenti di GPT-3.5-turbo e GPT-4 e calo dei prezzi

Dal 13 giugno 2023 sono disponibili versioni aggiornate e più governabili di GPT-4 e GPT-3.5-turbo, il cui costo dei token d’ingresso scende del 25%; riduzione del 75% dei costi rispetto al modello di embedding all’avanguardia

ChatGPT supporta comandi vocali e input da immagini

ChatGPT diventa multimodale: ora supporta vocali e immagini

Mercedes è la prima casa automobilistica a introdurre ChatGPT sulle proprie vetture negli Usa

Microsoft ha stretto una partnership con Mercedes: a partire dal 16 giugno 2023, la piattaforma di intelligenza artificiale generativa è disponibile per 900mila veicoli Mercedes dotati del sistema di infotainment MBUX dell’azienda tramite un aggiornamento software.

Disponibili per gli utenti gratuiti le “istruzioni personalizzate”

ChatGPT, disponibili per gli utenti gratuiti (ma non per tutti) le “istruzioni personalizzate”

OpenAI lancia ChatGPT Enterprise

29 agosto 2023: arriva finalmente la versione di ChatGPT per le aziende.

ChatGPT, i potenziali rischi

Ci sono enormi opportunità per le aziende di utilizzare strumenti come ChatGPT per migliorare i loro profitti e creare esperienze migliori per i clienti, ma ci sono anche alcuni potenziali pericoli con questa tecnologia. Nella versione beta del software ChatGPT, OpenAI riconosce gli attuali limiti dell’AI, incluso il potenziale di generare occasionalmente informazioni errate o contenuti distorti.

Ci sono anche potenziali problemi di privacy, per tutte le informazioni che ottiene dagli utenti.

ChatGPT può essere vulnerabile agli attacchi di sicurezza informatica, in quanto è connesso a Internet e potrebbe potenzialmente essere utilizzato per diffondere contenuti dannosi o virus. I criminali informatici malintenzionati potrebbero anche manipolare le persone affinché divulghino informazioni personali utilizzando il chatbot, quindi utilizzare tali informazioni per scopi fraudolenti o per attacchi di phishing mirati.

Infine, iniziano a manifestarsi i timori per un utilizzo diffuso di ChatGPT da parte delle aziende. In particolare, si teme che l’adozione di questo strumento possa portare al taglio di posti di lavoro.

Secondo un sondaggio di Sortlist Data Hub effettuato in Regno Unito, Belgio, Germania, Spagna, Paesi Bassi e Francia, infatti, ChatGPT potrebbe provocare tagli nell’organico per il 26% delle aziende tecnologiche europee. A rischiare di più sono i lavoratori di marketing e public relation

Le limitazioni

Ai primi di gennaio 2023, l’International Conference on Machine Learning (ICML) ha impedito agli autori di presentare articoli contenenti testo generato da strumenti come ChatGPT. Inoltre, le scuole di New York City hanno vietato agli studenti di utilizzare ChatGPT per paura che possa essere usato per imbrogliare. Ora è vietato su tutti i dispositivi e le reti nelle scuole pubbliche.

Un portavoce di OpenAI ha dichiarato al Washington Post che sta sviluppando “mitigazioni per aiutare chiunque a identificare il testo generato da quel sistema”.

C’è poi il problema della legalità delle opere generate dall’AI; attualmente, solo un’opera ha ottenuto la protezione del copyright: un fumetto negli Stati Uniti, anche se l’Ufficio copyright Usa sta rivedendo la sua decisione.

Il gigante dei servizi finanziari JP Morgan Chase ha vietato al suo personale di utilizzare ChatGPT. Lo riferisce la CNN, citando fonti che affermano che la decisione, che si applica al personale globale, è dovuta a problemi di conformità sull’utilizzo di software di terze parti.

Bing e Edge con ChatGPT anche sui dispositivi mobili

Microsoft ha esteso i suoi prodotti potenziati dall’AI anche agli smartphone iOS e Android. Inoltre, ha lanciato Bing per Skype e ha allungato il tempo delle chat: fino a 6 per sessione, per un massimo di 60 chat totali al giorno, con l’obiettivo di arrivare presto a 100.

Un miliardo di visualizzazioni di pagina

Il 14 marzo 2023, OpenAI annuncia che ChatGPT ha raggiunto un miliardo di visualizzazioni di pagina.

OpenAI dà l’accesso a Internet a ChatGPT

28 settembre 2023: OpenAI annuncia su X (ex Twitter) che ChatGPT

è ora in grado di navigare in Internet per fornire informazioni aggiornate e autorevoli, complete di link diretti alle fonti

grazie all’integrazione con il motore di ricerca Bing di Microsoft. Non è più limitato ai dati prima di settembre 2021.

Leggi tutto: OpenAI dà accesso a Internet a ChatGPT – AI4Business

ChatGPT di OpenAI è in grado di riassumere e analizzare i documenti caricati

31 ottobre 2023: gli abbonati a ChatGPT Plus e a ChatGPT for Enterprise possono inserire PDF, file di dati o “qualsiasi altro documento” per l’analisi. Grazie alle nuove capacità di gestione dei documenti si riduce il divario con il chatbot rivale Claude

Leggi tutto: OpenAI aggiornamento ChatGPT riassume analizza documenti –