Le truffe informatiche sfruttano le debolezze umane per compromettere la sicurezza di sistemi e reti. L’intelligenza artificiale contribuisce allo sviluppo di attacchi sofisticati e credibili che sfruttano deepfake e clonazione vocale. La consapevolezza, la formazione e l’utilizzo di strumenti AI-Powered per la sicurezza sono fondamentali per mitigare i rischi e proteggere le risorse digitali. Parliamo di “scam”, termine inglese che può essere tradotto in italiano con “truffa” o “inganno”. In ambito informatico, si utilizza per riferirsi a metodi e azioni fraudolente che mirano a sottrarre denaro o informazioni personali alle vittime.

Indice degli argomenti:

AI e cybercriminalità

Nell’ambito della cybersicurezza, il fattore umano riveste un ruolo cruciale, poiché gran parte delle minacce informatiche trae vantaggio dalle debolezze delle persone per compromettere la sicurezza dei sistemi e delle reti aziendali. Oggi, molte minacce derivano da un uso improprio dell’intelligenza artificiale: conoscerla e comprenderne il funzionamento è fondamentale per mitigare i rischi e proteggere adeguatamente le risorse digitali.

L’AI gioca un ruolo significativo nello sviluppo e nella diffusione delle truffe online, contribuendo ad aumentarne la sofisticazione e, di conseguenza, l’efficacia. Attraverso l’uso di algoritmi avanzati e tecniche di apprendimento automatico, i cybercriminali sono in grado di creare comunicazioni più persuasive e personalizzate, di analizzare e sfruttare le informazioni raccolte sulle vittime e di automatizzare interazioni false su larga scala. Inoltre, l’AI può essere utilizzata per creare immagini, video e contenuti fraudolenti, grazie al deepfake, rendendo così gli scam sempre più difficili da riconoscere e contrastare.

Per fortuna, le potenzialità dell’AI possono essere sfruttate anche dagli esperti che si occupano della sicurezza delle reti. Molti degli strumenti di protezione attualmente disponibili sfruttano l’intelligenza artificiale per rilevare e prevenire gli attacchi, identificando pattern, comportamenti e segnali caratteristici di queste truffe, proteggendo così gli utenti dai possibili rischi.

Cos’è e come funziona lo scam

Gli scam possono essere perpetrati in diversi modi e attraverso vari canali, tra cui telefonate, e-mail, social media, siti web e, addirittura, anche di persona. In generale, la strategia degli scam consiste nel fingersi un’entità affidabile, come una banca, una compagnia di assicurazione, un’agenzia governativa o un’organizzazione benefica, per convincere la vittima a divulgare informazioni personali o a inviare denaro.

Esempi comuni di scam includono le truffe romantiche, in cui viene instaurata una relazione fittizia con la vittima per richiedere denaro per motivi falsi. In altri casi, i cybercriminali usano fantomatiche vincite alla lotteria per truffare i malcapitati: inviano una comunicazione dove si annuncia la vincita un premio di elevato valore e si sollecita il pagamento di una “tassa” per poterlo riscuotere. Altri scam includono le false offerte di lavoro, che spesso richiedono di pagare anticipatamente per ricevere materiali di formazione o strumenti per l’impiego, o le truffe legate ai ransomware, dove la vittima viene convinta a eseguire un software che crittografa tutto il contenuto dell’hard disk e blocca il computer chiedendo il pagamento di un riscatto.

Per proteggersi dagli scam, è fondamentale essere vigili e informati sui vari tipi di truffe in circolazione. L’introduzione dell’AI rende queste truffe sempre più complesse e difficili da riconoscere; quindi, è importante verificare sempre l’identità delle persone o delle organizzazioni con cui si è in contatto, evitare di fornire informazioni personali a fonti sconosciute e dubitare di offerte o situazioni che sembrano troppo belle per essere vere.

Automated Massive Scam

Fino ad ora, le email di phishing erano convincenti, ma non impossibili da rilevare. Errori di ortografia e grammatica, contenuti incoerenti o una formattazione grafica approssimativa fungevano da “segnali” di allerta. Tuttavia, con testi e layout generati dall’AI, gli errori che una volta servivano da campanello di allarme stanno diventando sempre più rari. Inoltre, queste email risultano contestualmente più accurate, poiché strumenti di intelligenza artificiale vengono utilizzati per personalizzare gli attacchi, utilizzando un linguaggio e dettagli personali che rendono le email incredibilmente simili a quelle scritte da veri stakeholder o membri del personale.

L’AI ha dato ai criminali informatici la possibilità di rilevare più velocemente se le reti da attaccare sono vulnerabili. Software non aggiornato, aggiornamenti falliti, password deboli, API esposte: queste vulnerabilità possono ora essere sfruttate più facilmente. Ciò fornisce agli scammer una libreria di dispositivi penetrabili su cui lanciare un attacco.

Oltre a identificare i dispositivi su cui puntare, i bot di AI possono monitorare simultaneamente migliaia, centinaia di migliaia e persino milioni di dispositivi, piattaforme e account di posta elettronica, offrendo agli scammer infiniti possibili obiettivi da prendere di mira per colpire più vittime contemporaneamente. Questo spiana la strada ad attacchi di massa su vasta scala che fino a poco tempo fa non erano attuabili.

Come evitare le truffe di phishing basate su AI

Come evitare le truffe di phishing basate sull’AI? La sicurezza informatica non può più essere considerata una questione secondaria. Non è mai stato così cruciale disporre di una solida soluzione basata sull’AI per contrastare efficacemente le crescenti minacce. Questo è fondamentale per proteggere i dati, i sistemi informatici e le persone dal cadere vittime di attacchi che possono arrivare a distruggere un’attività commerciale.

I dispositivi e i sistemi connessi devono essere monitorati e gestiti 24 ore al giorno. Il crimine informatico non lavora dalle 9 alle 5, quindi disporre di un software o un team che rileva e risponde alle minacce in tempo reale è l’unico modo per evitare il cybercrimine. Fortunatamente, molte di queste soluzioni oggi iniziano ad avere costi contenuti, anche alla portata di business di piccole dimensioni o in fase di startup.

Voice e Deepfake Scam

I software di clonazione vocale esistono da molto tempo, ma negli ultimi mesi, grazie al progresso dell’AI, hanno raggiunto un notevole livello di miglioramento e sono diventati molto più economici e accessibili. Oggi, con soltanto un euro, qualche minuto e una connessione a Internet, è possibile sintetizzare perfettamente la voce di un estraneo, senza possedere competenze tecniche specifiche. Oggigiorno fidarsi della legittimità delle voci di coloro con cui interagiamo da lontano non è più una cosa scontata. Ci troviamo in una società in cui non c’è modo di sapere con certezza se dall’altro capo del telefono ci sia davvero un familiare o un collega.

Negli USA, le forze dell’ordine hanno segnalato già diversi casi di scam portati a termine grazie all’utilizzo della clonazione vocale AI-Powered. In Arizona, ad esempio, come riporta la CNN, una donna di nome Jennifer DeStefano ha ricevuto una telefonata da individui che sostenevano di aver rapito sua figlia e chiedevano un riscatto. Durante la telefonata, la donna ha sentito una voce femminile che assomigliava molto a quella di sua figlia, accompagnata dalle minacce di un uomo. Alla fine, DeStefano è riuscita a contattare la figlia e a confermare che la chiamata era uno scam, ma l’esito di questa truffa avrebbe potuto essere molto differente. L’evoluzione dei software di intelligenza artificiale accessibili e a basso costo, permette oggi ai truffatori di clonare le voci e rendere i loro raggiri sempre più convincenti. Negli Stati Uniti, le famiglie perdono in media 11mila dollari per ogni falso rapimento.

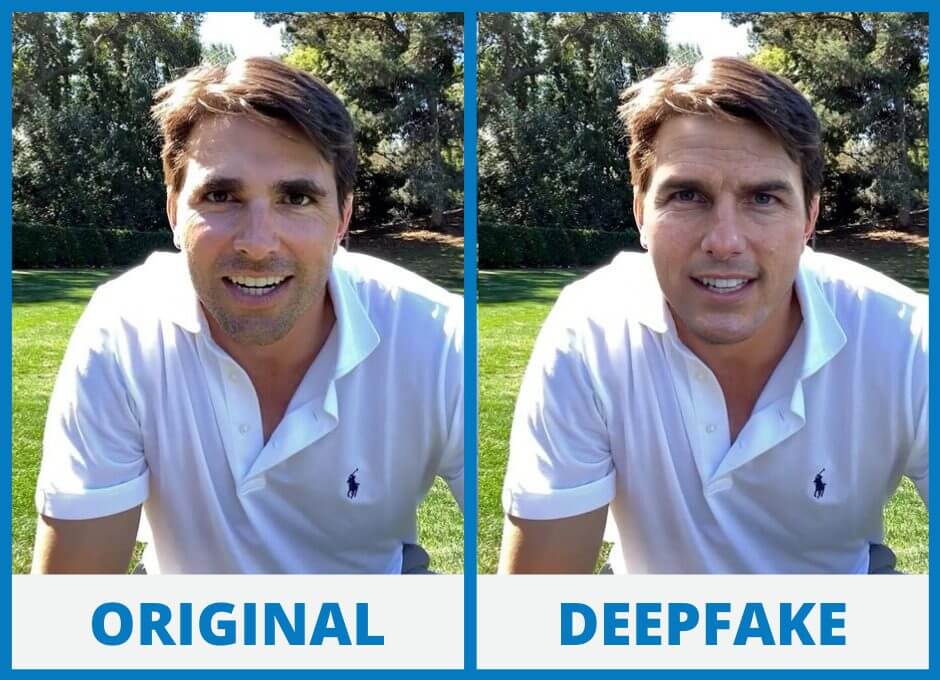

Deepfake

I cybercriminali possono spingersi anche oltre la clonazione vocale, grazie al deepfake, una tecnica di intelligenza artificiale che utilizza l’apprendimento profondo per creare o manipolare contenuti digitali, come video, immagini o audio, sostituendo il volto o la voce originale con un altro. Fino ad ora, il termine deepfake è stato principalmente associato a video di intrattenimento, spesso facilmente riconoscibili come falsi. Con l’evoluzione delle AI generative, però, la qualità di questi contenuti sta continuando a crescere a ritmi sostenuti, rendendoli strumenti pericolosi che consentono di orchestrare scam sempre più complessi da riconoscere. In Mongolia è stato denunciato uno dei primi casi di scam tramite deepfake: la truffa ha avuto una notevole risonanza mediatica perché a caderne vittima è stata una celebrità. Secondo quanto riferito dalla polizia di Baotou, una regione della Mongolia Interna, la vittima ha ricevuto una videochiamata da un suo amico che affermava di avere urgentemente bisogno di denaro per effettuare un deposito in una gara d’appalto. L’uomo, a seguito della chiamata, ha trasferito l’equivalente di 622mila dollari senza accertarsi dei fatti, scoprendo solo in un secondo momento di essere stato truffato.

Combattere questo fenomeno è una sfida complessa che va affrontata da aziende, istituzioni e privati con la massima attenzione. Naturalmente, limitare al minimo le informazioni condivise pubblicamente sui social media è un suggerimento sempre valido: gli scammer usano questi dati per rendere più credibili le loro frodi. Una truffa recentemente denunciata in Cina, che ha utilizzato la tecnologia deepfake per indurre un uomo a trasferire del denaro, ha sollevato preoccupazioni riguardo l’uso dell’intelligenza artificiale (AI) nella conduzione di attività fraudolente nel Paese. La discussione sul sito di social media Weibo sull’esplosione del numero di attacchi basati sull’intelligenza artificiale ha ottenuto più di 120 milioni di visualizzazioni in un giorno, secondo quanto riportato da Reuters.

Ad ogni modo, è importante evitare un’eccessiva paranoia e la perdita di fiducia nell’autenticità di contenuti audio e video, poiché viviamo in un contesto dove la diffidenza verso le informazioni che riceviamo, e quindi verso le istituzioni, sta già crescendo a dismisura, amplificata dall’intelligenza artificiale. La consapevolezza è certamente essenziale, così come lo è lo sviluppo di tool AI-Powered che sappiano distinguere ciò che è reale da ciò che non lo è.

AI-Powered Social Engineering

L’ingegneria sociale, una tattica utilizzata dagli attaccanti per manipolare le persone al fine di ottenere informazioni riservate, rappresenta uno dei metodi più efficaci per sfruttare il fattore umano. Una delle tecniche più comuni basate sul social engineering è il phishing, un attacco informatico in cui gli utenti ricevono email fraudolente che sembrano provenire da fonti attendibili e vengono indotti a condividere credenziali di accesso o installare malware.

I cybercriminali possono sfruttare l’AI per analizzare grandi quantità di dati presenti online, identificando così i potenziali obiettivi e selezionando l’approccio più efficace per un attacco di social engineering, aumentandone, in questo modo, le probabilità di successo. I contenuti e le informazioni che pubblichiamo online diventano quindi delle risorse preziose per valutare la superficie d’attacco e scoprire le vulnerabilità di un obiettivo.

Anche i dati pubblicati sul Dark web, provenienti da leak e attacchi informatici precedenti, sono un’ottima base di partenza per un’analisi AI-Powered. Senza il supporto di un’intelligenza artificiale, sarebbe davvero complesso catalogare e filtrare i milioni di record che possono essere scaricati dai siti specializzati del web sommerso. La classificazione dei dati mediante l’utilizzo di sistemi di apprendimento automatico permette di mappare queste informazioni in poco tempo e di confrontarle tra loro, così da avere a disposizione un vero e proprio arsenale d’attacco.

Anche in questo caso, l’arma fondamentale per combattere il fenomeno è la consapevolezza. Online è possibile trovare molte risorse (anche gratuite) che permettono di comprendere e imparare a riconoscere le diverse tattiche di social engineering. Sistemi avanzati di segmentazione delle informazioni e di autenticazione multifattore si sono rivelati particolarmente efficaci per evitare che un singolo utente con un’azione distratta possa mettere a rischio la sicurezza di intere organizzazioni.

Conclusioni

La conoscenza dei rischi e la comprensione dei meccanismi di difesa costituiscono un elemento chiave per prevenire e mitigare gli scam. Adottare una strategia di formazione continua e promuovere la consapevolezza sulla sicurezza informatica all’interno delle organizzazioni rappresenta uno dei passi più efficaci per contrastare il fattore umano e proteggere le infrastrutture critiche.

La sensibilizzazione alle minacce e l’educazione degli utenti alle migliori pratiche di sicurezza, come la creazione di password complesse e il monitoraggio delle comunicazioni sospette, contribuiranno a ridurre il rischio di attacchi riusciti. Inoltre, fornire una formazione approfondita sul riconoscimento delle email di phishing, sull’uso sicuro dei dispositivi mobili e sulla navigazione sicura in Internet sono esempi di iniziative che possono rafforzare la sicurezza del fattore umano.

Investire nella formazione e nella ricerca è un passo indispensabile per contrastare il crescente rischio di attacchi informatici AI-Powered e garantire la protezione dei dati, delle infrastrutture e, soprattutto, delle persone.