- GFP-GAN per il restauro delle Immagini: è un nuovo modello di intelligenza artificiale sviluppato da Tencent, capace di ripristinare immagini danneggiate e a bassa risoluzione. È gratuito e disponibile su GitHub, combinando il modello di Tencent con il modello pre-addestrato StyleGAN-2 di Nvidia.

- GFP-GAN utilizza due modelli per riempire gli elementi mancanti di un’immagine, trasformando in pochi secondi immagini di bassa qualità in versioni migliorate. A differenza dei metodi precedenti che richiedevano punti di riferimento specifici, GFP-GAN combina volti pre-addestrati con l’input dell’immagine da ripristinare per creare un risultato bilanciato tra realtà e fedeltà.

- GFP-GAN si comporta bene su volti di varie tonalità di pelle e gruppi di popolazione, ma può presentare problemi di accuratezza del colore in ritratti in scala di grigi. Per migliorare ulteriormente, è necessario un set di dati diversificato ed equilibrato.

Si chiama GFP-GAN, ovvero Generative Facial Prior-Generative Adversarial Network ed è un nuovo modello di intelligenza artificiale che può ripristinare immagini danneggiate e a bassa risoluzione. Sviluppato da ricercatori della società cinese Tencent, lo strumento è gratuito e può essere scaricato tramite GitHub. Utilizza sia il modello di Tencent che un modello StyleGAN-2 pre-addestrato di Nvidia, simile al sistema utilizzato per sviluppare GauGAN, il modello generativo di immagini di Nvidia.

In un documento che delinea come funziona il modello, il team AI di Tencent ha utilizzato i due modelli per riempire efficacemente gli elementi mancanti di una vecchia immagine. In pochi secondi, la potenza combinata di due modelli può trasformare le immagini di bassa qualità in immagini nuove e migliori.

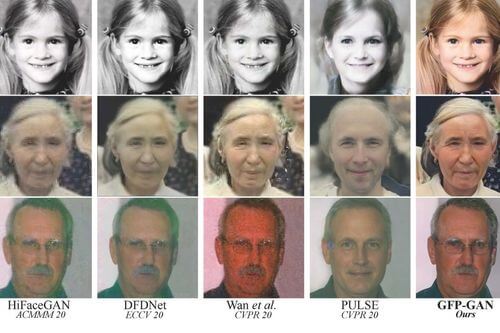

Le prestazioni ottenute dai vari sistemi di elaborazione del viso. L’ultimo a destra è GFP-GAN.

Il documento suggerisce che, in precedenza, il restauro delle immagini richiedeva un punto di riferimento per ricreare dettagli specifici. GFP-GAN, tuttavia, funziona combinando volti pre-addestrati dal modello di Nvidia con l’input di dati dalla foto da ripristinare per creare un’immagine che abbia “un buon equilibrio tra realtà e fedeltà”.

“Grazie ai potenti design generativi del viso precedenti, il nostro GFP-GAN può ripristinare congiuntamente i dettagli del viso e migliorare i colori con un solo passaggio, mentre i metodi di inversione GAN richiedono un’ottimizzazione specifica dell’immagine all’inferenza”, si legge nel documento.

Il documento suggerisce che il modello “si comporta bene sulla maggior parte dei volti dalla pelle scura e su vari gruppi di popolazione” a causa di una combinazione di dati pre-addestrati e dati dall’immagine di input.

Il team di Tencent ha notato che il colore della persona in un ritratto di input può apparire più chiaro del tono della pelle originale da un’immagine in scala di grigi poiché “gli input non contengono informazioni sufficienti sul colore”. Per correggere ulteriormente questo problema, gli autori dell’articolo suggeriscono la necessità di un set di dati diversificato ed equilibrato per realizzare appieno il potenziale del modello.