Il National Institute of Standards and Technology (NIST) del Dipartimento del Commercio degli Stati Uniti ha rilasciato il 26 gennaio 2023 la prima versione del suo nuovo AI Risk Management Framework (AI RMF 1.0), un “documento di orientamento per l’uso volontario da parte delle organizzazioni che progettano, sviluppano, implementano o utilizzano sistemi di intelligenza artificiale per aiutare a gestire i numerosi rischi delle tecnologie AI”.

Il NIST AI Risk Management Framework è accompagnato da un playbook complementare che suggerisce modi per navigare e utilizzare il framework per “incorporare considerazioni di affidabilità nella progettazione, sviluppo, distribuzione e utilizzo dei sistemi di intelligenza artificiale”.

Indice degli argomenti:

NIST AI Risk Management Framework, un percorso iniziato nel 2020

Il Congresso ha ordinato al NIST di sviluppare il quadro attraverso il National Artificial Intelligence Act del 2020 e il NIST ha sviluppato il quadro da luglio 2021, sollecitando feedback attraverso workshop e commenti pubblici. La bozza più recente era stata pubblicata nell’agosto 2022.

Un comunicato stampa ha spiegato che l’AI RMF è diviso in due parti.

Nella prima parte si discute come le organizzazioni possono inquadrare i rischi legati all’AI e delinea le caratteristiche dei sistemi di AI affidabili.

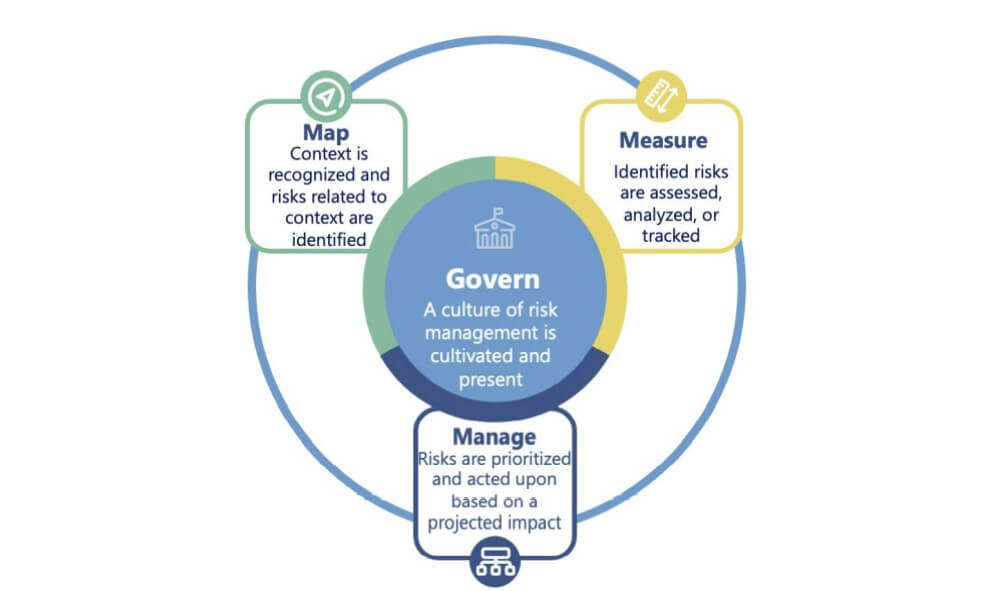

La seconda parte, il nucleo del framework, descrive quattro funzioni specifiche – governare, mappare, misurare e gestire – per aiutare le organizzazioni ad affrontare i rischi dei sistemi di intelligenza artificiale nella pratica. Il feedback della community sarà fondamentale

In un video in diretta che annunciava il lancio di RMF, il sottosegretario al commercio per la tecnologia e direttore del NIST Laurie Locascio ha dichiarato: “Il Congresso ha chiaramente riconosciuto la necessità di questa guida volontaria e l’ha assegnata al NIST come alta priorità”. Il NIST conta sulla vasta comunità, ha aggiunto, per “aiutarci a perfezionare queste priorità della roadmap”.

Il vicesegretario al commercio, Don Graves, ha sottolineato che l’AI RMF non arriva un momento troppo presto. “Sono stupito dalla velocità e dalla portata delle innovazioni AI solo nel breve periodo tra l’inizio e la consegna di questo framework”, ha affermato. “Come molti di voi, sono anche colpito dall’enormità dei potenziali impatti, sia positivi che negativi, che accompagnano i progressi scientifici, tecnologici e commerciali”.

Tuttavia, ha aggiunto, “sono stato in giro per gli affari abbastanza a lungo da sapere che il vero valore di questo quadro dipenderà dal suo uso effettivo e se cambierà i processi, le culture, le nostre pratiche”.

La gestione del rischio dell’AI affrontata in “modo olistico”

Courtney Lang, direttore senior di politica, fiducia, dati e tecnologia presso l’Information Technology Industry Council, ha affermato che l’AI RMF offre un “modo olistico di pensare e affrontare la gestione del rischio dell’AI, e il Playbook associato consolida in un unico luogo riferimenti informativi, che aiuteranno gli utenti a rendere operativi i principi chiave di affidabilità”.

Le organizzazioni di tutte le dimensioni saranno in grado di utilizzare il framework flessibile basato sui risultati, ha affermato, per gestire i rischi sfruttando al contempo le opportunità presentate dall’AI. Ma dato che gli sforzi di standardizzazione sono in corso, ha aggiunto che il quadro dovrà anche evolversi “al fine di riflettere il panorama in evoluzione e promuovere un maggiore allineamento”.

Le critiche al NIST AI RMF: troppo “di alto livello” e “generica”

Mentre il NIST AI RMF è un punto di partenza, “in termini pratici, non significa molto”, afferma Bradley Merrill Thompson, avvocato specializzato nella regolamentazione dell’AI presso lo studio legale Epstein Becker Green. “È così di alto livello e generico che serve davvero solo come punto di partenza per pensare a un quadro di gestione del rischio da applicare a un prodotto specifico”, ha affermato. “Questo è il problema nel cercare di quasi regolare tutta l’AI. Le applicazioni sono molto diverse con rischi molto diversi”.

Gaurav Kapoor, co-CEO di governance, rischio e conformità per il fornitore di soluzioni MetricStream, ha convenuto che il framework è solo un punto di partenza. Ma ha aggiunto che il framework aiuta a “mettere processi sostenibili intorno alla gestione delle prestazioni in corso, al monitoraggio del rischio, al rischio di pregiudizi indotti dall’AI e persino alle misure per garantire che le PII siano sicure”. È chiaro, ha aggiunto, che “tutte le parti interessate dovrebbero essere coinvolte quando si tratta di migliori pratiche nella gestione del rischio”.

NIST “posizionato in modo univoco” per riempire il vuoto

Tuttavia, mancano le migliori pratiche ampiamente accettate sulla gestione del rischio dell’AI e i professionisti sia sul lato tecnico che su quello legale hanno bisogno di una guida chiara, afferma Andrew Burt, managing partner dello studio legale BNH.

“Quando si tratta di gestione del rischio di intelligenza artificiale, i professionisti si sentono, troppo spesso, come se stessero operando nel selvaggio West”, ha affermato. “Il NIST è in una posizione unica per colmare questo vuoto e l’AI Risk Management Framework consiste in una guida chiara ed efficace su come le organizzazioni possono gestire in modo flessibile ma efficace i rischi dell’AI. Mi aspetto che la RMF stabilisca lo standard per il modo in cui le organizzazioni gestiscono i rischi dell’AI in futuro, non solo negli Stati Uniti, ma anche a livello globale”.