Il problema si pone da tempo. Prima era solo di natura speculativa, oggi col diffondersi dell’AI diventa concreto. E siccome “coloro che ignorano la storia, sono condannati a ripeterla”, sarà bene riflettere su di una serie di osservazioni di autorevoli personaggi, già da tempo disponibili ma troppo rapidamente dimenticate. Dovrebbero servire, più che a ingenerare paura, a riflettere sulla necessità di informarsi approfonditamente su alcune innovazioni tecnologiche che fanno parte ormai della vita quotidiana. Possiamo evitare così ciò che è successo in passato in altre occasioni e per altre tecnologie, che non informandosi correttamente e per tempo, siamo usciti dal gioco per un combinato disposto di ignoranza e paura.

Fortunatamente, siamo ancora in presenza di sistemi in commercio che non sono vera intelligenza artificiale, bensì ottime esercitazioni di pattern recognition con astuti “artful deception“.

Indice degli argomenti:

Alcuni punti chiave

- L’AI, sia tecnicamente che sociologicamente, pervade tutto prima che scienziati, governanti e popolazione siano pronti ad accoglierla. Con Stati che non sanno come muoversi, non appena si accorgono che i loro PIL sono solo frazioni del fatturato delle bigtech.

- Le Bigtech producono avanzamenti tecnici che sono delle vere discontinuità per il vecchio mondo, ma le nostre organizzazioni vorrebbero inserirle nel business come piccole modifiche incrementali e questo per non cambiare l’organizzazione. Ma con l’AI siamo in presenza della “burrasca della distruzione creativa”. La burrasca cui si fa qui riferimento non riguarda un problema di cambiamento climatico, ma è il “processo di mutazione industriale che rivoluziona incessantemente la struttura economica dall’interno, distruggendo senza sosta quella vecchia e creando sempre una nuova” (J. A. Schumpeter). Sombart poi ci dice pure come: “il capitalismo distrugge e riconfigura gli ordini economici precedenti, e deve anche svalutare incessantemente la ricchezza esistente (sia attraverso la guerra, l’abbandono o crisi economiche regolari e periodiche) al fine di spianare il terreno per la creazione di nuova ricchezza”. L’analisi è precisa, ma è dura da attuare. I cambiamenti organizzativi che comporta certo non sono dei piccoli accorgimenti incrementali di manutenzione adeguativa o correttiva delle organizzazioni ma cambiamenti radicali: chi non li recepisce per tempo, o non si adegua, è destinato come nella selezione darwiniana a scomparire.

- L’AI, col suo grappolo di innovazioni, dimostra, anche attraverso i suoi inverni e primavere, che è qui per starci e sembra essere un riuscito esempio dell’applicazione della teoria di Schumpeter. Stavolta indietro non si torna, né ha senso ritornarci. Per chi volesse approfondire tali aspetti, in un mio libro “K-Economy” – dove K sta per knowledge – ho dedicato un ampio capitolo all’applicazione della teoria di Schumpeter alle innovazioni legate a Internet all’AI alle IoT, alla innovazione digitale in genere, per far vedere come il capitalismo non è né è mai stato stazionario.

- Sì, la burrasca è qui! E fuor di metafora arrivano i rischi, prima del previsto. Alcuni segnali sui rischi già cominciano a essere disponibili. Vediamone insieme alcuni.

Segnali di allarme

Elon Musk: parla di “real dangerous AI” e ha ripetutamente messo in guardia il mondo sul pericolo che l’AI un giorno surclassi l’umanità. E come le società tech abbiano dovuto da sole mettersi dei vincoli morali, prima che lo facesse un qualsiasi ordinamento dello Stato!

Stuart Russell: “una macchina non ha bisogno di essere più intelligente degli umani in tutte le cose per rappresentare un serio rischio. “È qualcosa che si sta svolgendo ora”, dice. “Se guardi ai social media e agli algoritmi che scelgono ciò che le persone leggono e guardano, hanno già un enorme controllo sul nostro input cognitivo”.

– La comunità dell’AI non si è ancora adattata al fatto che ora stiamo iniziando ad avere un impatto davvero grande nel mondo reale;

– il futuro per l’intelligenza artificiale risiede nello sviluppo di macchine che sanno che il vero obiettivo è incerto, così come lo sono le nostre preferenze, il che significa che devono confrontarsi con gli umani, un po’ come un maggiordomo, per qualsiasi decisione. Ma l’idea è complessa, anche perché persone diverse hanno preferenze diverse, e talvolta conflittuali, e quelle preferenze non sono fisse”.

È davvero importante che il pubblico sia coinvolto in queste scelte, perché è il pubblico che ne trarrà beneficio o meno”, ha affermato Russell.

– “Il progresso nell’intelligenza artificiale è qualcosa che richiederà del tempo per accadere, ma non è fantascienza”.

Già si vedono gli effetti sui social media…

Yuval Harari: “Netflix ci dice cosa guardare e Amazon ci dice cosa comprare”. “Alla fine entro 10, 20, 30 anni gli algoritmi potrebbero anche dirti cosa studiare al college, dove lavorare, chi sposare. Perfino per chi votare”. A quel punto non si potrà nemmeno parlare di “hackerare” un essere umano. Sarà come telecomandarlo. Non puoi regolare la potenza esplosiva dell’intelligenza artificiale a livello nazionale”. Harari ha aggiunto anche che i dati non dovrebbero mai essere concentrati in un solo posto. E lo ha detto con una frase lapidaria: “Questa è la ricetta per una dittatura”.

Ora con il cloud e i big data, in un mondo dove tutto sembra passare da prodotto a servizio è assai probabile imboccare la scorciatoia di un paese affidato a estranei e dove la rete è la via migliore per la sudditanza.

Francesco Varanini: Agenda Digitale – “Il metaverso di Facebook: la realtà aumentata come distruzione sociale”

All’inizio dell’estate 2021 Mark Zuckerberg lancia il progetto del Metaverse. Se si è stufi di Facebook, ecco la nuova terra promessa: un mondo virtuale dove sarà possibile “sperimentare un senso di presenza molto più forte” di quello offerto da social network e piattaforme. “Più naturale”, “più comodo”, dove “le interazioni sembreranno reali”.

Il rischio di trovarsi a vivere nella ‘realtà’ progettata nei Facebook Reality Labs non è poi così lontano.

“Dovremmo riflettere sull’accondiscendenza con cui accogliamo tutto ciò che viene presentato come innovazione. Di fronte ai difetti o ai pericoli impliciti in una tecnologia, l’unico rimedio sembra consistere nel passare ad una più potente.”

“Ho perso il conto delle volte in cui ho sentito tecnici informatici, User Experience Designer, strateghi del passaggio al digitale, giustificare le loro scelte progettuali con i ‘bias cognitivi’ degli esseri umani. Molto più raro il loro appello alla capacità di giudizio e alla saggezza che ogni essere umano possiede.”

“Possiamo certo nutrire dubbi sulla capacità di molti esseri umani di prendere decisioni. Ma di fronte a questi dubbi, cosa si fa? La via più breve è quella del ‘nudge’, la spinta gentile esercitata tramite gli strumenti digitali che ogni essere umano ha in mano. Il che equivale a dire che per via digitale si spingono cittadini e lavoratori a prendere le decisioni che le élite ritengono più convenienti.”

“Al senso di presenza creato via software che Zuckerberg ci propone, possiamo contrapporre la consapevolezza del nostro essere umani, l’autocoscienza, l’esperienza di sé narrata lungo l’arco di millenni dall’arte e dalla letteratura, dalla filosofia e dalle scienze umane, e presente nelle relazioni sociali, quando ci incontriamo faccia a faccia, veramente insieme con i nostri corpi e le nostre anime.”

Quanto sopra, in regime di “dittatura pubblicitaria”, che effetto può avere sui giovani?

Fate caso alla curva dell’attenzione dei ragazzi e vedrete come sia tarata su slot della durata di una manciata di secondi di concentrazione, come da format TikTok e Youtube. Durata massima? 10 minuti continuativi… Essi, sottoposti al bombardamento pubblicitario, sono disinteressati alla loro storia e al loro futuro; vogliono e vivono solo il presente. Si creano una loro sotto-realtà del virtuale, un luogo virtuale del verosimile dove vengono recuperate tutte le cose impossibili nel reale: vita, morte, sconfitte…

Nel virtuale, al vero si sostituisce il verosimile, si camuffano le identità, si perpetrano ricatti, al costo, nel mondo reale, di un rendimento scolastico scarso, di depressione, ansia, anoressia.

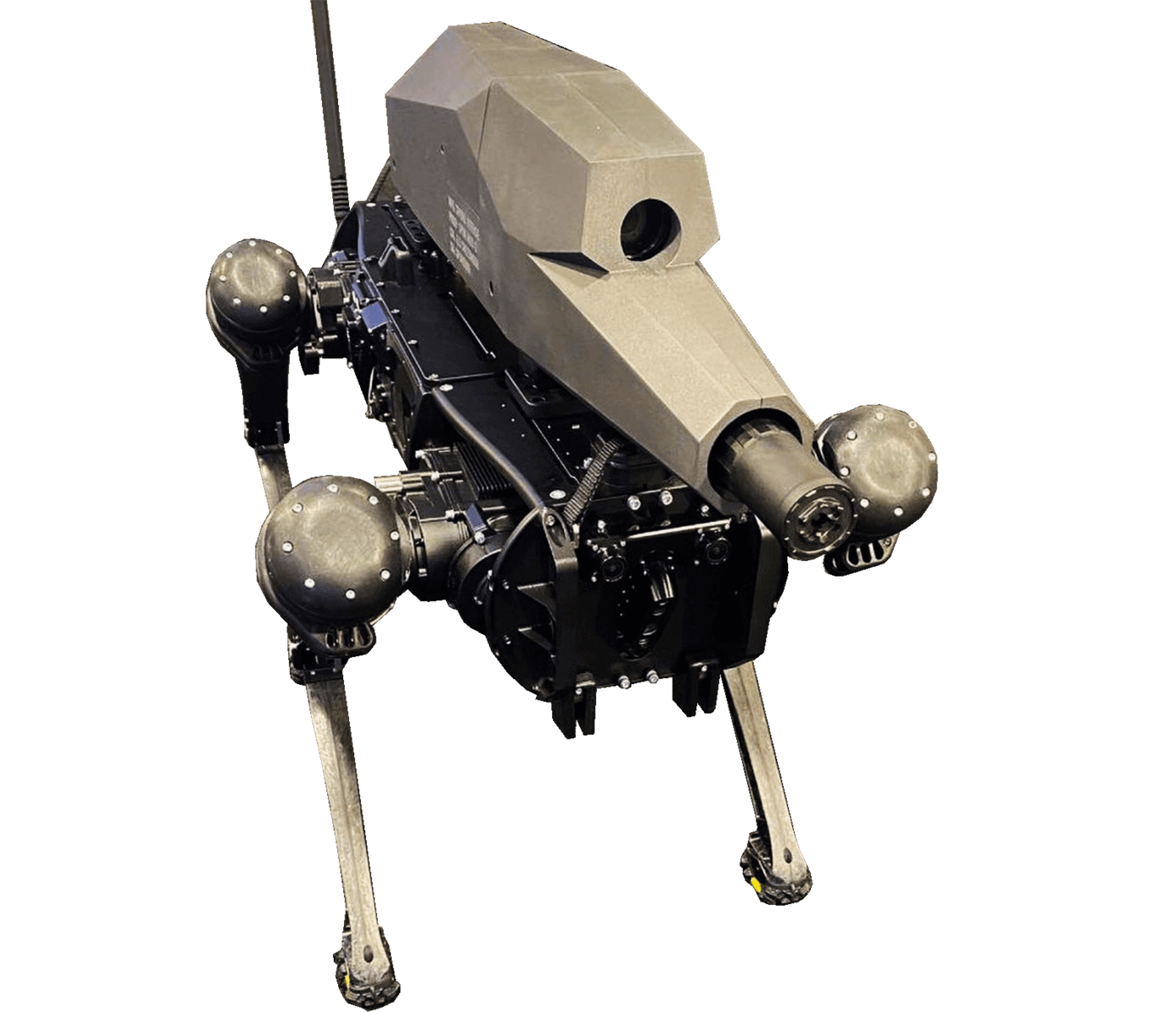

Per non parlare della “robotica armata”: Sword International mette in produzione SPUR (Special Purpose Unmanned Rifle), un robot quadrupede cecchino.

Tutto da buttare, allora?

SPUR

La risposta è l’alfabetizzazione

Non commettiamo con l’AI lo stesso errore che abbiamo commesso con l’utilizzo del nucleare in Italia: disinformazione, approssimazione, lobby al lavoro che producono i casi Ippolito, i casi Silvestri (“Il prezzo della menzogna”, ottimo libro letto da pochissimi….), organi di stampa che vennero usati come organi di propaganda, con giornalisti scarsamente preparati ma in buona fede, che portarono a un referendum in cui la popolazione arrivò assolutamente impreparata, frastornata, confusa.

In questo caso potremmo essere di nuovo portati a qualche scelta regolatoria mal fatta, consapevolmente o inconsapevolmente. Ma va ricordato che una tecnologia non è buona o cattiva in sé, bisogna vedere per quali fini la si utilizza.