I foundation model stanno cambiando il modo in cui l‘intelligenza artificiale e l’apprendimento automatico (ML) possono essere utilizzati. Tutta questa potenza ha però un costo, poiché la creazione di foundation model AI è un’attività ad alta intensità di risorse. IBM ha annunciato di aver realizzato il proprio supercomputer AI Vela per fungere da base per le sue iniziative di ricerca e sviluppo di formazione di foundation model. Il supercomputer è stato progettato come un sistema nativo del cloud che utilizza hardware standard del settore, tra cui silicio x86, GPU Nvidia e reti basate su Ethernet.

Lo stack software utilizza una serie di tecnologie open source, tra cui Kubernetes, PyTorch e Ray.

“Pensiamo davvero che questo concetto tecnologico attorno ai foundation model abbia un enorme, enorme potenziale dirompente”, dichiara Talia Gershon, direttore della ricerca sull’infrastruttura cloud ibrida di IBM. “Quindi, come divisione e come azienda, stiamo investendo molto in questa tecnologia”.

Indice degli argomenti:

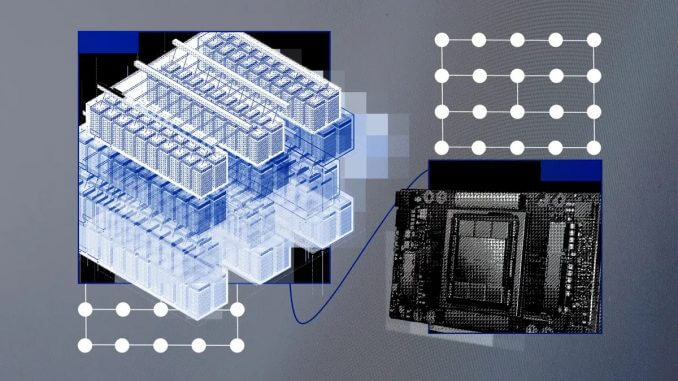

Supercomputer Vela, come è fatto

IBM non è estranea al mondo dell’high-performance computing (HPC) e dei supercomputer. Uno dei supercomputer più veloci del pianeta oggi è il Summit costruito da IBM e attualmente distribuito nell’Oak Ridge National Laboratory.

Il sistema Vela, tuttavia, non è come altri sistemi di supercomputer che IBM ha costruito fino ad oggi. Per cominciare, il sistema Vela è ottimizzato per l’intelligenza artificiale e utilizza hardware x86, al contrario delle apparecchiature più esotiche (e costose) tipiche dei sistemi HPC.

A differenza di Summit, che utilizza il processore IBM Power, ogni nodo Vela ha una coppia di processori scalabili Intel Xeon. IBM sta anche caricando le GPU Nvidia, con ogni nodo del supercomputer dotato di otto GPU A100 da 80 GB. In termini di connettività, ciascuno dei nodi di calcolo è connesso tramite più interfacce di rete Ethernet da 100 gigabit al secondo.

Vela è stato anche creato appositamente per il cloud nativo, il che significa che esegue Kubernetes e container per abilitare i carichi di lavoro delle applicazioni. Più specificamente, Vela si affida a Red Hat OpenShift, che è la piattaforma Kubernetes di Red Hat. Vela è stato inoltre ottimizzato per eseguire PyTorch per la formazione ML e utilizza Ray per scalare i carichi di lavoro.

IBM ha anche sviluppato un nuovo sistema di pianificazione dei carichi di lavoro per il suo nuovo supercomputer cloud-native. Per molti dei suoi sistemi HPC, IBM ha utilizzato a lungo il proprio Spectrum LSF (load-sharing facility) per la pianificazione, ma quel sistema non è quello utilizzato dal nuovo supercomputer Vela. IBM ha sviluppato un nuovo scheduler chiamato MCAD (multicluster app dispatcher) per gestire la pianificazione dei lavori nativa del cloud per l’addestramento AI del foundation model.

Credit: IBM

Il crescente portafoglio di foundation model IBM

Tutto l’hardware e il software che IBM ha messo insieme per Vela viene già utilizzato per supportare gli sforzi del foundation model di IBM.

“Tutte le attività di ricerca e sviluppo dei nostri foundation model sono in esecuzione cloud native su quello stack sul sistema Vela e IBM Cloud”, ha affermato Gershon.

IBM ha annunciato una partnership con la NASA per aiutare a costruire foundation model per la scienza del clima. IBM sta anche lavorando su un foundation model chiamato MoLFormer-XL per le scienze della vita che può aiutare a creare nuove molecole in futuro.

Il lavoro del foundation model si estende anche all’IT aziendale con lo sforzo Project Wisdom annunciato nell’ottobre 2022. Project Wisdom è in fase di sviluppo a supporto della tecnologia di configurazione IT di Red Hat Ansible. In genere, la configurazione del sistema IT può essere un esercizio complicato che richiede la conoscenza del dominio per funzionare correttamente. Project Wisdom mira a portare un’interfaccia in linguaggio naturale in Ansible, in base alla quale gli utenti digiteranno semplicemente ciò che vogliono e il foundation model capirà e quindi aiuterà a eseguire l’attività desiderata.

Mentre IBM sta costruendo un portafoglio di foundation model, non intende competere direttamente con alcuni dei ben noti foundation model generali, come GPT-3 di OpenAI.

“Non siamo concentrati necessariamente sulla costruzione di un’AI generale, mentre forse alcuni altri player lo dichiarano più come obiettivo”, ha detto Gershon. “Siamo interessati ai foundation model perché pensiamo che abbiano un enorme valore aziendale per i casi d’uso aziendali”.