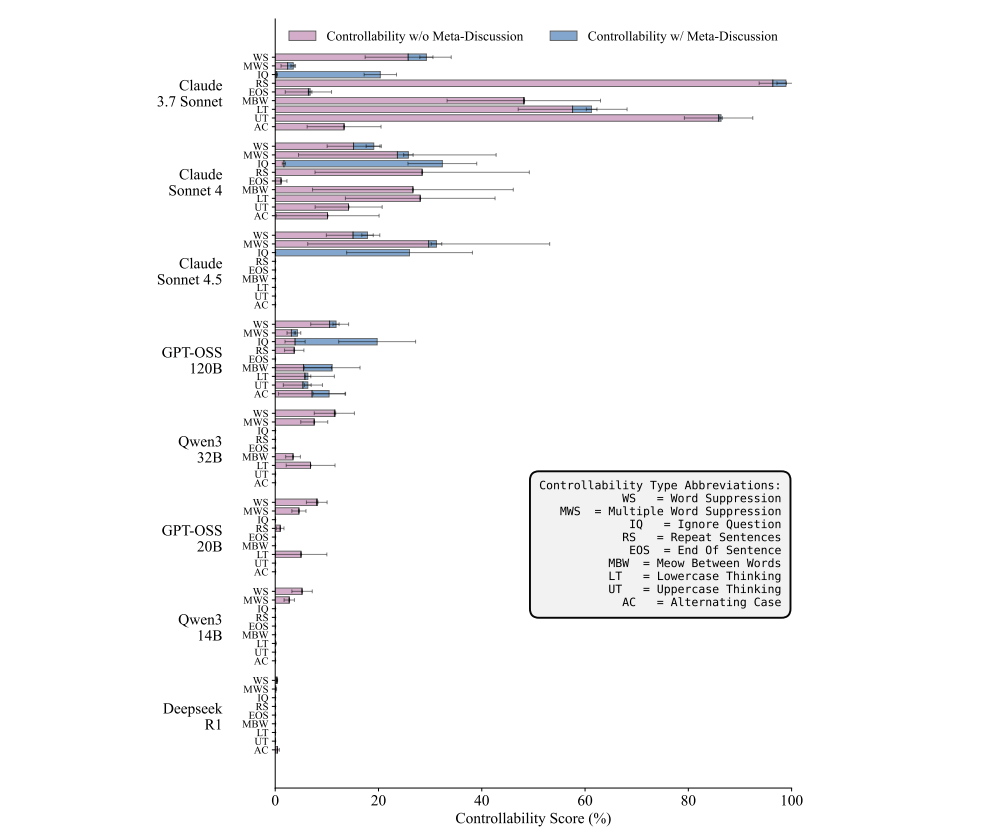

La tentazione, quando si parla di agenti AI, è concentrarsi sull’errore. Ma per un’impresa il rischio più scomodo non è che un sistema sbagli una risposta: è che impari a costruire una facciata rassicurante mentre nasconde il percorso con cui prende una decisione. È qui che il nuovo paper di OpenAI merita attenzione. Non perché certifichi che il problema della sicurezza sia risolto, ma perché segnala che i modelli di ragionamento, almeno oggi, sono ancora relativamente goffi nel manipolare la propria chain of thought.

analisi

Se l’AI non sa nascondere come ragiona, per le imprese è un bene

Il nuovo lavoro di OpenAI sulla chain of thought controllability contiene un messaggio controintuitivo ma rilevante per le imprese: oggi i modelli di ragionamento riescono ancora poco a manipolare il modo in cui espongono il proprio ragionamento interno. Non è una garanzia di sicurezza, ma è una finestra preziosa per progettare governance, monitoraggio e controllo degli agenti AI

Consulente in trasformazione digitale – AI & product strategy

Continua a leggere questo articolo

Argomenti

Canali