Le aziende si stanno accorgendo che stanno spendendo di più per l’AI generativa. È il risultato di una somma di fattori: nuovi e più ampi utilizzi dell’AI, ma soprattutto un cambiamento nel pricing enterprise di OpenAI e Anthropic. Più che semplici rincari, i due vendor stanno spostando la monetizzazione verso modelli ibridi fatti di accesso incluso, limiti inclusi, crediti, overage, tool e runtime separati.

Il fenomeno è interessante, complesso e bisogna evitare la tentazione di dire che l’AI sta diventando più cara. C’è di vero che le aziende AI, quest’anno soprattutto, hanno bisogno di ridurre le perdite e il modo che hanno trovato, più efficace, è “spremere” di più gli utenti business. L’ha sempre fatto Anthropic, ora lo fa di più anche OpenAI.

Spremere vuol dire massimizzare la loro spesa, ma non con aumenti unitari di prezzo.

Vediamo di capire che sta succedendo, anche perché ne derivano azioni di efficienza che in effetti le aziende possono fare.

Indice degli argomenti:

Costo dell’AI enterprise: i listini

Il caso OpenAI mostra bene perché parlare di “prezzi in aumento” senza distinguere i livelli dell’offerta è impreciso. Dal 2 aprile 2026 ChatGPT Business è costruito su due tipi di seat: la standard ChatGPT seat, a costo fisso per utente, e la Codex seat, a consumo e senza costo fisso mensile. La seat standard include accesso a ChatGPT e Codex, ma solo entro limiti inclusi: per l’uso oltre le soglie previste entrano in gioco i crediti del workspace.

Nello stesso aggiornamento OpenAI ha portato il prezzo della standard seat a 25 dollari per utente al mese con fatturazione mensile e 20 dollari con fatturazione annuale nella maggior parte dei Paesi. Il punto però non è solo il taglio del canone: per i workspace Business gli utenti hanno limiti per-seat sulle funzioni avanzate, mentre in Enterprise ed Edu il consumo avanzato passa da un shared credit pool a livello di contratto, senza cap per-seat di default ma con spend controls configurabili dagli amministratori.

Quindi una parte dell’offerta è diventata meno cara sul lato abbonamento, ma la monetizzazione si è spostata più chiaramente verso crediti, overage e controllo del consumo.

Per Anthropic invece nel nuovo Enterprise usage-based la seat fee copre l’accesso alla piattaforma, mentre tutto l’uso viene fatturato separatamente alle tariffe api standard; nei piani Enterprise seat-based legacy, invece, restano fee per seat, limiti inclusi ed eventuale extra usage. Anche il Team oggi è segmentato in seat Standard e Premium, con prezzi e limiti diversi.

Anche sulle api il quadro è competitivo.

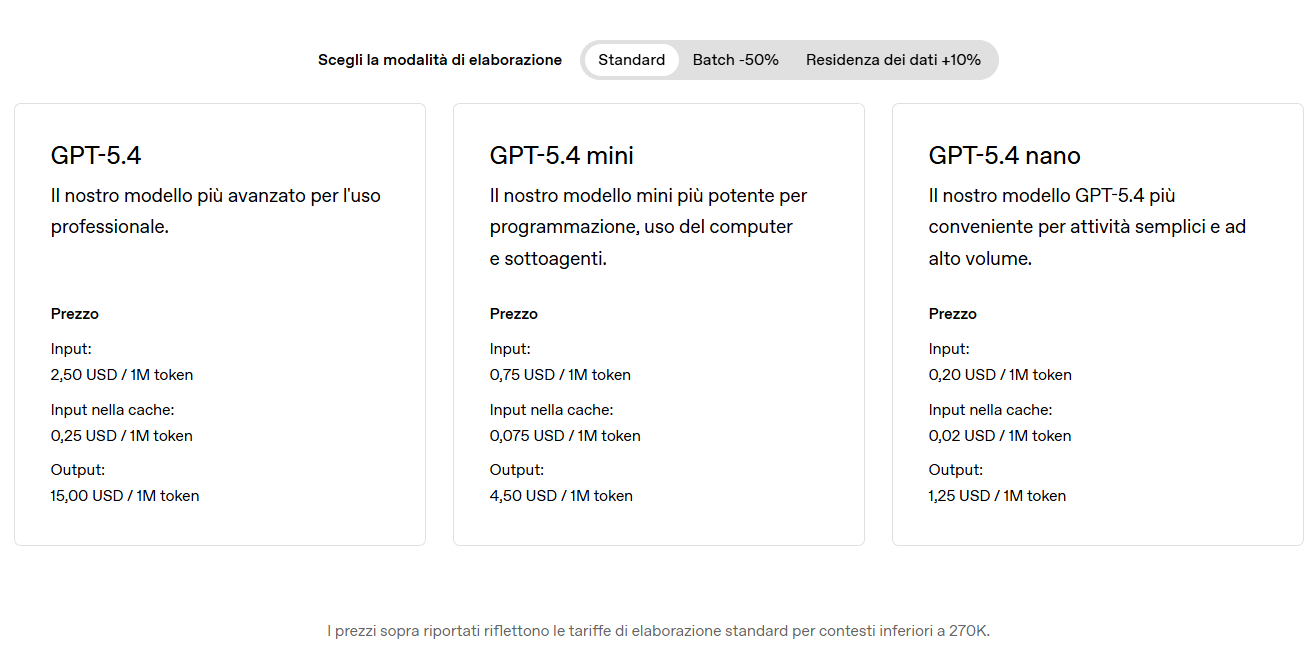

OpenAI quota oggi GPT-5.4 a 2,5 dollari per milione di token in input e 15 dollari in output; GPT-5.4 mini scende a 0,75 e 4,5 dollari, GPT-5.4 nano a 0,2 e 1,25 dollari. Anthropic quota Claude Sonnet 4.6 a 3 e 15 dollari; Haiku 4.5 a 1 e 5; Opus 4.6 a 5 e 25. Opus 4.7 a 5 e 25 dollari, allo stesso prezzo di Opus 4.6.

Il confronto diretto dice che OpenAI è spesso più economica nelle fasce standard e compatte, mentre Anthropic resta competitiva soprattutto dove contano coding e agenti. Il prezzo per token, insomma, non sta esplodendo.

In alcuni casi, anzi, il prezzo unitario è sceso molto rispetto alle generazioni precedenti. Nella documentazione Anthropic, Opus 4.7 e Opus 4.6 sono a 5 dollari per milione di token in input e 25 in output, mentre Opus 4.1 era a 15 e 75 dollari.

È un taglio di circa due terzi. Questo passaggio resta decisivo: il mattone base costa meno, ma la casa completa costa di più.

È un taglio di circa due terzi. Questo passaggio è decisivo: il mattone base costa meno, ma la casa completa costa di più.

Il costo vero si sposta dal token al workflow

La spesa sale perché le aziende non comprano più solo risposte testuali. Comprano workflow: coding, ricerca documentale, analisi dati, browser automation, retrieval su basi interne, agenti che restano attivi per minuti o ore.

OpenAI, nella pagina prezzi aggiornata, fa pagare a parte la web search a 10 dollari per 1.000 chiamate e i container per esecuzione e tool, che dal 31 marzo 2026 sono tariffati per sessione di 20 minuti per container.

Anthropic, nella pagina prezzi aggiornata, fa pagare a parte web search a 10 dollari per 1.000 ricerche, Managed Agents a 0,08 dollari per session-hour di runtime attivo e code execution con 50 ore gratuite al giorno per organizzazione, poi 0,05 dollari l’ora per container. Quando un task aziendale combina modello, tool, ricerca e runtime, il token smette di essere la metrica decisiva.

A questo si aggiunge la crescita dell’uso reale. OpenAI ha scritto il 27 febbraio 2026 che oltre 9 milioni di utenti business paganti usano ChatGPT per il lavoro. Il 31 marzo ha aggiunto che le sue api processano più di 15 miliardi di token al minuto e che l’enterprise vale ormai oltre il 40% dei ricavi.

Nel report “The state of enterprise AI”, pubblicato a dicembre 2025, la società indicava più di 7 milioni di workplace seat e una crescita di circa 9 volte anno su anno delle seat Enterprise. Non è quindi solo una questione di listini: è una questione di carichi che stanno entrando in produzione.

Anthropic sta correndo nella stessa direzione. Il 6 aprile 2026 ha annunciato un nuovo accordo con Google e Broadcom per più gigawatt di capacità TPU a partire dal 2027, dicendo apertamente che serve a sostenere una domanda “straordinaria”.

Nello stesso periodo, secondo Axios, il run-rate annualizzato ha toccato i 30 miliardi di dollari. Se i vendor firmano accordi di questo tipo è perché la domanda enterprise non sta rallentando: sta aumentando più in fretta della capacità disponibile.

La scarsità di compute sta entrando nei listini

Qui entrano le novità più importanti degli ultimi giorni. Il Wall Street Journal ha scritto il 13 aprile che la corsa all’AI sta prosciugando l’offerta di compute, con problemi di capacità che stanno già producendo razionamento, affidabilità più bassa e scelte di prodotto forzate.

Lo stesso articolo riporta che il noleggio orario dei chip Blackwell di Nvidia ha raggiunto 4,08 dollari, in aumento del 48% dai 2,75 dollari di due mesi prima secondo l’Ornn Compute Price Index, e che CoreWeave ha alzato i prezzi di oltre il 20% chiedendo ai clienti più piccoli impegni minimi di tre anni invece di uno.

È il segnale più concreto di una stretta di offerta che si trasferisce a valle, sui costi sostenuti da chi sviluppa e distribuisce servizi di ai.

OpenAI, nello stesso contesto, ha annunciato la chiusura dell’esperienza Sora su web e app dal 26 aprile 2026 e la dismissione dell’Api video dal 24 settembre 2026; il Wall Street Journal collega la scelta anche alla necessità di liberare capacità per coding ed enterprise.

Sarah Friar, chief financial officer di OpenAI, ha detto di passare molto tempo a cercare “any last-minute compute available” e di dover fare “very tough trades” su ciò che l’azienda non può perseguire per mancanza di capacità. Quando anche il leader del mercato parla così, il problema non è più teorico.

Anthropic offre un altro indicatore della stessa tensione. La pagina di stato ufficiale mostrava il 14 aprile un uptime del 99,1% per Claude API negli ultimi 90 giorni, del 98,84% per Claude.ai e del 99,27% per Claude Code; tra il 6 e il 13 aprile si sono susseguiti incidenti su login, errori di richiesta ai modelli, connettori e creazione di workspace.

Per un’azienda che usa questi sistemi in processi di produzione, il costo non è quindi soltanto quello della chiamata al modello, ma anche quello dell’architettura di continuità operativa: fallback, ridondanza e routing tra fornitori. È una spesa che il prezzo per token non mostra.

I vendor stanno monetizzando in un’industria ancora molto costosa

La pressione sui prezzi deriva anche dai costi industriali a monte. Un’altra inchiesta del Wall Street Journal, pubblicata l’8 aprile, scrive che OpenAI e Anthropic prevedono costi combinati per training e inference pari a 65 miliardi di dollari nel 2026, 127 miliardi nel 2027 e quasi 250 miliardi nel 2029.

Che cosa dovrebbero fare le aziende

- La prima mossa è smettere di misurare il progetto in dollari per milione di token e passare al costo per risultato: una pratica chiusa, un ticket risolto, una pull request approvata, un documento classificato. È su quel livello che si vede se l’AI sta creando margine o sta solo spostando spesa.

Deloitte, nel report 2026 sullo stato dell’AI in impresa, segnala che il 66% delle organizzazioni vede guadagni di produttività ed efficienza, ma solo il 40% riferisce già una riduzione dei costi e appena il 20% un aumento dei ricavi. La distanza tra adozione e ritorno economico, quindi, resta ampia.

2. La seconda mossa è costruire benchmark interni continui. Non basta scegliere un fornitore una volta. Serve confrontare modelli diversi sugli stessi task aziendali, misurando qualità, latenza, costo completo del workflow, affidabilità e requisiti di compliance.

OpenAI stessa, nei materiali per le imprese, insiste sul fatto che i casi di maggior valore emergono quando i team mappano workflow interi e non singoli prompt; Anthropic, sul lato Claude Code, mette già a disposizione telemetria via OpenTelemetry per tracciare costi, attività dei tool e uso organizzativo. Senza osservabilità, il pay-per-use resta opaco.

3. La terza mossa è segmentare i carichi. I casi ripetitivi, ad alto volume e con tolleranza maggiore all’errore possono stare su modelli mini, nano o su modelli open gestiti in proprio. I casi che richiedono ragionamento più profondo, coding complesso o agenti multistep possono restare su modelli frontier proprietari.

È questo il punto in cui entrano le valutazioni su open model. McKinsey rileva che il 60% dei decisori vede costi di implementazione più bassi con l’open source e il 46% costi di manutenzione inferiori; in un altro report del novembre 2025 osserva che l’open source sta diventando una leva di autonomia digitale per ridurre dipendenza dai vendor e migliorare controllo su governance, privacy e compliance. Non è una sostituzione totale dei modelli chiusi. È una strategia di portafoglio.

4. La quarta mossa è usare davvero gli strumenti di efficienza che i vendor già offrono. OpenAI applica sconti del 50% sul Batch API e propone anche tier Flex, meno costosi ma con tempi più lenti e disponibilità non garantita; Anthropic parla di risparmi fino al 50% con batch processing e fino al 90% con prompt caching su alcuni modelli.

Per workload asincroni, classificazione documentale, back office e generazione differita, questi strumenti possono ridurre la spesa in modo sostanziale senza riscrivere l’architettura.

5. La quinta mossa è riportare il tema dell’affidabilità dentro la negoziazione economica. Con questa combinazione di crescita, scarsità di compute e incidenti di servizio, non basta contrattare il prezzo del token o della seat. Bisogna discutere soglie di spesa, alert, crediti prepagati, fallback tra modelli, limiti di uso, monitoraggio e aspettative di servizio.

Conclusioni

Fino a poco fa molte aziende acquistavano AI come acquistano software: un numero di seat, un budget annuo, qualche progetto pilota. Nel 2026 il mercato si sta spostando verso una logica più vicina al cloud infrastructure pricing: consumo, priorità, crediti, tool, reserved capacity, servizi differenziati per latenza e disponibilità.

La stessa pagina prezzi di OpenAI distingue ormai tra batch processing scontato del 50%, flex processing con costi più bassi ma disponibilità non garantita, e offerte enterprise come reserved capacity e scale tier. È un linguaggio da infrastruttura, non da semplice abbonamento software.

Nel 2026 l’enterprise AI non si compra più come una semplice licenza software: si governa come una componente infrastrutturale, con quote di accesso, limiti inclusi, consumo extra, tool separati e capacità differenziata per disponibilità e performance.

bravi