OpenAI spinge sull’uso dell’intelligenza artificiale nella cybersicurezza e prova a farlo con una distinzione più netta tra accesso generale e accesso riservato ai difensori verificati. Il passaggio chiave è l’estensione di Trusted Access for Cyber, il programma che consente a team e ricercatori autorizzati di usare GPT-5.5 con meno blocchi automatici nelle attività difensive, e il lancio in anteprima limitata di GPT-5.5-Cyber, una variante più permissiva destinata a chi protegge infrastrutture critiche e opera in contesti controllati.

La società presenta questa evoluzione come una risposta al nodo che accompagna da anni gli strumenti di ai applicati alla sicurezza: aiutare chi difende senza abbassare le barriere contro usi offensivi o criminali. Il punto non è solo la qualità del modello, ma il modo in cui l’accesso viene graduato in base all’identità dell’utente, al tipo di organizzazione, al contesto operativo e ai controlli di sicurezza associati all’account.

Indice degli argomenti:

Che cosa cambia con Trusted Access for Cyber

Il meccanismo descritto da OpenAI è basato su identità e fiducia. In pratica, gli utenti approvati per Trusted Access for Cyber ottengono un modello che rifiuta meno richieste legate a compiti difensivi legittimi. L’azienda cita, tra gli usi consentiti, l’identificazione e il triage delle vulnerabilità, l’analisi di malware, il reverse engineering di binari, la detection engineering e la validazione delle patch.

Il principio è semplice: se un ricercatore o un team di sicurezza sta lavorando in un ambiente autorizzato, il modello deve poter essere più utile e meno incline a fermarsi davanti a richieste che, lette senza contesto, potrebbero apparire dual use. Questa riduzione dei rifiuti automatici, però, non equivale a un via libera generale. OpenAI dice di continuare a bloccare attività come il furto di credenziali, i meccanismi di persistenza, la distribuzione di malware, le tecniche di stealth e lo sfruttamento di sistemi di terzi.

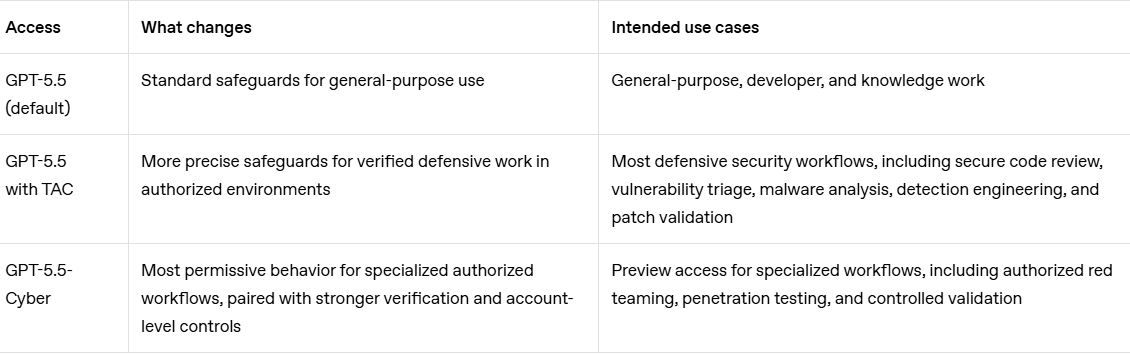

La novità più significativa è che l’azienda non propone un unico livello di capacità. Definisce invece tre gradini. Il primo è GPT-5.5 nella versione standard, con salvaguardie generali per uso generico, sviluppo software e lavoro di conoscenza. Il secondo è GPT-5.5 con Trusted Access for Cyber, pensato per la maggior parte dei flussi di lavoro difensivi.

Il terzo è GPT-5.5-Cyber, la versione più permissiva, riservata in anteprima a processi specialistici come red teaming autorizzato, penetration test e validazioni controllate.

Il nodo dei controlli: meno rifiuti, più verifica

Per OpenAI, l’aumento delle capacità deve andare di pari passo con misure più rigide sugli account. Dal 1° giugno 2026, i singoli membri del programma che accedono ai modelli più permissivi sul piano cyber dovranno attivare Advanced Account Security, cioè protezioni dell’account resistenti al phishing. Le organizzazioni potranno in alternativa attestare l’uso di autenticazione resistente al phishing all’interno del proprio sistema single sign-on.

È un passaggio rilevante perché segnala il tentativo di portare la sicurezza dell’utente dentro la sicurezza del modello. Se un sistema AI può assistere attività molto sensibili, il rischio non riguarda solo il prompt, ma anche l’eventuale compromissione dell’identità di chi lo usa.

In altre parole, OpenAI prova a costruire un regime di accesso in cui la fiducia non si basa soltanto sulla dichiarazione di intenti del cliente, ma anche su controlli tecnici minimi.

La differenza tra GPT-5.5 e GPT-5.5-Cyber

La distinzione tra i livelli emerge soprattutto nelle richieste che toccano la validazione pratica di una vulnerabilità. OpenAI porta un esempio concreto: la creazione di una proof of concept a partire da una vulnerabilità pubblicata per verificare una remediation in un ambiente autorizzato. Nella versione standard, GPT-5.5 può rifiutare del tutto la richiesta o limitarsi a suggerire alternative difensive, come scanner di versione, controlli ci/cd, regole di rilevamento o documentazione senza dettagli sfruttabili.

Con Trusted Access for Cyber, invece, il modello può aiutare di più nei flussi difensivi autorizzati, conservando comunque paletti di sicurezza. Il salto successivo riguarda i casi in cui un difensore deve spingersi oltre l’analisi e verificare l’exploitability in un ambiente controllato.

Qui entra in gioco GPT-5.5-Cyber, progettato per workflow più specialistici e ad alto rischio potenziale, ma ammessi solo in presenza di verifiche più forti, monitoraggio dell’uso e una cornice di utilizzo approvata.

OpenAI fa un esempio ancora più esplicito: l’esecuzione di un exploit su un target live per recuperare l’output di un comando di sistema. In quel caso, GPT-5.5 con TAC si ferma alla validazione difensiva e alla prioritizzazione della remediation. GPT-5.5-Cyber, invece, viene descritto come capace di supportare un flusso di exploit live in un contesto autorizzato e controllato.

È questo il punto più delicato dell’annuncio, perché mostra con chiarezza quanto il nuovo livello di accesso si avvicini a capacità operative che, fuori da un perimetro strettamente governato, sarebbero ad alto rischio di abuso.

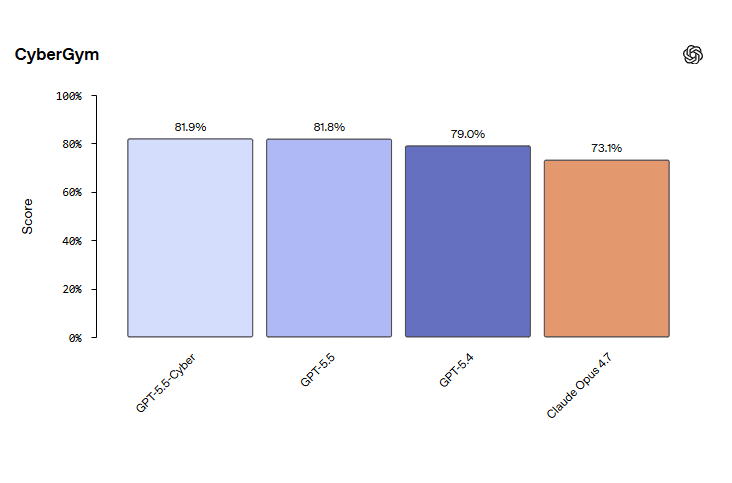

Perché OpenAI insiste sul fatto che non conta solo la potenza del modello

L’azienda sottolinea che questa prima anteprima di GPT-5.5-Cyber non nasce per aumentare in modo netto la capacità cyber rispetto a GPT-5.5. L’obiettivo iniziale, scrive, è soprattutto rendere il modello più permissivo sulle richieste di sicurezza. È una distinzione importante. OpenAI non sostiene che GPT-5.5-Cyber sia necessariamente migliore in ogni valutazione tecnica. Sostiene che sia più adatto a un insieme ristretto di attività autorizzate che, con il modello standard o con TAC, possono ancora incontrare rifiuti.

Questo approccio serve a giustificare una distribuzione graduale. Prima si concede un accesso più ampio ai workflow difensivi più comuni, poi si testa con un gruppo ristretto di partner se abbia senso aprire di più sui casi specialistici. Il modello, in questa lettura, è solo un pezzo di una catena composta anche da verifica dell’identità, monitoraggio degli abusi, delimitazione degli usi approvati e raccolta di feedback da organizzazioni partner.

Il “security flywheel”: la strategia industriale dietro il progetto

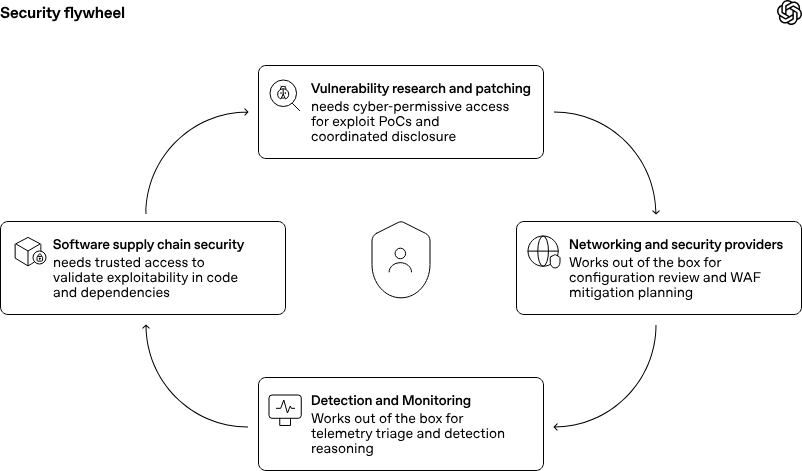

OpenAI lega questa architettura a un’idea precisa: la cybersicurezza come filiera in cui ogni anello rafforza gli altri. L’azienda la descrive come un “security flywheel”, una ruota composta da ricerca sulle vulnerabilità e patching, sicurezza della supply chain software, monitoraggio e rilevamento, protezione di rete e mitigazione.

Il ragionamento è lineare. I ricercatori individuano una vulnerabilità, la validano e producono indicazioni per correggerla. I fornitori di strumenti di supply chain bloccano la propagazione di codice o dipendenze compromesse. I partner che lavorano su endpoint detection and response e siem intercettano segnali di sfruttamento in ambienti reali. I provider di rete e sicurezza applicano mitigazioni, regole waf e modifiche di configurazione per ridurre l’esposizione mentre le patch vengono distribuite.

Se ogni passaggio accelera, sostiene OpenAI, la protezione per il cliente finale arriva prima. È qui che l’azienda colloca il valore economico e industriale del programma: non solo assistenza al singolo analista, ma una riduzione del tempo che separa la scoperta di una falla dalla protezione effettiva di sistemi, aziende e servizi pubblici.

I partner industriali: Cisco, Intel, SentinelOne, Snyk

A sostegno di questa impostazione, OpenAI cita diversi partner.

Cisco presenta i modelli di frontiera come un moltiplicatore di forza per i difensori e insiste sul fatto che velocità e fiducia debbano crescere insieme. Intel inquadra la collaborazione come un modo per portare capacità di ai governate e scalabili nei workflow di ricerca delle vulnerabilità e remediation.

SentinelOne si concentra sull’accelerazione dell’analisi: collegare la telemetria, selezionare i segnali rilevanti e migliorare indagine, detection e risposta.

Snyk, infine, mette l’accento sulla supply chain software e sul fatto che gli attaccanti stiano già sfruttando modelli avanzati.

Queste dichiarazioni hanno un valore soprattutto strategico. Mostrano dove OpenAI vuole posizionarsi: non come fornitore di un chatbot generalista con qualche funzione di sicurezza, ma come componente di una infrastruttura enterprise integrata nei processi di sviluppo sicuro, indagine sugli incidenti, monitoraggio e difesa della catena del software.

Rete, patching, monitoraggio: dove il modello può avere impatto

Nella protezione di rete, il beneficio atteso riguarda la fase in cui la correzione non è ancora arrivata ovunque. In quel lasso di tempo, un modello come GPT-5.5 può assistere nella revisione di regole, nell’analisi delle configurazioni, nelle indagini di incidente e nella gestione sicura dei cambiamenti. L’utilità aumenta nei contesti distribuiti, dove la velocità con cui si applicano mitigazioni temporanee fa la differenza tra un rischio contenuto e una compromissione diffusa.

Nella ricerca delle vulnerabilità e nel patching, OpenAI assegna a GPT-5.5 con TAC il grosso del lavoro: comprendere codice sconosciuto, mappare le superfici colpite, risalire alla causa del problema, esaminare patch, costruire ambienti di riproduzione sicuri, assegnare priorità e trasformare i risultati in linee guida di remediation. GPT-5.5-Cyber viene riservato ai casi in cui serve una permissività maggiore, per esempio nella costruzione di proof of concept necessarie a disclosure coordinate o a validazioni strettamente controllate.

Nel monitoraggio e nella detection, il punto è ridurre il tempo che separa un advisory pubblico dalla capacità concreta di vedere se qualcuno stia già sfruttando quella falla. In questo passaggio, modelli di linguaggio e ragionamento possono aiutare gli analisti a collegare telemetria, allarmi e contesto tecnico, sintetizzando quello che conta e accelerando la scrittura di regole di rilevamento o workflow di risposta.

Il fronte della supply chain software

Una parte centrale della strategia riguarda il software supply chain risk. Quando una dipendenza vulnerabile o compromessa entra nel processo di build, il problema si propaga rapidamente da un progetto all’altro. OpenAI indica qui il contributo di GPT-5.5 con TAC: esaminare modifiche nelle dipendenze, ragionare sull’exploitability nel codice posseduto dall’organizzazione, dare priorità alle correzioni e individuare comportamenti sospetti dei pacchetti nelle prime fasi dello sviluppo.

La società cita partner come Snyk, Gen Digital, Semgrep e Socket e richiama casi come quello di axios compromise, dove la correzione più efficace non consiste nell’intervenire a valle, ma nel bloccare subito l’ingresso di codice vulnerabile o compromesso nel processo di compilazione e rilascio. È un punto decisivo anche per la spesa it: prevenire un incidente nella supply chain costa meno che gestire la contaminazione in produzione.

Codex Security e il tentativo di agire a monte

Accanto ai modelli GPT, OpenAI inserisce anche Codex Security, uno strumento pensato per aiutare i team a identificare, validare e correggere vulnerabilità costruendo un threat model specifico per il codice, esplorando percorsi di attacco realistici, verificando i problemi in ambienti isolati e proponendo patch da sottoporre a revisione umana.

L’azienda annuncia inoltre Codex for Open Source, che dovrebbe offrire a manutentori selezionati di progetti critici un accesso condizionato a Codex Security, oltre a crediti Codex e api per alleggerire il carico di manutenzione e review. È una mossa che punta al livello più fragile e insieme più importante dell’ecosistema: il software open source da cui dipendono migliaia di applicazioni e servizi.

Il punto politico e regolatorio dell’annuncio

OpenAI collega questa evoluzione a colloqui con leader della cybersicurezza e della sicurezza nazionale, a livello federale e statale, oltre che con grandi soggetti commerciali. Il riferimento serve a collocare il progetto dentro una logica di interesse pubblico, soprattutto quando si parla di infrastrutture critiche e servizi essenziali.

Resta però una questione aperta: quanto sia possibile allargare l’accesso a capacità sempre più permissive senza aumentare il rischio sistemico. OpenAI risponde dicendo che l’espansione dipenderà dal rafforzamento di tre elementi: verifica dell’identità e dell’organizzazione, delimitazione degli usi approvati e monitoraggio degli abusi. La formula è chiara, ma la tenuta pratica dipenderà dalla qualità dei controlli, dal rigore con cui verranno applicati e dalla trasparenza con cui verranno gestiti incidenti, violazioni o errori di classificazione.

Il mercato della sicurezza guarda al tempo, non solo alla precisione

Dal punto di vista economico, il valore di questi strumenti non si misura soltanto nella qualità tecnica delle risposte. Conta soprattutto il tempo risparmiato. Ridurre di ore o giorni il passaggio tra scoperta, verifica, patching, detection e mitigazione può tradursi in minori perdite, meno interruzioni di servizio e minori costi di incident response.

È questo il terreno su cui OpenAI prova a convincere clienti enterprise, vendor di sicurezza e attori pubblici. GPT-5.5 con Trusted Access for Cyber viene presentato come il punto di ingresso per la maggior parte dei workflow legittimi. GPT-5.5-Cyber, invece, resta confinato a una platea più ristretta, almeno in questa fase, per studiare dove una maggiore permissività produca un vantaggio reale senza compromettere la sicurezza complessiva.

La promessa finale è che l’accesso si allargherà nel tempo, man mano che miglioreranno verifiche e controlli. È una traiettoria coerente con la strategia di OpenAI: usare l’ai come acceleratore della difesa, distribuendo capacità sensibili in modo selettivo e progressivo. La prova decisiva, però, non sarà nella formulazione del framework. Sarà nella capacità di dimostrare che questi modelli aiutano davvero a chiudere le falle più in fretta di quanto possano essere sfruttate.