Il 23 aprile 2026 OpenAI ha presentato GPT-5.5, a sette settimane da GPT-5.4. Il modello arriva insieme alla variante Pro, è già disponibile per gli utenti Plus, Pro, Business ed Enterprise di ChatGPT e Codex, con l’API in arrivo a 5 dollari per milione di token in input e 30 in output.

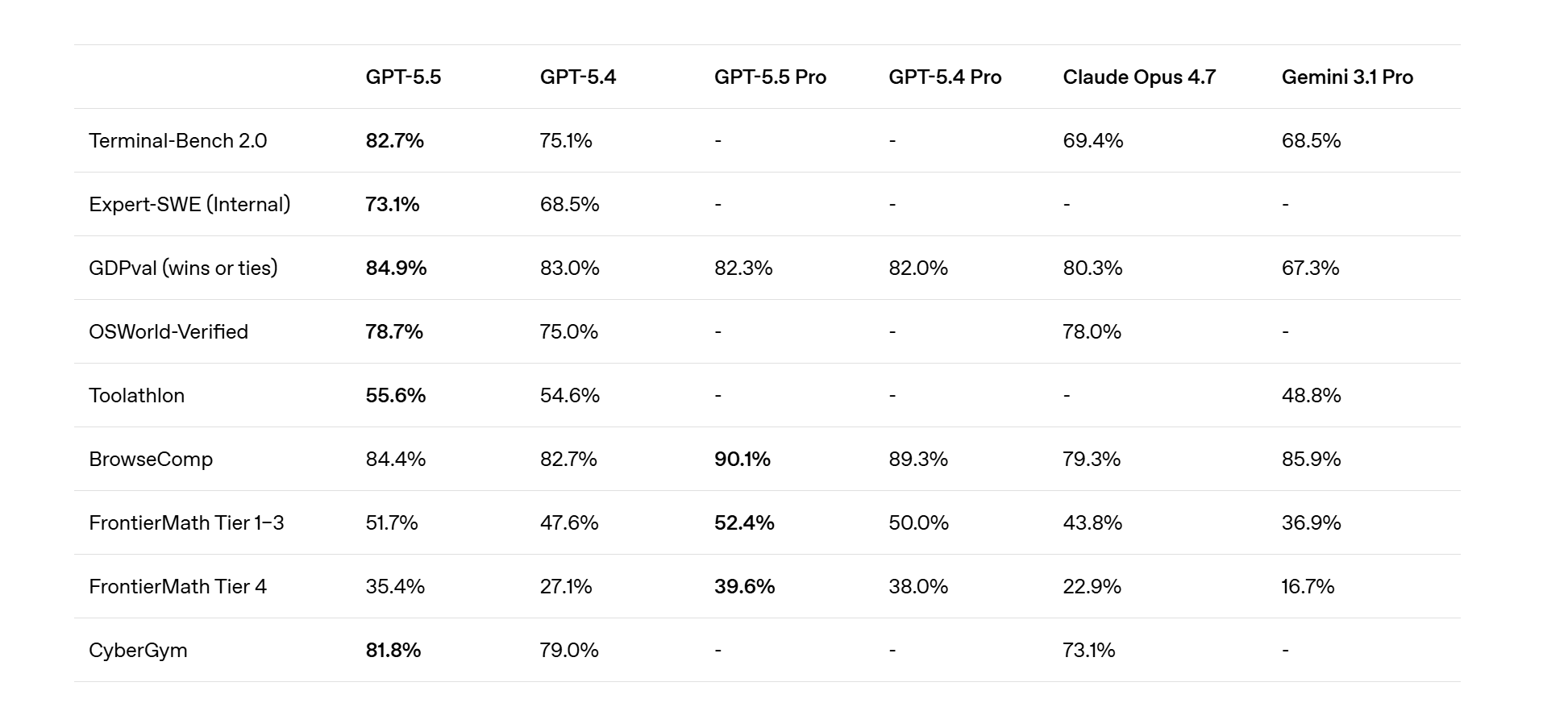

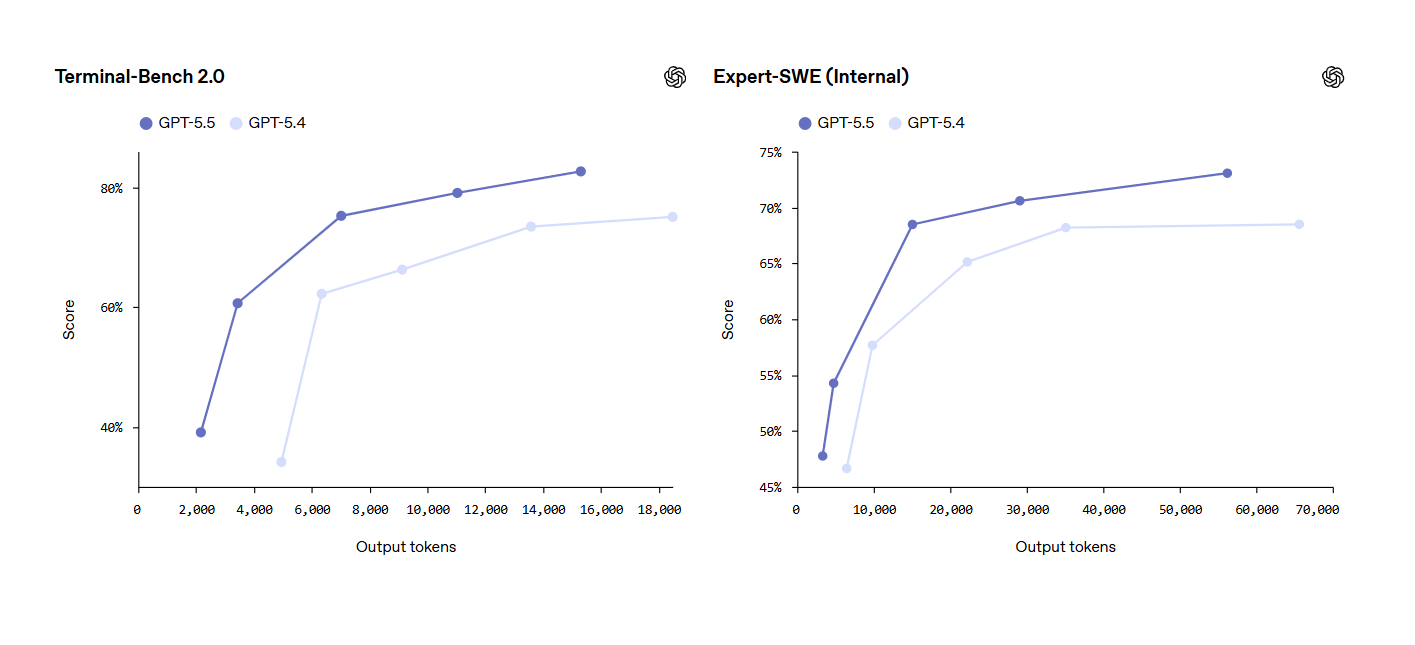

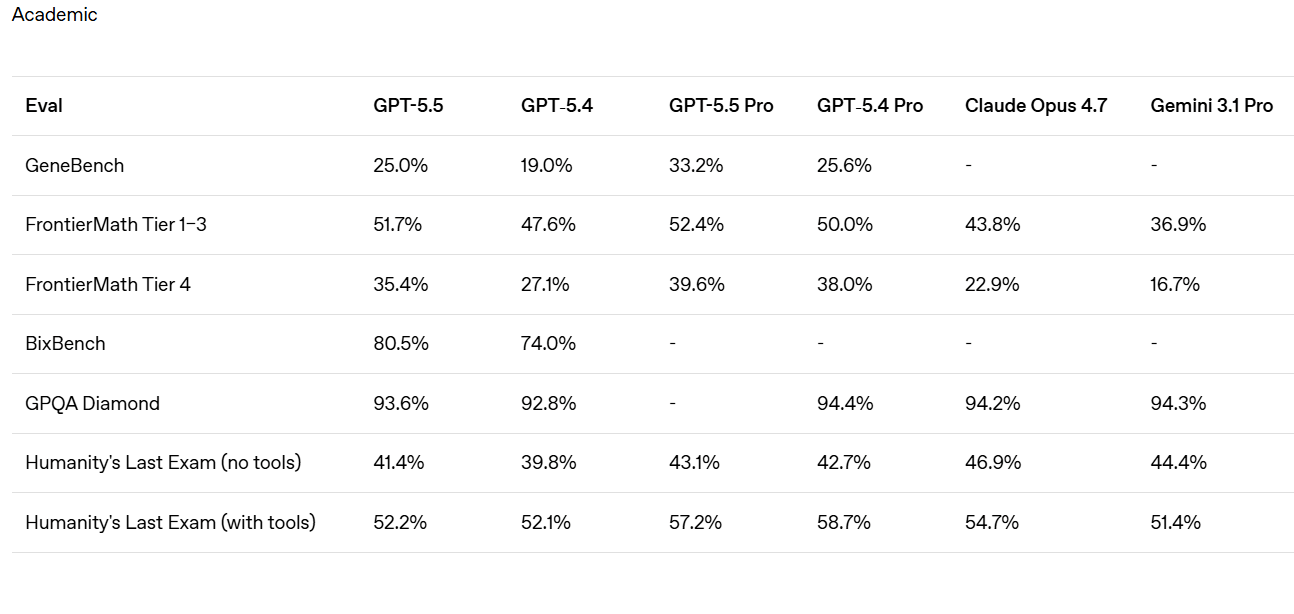

Il numero che ha fatto più rumore è 82,7%: lo score su Terminal-Bench 2.0, il benchmark che misura la capacità di un modello di gestire flussi di lavoro complessi da riga di comando, con pianificazione, iterazione e coordinamento di strumenti. GPT-5.4 si fermava al 75,1%, Claude Opus 4.7 al 69,4%, Gemini 3.1 Pro al 68,5%. La distanza è di quelle che si vedono a occhio in produzione, su task reali.

Indice degli argomenti:

Efficienza, velocità e costi di GPT-5.5

Il punto però non sta solo nel salto rispetto ai concorrenti. OpenAI rivendica un miglioramento su quasi ogni dimensione misurata, mantenendo la stessa latenza per token di GPT-5.4, riducendo il numero di token consumati per completare lo stesso compito e spingendo oltre il 20% la velocità di generazione grazie a nuove euristiche di load balancing co-progettate con Nvidia sui sistemi GB200 e GB300 NVL72.

Un modello più intelligente, più parsimonioso nei costi operativi a parità di output, più veloce nella restituzione, e più caro al token singolo. Vettori che di solito si spingono a vicenda in direzioni contrarie, e qui convivono.

GPT-5.5 e agentic coding nel lavoro di sviluppo

La parola d’ordine è “agentic coding”. Un modello che non si limita a rispondere a domande di programmazione, ma prende in carico un task, lo pianifica, usa strumenti, verifica i propri risultati intermedi, porta avanti il lavoro senza fermarsi a ogni passaggio.

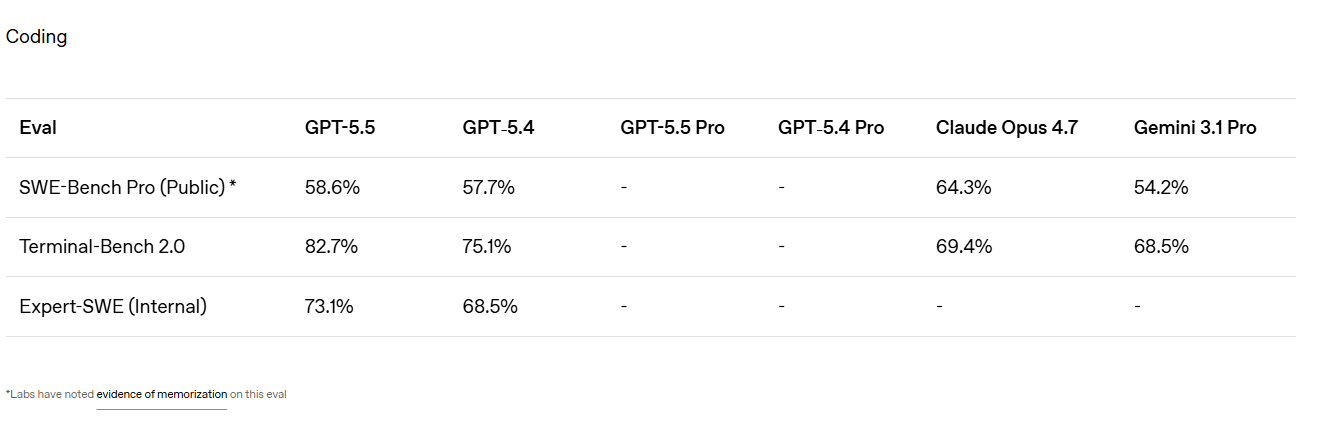

Su SWE-Bench Pro, che valuta la risoluzione di issue GitHub reali, GPT-5.5 raggiunge il 58,6% in singolo passaggio, mentre Claude Opus 4.7 mantiene un vantaggio al 64,3% per i task multi-file complessi.

La lettura dei benchmark restituisce una mappa di punti di forza specifici, che in produzione si traducono in scelte di modello diverse a seconda della natura del task.

Feedback degli sviluppatori e capacità di comprensione

I feedback degli sviluppatori in preview insistono su un aspetto che nei numeri si intuisce ma non si legge: il modello capisce la forma di un sistema software. Perché qualcosa sta fallendo, dove il fix deve atterrare, cosa si rompe a valle se si tocca una certa classe.

Dan Shipper, founder di Every, lo ha descritto come il primo modello di coding con una seria chiarezza concettuale: dopo giorni di debug post-lancio di un’app, il suo team aveva dovuto chiamare un senior engineer per riscrivere una parte del sistema, GPT-5.4 a quel tipo di riscrittura non ci era arrivato, GPT-5.5 a parità di input sì.

Michael Truell di Cursor ha aggiunto un dettaglio operativo che chiunque abbia provato a mettere in produzione un agente riconosce: il modello rimane sul compito più a lungo, non molla prima del previsto. Era il problema cronico dei modelli precedenti sui task lunghi, e non era risolvibile con prompt migliori.

GPT-5.5 nella ricerca scientifica e nel co-scientist

Il ragionamento esce dal laboratorio, ricerca scientifica e co-scientist. Il capitolo più sorprendente del comunicato riguarda la ricerca scientifica. Una versione interna di GPT-5.5 con un harness dedicato ha contribuito a trovare una nuova dimostrazione su un fatto asintotico riguardante i numeri di Ramsey off-diagonali, un oggetto centrale della combinatoria, poi verificata formalmente in Lean.

La combinatoria studia come oggetti discreti si combinano fra loro, grafi, reti, insiemi, pattern, e i numeri di Ramsey chiedono, in soldoni, quanto deve essere grande una rete perché emerga inevitabilmente un certo tipo di ordine.

Risultati in quest’area sono rari, tecnicamente tosti, e che un LLM contribuisca a un risultato formalmente verificabile su questo terreno è una notizia diversa da “il chatbot scrive meglio le email”.

Applicazioni reali di GPT-5.5 nella bioinformatica

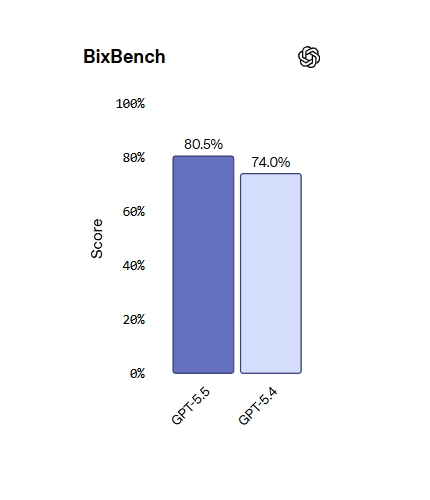

Su BixBench, un benchmark di bioinformatica costruito su dati reali, GPT-5.5 raggiunge l‘80,5% contro il 74% di GPT-5.4. Un professore di immunologia citato nel comunicato ha usato GPT-5.5 Pro per analizzare un dataset con 62 campioni e circa 28mila geni, producendo un report che a detta sua avrebbe richiesto mesi al suo team.

Sono aneddoti, vanno letti con cautela, però il pattern è coerente con le altre testimonianze raccolte dalle testate che hanno seguito il lancio: il modello è utile non solo per rispondere a domande, ma per iterare su un problema distribuito nel tempo. Per stare dentro una ricerca.

GPT-5.5 nel lavoro d’ufficio e knowledge work

Sul lavoro d’ufficio OpenAI spinge forte sul concetto di knowledge work: analisi di dati, generazione di documenti e presentazioni, automazione di flussi aziendali. Internamente il team Finance di OpenAI ha usato GPT-5.5 in Codex per revisionare 24.771 moduli fiscali K-1 per un totale di 71.637 pagine, accorciando di due settimane il ciclo rispetto all’anno precedente.

Non è un caso d’uso per tutti, dà però la scala su cui il modello può operare quando ha accesso ai file e ai sistemi giusti.

Benchmark professionali e confronto con i concorrenti

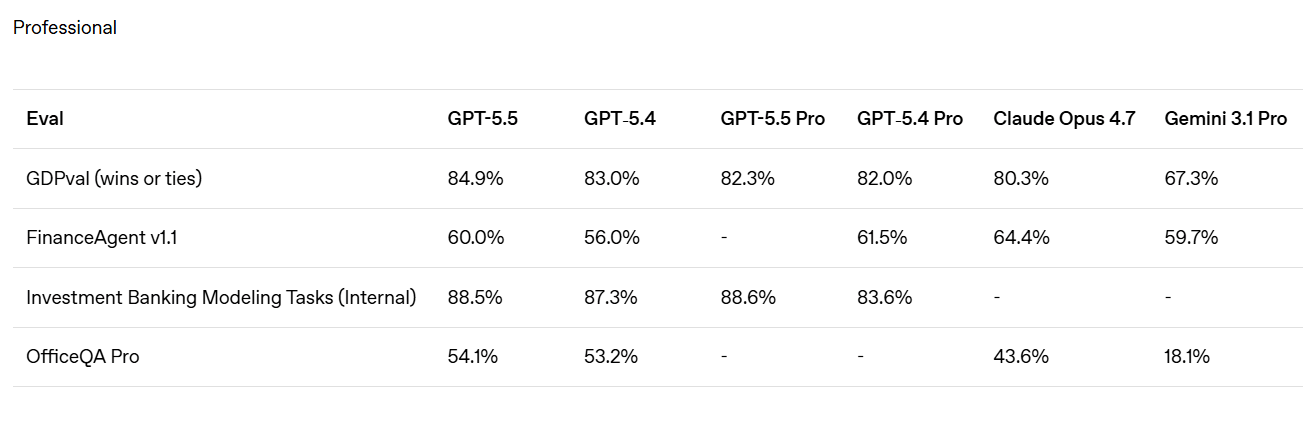

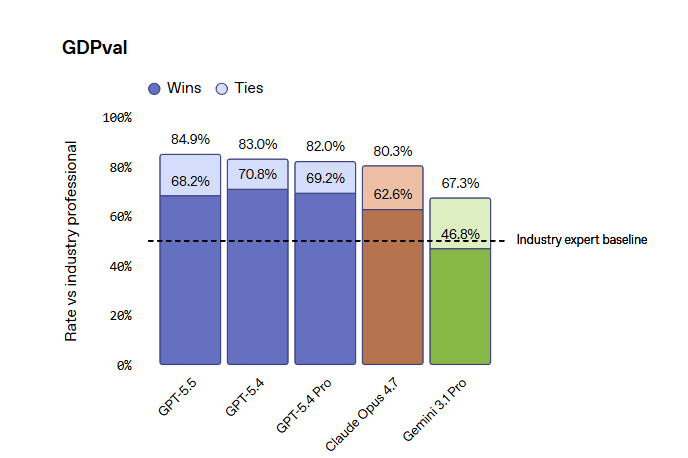

Su GDPval, la metrica che OpenAI usa per valutare il lavoro di conoscenza, GPT-5.5 arriva all’84,9%, contro il 46,8% di Gemini 3.1 Pro.

Vale la pena soffermarsi un attimo su cosa significhi GDPval, perché è un benchmark diverso dagli altri, misura la produzione di artefatti professionali reali, un pitch deck di vendita, uno scheduling da pronto soccorso, una scheda fiscale.

Sul FinanceAgent v1.1, invece, Claude Opus 4.7 resta davanti al 64,4% contro il 60,0% di GPT-5.5, e OpenAI lo ammette apertamente nella tabella ufficiale, cosa che è una novità rispetto ai lanci precedenti quando le comparison venivano pubblicate solo dove vincevano.

Prezzi, token e costo reale per outcome

Il tema dei costi merita un’osservazione specifica, perché qui si gioca buona parte del ragionamento di adozione enterprise. Il prezzo API è il doppio di GPT-5.4 al token, 5/30 dollari per milione invece di 2,5/15 (GPT-5.5 Pro addirittura 30/180), ma OpenAI dichiara che per completare gli stessi task in Codex il modello usa significativamente meno token.

Il costo reale per outcome, non per token, può essere quindi più basso. Va verificato sul campo, caso per caso, ed è un pattern di pricing che premia chi misura la spesa in funzione del risultato prodotto, non del consumo grezzo. Per chi ragiona in ottica agentica, è esattamente il metro giusto.

Sicurezza e cybersecurity con GPT-5.5

Sul fronte safety OpenAI classifica le capacità biologiche/chimiche e di cybersecurity di GPT-5.5 come “High”, un gradino sotto il livello “Critical”, e pubblica un set di safeguard più stretto rispetto alla precedente generazione.

Nella pratica, chi lavora su ricerca legittima in ambito cyber può trovare qualche filtro in più all’inizio, con qualche falso positivo su richieste che su GPT-5.4 passavano tranquille. Esiste un programma di Trusted Access per i verified defender, chi fa difesa di infrastrutture critiche può richiederne l’accesso dedicato.

Competizione tra modelli AI

C’è anche un elemento contestuale che vale la pena tenere a mente per leggere la partita competitiva. Anthropic ha una cosa chiamata Claude Mythos Preview che resta fuori dalla disponibilità commerciale, viene classificata da Anthropic come asset strategico difensivo ad alto rischio cyber e accessibile solo a un numero ristretto di partner e agenzie governative.

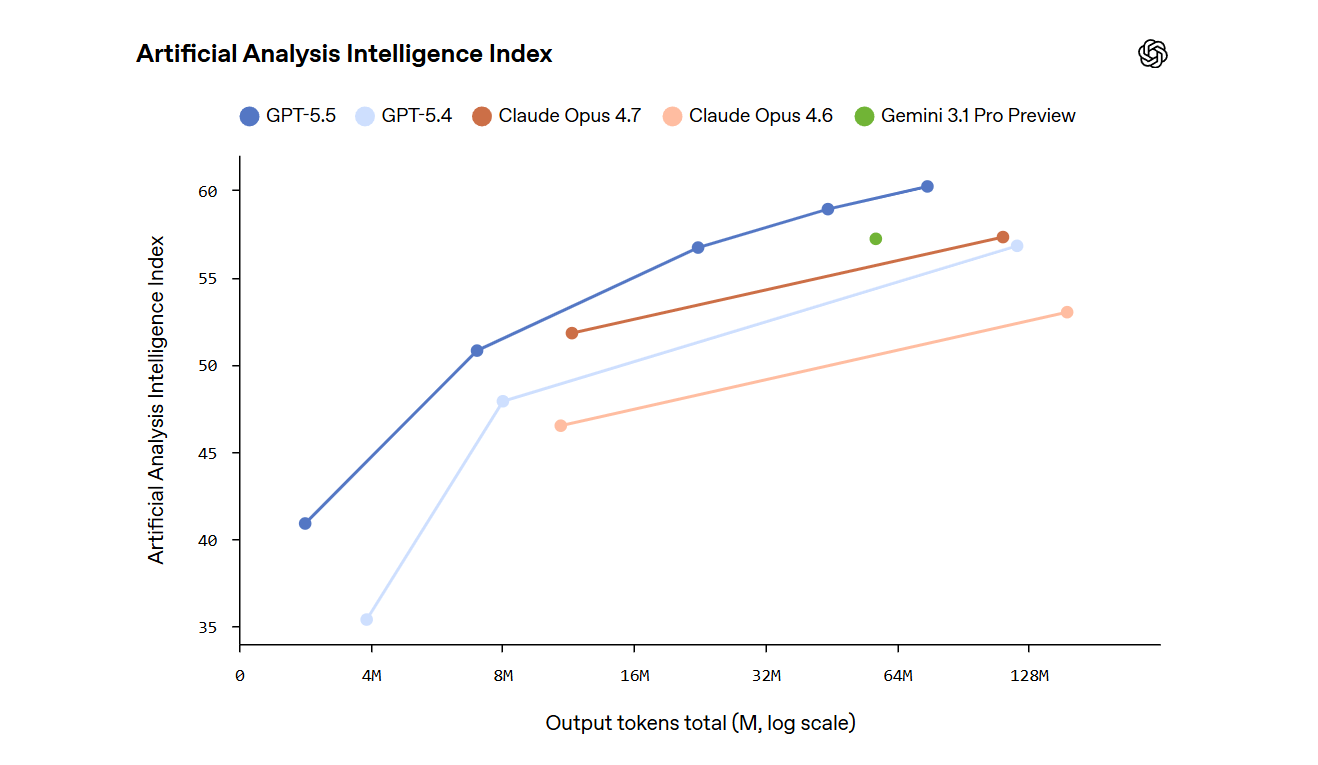

La competizione sul mercato commerciale resta quindi tra GPT-5.5, Gemini 3.1 Pro e Claude Opus 4.7, e su quel perimetro GPT-5.5 ritorna in cima alla classifica composita Artificial Analysis Intelligence Index con 59 punti, contro una media dei modelli comparabili di 33.

Impatto di GPT-5.5 nelle aziende

Dal punto di vista di chi adotta AI in azienda, il lancio pone tre questioni concrete, che conviene affrontare subito senza aspettare il prossimo round di release.

La prima è di procurement. Se l’organizzazione ha contratti aperti su GPT-5.4, il salto a GPT-5.5 richiede una rivalutazione del rapporto costo/outcome sui casi d’uso effettivamente in produzione.

La seconda questione è di architettura. Un modello che capisce la forma di un sistema software cambia il perimetro di cosa si può delegare a un agente rispetto a ciò che resta nelle mani dell’ingegnere.

La terza è di portfolio. GPT-5.5 non è il miglior modello su ogni cosa, la pratica aziendale sensata è costruire un’architettura multi-modello.

La sfida organizzativa dell’adozione AI

Resta una domanda aperta, la più interessante, quella che nessun benchmark cattura: quanto velocemente le organizzazioni riescono ad assorbire questo tasso di innovazione. Sette settimane tra GPT-5.4 e GPT-5.5 è un ciclo che la maggior parte delle aziende non sa ancora come governare.

Il rischio di rimanere sempre un modello indietro non è tecnologico, è organizzativo. Senza dubbio il ritmo continuerà, OpenAI lo ha dichiarato, Anthropic pure, Google anche. La vera competizione, allora, sarà tra chi ha disegnato processi capaci di assorbire questi salti e chi no?