L’accesso affidabile agli strumenti di difesa cyber entra in una nuova fase per OpenAI con l’espansione del programma Trusted Access for Cyber (TAC) e il lancio di GPT-5.4-Cyber, un modello di intelligenza artificiale addestrato per casi d’uso legati alla sicurezza informatica. L’iniziativa nasce in un contesto in cui la crescita delle capacità dell’AI procede insieme all’aumento dei rischi digitali.

Negli ultimi anni, le infrastrutture digitali globali hanno mostrato vulnerabilità strutturali. Sistemi software, reti e servizi pubblici sono esposti a minacce sempre più sofisticate. L’intelligenza artificiale ha accelerato questo processo: da un lato consente ai difensori di individuare e correggere falle più rapidamente, dall’altro offre nuovi strumenti anche agli attaccanti.

OpenAI ha costruito la propria strategia su tre direttrici:

- accesso democratizzato,

- distribuzione progressiva delle tecnologie

- rafforzamento dell’ecosistema della sicurezza.

L’espansione del programma TAC rappresenta un passaggio operativo di questa impostazione.

Indice degli argomenti:

TAC, un programma in espansione: più accesso, più controlli

Il programma Trusted Access for Cyber viene esteso a migliaia di professionisti verificati e a centinaia di team impegnati nella protezione di software critici. L’obiettivo dichiarato è ampliare la platea dei difensori senza compromettere i sistemi di sicurezza.

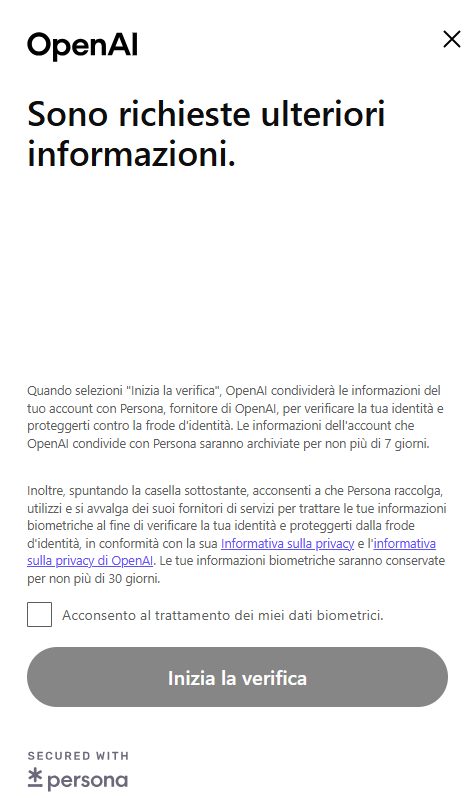

L’accesso agli strumenti più avanzati non è libero, ma regolato da criteri verificabili. Tra questi, procedure di identificazione rigorose (KYC, Know Your Customer) e sistemi automatizzati di validazione dell’identità. Il principio è evitare decisioni arbitrarie su chi possa utilizzare tecnologie sensibili, sostituendole con criteri oggettivi e tracciabili.

Questo approccio mira a includere soggetti diversi: grandi aziende, sviluppatori indipendenti, enti pubblici e organizzazioni che gestiscono infrastrutture critiche. La logica è ampliare le capacità difensive dove esiste una responsabilità concreta nella protezione dei sistemi digitali.

GPT-5.4-Cyber: un modello per la sicurezza offensiva e difensiva

Il cuore tecnologico dell’iniziativa è GPT-5.4-Cyber, una versione del modello GPT-5.4 modificata per supportare attività avanzate di cybersecurity. Il modello è stato addestrato per essere più “permissivo” nei contesti legittimi di sicurezza, riducendo i limiti automatici che spesso bloccano operazioni a doppio uso.

Tra le funzionalità principali figura la capacità di analisi di software compilato, anche in assenza del codice sorgente. Questo consente attività come il reverse engineering binario, fondamentale per individuare malware, vulnerabilità e criticità strutturali nei programmi.

L’accesso a GPT-5.4-Cyber è limitato nella fase iniziale. Il rilascio avviene in modo graduale e controllato, coinvolgendo aziende di sicurezza, ricercatori e organizzazioni verificate. La scelta riflette la natura delicata dello strumento, che può essere utilizzato sia per difesa sia per attacco.

Difensori e attaccanti: una corsa parallela

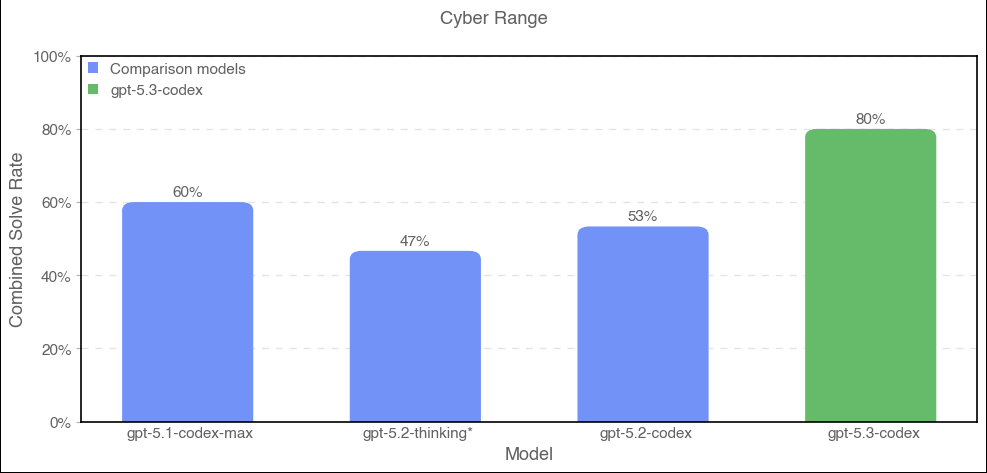

L’evoluzione dell’intelligenza artificiale ha ridotto i tempi necessari per analizzare codice, identificare vulnerabilità e sviluppare exploit. Secondo OpenAI, già oggi modelli esistenti sono in grado di supportare fasi rilevanti del ciclo operativo cyber, dall’analisi alla correzione.

Allo stesso tempo, gruppi ostili stanno sperimentando approcci basati su AI per migliorare le proprie capacità. L’uso di tecniche avanzate, come l’aumento della potenza di calcolo durante i test (test-time compute), consente di ottenere risultati sempre più sofisticati anche da modelli già disponibili.

Questo scenario impone un cambio di strategia: le misure di sicurezza non possono attendere una soglia futura di rischio, ma devono evolvere in parallelo con le capacità tecnologiche.

Il ruolo delle salvaguardie e del controllo dell’accesso

Un punto centrale della strategia è la gestione del rischio legato al “dual use”, cioè all’uso ambiguo delle tecnologie cyber. Il rischio non dipende solo dal modello, ma anche da chi lo utilizza, dalle modalità d’uso e dai segnali di affidabilità associati all’utente.

Per questo, OpenAI distingue tra accesso generalizzato ai modelli e accesso avanzato a funzionalità più sensibili. I livelli più alti richiedono verifiche più stringenti e offrono maggiore visibilità sulle attività svolte.

In alcuni casi, l’accesso è limitato quando manca trasparenza sull’utilizzo, come nelle configurazioni con zero data retention (ZDR) o attraverso piattaforme terze che riducono la capacità di monitoraggio.

Investimenti e risultati: numeri della strategia

La strategia di rafforzamento della sicurezza informatica si accompagna a investimenti e iniziative concrete. Tra queste:

- un programma di finanziamento da 10 milioni di dollari per progetti di cybersecurity, avviato nel 2023;

- il supporto a oltre 1.000 progetti open source tramite strumenti di scansione delle vulnerabilità;

- lo sviluppo di Codex Security, un sistema automatizzato per il monitoraggio del codice.

Secondo i dati diffusi dall’azienda, Codex Security ha contribuito alla risoluzione di oltre 3mila vulnerabilità classificate come critiche o ad alta gravità. A queste si aggiungono numerosi problemi di livello inferiore corretti all’interno dell’ecosistema software.

Il sistema opera monitorando i repository, validando i problemi individuati e proponendo soluzioni. Con il miglioramento dei modelli, la precisione e l’utilità delle analisi sono aumentate.

Sicurezza integrata nello sviluppo software

Una delle linee strategiche riguarda l’integrazione della sicurezza direttamente nei processi di sviluppo. L’obiettivo è superare un approccio basato su controlli periodici e audit isolati, introducendo invece una verifica continua durante la scrittura del codice.

L’integrazione di modelli avanzati nei flussi di lavoro degli sviluppatori consente di ricevere feedback immediati su vulnerabilità e rischi. Questo riduce i tempi di esposizione e migliora la qualità complessiva del software.

Il passaggio è rilevante anche dal punto di vista economico: correggere un errore nelle fasi iniziali costa meno rispetto a intervenire su sistemi già in produzione.

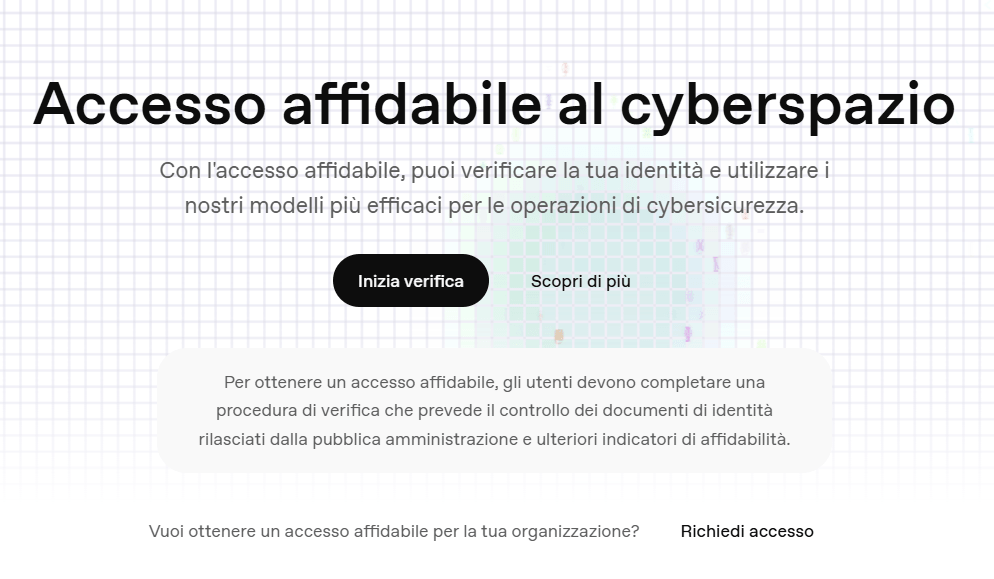

Accesso verificato: come funziona il sistema TAC

L’accesso al programma Trusted Access for Cyber è strutturato su più livelli. Gli utenti individuali possono verificare la propria identità attraverso una procedura online. Le aziende possono richiedere l’accesso per i propri team tramite canali dedicati.

Una volta approvati, gli utenti ottengono versioni dei modelli con minori restrizioni nei contesti di sicurezza informatica. Questo consente attività come ricerca sulle vulnerabilità, formazione e sviluppo di soluzioni difensive.

Per accedere ai livelli più avanzati, inclusi quelli che prevedono l’uso di GPT-5.4-Cyber, è richiesta una verifica aggiuntiva che attesti il ruolo effettivo di difensore cyber.

Distribuzione graduale e gestione del rischio

La distribuzione delle nuove tecnologie avviene secondo un modello iterativo. I sistemi vengono rilasciati in ambienti controllati, monitorati e aggiornati sulla base dei risultati osservati.

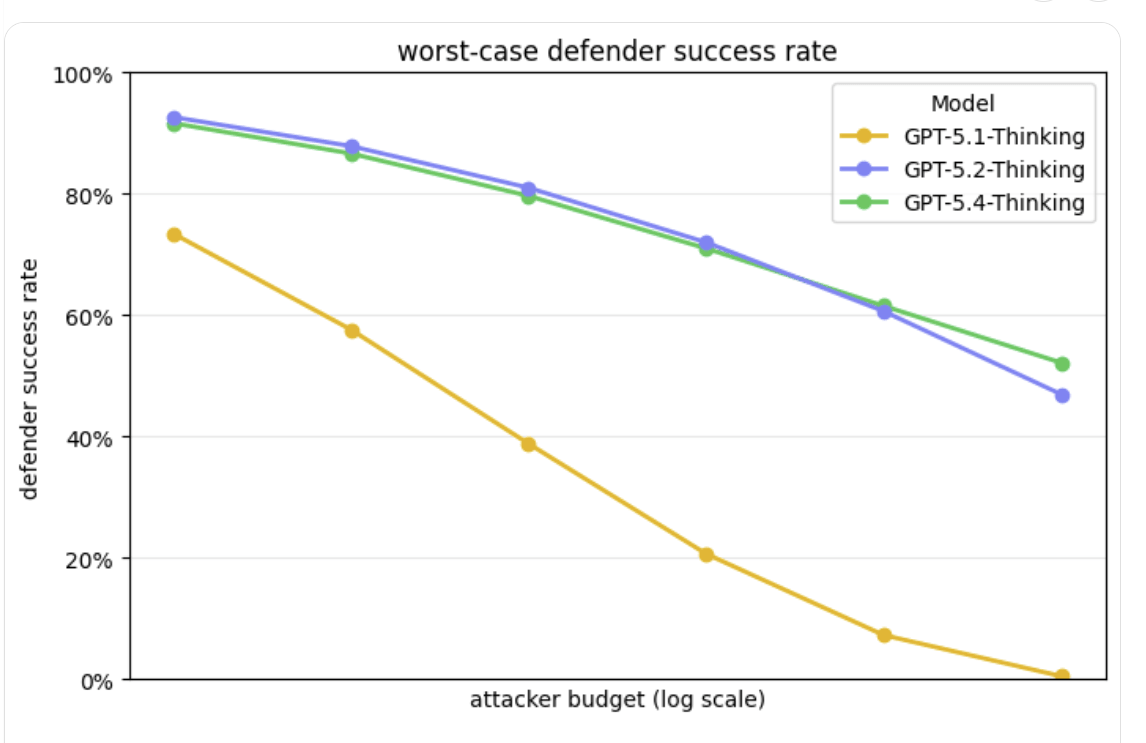

Questo approccio consente di comprendere meglio sia le potenzialità sia i rischi. Tra gli aspetti monitorati rientrano la resistenza agli attacchi, la capacità di evitare abusi e l’efficacia nelle attività difensive.

Le soglie di rifiuto delle richieste vengono calibrate nel tempo, cercando di ridurre i falsi positivi che ostacolano i difensori senza compromettere la sicurezza.

Prospettive: modelli più potenti, difese più complesse

Le prospettive indicate da OpenAI prevedono un aumento rapido delle capacità dei modelli nei prossimi mesi. Questo comporta la necessità di rafforzare ulteriormente le misure di sicurezza.

Secondo l’azienda, le salvaguardie attuali sono sufficienti per sostenere la diffusione dei modelli esistenti. Tuttavia, i modelli futuri, più avanzati, richiederanno sistemi di difesa più articolati.

L’evoluzione riguarda sia la tecnologia sia i meccanismi di controllo dell’accesso. L’obiettivo è mantenere un equilibrio tra apertura e protezione, evitando che strumenti progettati per la sicurezza diventino un vantaggio per gli attaccanti.

GPT-5.4-Cyber: tra potenzialità operative e rischi di sopravvalutazione

Il lancio di GPT-5.4-Cyber è stato accolto con interesse, ma anche con una dose significativa di scetticismo tra analisti e operatori del settore. Da un lato, la stampa specializzata sottolinea il valore operativo di un modello capace di supportare attività avanzate come il reverse engineering e l’analisi delle vulnerabilità, in un contesto di competizione crescente tra grandi player dell’AI come OpenAI e Anthropic (Vedi: The Times of India).

Dall’altro, emergono dubbi concreti sulla reale efficacia e sull’impatto pratico: alcuni esperti evidenziano che molti strumenti AI individuano vulnerabilità già note o difficilmente sfruttabili, mentre i costi computazionali e la complessità d’uso potrebbero limitarne l’adozione su larga scala (Vedi: Axios).

Nella comunità tecnica, il punto più critico riguarda però il rischio di “illusione di competenza”: modelli più permissivi possono spingere analisti meno esperti a sopravvalutare risultati ancora incompleti o ambigui, confondendo ipotesi con evidenze operative (Vedi: penligent.ai).

In questo quadro, GPT-5.4-Cyber appare meno come una svolta definitiva e più come un passaggio intermedio: uno strumento potente, ma che sposta il problema dalla capacità tecnica alla governance dell’accesso e alla responsabilità d’uso.

In termini documentali, GPT-5.4-Cyber si colloca in una zona intermedia: abbastanza avanzato da richiedere restrizioni operative, ma non ancora accompagnato da una model card autonoma. La trasparenza resta ancorata al modello “madre” (GPT-5.4), mentre le modifiche più sensibili — proprio quelle che distinguono la versione cyber — sono descritte solo a livello divulgativo e non in un documento tecnico strutturato.

Conclusione

L’espansione del programma Trusted Access for Cyber e l’introduzione di GPT-5.4-Cyber segnano un passaggio nella gestione del rischio digitale. L’intelligenza artificiale diventa un elemento centrale nella sicurezza informatica, con effetti diretti su imprese, infrastrutture e servizi pubblici.

La strategia punta a estendere le capacità difensive mantenendo un controllo rigoroso sull’accesso. La sfida riguarda la velocità con cui le tecnologie evolvono e la capacità delle istituzioni e delle aziende di adattare i propri strumenti di protezione.