C’è una distanza enorme tra rispondere a una domanda e risolvere un problema. La maggior parte delle aziende si trova ancora ferma al primo stadio. Ecco come si legge la traiettoria dell’AI conversazionale, e dove è possibile direzionarsi.

Lo so, “chatbot” suona già datato. È una parola che evoca i primi assistenti virtuali del 2015, quei piccoli popup sul sito dell’e-commerce che non capivano nulla e rispondevano con “non ho compreso la tua richiesta”. Eppure bisogna partire da lì. Perché senza capire da dove viene questa tecnologia, è impossibile capire dove sta andando, e soprattutto cosa significa oggi quando qualcuno dice “abbiamo implementato un AI agent”.

Se hai interagito con un assistente virtuale negli ultimi anni, probabilmente hai vissuto questa sequenza: fai una domanda, ricevi una risposta plausibile, provi a fare qualcosa di concreto, e ti ritrovi reindirizzato a un modulo, a un numero verde, o a un operatore umano.

Non è un difetto dell’implementazione, è il limite strutturale della categoria.

La maggior parte degli strumenti AI conversazionali oggi in produzione è progettata per rispondere, non per agire. Sanno recuperare informazioni, parafrasarle in modo fluente, guidarti verso la soluzione. Ma quando la soluzione richiede un’azione, si fermano.

Questo confine sta per spostarsi: per capire come si articola l’evoluzione di queste tecnologie è diventato un tema strategico, non solo tecnico.

Indice degli argomenti:

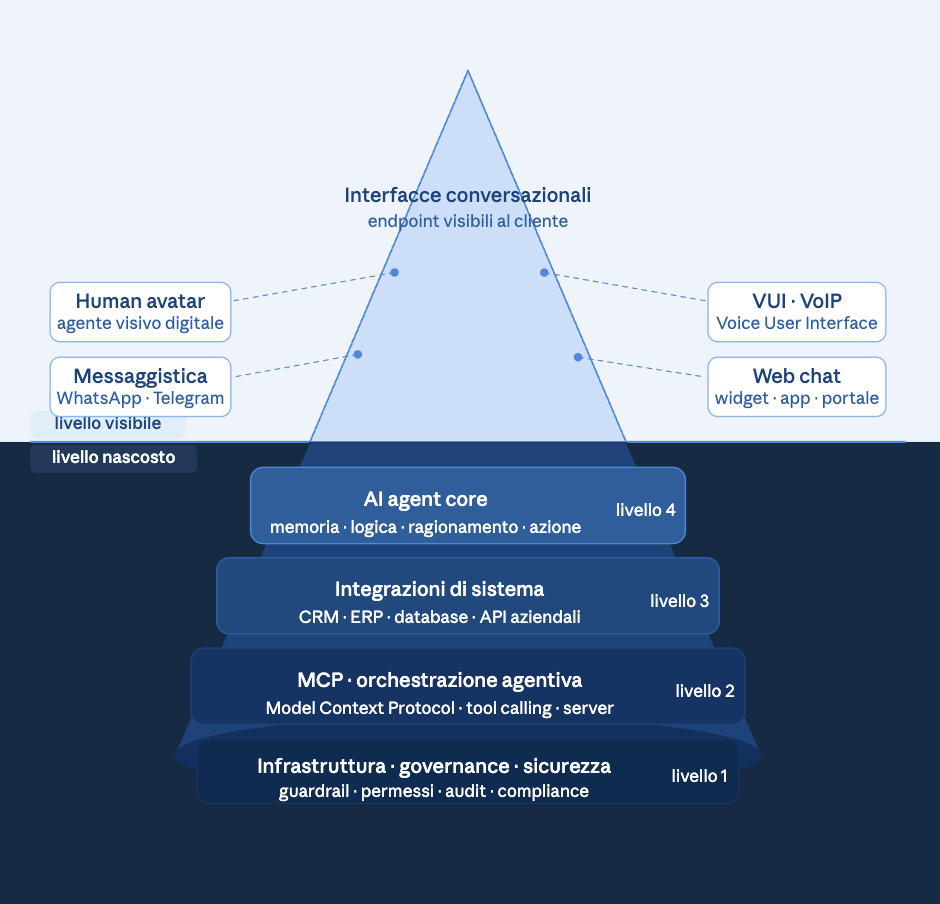

L’interfaccia non è il cervello

C’è un elemento che spesso genera confusione, soprattutto nelle aziende che si avvicinano per la prima volta a questi strumenti. Quando un’organizzazione vede un avatar umano che risponde su WhatsApp, o una voce sintetica che gestisce una chiamata via VoIP, tende a concentrarsi su quello: sull’endpoint, sull’interfaccia visibile. E in base a quella percezione, costruisce la propria idea di cosa sia l’AI conversazionale.

Il problema è che l’interfaccia è solo l’ultimo strato. Sotto di essa può esserci qualsiasi cosa: un chatbot a regole degli anni “dieci”, un assistente GenAI di livello due, o un agente autonomo di livello quattro capace di eseguire transazioni complesse, l’avatar non dice nulla sul livello di intelligenza del sistema. La messaggistica su Telegram non implica sofisticazione, la voce non è sinonimo di capacità.

Questi endpoint, che si tratti di interfacce testuali come WhatsApp o Telegram, di avatar conversazionali, o di sistemi VUI (Voice User Interface) per la gestione vocale, sono canali di accesso. Definiscono come l’utente interagisce con il sistema, non cosa il sistema è in grado di fare.

Confondere l’endpoint con la tecnologia sottostante è uno degli errori più comuni, e uno dei più costosi: porta a sovrastimare soluzioni superficiali e a sottovalutare il lavoro necessario per costruire qualcosa che funzioni davvero.

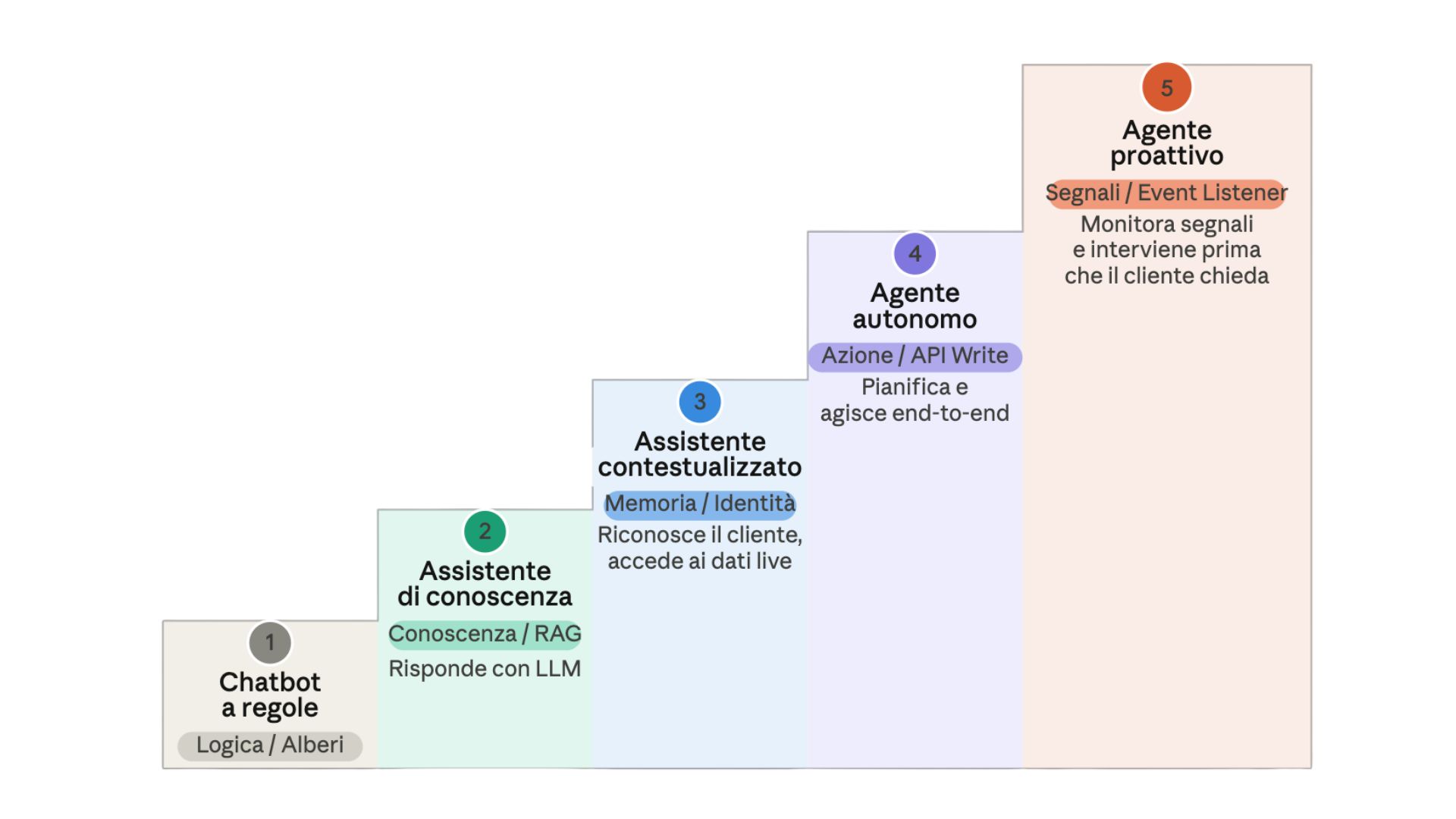

Cinque livelli, una sola traiettoria

Esiste una progressione logica che porta dal chatbot più elementare all’agente AI più sofisticato e non si tratta di una sostituzione per salti, ma di un’evoluzione cumulativa: ogni livello aggiunge capacità senza necessariamente eliminare il precedente.

I cinque stadi si distinguono per tre variabili fondamentali: memoria, logica, azione.

La memoria descrive quanto contesto il sistema riesce a portare con sé, oltre la singola conversazione; la logica descrive come il sistema prende decisioni, scegliendo il passo successivo in base al contesto disponibile; l’azione descrive cosa il sistema può fare concretamente, dal recuperare informazioni fino a scrivere dati nei sistemi aziendali.

Livello 1: chatbot basato su regole

È il punto di partenza. Il chatbot segue flussi predefiniti, risponde a domande previste dal copione, instrada l’utente attraverso percorsi decisionali scritti da qualcuno a priori. Prevedibile, controllabile, ma fragile. Appena la richiesta esce dai binari previsti, il sistema si blocca o reindirizza altrove. La memoria è inesistente tra sessioni diverse. La logica è un albero decisionale, quindi l’azione è zero.

Livello 2: assistente di conoscenza

Qui entra il linguaggio naturale, abilitato dai modelli linguistici di ultima generazione. Il sistema non segue più un copione, ma recupera risposte dalla base di conoscenza aziendale e le formula con fluidità. È il livello in cui si trovano molte implementazioni attuali: FAQ intelligenti, assistenti documentali, bot integrati nei portali di supporto. Funzionano bene per le richieste semplici, ma la memoria si ferma alla singola sessione. La logica è ancora statica e l’azione rimane consultiva: posso dirti cosa fare, non farlo al posto tuo.

Livello 3: assistente contestualizzato

Il salto qualitativo vero inizia qui. L’assistente smette di trattare ogni interazione come se fosse la prima. Riconosce l’utente, recupera la cronologia delle interazioni precedenti, accede in tempo reale ai dati transazionali: stato di un ordine, informazioni di fatturazione, storico del rapporto.

Questo cambia radicalmente la qualità dell’esperienza. L’utente non deve ripetersi, le risposte sono calibrate sulla situazione specifica, non su una domanda generica.

Il limite rimane però nella capacità di agire: il sistema sa tutto ciò che serve per risolvere il problema, ma non può ancora risolverlo direttamente. Può guidarti, non eseguire al posto tuo.

Livello 4: agente autonomo

È qui che avviene la trasformazione più rilevante. L’agente non si limita a spiegare il passo successivo: lo compie. Grazie alle capacità agentiche, il sistema può pianificare una sequenza di azioni, selezionare gli strumenti appropriati, interagire con i sistemi aziendali in lettura e scrittura. Aprire una richiesta, avviare un rimborso, aggiornare un’informazione di profilo, pianificare un appuntamento.

L’autonomia non è illimitata. Le aziende definiscono guardrail precisi: permessi per ruolo, soglie di rischio, criteri di escalation. L’agente agisce con flessibilità dove il rischio è basso, e con prudenza dove le implicazioni sono più rilevanti.

Questo livello richiede infrastruttura: API sicure, qualità dei dati affidabile, governance dei processi. Non è una questione solo tecnologica, è organizzativa.

Livello 5: agente proattivo

Il livello più maturo non aspetta che il cliente faccia una domanda. Monitora segnali attraverso il percorso del cliente, e interviene quando le condizioni lo richiedono, ancora prima che il problema diventi visibile.

- Un ritardo nella spedizione rilevato prima che l’utente si accorga del problema.

- Un’anomalia di fatturazione corretta in anticipo.

- Un rischio di abbandono intercettato nel comportamento d’uso del prodotto.

L’agente proattivo è connesso a sistemi di monitoraggio degli eventi, che lo invocano al verificarsi di determinate condizioni. Questo sposta il servizio da funzione reattiva a livello di presidio continuo, riducendo i contatti evitabili e intervenendo dove conta, nel momento in cui conta.

Non tutte le aziende devono arrivare al livello cinque

Questa è forse la considerazione più utile per chi sta costruendo una roadmap. L’evoluzione verso livelli di maturità più alti porta con sé complessità crescente: integrazione tecnica, governance, costi di sviluppo e mantenimento. Non tutte le aizienda hanno le stesse priorità, lo stesso mix di casi d’uso, la stessa tolleranza al rischio.

La domanda corretta non è “quanto possiamo spingerci?” ma “qual è il livello di maturità che genera il massimo impatto in relazione ai nostri obiettivi e alle nostre capacità attuali?”

Per alcune aziende, un assistente contestualizzato al livello tre che riduce significativamente il volume di richieste ripetitive vale più di un agente autonomo mal governato. Per altre, l’automazione transazionale al livello quattro è il vero salto di efficienza che cercano.

Il punto di partenza è un’analisi onesta della posizione attuale: cosa riesce a fare lo strumento oggi, dove ancora dipende da handoff umani, e dove quei handoff rappresentano il maggiore costo o attrito.

Memoria, logica, azione: tre variabili, tre leve. Ogni progresso nel percorso di maturazione richiede investimenti lungo questi assi, la qualità della memoria dipende dalla struttura dei dati e dalla loro accessibilità. La qualità della logica dipende dalla governance dei processi e dalla chiarezza dei criteri decisionali, la qualità dell’azione dipende dalla sicurezza delle integrazioni e dalla ridondanza dei controlli.

Il risultato non è solo uno strumento più capace, è un’infrastruttura che permette all’AI di creare valore reale, non solo di rispondere a domande.

Il chatbot deflette, l’agente risolve. La distanza tra i due non è solo tecnologica: è strategica.