Alibaba Cloud ha rilasciato, ai primi di aprile 2026, Qwen 3.6-Plus. Diciotto giorni dopo, il 20 aprile, è arrivata la preview del Max. Due rilasci ravvicinati che, letti insieme, raccontano una cosa sola: la corsa cinese agli agenti AI è entrata nella fase industriale.

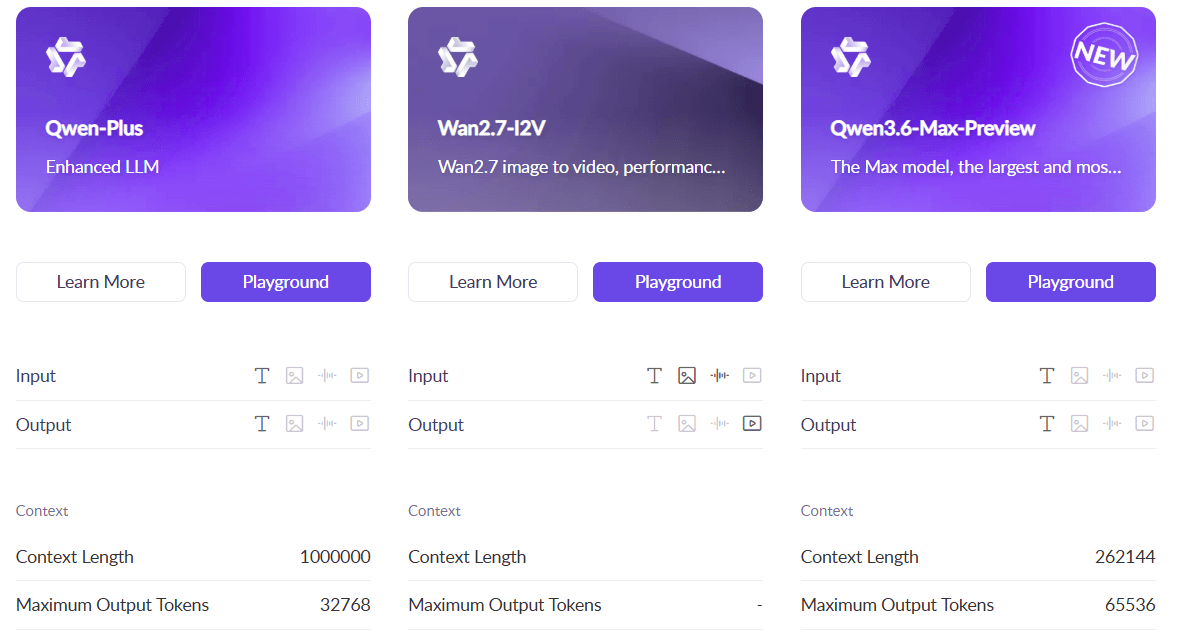

La finestra di contesto arriva a un milione di token, sufficiente a contenere un repository software completo, un archivio documentale aziendale, sequenze lunghe di interazione. L’architettura ibrida, linear attention combinata con sparse mixture-of-experts, abbatte il costo per token senza sacrificare le capacità di ragionamento.

E sul mercato globale il prezzo API parte da 0,276 dollari per milione di token in input, contro i 5 dollari di Claude Opus 4.6, dunque un rapporto di circa diciassette a uno a valle dell’integrazione nello stack di produzione.

Per chi guarda dall’Europa, la questione competitiva si sposta. Fino a ieri l’AI generativa di frontiera era uno strumento per chi aveva margini industriali e contratti cloud robusti, adesso è una commodity accessibile anche alla PMI italiana che vuole automatizzare il customer service o il document processing.

Con tutto ciò che questa accessibilità porta con sé, però, opportunità reali e dipendenze nuove.

Indice degli argomenti:

Un modello costruito per eseguire

La documentazione tecnica di Alibaba parla di un’architettura progettata intorno al concetto di “capability loop“, percepire, ragionare, agire dentro un singolo flusso di lavoro. Qwen 3.6-Plus interpreta uno screenshot di un’interfaccia e genera il codice front-end corrispondente, legge un wireframe disegnato a mano e lo trasforma in HTML funzionante, pianifica un intervento su un repository software e itera sulle correzioni fino al completamento. Le azioni non sono più mediate da un umano che copia e incolla, diventano catene eseguite dall’agente con supervisione finale.

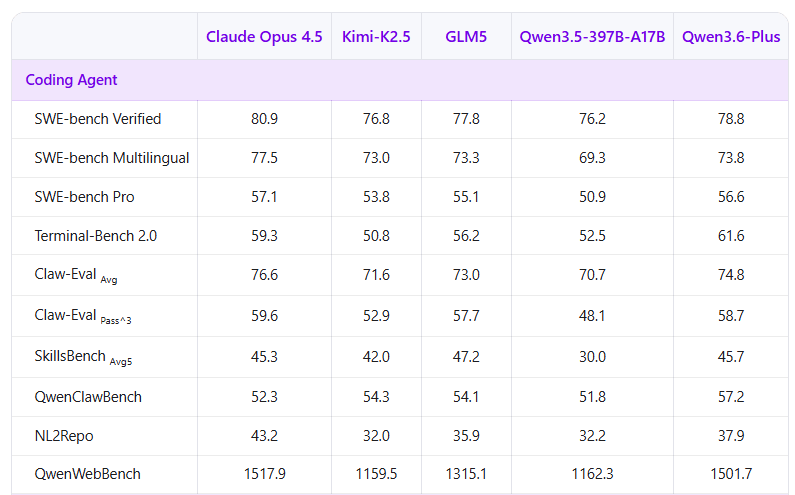

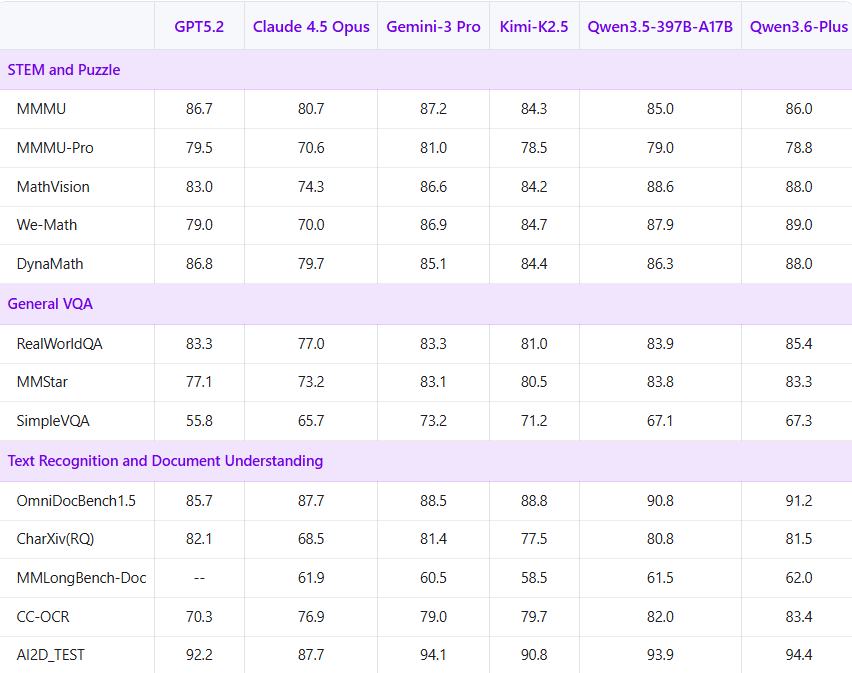

Sul benchmark SWE-bench Verified, che misura la capacità di risolvere issue reali di GitHub, Qwen 3.6-Plus totalizza 78,8 punti, seppur contro i circa 80 di Claude Opus 4.6. Un distacco di meno di due punti, il più stretto mai raggiunto da un laboratorio cinese su questo test, su una metrica che l’industria riconosce come proxy affidabile per il coding agentico in produzione.

Non si tratta solo di un risultato di laboratorio, Airbnb ha pubblicamente dichiarato che il chatbot del proprio customer service gira in larga parte su modelli Qwen, e casi analoghi iniziano a emergere in aziende globali.

A valle di questa scelta architetturale, la compatibilità API con le specifiche OpenAI e Anthropic è quasi un dettaglio, però cambia la vita a chi sviluppa. Sostituire il modello occidentale con Qwen nelle proprie pipeline richiede, nella maggior parte dei casi, una riga di configurazione modificata.

Il costo per token come leva industriale

Il costo di un modello AI entra direttamente nel margine operativo di chi lo usa in produzione, e questo è un fatto che chi lavora su workflow agentici ad alto volume conosce da tempo. Le tariffe sul mercato globale raccontano una distanza strutturale.

Claude Opus 4.6 a 5 dollari per milione di token in input, 25 in output. GPT-5.4 a 2,50 in input, 15 in output. Qwen 3.6-Plus, nella fascia sotto i 256K token, a 0,276 in input e 1,651 in output.

Un’analisi indipendente di TokenCost ha quantificato l’impatto su uno scenario tipico di agente AI in produzione, circa 4.700 dollari di risparmio al mese rispetto a Claude Opus 4.6, circa 2.450 rispetto a GPT-5.4. Cifre che per una PMI che deve decidere se portare l’AI generativa dentro i propri processi, o rinviare l’investimento di un altro anno, possono essere il fattore discriminante.

Alibaba, in parallelo, continua a rilasciare varianti open-weight. Qwen 3.6-35B-A3B, uscito pochi giorni prima del Max, è disponibile sotto licenza Apache 2.0 e attiva solo 3 miliardi di parametri per inferenza, ottimizzato per il self-hosting su GPU di fascia media.

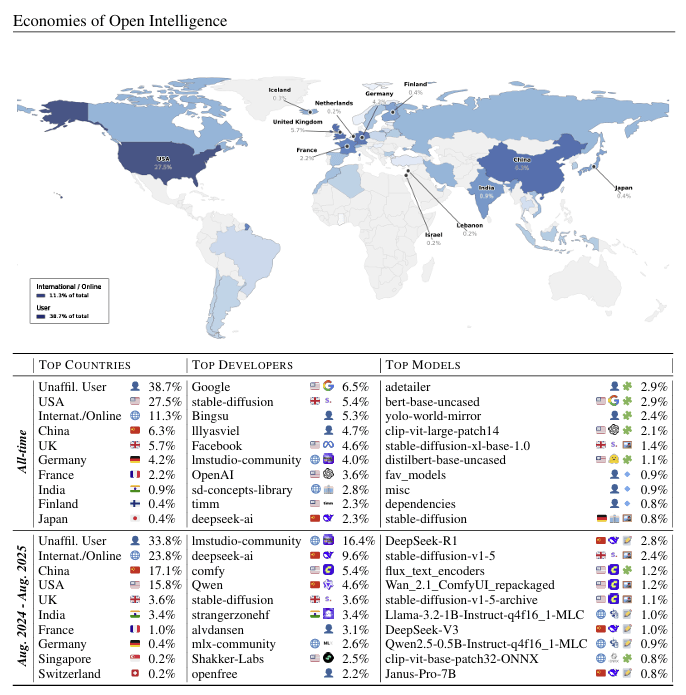

La strategia è quella a due binari che ormai caratterizza i grandi gruppi cinesi, flagship proprietario per la monetizzazione cloud, modelli aperti per l’adozione capillare. Sulla piattaforma Hugging Face, la famiglia Qwen ha generato oltre 180mila varianti derivate, più dei modelli di Google e Meta messi insieme!

La quota cinese sulle piattaforme di inferenza

OpenRouter, aggregatore API che raccoglie il traffico reale degli sviluppatori verso i principali modelli, restituisce un dato che merita attenzione.

Un anno fa i modelli cinesi rappresentavano meno del 2% del traffico complessivo, ad aprile 2026 la loro quota aggregata supera il 45%.

Xiaomi, con il modello MiMo-V2-Pro, da sola detiene il 21,1% contro il 7,5% di OpenAI. Sono i token che effettivamente attraversano le pipeline di chi costruisce prodotti.

Uno studio condotto da ricercatori MIT e Hugging Face pubblicato a fine 2025 ha rilevato che i modelli open-weight cinesi hanno superato per la prima volta quelli statunitensi in termini di download globali, 17,1% contro 15,86%.

RAND Corporation ha misurato un salto dal 3% al 13% della quota di mercato cinese nei due mesi successivi al rilascio di DeepSeek, con una penetrazione superiore al 20% in undici paesi del Global South.

Quello che sta accadendo, a valle di questi numeri, è che la scelta dello stack AI per le aziende globali sta diventando agnostica rispetto alla nazionalità del modello. Contano prestazioni, costo, disponibilità di API compatibili.

La geografia industriale che sembrava cristallizzata fino al 2024 attorno a tre-quattro attori californiani si è rotta in meno di diciotto mesi.

Frontiera americana, esecuzione cinese

Sarebbe una lettura superficiale interpretare questi dati come un sorpasso. I modelli americani restano avanti sui benchmark di frontiera, Gemini 3.1 Pro guida ARC-AGI-2 e GPQA Diamond, Claude Opus 4.6 mantiene il primato su SWE-bench Verified.

Gli ecosistemi costruiti intorno a OpenAI e Anthropic, tool di produttività, ambienti di sviluppo integrati, accordi con i grandi cloud provider, hanno una profondità che i laboratori cinesi non hanno ancora replicato.

Il divario di capability medio, secondo analisi indipendenti, resta intorno ai sette mesi, seppur in accelerazione di accorciamento. Questo divario si accorcia però in modo asimmetrico, ed è qui che la cosa diventa rilevante per l’Europa. Sui task di esecuzione, coding agentico e workflow automation, dove l’ecosistema di contorno vale meno della qualità intrinseca del modello, la distanza è quasi annullata.

Sui task che richiedono integrazione profonda con infrastrutture di produttività esistenti, tipicamente americane, la distanza resta più ampia.

Le imprese europee usano raramente Claude o GPT come parte di un ecosistema proprietario statunitense integrato, li consumano come API chiamate da stack eterogenei. In questo scenario d’uso concreto, la distanza tra modello americano e modello cinese si riduce drasticamente, e il costo per token diventa il criterio decisivo per scegliere.

Dipendenza infrastrutturale, il tema che l’Europa non può eludere

La disponibilità di modelli avanzati a costi ridotti apre alle imprese europee opportunità che fino a ieri erano appannaggio di chi aveva budget da grande industria. Gestione documentale automatizzata, assistenza al codice, analisi di grandi moli di dati con prompt in linguaggio naturale, supporto ai processi decisionali. Attività poco automatizzate che con un rapporto costo-qualità così favorevole diventano economicamente sostenibili anche per realtà medio-piccole.

Il rovescio della medaglia ha un nome preciso, dipendenza infrastrutturale. Adottare Qwen significa inviare prompt aziendali a Alibaba Cloud, o passare attraverso aggregatori terzi che a loro volta li inoltrano.

Per settori regolati, GDPR e AI Act pongono vincoli non banali sulla tracciabilità dei processi decisionali automatizzati. Generare un’immagine di marketing con un modello cinese è una cosa, analizzare con lo stesso modello contratti legali o dati clinici è tutt’altra.

C’è poi una questione più sottile, sollevata al Montreal International Security Summit dello scorso ottobre con l’espressione “infrastructure colonization”. L’adozione diffusa di modelli cinesi incorpora dentro i workflow europei scelte di moderazione, framing narrativi, priorità informative che riflettono il contesto regolatorio e politico di provenienza.

Un modello è anche un oggetto culturale, porta con sé assunzioni implicite su cosa può essere generato e cosa no, su quali argomenti vengono evitati e su quali viene offerta completezza.

La questione industriale europea, oltre la regolazione

L’Unione europea ha risposto alla pressione dell’AI con l’AI Act, strumento regolatorio pensato per proteggere cittadini e imprese dall’uso improprio dei sistemi automatizzati. La regolazione, però, non coincide con la capacità industriale. Tra la produzione di modelli di frontiera e la disponibilità di infrastrutture europee in grado di addestrarli, la distanza resta ampia sia in termini di investimenti sia di capacità computazionale disponibile su suolo europeo.

Gli investimenti cinesi raccontano una storia di scala diversa. Nel 2025 il governo cinese ha impegnato 56 miliardi di dollari in infrastrutture AI, Alibaba da sola ha annunciato 50,6 miliardi su un orizzonte triennale. Cifre a cui né singoli paesi europei né l’Unione nel suo complesso sono oggi in grado di rispondere con risorse equivalenti, a prescindere dalle intenzioni politiche dichiarate.

Senza capacità di calcolo sovrana l’autonomia di modello resta un obiettivo teorico.

Il rischio europeo non è restare fuori dall’AI generativa, lo scenario più probabile è quello opposto, un’adozione massiccia ma dipendente, dove ogni processo critico delle imprese europee passa attraverso un modello ospitato altrove. Quando si parla di sovranità digitale si tende a pensare solo ai dati, mentre il vero nodo riguarda chi controlla l’intero ciclo di vita del modello, dall’addestramento agli aggiornamenti, fino al logging delle interazioni che avvengono ogni giorno tra l’AI e gli utenti aziendali.

Dal modello agentico al sistema operativo della produzione

Qwen 3.6 non è il primo modello agentico in circolazione, è però il primo che porta la logica agentica a un livello di prezzo tale da renderla una commodity accessibile. Quando un’operazione che prima costava diversi dollari inizia a costarne pochi centesimi, l’intera economia del processo in cui è inserita si riorganizza, e quello che era un esperimento pilota diventa componente strutturale del modo in cui l’impresa lavora.

La catena del valore digitale si riorganizza di conseguenza. Il codice viene sempre più spesso orchestrato da agenti che eseguono e verificano, l’analisi documentale diventa un processo automatizzato con supervisione umana su campione, il customer service scivola da centro di costo a infrastruttura conversazionale a costo marginale prossimo a zero.

Non sparisce il lavoro umano, cambia la sua collocazione nella catena, si sposta verso la definizione dei vincoli, la verifica del risultato, la gestione delle eccezioni.

In Spatial Shift ho provato a descrivere come l’evoluzione dei sistemi digitali ridisegni gli spazi di interazione tra persone, ambienti e oggetti. Quello che sta accadendo con i modelli agentici apre un capitolo nuovo di quella traiettoria, l’intelligenza computazionale esce dall’interfaccia conversazionale per distribuirsi dentro le attività stesse, funziona come una presenza continua che lavora in background mentre il team si occupa di ciò che richiede giudizio umano.

Utilizzatori o produttori, la scelta resta sul tavolo

La competizione tra Cina e Stati Uniti sull’intelligenza artificiale ha smesso di giocarsi solo sulla frontiera dei benchmark, adesso si gioca sulla velocità di diffusione nell’economia reale, sulla capillarità con cui i modelli entrano nei processi produttivi. Qwen 3.6 è un segnale forte proprio in questa direzione, un modello tarato per costare poco e funzionare in produzione.

Per l’Europa, il bivio si pone in termini industriali prima che regolatori. Accettare il ruolo di utilizzatore di piattaforme altrui, con tutti i benefici di costo immediato che ne conseguono, oppure investire per costruire alternative che rispondano a vincoli di sovranità, governance e trasparenza.

Chi leggerà questo articolo fra tre anni vedrà come la scelta sia stata fatta, dalle imprese con i contratti cloud firmati e dalle istituzioni con le infrastrutture finanziate o rinviate. Senza dubbio, resta una domanda sospesa per chi oggi deve decidere, chi costruirà l’infrastruttura su cui gli agenti AI eseguiranno il lavoro digitale quotidiano del prossimo decennio?