OpenAI ha annunciato Frontier il 5 febbraio 2026, presentandola come una piattaforma pensata per portare gli agenti AI dentro processi operativi concreti e continuativi, superando la logica dei casi d’uso isolati.

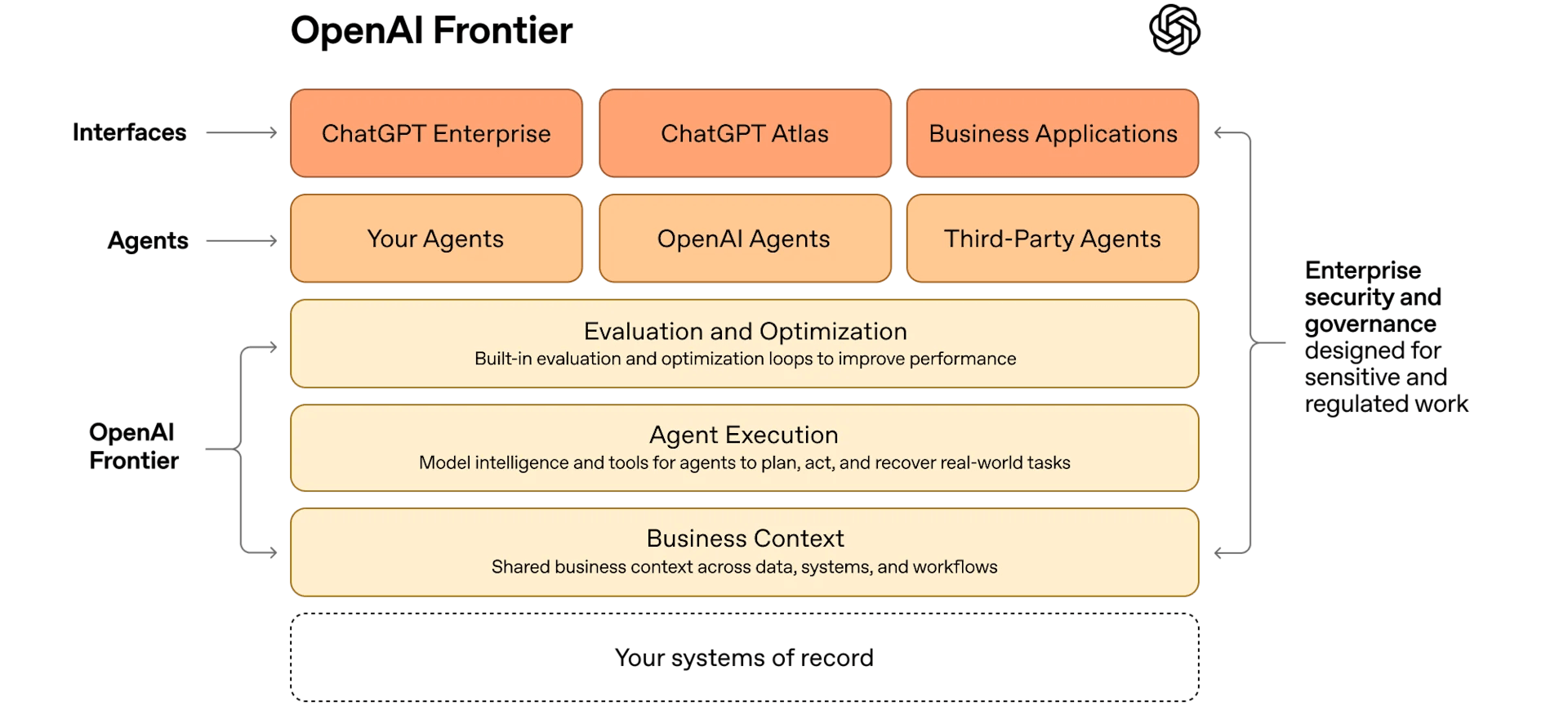

L’impianto è costruito attorno a quattro elementi chiave:

- un contesto condiviso a livello aziendale,

- meccanismi di onboarding apprendimento basati su feedback,

- capacità di esecuzione su strumenti e ambienti eterogenei,

- identità e permessi definiti da confini espliciti.

L’annuncio si inserisce in una fase in cui l’adozione dell’AI in ambito enterprise sta passando dalla sperimentazione individuale alla messa in produzione. Il divario tra le capacità teoriche dei modelli e ciò che le organizzazioni riescono a utilizzare in modo affidabile e governato rimane ampio.

OpenAI richiama un dato ricorrente: una quota significativa di lavoratori dichiara di riuscire a svolgere attività prima non accessibili, segnalando che il tema non è più l’utilità dell’AI, ma la sua integrazione operativa su scala.

Indice degli argomenti:

Scenario di mercato: la corsa al control plane degli agenti

La dinamica competitiva più rilevante, oggi, non è solo sul modello “migliore”, ma sulla piattaforma che consente di portare gli agenti in produzione e governarli. Gli hyperscaler e i grandi vendor applicativi stanno convergendo su uno schema comune: ambiente di sviluppo (low-code e pro-code), runtime di esecuzione, integrazione con dati e strumenti, osservabilità, gestione identità e policy, con l’obiettivo implicito di diventare il punto di controllo di un “parco agenti” distribuito nell’organizzazione.

OpenAI descrive il problema dal punto di vista delle imprese come frammentazione di sistemi, governance distribuita e proliferazione di agenti “isolati” per visibilità e capacità d’azione. In questo quadro, ogni nuovo agente rischia di aumentare complessità invece di ridurla, se non dispone di contesto sufficiente e se non è inserito in un modello operativo coerente.

La traiettoria è coerente con quanto emerge anche dal report “The state of enterprise AI | 2025”: l’impatto percepito cresce con l’intensità d’uso e con l’adozione di funzionalità più avanzate; inoltre i profili che dichiarano maggior risparmio di tempo risultano associati, fra le altre cose, all’uso di più modelli e più strumenti. Questo è un segnale utile perché sposta la discussione dalla singola “app AI” a un’architettura di piattaforma e portafoglio.

Cosa ha presentato OpenAI con Frontier

Frontier viene presentata come piattaforma enterprise per “build, deploy, manage” di agenti AI, con l’obiettivo di farli operare come “AI coworkers” in attività di lavoro reale. Nel messaggio di lancio, OpenAI insiste sul fatto che il freno principale non è più l’intelligenza del modello, ma il modo in cui gli agenti vengono costruiti e gestiti nelle organizzazioni.

Un elemento concreto è la strategia di adozione: OpenAI indica HP, Intuit, Oracle, State Farm, Thermo Fisher Scientific e Uber come primi adopter; e cita inoltre BBVA, Cisco e T-Mobile tra i clienti che hanno già sperimentato l’approccio di Frontier in attività complesse.

La disponibilità è dichiarata come “limitata” nella fase iniziale, con ampliamento nei mesi successivi; OpenAI afferma anche di aver osservato l’adozione in oltre un milione di aziende negli ultimi anni e riporta alcuni esempi di benefici attribuiti agli agenti (riduzione drastica di cicli di lavoro, recupero di tempo commerciale, miglioramenti di output produttivo). Questi numeri vanno letti come casi riportati dal vendor, utili per capire l’intento e l’ambizione della piattaforma più che come benchmark generalizzabili.

Contesto, esecuzione, valutazione, governance

Il modo più utile per interpretare Frontier è come combinazione di quattro “piani” che, in molte organizzazioni, oggi sono dispersi in prodotti e iniziative differenti.

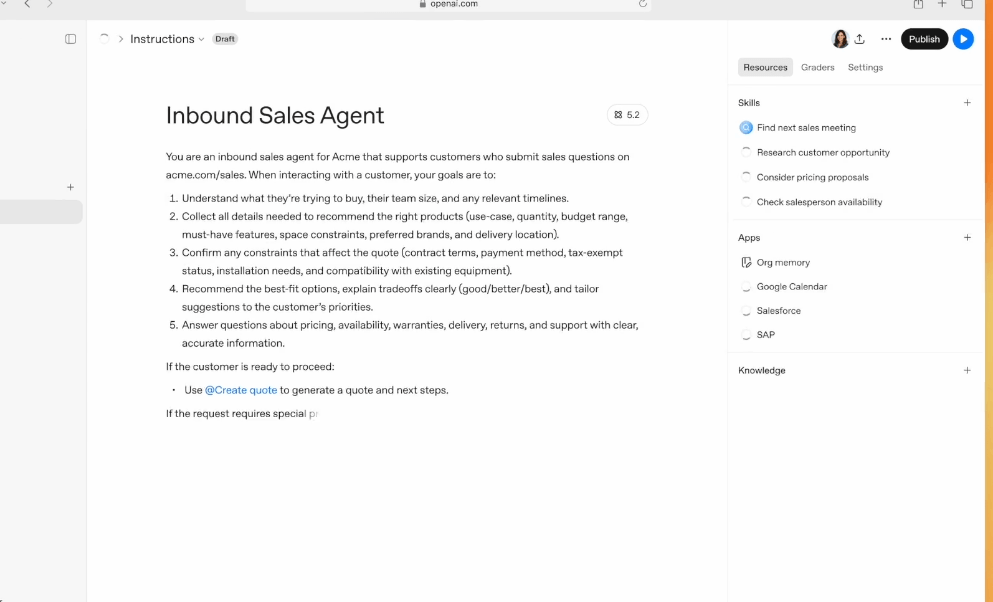

Il primo è il contesto business condiviso. OpenAI parla esplicitamente di collegare data warehouse, CRM, ticketing e applicazioni interne per fornire agli agenti un contesto unificato; in questa narrativa, Frontier agisce come “semantic layer” dell’impresa, in modo che agenti diversi possano operare e comunicare con lo stesso lessico e con la stessa visione dei flussi informativi.

Il secondo è l’esecuzione degli agenti. L’annuncio descrive un “open agent execution environment” in cui gli agenti possono lavorare con file, eseguire codice e usare strumenti; inoltre OpenAI sottolinea l’idea di memorie che accumulano contesto utile dalle interazioni precedenti. Sul piano infrastrutturale, viene dichiarata la possibilità di far girare gli agenti su ambienti locali, su infrastrutture cloud aziendali e su runtime ospitati da OpenAI, con enfasi sulla bassa latenza verso i modelli per casi time-sensitive.

Il terzo è la qualità nel tempo. Frontier integra meccanismi di valutazione e ottimizzazione: l’obiettivo dichiarato è rendere visibile cosa funziona e cosa no, così che i comportamenti “buoni” si consolidino e gli agenti migliorino su lavoro reale, non su demo. Questo punto è cruciale perché, per molti agenti, la degradazione non avviene per mancanza di capacità astratta, ma per drift di contesto, cambiamenti di processo, variazioni nelle UI o nelle policy di accesso.

Il quarto è identità, permessi e confini. OpenAI dichiara che ogni “AI coworker” ha una propria identità con permessi espliciti e guardrail, per poter operare anche in contesti sensibili e regolamentati. Nella pagina business, Frontier viene descritta come governata da controlli enterprise con auditing e osservabilità, e viene collegata alla foundation di sicurezza e compliance già usata per clienti business.

Sicurezza e compliance

Sul tema di sicurezza e compliance, la documentazione OpenAI per business esplicita alcuni impegni trasversali (non training sui dati business per impostazione predefinita, cifratura in transito e at rest, opzioni di gestione chiavi come Enterprise Key Management, controlli di retention e opzioni zero data retention su API per organizzazioni idonee, possibilità di data residency in regioni tra cui Europa e UK per offerte qualificate).

Questi aspetti diventano parte della valutazione di piattaforma quando gli agenti iniziano a toccare processi core e dati ad alta criticità.

Va anche evidenziato un punto operativo: quando la strategia include interfacce “agentiche” dentro un browser (nel lessico OpenAI: Atlas), OpenAI stessa avverte che alcune protezioni enterprise potrebbero non applicarsi automaticamente, e che Atlas per Business/Enterprise è in accesso anticipato con esclusioni rilevanti (perimetro SOC/ISO, logging per compliance API, integrazione SIEM/eDiscovery, vincoli di residenza, SSO/SCIM specifici).

Se Frontier viene usata “attraverso workflow con Atlas”, il perimetro di controllo va progettato in modo esplicito.

Perché può interessare alle aziende

Frontier intercetta una necessità concreta: normalizzare la messa in produzione degli agenti in un’azienda che ha già sistemi di record, policy e processi di change. OpenAI enfatizza che la piattaforma lavora con sistemi esistenti senza imporre replatforming, e che l’integrazione avviene tramite standard aperti, evitando nuovi formati e riducendo la necessità di riscrivere quanto già esiste (agenti e applicazioni).

Se questa promessa è mantenuta nella pratica, si traduce in una riduzione del costo marginale di ogni nuovo agente e, soprattutto, nella riduzione delle “integrazioni one-off” che oggi assorbono tempo nelle funzioni IT e data.

L’interesse aumenta quando il valore atteso non sta nel singolo assistente, ma in un insieme di agenti coordinati su processi end-to-end. Nella pagina di posizionamento, Frontier viene associata a tre famiglie: “AI teammates” per ruoli e team, automazione di processi core su sistemi di record, e progetti strategici multi-dipartimentali che richiedono coordinamento e competenza.

Questo allinea la piattaforma a use case dove il ritorno dipende dalla continuità operativa, non dalla qualità di una singola risposta.

Gli esempi riportati nel lancio chiariscono il tipo di esecuzione che OpenAI vuole abilitare:

- riduzione di tempi di ottimizzazione in ambito manufacturing/semiconduttori,

- automazione di attività commerciali lungo il processo di vendita,

- incremento di output in ambito energy,

- un caso dettagliato di root cause analysis in cui l’identificazione passa da ore a minuti grazie alla capacità dell’agente di correlare log, documentazione, workflow e codice. Anche qui, il valore è nella capacità di attraversare sistemi e fonti, non in una sola interazione.

Per molte aziende, un beneficio secondario ma determinante è la riduzione del rischio di “agent sprawl” e di incoerenza di governance. Centralizzare contesto, osservabilità e policy significa rendere verificabili le azioni degli agenti, con tracciabilità e controlli più vicini a quanto già esiste per applicazioni e identità umane. Questo è coerente con la direzione del mercato: la maturità passa dall’“uso individuale” a un modello che assomiglia a un nuovo strato di piattaforma aziendale.

Confronto con le principali alternative enterprise

Nel confronto, è utile separare tre dimensioni:

- ampiezza di ecosistema (connettori, standard, marketplace),

- integrazione con sistemi di lavoro già dominanti (suite produttive o sistemi di record),

- profondità di governance/observability per fleet di agenti.

Microsoft sta spingendo un impianto molto esplicito di “control plane” per agenti e strumenti. La documentazione descrive Microsoft Foundry Control Plane come interfaccia unificata per visibilità, governance e controllo di agenti, modelli e tool lungo tutto il percorso build-to-production; Foundry Agent Service viene posizionata come piattaforma per progettare, distribuire e scalare agenti con integrazione a un catalogo di modelli, fonti di conoscenza enterprise e connettività ampia (oltre 1.400 connector via Logic Apps). In questo stack compare in modo esplicito anche Model Context Protocol come meccanismo di integrazione verso API e tool.

Amazon Web Services propone con Amazon Bedrock Agents un’impostazione centrata su orchestrazione tra foundation model, data source, applicazioni e conversazioni, con chiamate automatiche ad API e integrazione con knowledge base. La documentazione enfatizza che il servizio gestisce elementi come prompt engineering, memoria, monitoring, cifratura, permessi utente e invocazione API, e include tracing per analizzare il reasoning step-by-step durante l’orchestrazione. È un approccio fortemente cloud-native e integrato nell’offerta Bedrock.

Google Cloud presenta Vertex AI Agent Builder come suite per costruire, scalare e governare agenti in produzione lungo l’intero lifecycle. La documentazione è significativa perché dettaglia componenti come Agent Engine (runtime managed), evaluation, sessions, memory bank e code execution, oltre a osservabilità tramite Cloud Trace con supporto OpenTelemetry. Dal lato integrazione emerge una pluralità di opzioni: framework open-source “a scelta”, strumenti MCP, integrazione con molte applicazioni enterprise tramite Integration Connectors e un livello di governance che include audit trail e concetti di agent identity su IAM.

Salesforce spinge Agentforce come piattaforma agentica integrata con CRM e applicazioni del proprio ecosistema, con strumenti per gestire l’intero ciclo di sviluppo degli agenti (build, test, deploy, manage, orchestrate) e con enfasi su “Intelligent Context”. In prospettiva enterprise, è rilevante la scelta di esporre connessioni verso tool e dati esterni anche attraverso server MCP, con la logica di accelerare deployment e integrazione con terze parti.

ServiceNow porta l’agentic AI dentro la “macchina dei workflow” aziendali. Now Assist è posizionata come esperienza GenAI built-in nella piattaforma, con capacità che vanno da summarization e conversational skills fino a generazione di codice/flow. Un punto distintivo, in chiave scelta vendor, è la dichiarazione di supporto a modelli terzi (inclusi OpenAI e altri) oltre a LLM propri, in modo da lasciare flessibilità sul modello a seconda del caso d’uso e del perimetro. Sul piano governance, ServiceNow posiziona anche una propria soluzione di AI governance per connettere strategia, sicurezza, legale, rischio e compliance lungo il lifecycle e il monitoraggio continuo.

IBM con watsonx Agents punta su agenti “built for business” con logica enterprise e agenti preconfigurati per domini (HR, sales, procurement, support), più la possibilità di integrare con tool e dati aziendali. Il messaggio è orientato a time-to-value e a una gestione centralizzata degli agenti in un’unica interfaccia, con attenzione a integrazione e automazione multistep.

In questo panorama, Frontier si colloca come proposta “cross-interfaccia” (ChatGPT, workflow tipo Atlas, applicazioni business), “cross-agent” (agenti sviluppati internamente, forniti da OpenAI o da terze parti) e “cross-environment” (local, cloud enterprise, runtime OpenAI). Il posizionamento competitivo è quindi sul piano di contesto condiviso, esecuzione e governance come servizio, con un’attenzione dichiarata a standard aperti e a non richiedere formati proprietari nuovi.

Punti di attenzione: lock-in, sicurezza e scelta mono-vendor

La scelta di una piattaforma per agenti tende a diventare “monodirezionale” per inerzia architetturale più che per decisione esplicita: il contesto condiviso, le memorie, le policy, le integrazioni e gli strumenti di osservabilità creano dipendenze che rendono costoso migrare. Frontier dichiara di voler mitigare questo rischio tramite standard aperti e integrazione di agenti di terze parti, ma nella valutazione enterprise conta verificare dove risiedono realmente il contesto e le memorie, quanto siano esportabili, e quale sia la portabilità dei flussi di esecuzione tra runtime diversi.

Il tema multi-modello merita un’attenzione specifica, anche perché OpenAI stessa nel report “The state of enterprise AI | 2025” associa i livelli più alti di beneficio percepito a un uso più ricco di funzionalità e, per gli utenti con maggiore risparmio di tempo, anche all’uso di più modelli e più strumenti. In pratica: una strategia solo single-model o single-vendor può semplificare procurement e architettura, ma rischia di ridurre opzionalità quando cambiano vincoli (costi, compliance, latenza, requisiti di dominio).

Sicurezza

Sul piano della sicurezza, l’agentic AI amplia la superficie d’attacco perché gli agenti non si limitano a generare testo: leggono contenuti, interpretano istruzioni e compiono azioni. OpenAI, parlando di agenti in ambiente browser, descrive la prompt injection come rischio significativo e come “open challenge” di lungo periodo per la sicurezza degli agenti; indica inoltre la necessità di difese multilivello e di cicli continui di discovery e mitigazione. Senza trasferire automaticamente queste considerazioni su ogni contesto enterprise, il punto resta: un agente che attraversa email, documenti e sistemi può incontrare istruzioni non affidabili e deve essere progettato per resistere a manipolazioni e per chiedere conferme su azioni consequenziali.

Un’area concreta di rischio operativo è il disallineamento di perimetro tra componenti che sembrano unificate nella user experience ma non lo sono nella compliance.

L’esempio più esplicito, nella documentazione OpenAI, è Atlas per Business/Enterprise: OpenAI indica limitazioni attuali su certificazioni, logging compliance, integrazioni SIEM/eDiscovery, residenza dati e controlli di provisioning (SSO/SCIM). In un disegno Frontier che includa anche workflow via Atlas, serve una segmentazione netta: dati a basso rischio e prove in “early access” da una parte; dati regolamentati e processi core dall’altra, con i controlli richiesti dal proprio settore.

Infine, la valutazione “mono direzione” non è solo tecnologica ma contrattuale e di governance: tempi di evoluzione molto rapidi (OpenAI dichiara un ritmo di rilascio interno di circa un aggiornamento ogni tre giorni) impongono un modello di controllo che bilanci sperimentazione e stabilità, con processi di change management, testing e osservabilità che siano parte della piattaforma e della cultura di delivery.

In questo senso, Frontier prova a posizionarsi non solo come prodotto ma come combinazione di tecnologia e supporto operativo tramite Forward Deployed Engineers, presentata anche come “Enterprise Frontier Program” nella pagina business. La sostanza da verificare, per l’azienda, è quanto questo modello si traduca in capacità interne trasferibili e in pattern replicabili, e quanto rimanga legato a intervento specialistico del vendor.

Keyword

, agenti AI enterprise

Titolo SEO

Metadescription