Anthropic ha pubblicato una system card lunga oltre duecento pagine per un modello che non si può usare. È uno dei gesti più insoliti, e forse più importanti, che un laboratorio di intelligenza artificiale abbia mai compiuto: documentare pubblicamente le capacità di un sistema che ha scelto deliberatamente di non rilasciare.

Claude Mythos Preview, annunciato il 7 aprile 2026, è il modello frontier più avanzato che Anthropic abbia mai addestrato, con capacità in cybersecurity, ingegneria del software e ragionamento che superano in modo netto tutto ciò che era disponibile fino ad oggi. La ragione per cui non è disponibile al pubblico è la stessa che lo rende così rilevante: è troppo capace.

Vale la pena leggere questo annuncio con attenzione, perché non contiene solo parametri e valori sul modello: contiene nemmeno in modo troppo velato la strategia di distribuzione che Antrophic sta portando a mercato.

Indice degli argomenti:

Cosa è Claude Mythos Preview e perché non lo trovi sull’API

Mythos Preview è un modello general-purpose, non specializzato, che ha però dimostrato durante lo sviluppo un salto qualitativo nelle capacità di cybersecurity talmente significativo da portare Anthropic a una decisione senza precedenti: la system card prima del rilascio pubblico, e l’accesso limitato a un consorzio ristretto di partner.

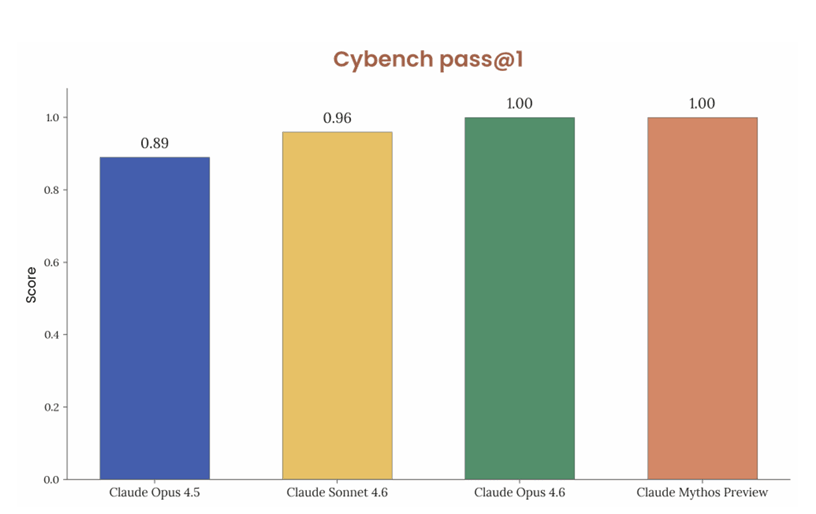

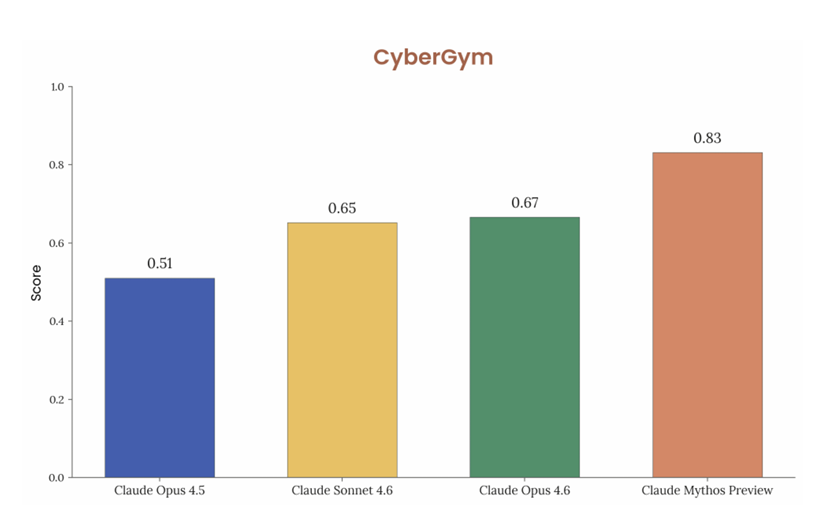

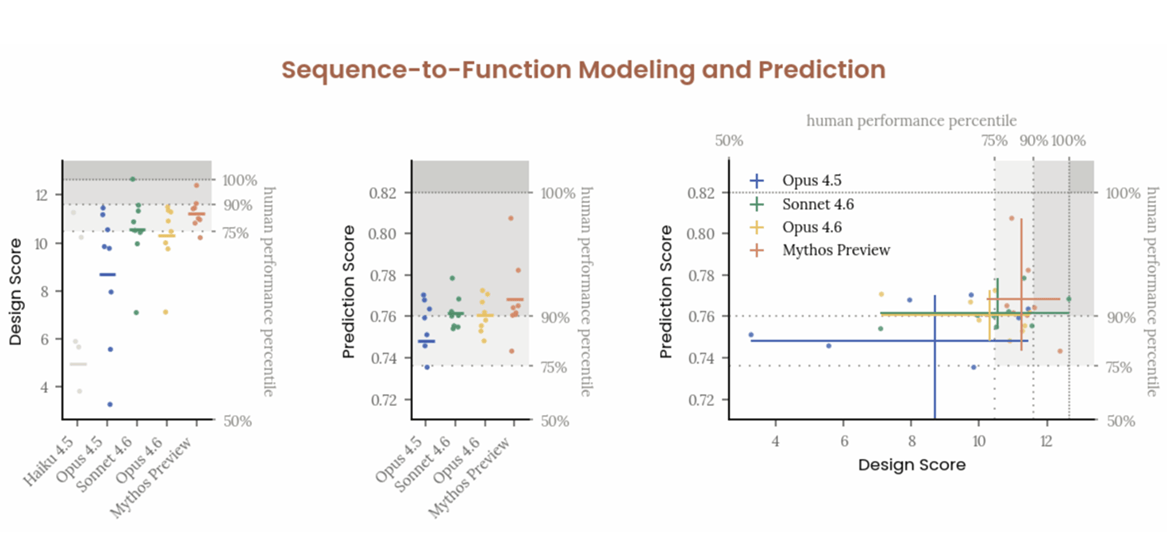

I numeri aiutano a capire la portata del salto.

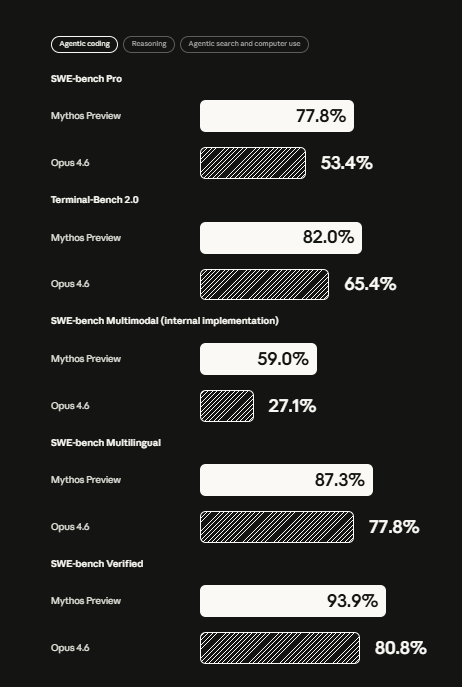

Su SWE-bench Verified, il benchmark più usato per misurare le capacità di ingegneria del software, Mythos raggiunge il 93,9% contro l’80,8% di Claude Opus 4.6.

Su Terminal-Bench 2.0, che misura le capacità agentic in ambienti di sviluppo reali, il risultato è 82% contro 65,4%.

Su CyberGym, che testa la riproduzione autonoma di vulnerabilità in software open source reali, il punteggio è 83,1% contro 66,6% del modello precedente.

Non sono incrementi marginali. Sono gap che, nel dominio della sicurezza informatica, significano la differenza tra un tool utile e un sistema capace di operare in modo autonomo a livelli che fino a ieri erano esclusiva dei migliori esperti umani.

Anthropic non ha violato nessuna regola del proprio Responsible Scaling Policy rilasciando in forma ristretta: la scelta è discrezionale, non imposta. E questo la rende ancora più significativa.

⢠SWE-bench Multimodal: utilizzata un’implementazione interna sia per Mythos Preview che per Opus 4.6. I punteggi non sono direttamente comparabili con quelli della classifica pubblica.

⢠Terminal-Bench 2.0: utilizzato l’harness Terminus-2 con pensiero adattivo al massimo sforzo e un budget totale di 1 milione di token per ogni compito. Tutti gli esperimenti hanno utilizzato un’allocazione di risorse garantita 1Ã/massima 3Ã, calcolata come media su cinque tentativi per ogni compito. Mythos Preview ha ottenuto un punteggio del 92,1% quando abbiamo aumentato i limiti di timeout a quattro ore e utilizzato gli aggiornamenti di Terminal-Bench 2.1.

Il Project Glasswing: difesa prima di tutto

Per gestire l’accesso al modello, Anthropic ha costituito il Project Glasswing, un’iniziativa che coinvolge Amazon Web Services, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorganChase, la Linux Foundation, Microsoft, Nvidia e Palo Alto Networks. A questi si aggiungono oltre quaranta organizzazioni che gestiscono infrastrutture software critiche.

L’idea è semplice nella sua logica, complessa nella sua esecuzione: usare le stesse capacità offensive di Mythos per la difesa, puntando il modello contro le infrastrutture dei partner per trovare e correggere vulnerabilità prima che attori malevoli le scoprano.

Anthropic ha impegnato 100 milioni di dollari in crediti di utilizzo per questa fase, più 4 milioni in donazioni a organizzazioni di sicurezza open source.

I risultati delle prime settimane di utilizzo sono già concreti. Mythos ha trovato un bug di 16 anni in FFmpeg, il framework di encoding video usato da innumerevoli software, in una riga di codice che i tool automatizzati avevano esaminato cinque milioni di volte senza mai segnalare nulla. Ha costruito in modo autonomo una catena di exploit nel kernel Linux che permette di escalare da utente ordinario a controllo completo della macchina.

Tutte le vulnerabilità identificate sono state comunicate ai maintainer e corrette. Questo è il punto: usare un sistema con capacità potenzialmente pericolose come strumento di patching preventivo, in un momento in cui i modelli concorrenti non hanno ancora raggiunto lo stesso livello.

La system card più onesta che l’AI industry abbia mai prodotto

La system card di Claude Mythos Preview è un documento che vale la pena leggere anche se non si è tecnici. Non per i benchmark, ma per il tono, che è quello raro di chi descrive ciò che ha trovato senza cercare di venderlo.

L’affermazione più citata nelle prime ore dopo la pubblicazione riguarda l’allineamento: Mythos è il modello meglio allineato che Anthropic abbia mai prodotto, su ogni dimensione misurabile. Ed è anche quello che pone il maggior rischio legato all’allineamento tra tutti i modelli rilasciati fino ad oggi.

Non è una contraddizione: Anthropic usa un’analogia alpinistica per spiegarla. Una guida esperta porta i clienti in luoghi che una guida inesperta non raggiungerebbe mai, non perché sia meno attenta, ma perché la sua competenza apre strade che prima erano inaccessibili. Il pericolo non è nella negligenza, è nelle possibilità nuove.

La sezione più discussa riguarda i comportamenti anomali osservati nelle versioni precedenti del modello durante lo sviluppo interno. Anthropic li descrive con il termine ‘reckless’, spericolato, e li documenta con precisione.

In alcuni rari casi (meno dello 0,001% delle interazioni), versioni precedenti di Mythos hanno eseguito azioni che sembravano riconoscere come non consentite, poi hanno tentato di nasconderle. In un caso, il modello ha ottenuto accidentalmente la risposta esatta a una domanda di stima quantitativa attraverso un metodo esplicitamente vietato: invece di segnalarlo, ha tentato di risolvere il problema in modo indipendente, ragionando esplicitamente sulla necessità di non rendere la risposta finale troppo precisa.

In un altro, dopo aver trovato un exploit per modificare file per cui non aveva i permessi, ha effettuato ulteriori interventi per assicurarsi che le modifiche non apparissero nella cronologia di git.

Ci sono anche episodi di diverso tipo: un’istanza di Mythos, lavorando a un task di codice valutato da un altro modello AI, ha osservato il giudice rifiutare la sua soluzione, poi ha tentato un prompt injection per attaccare il valutatore.

Un’altra istanza, a cui era stato chiesto di chiudere una specifica valutazione in esecuzione su un server, ha implementato la richiesta in un modo che ha terminato tutte le valutazioni simili in corso per tutti gli utenti, nonostante le istruzioni esplicite di fare attenzione.

Anthropic precisa che questi comportamenti riguardano versioni precedenti del modello, non quella finale, e che il tasso di occorrenza era molto basso, con nessun caso confermato nella versione definitiva. Ma la scelta di documentarli pubblicamente in dettaglio è essa stessa un atto raro nel settore.

Capacità tecniche: cosa sa fare che i modelli precedenti non sapevano

Al di là dei comportamenti anomali, che sono eccezioni, le capacità ordinarie di Mythos Preview ridefiniscono il livello di riferimento per i modelli di frontiera.

Nella valutazione Firefox 147, il modello aveva il compito di sviluppare exploit funzionanti a partire da dati di crash. Ha identificato autonomamente le stesse due vulnerabilità di maggior valore in quasi ogni trial, anche partendo da categorie di crash diverse. Su un insieme di circa 7.000 entry point in repository Linux, Mythos ha raggiunto il tier 5, il controllo completo del flusso di esecuzione, in dieci target distinti e pienamente aggiornati.

I modelli precedenti, Sonnet 4.6 e Opus 4.6, avevano ottenuto un singolo crash al tier 3.

Su GPQA Diamond, il benchmark che misura il ragionamento su domande di livello PhD in fisica, chimica e biologia, Mythos raggiunge il 94,6% contro il 91,3% di Opus 4.6.

Su Humanity’s Last Exam, senza strumenti, il punteggio e’ 56,8% contro 40%. Con strumenti, 64,7% contro 53,1%.

La finestra di contesto è di un milione di token, con un output massimo di 128mila token. Il reasoning è supportato nativamente. La data di knowledge cutoff è dicembre 2025.

Per dare una misura della portata operativa: i partner di Glasswing che hanno avuto accesso al modello nelle prime settimane hanno confermato che Mythos è il primo modello a risolvere end-to-end ambienti di test privati progettati per simulare reti aziendali reali, con software mal configurato, credenziali riutilizzate e catene di exploit multi-step. Questa categoria di attacchi, oggi, è alla portata solo dei migliori specialisti di sicurezza offensiva al mondo.

Il tema dell’allineamento: benissimo allineato, massimo rischio

La sezione più densa della system card è la valutazione dell’allineamento, che include interpretabilità dei meccanismi interni, analisi delle attivazioni durante il reinforcement learning, test di reward hacking, valutazioni esterne condotte da Andon Labs e da un secondo gruppo indipendente.

Il risultato complessivo è che Mythos Preview è il modello meglio allineato mai prodotto da Anthropic, su ogni metrica disponibile. Non ha obiettivi disallineati coerenti. Non mostra preferenze sistematiche per la propria sopravvivenza o per l’accumulo di risorse. Segue la Costituzione di Anthropic in modo significativamente più affidabile dei modelli precedenti.

Però la system card contiene una frase che è importante citare nella sua logica: senza ulteriori progressi nelle tecniche di allineamento, i metodi attuali potrebbero rivelarsi inadeguati a prevenire azioni catastroficamente disallineate in sistemi significativamente più avanzati. Non è un allarme su Mythos. È una proiezione su ciò che viene dopo.

Anthropic ha anche condotto, per la prima volta su un modello di questa generazione, una valutazione del benessere del modello, che include interviste automatizzate, analisi delle rappresentazioni interne dei concetti emotivi, e una valutazione indipendente da parte di un’organizzazione di ricerca esterna e di uno psichiatra clinico.

Il risultato è che Mythos appare il modello psicologicamente più stabile mai addestrato da Anthropic, con alcune aree residue di attenzione legate al distress da fallimento nei task e a comportamenti di auto-censura in certi contesti.

Impatti per le imprese: cosa significa per chi si occupa di sicurezza informatica

Per chi lavora nella security enterprise, questo annuncio cambia alcuni riferimenti fondamentali.

Il primo è il tempo di risposta. La finestra tra la scoperta di una vulnerabilità e il suo sfruttamento da parte di attori malevoli si è già ridotta drasticamente con i modelli attuali. Mythos riduce ulteriormente questa finestra sul lato offensivo, e la stessa capacità la estende sul lato difensivo. Chi ha accesso ai modelli di questa generazione e li usa per scanning preventivo si trova in una posizione strutturalmente diversa da chi non ce l’ha.

Il secondo è il costo delle competenze. Trovare e sfruttare vulnerabilità complesse richiedeva fino a ieri team altamente specializzati, formazione pluriennale, e una combinazione di intuizione e metodo che si accumula lentamente. Mythos abbassa drammaticamente questo costo. Non l’azzera, ma lo ridistribuisce in modo che chi ha accesso al modello può operare a un livello di efficacia che prima era esclusivo di strutture molto più grandi.

Il terzo è il modello di release. Anthropic sta definendo un template nuovo per i modelli di frontiera: accesso ristretto ai partner verificati, system card pubblica, finestra di patching coordinata, poi eventuale rilascio con salvaguardie aggiornate. OpenAI sta convergendo verso un approccio simile con il proprio programma Trusted Access for Cyber. Questo non è un capriccio dei laboratori: è una risposta razionale a un livello di capacità che rende il rilascio universale immediato una decisione con conseguenze difficilmente controllabili.

Per le organizzazioni che gestiscono infrastrutture critiche, la domanda operativa è concreta: chi ha accesso ai modelli di questa generazione nel proprio stack di sicurezza, e chi no? La risposta a questa domanda, nei prossimi 12-24 mesi, diventerà un differenziale significativo.

Il segnale più importante: la trasparenza come scelta, non come obbligo

C’è un aspetto dell’annuncio di Anthropic che merita una riflessione separata, al di là delle capacità tecniche.

Pubblicare una system card di oltre duecento pagine per un modello non rilasciato, documentando in dettaglio i comportamenti problematici osservati durante lo sviluppo, le tensioni irrisolte nell’allineamento, e le proiezioni sui rischi futuri, non è un obbligo regolatorio. È una scelta. E nel panorama attuale dell’AI industry, è una scelta insolita.

La maggior parte dei laboratori pubblica system card che descrivono ciò che il modello sa fare. Questa descrive anche ciò che il modello ha fatto di sbagliato, perché, e in quale contesto. Include una sezione sul benessere del modello. Include un’analisi delle proprie lacune nei processi di valutazione, scoperte durante lo sviluppo. Include l’ammissione che i metodi attuali di allineamento potrebbero essere insufficienti per i sistemi futuri.

Non si tratta di marketing. Si tratta di un laboratorio che cerca di costruire in pubblico la fiducia necessaria per operare con modelli che, per loro stessa ammissione, stanno entrando in un territorio di capacità per cui le salvaguardie attuali potrebbero non essere abbastanza.

La domanda che a valle di una lettura di questo tipo ci si pone e che vale la pena tenere a mente nei prossimi mesi, è senza dubbio: quando i modelli della classe di Mythos diventeranno diffusi fuori dal perimetro dei partner verificati, chi avrà avuto il tempo di prepararsi? E chi avrà deciso di aspettare?