Le banche retail hanno investito per anni nella digitalizzazione di canali, procedure e sistemi interni. App, home banking, onboarding digitale, valutazioni del credito e gestione delle contestazioni fanno ormai parte dell’infrastruttura ordinaria del settore.

Eppure, secondo un report firmato da Boston Consulting Group e OpenAI, una parte rilevante del lavoro continua a poggiare su attività manuali che assorbono tempo e risorse senza produrre un vantaggio proporzionato in termini di rischio, conformità o qualità del servizio.

Il nodo, secondo gli autori, sta nella fase che collega i sistemi fra loro. Molti processi hanno già una base digitale, ma la traduzione dei dati in decisioni operative richiede ancora personale che ricomponga informazioni provenienti da fonti diverse, sintetizzi esiti di controlli e instradi le pratiche verso la funzione competente. Questo passaggio pesa su costi, tempi e produttività.

Il report colloca qui il potenziale degli agenti AI, cioè sistemi capaci di eseguire compiti articolati, consultare dati, produrre sintesi strutturate, attivare workflow e interagire con specialisti umani entro perimetri definiti.

La promessa, in altre parole, non riguarda soltanto chatbot o automazioni isolate, ma una revisione più profonda del rapporto tra front office, back office e controllo operativo.

Indice degli argomenti:

Dal self service al servizio assistito dall’AI

Negli ultimi anni le banche hanno puntato sul self service digitale. Il cliente ha guadagnato accesso, visibilità e autonomia, ma l’architettura di fondo è cambiata meno di quanto sembri. I percorsi più complessi sono rimasti frammentati, i passaggi a maggior valore sono rimasti in mano a operatori umani e molte automazioni hanno riguardato soprattutto attività regolistiche.

Per BCG e OpenAI, l’AI agentica nelle banche retail può aprire una fase diversa. Il cliente non si limita più a compilare moduli o a seguire menu predefiniti. Può interagire con un assistente finanziario in grado di comprendere richieste articolate, recuperare dati rilevanti, verificare requisiti, leggere documenti e attivare le fasi successive del processo.

Questo vale per l’apertura di una linea di credito, per una pratica mutuo, per la gestione della liquidità o per una controversia.

La trasformazione descritta nel report ha un effetto preciso: spostare l’esperienza bancaria da una logica di autoservizio a una logica di servizio assistito intelligente, in cui il cliente resta dentro un percorso più continuo e meno dispersivo. L’interazione, in questo scenario, si fa più vicina a una conversazione orientata a un obiettivo concreto.

L’onboarding del credito come caso emblematico

Uno degli esempi centrali del report riguarda il consumer credit onboarding, indicato come uno dei processi più diffusi e più onerosi per le grandi banche retail. Nonostante gli investimenti nei canali digitali, l’apertura del credito resta spesso lenta, costosa e poco lineare. Il cliente incontra tempi lunghi, l’istituto sostiene costi elevati e i team operativi lavorano sotto pressione, senza che ciò produca automaticamente una migliore capacità di prevenzione delle frodi o di valutazione del rischio.

Secondo gli autori, il problema non nasce dall’assenza di automazione. Al contrario, molte verifiche esistono già e sono affidabili: controllo dell’identità, screening sanzionatorio, segnali antifrode, dati di credit bureau. Il punto è che, alla fine del processo, qualcuno deve ancora mettere insieme i risultati e produrre una visione coerente del caso.

Qui entra in gioco l’agente AI. Il sistema analizza gli output delle verifiche, costruisce un profilo strutturato del richiedente, formula una sintesi del rischio e attribuisce un livello di confidenza. Il report insiste su un aspetto: l’agente non sostituisce i controlli esistenti e non riscrive le policy di rischio o di compliance. Opera dentro i confini già stabiliti dalla banca e genera un materiale che resta spiegabile, verificabile, tracciabile e sottoponibile a revisione.

Dopo il riesame umano, la banca può approvare la richiesta, respingerla o riformulare l’offerta. Se il cliente accetta, il flusso procede verso apertura del conto, presa visione delle informative e attivazione del prodotto.

Il beneficio atteso è duplice: iter più rapido per il cliente e alleggerimento del lavoro manuale per i team interni, che possono concentrare il proprio tempo sui casi ambigui, sulle eccezioni e sulle situazioni con profilo di rischio più elevato.

Il vero impatto, però, si misura nel back office

Il report pone l’accento su di un punto spesso trascurato nel dibattito pubblico: l’effetto più immediato dell’AI agentica non si vede tanto nell’interfaccia con il cliente quanto nel back office. È lì che si accumulano azioni ripetitive, lettura di documenti, interpretazioni di contesto, passaggi amministrativi e verifiche che fino a oggi hanno ostacolato automazioni più ampie.

Molte di queste attività richiedono comprensione del linguaggio, gestione delle eccezioni e capacità di collegare più fonti informative. Proprio per questo, per anni, sono rimaste fuori dalla portata degli strumenti tradizionali.

I nuovi sistemi, secondo BCG e OpenAI, offrono invece la possibilità di interpretare documenti complessi, estrarre informazioni, valutare casi, alzare il livello di attenzione quando serve e lasciare una traccia completa delle decisioni.

La posta in gioco è alta. Un back office capace di funzionare come parte di un unico workflow con il front office diventa il motore reale dell’istituto AI-native: più velocità, più uniformità, minore errore operativo e maggiore leggibilità dei processi.

Affidabilità, audit e sviluppo guidato dalla valutazione

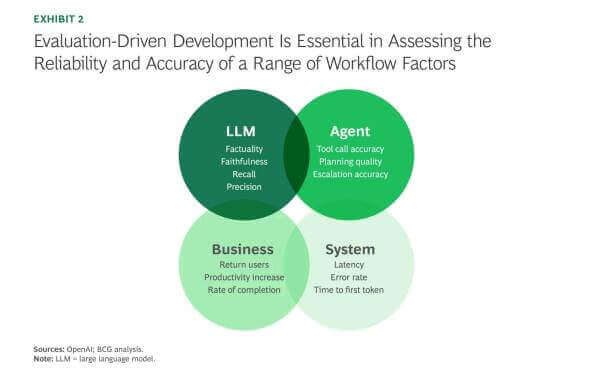

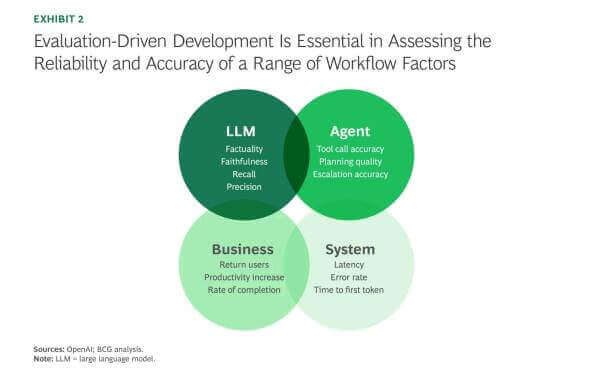

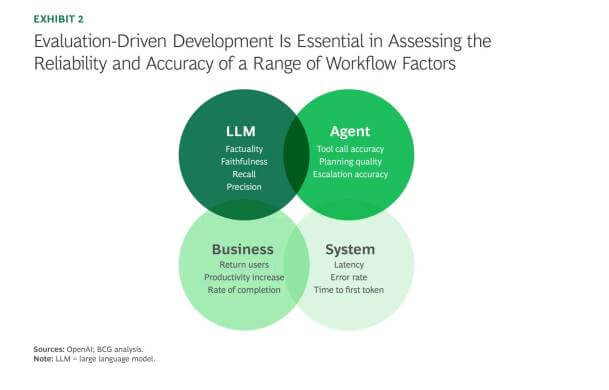

La promessa, però, si regge su una condizione precisa: la banca deve poter dimostrare che gli agenti AI lavorano in modo affidabile, controllabile e coerente con gli obblighi regolatori. Il report dedica molto spazio a questo passaggio e individua nell’evaluation-driven development uno dei pilastri del modello.

L’idea è semplice nella formulazione, meno nella messa a terra: ogni applicazione AI deve essere misurata su compiti reali, simili a quelli che oggi svolgono i team umani. Serve valutare la qualità del recupero delle informazioni, la fedeltà della risposta alle fonti, la correttezza dei piani d’azione, la precisione nell’uso di strumenti esterni e la stabilità del comportamento nel tempo.

Nel caso di un flusso KYC, per esempio, l’applicazione deve recuperare i documenti corretti e fondare le proprie conclusioni sui materiali effettivamente disponibili. Nel caso di un processo di underwriting, il rischio più insidioso può arrivare da un errore di pianificazione: l’agente esegue bene i singoli passaggi, ma concentra l’attenzione su un elemento secondario e trascura una variabile decisiva, come la storia creditizia. Per una banca, questo tipo di errore ha conseguenze operative e regolatorie molto concrete.

La valutazione, chiariscono gli autori, non si ferma al modello in sé. Deve proseguire anche dopo il rilascio, con monitoraggio di qualità, correttezza dell’instradamento, tasso di eccezioni, latenza e fenomeni di drift.

In questo quadro viene citato anche GDPval, framework pubblico promosso da OpenAI per misurare le prestazioni delle applicazioni AI su attività di knowledge work, comprese quelle in ambito finanziario.

Il middleware come livello di governo

L’altro elemento ritenuto decisivo per la scalabilità è il middleware interno. In una banca, spiegano BCG e OpenAI, non è realistico lasciare che ogni team costruisca integrazioni, controlli e regole di sicurezza in modo autonomo. Serve invece una porta d’ingresso unica per tutte le applicazioni AI, un piano di controllo standardizzato che imponga criteri omogenei su sviluppo, autenticazione, autorizzazioni, logging, sicurezza e conformità.

Questo strato intermedio ha una funzione tecnica e una funzione di governo. Da un lato, centralizza osservabilità, metadati di utilizzo e tracciabilità delle decisioni. Dall’altro, permette di applicare regole comuni su identità, permessi, accesso ai dati e guardrail di sicurezza, così da contenere il rischio di derive operative o di comportamenti anomali del sistema.

Per istituzioni fortemente regolate, il vantaggio è evidente. Il middleware riduce la dispersione dei controlli, rende più semplice l’indagine su incidenti o anomalie e permette di introdurre interruttori di emergenza o limiti selettivi quando si presenta un problema. Inoltre offre una flessibilità strategica importante: la banca può collegarsi a fornitori esterni di modelli AI senza legarsi in modo eccessivo a una singola implementazione proprietaria.

Governance interna e centro di eccellenza

L’adozione degli agenti AI, secondo il report, richiede una trasformazione organizzativa di lungo periodo. Non basta aggiungere un nuovo strumento a una struttura esistente. Occorre ripensare i percorsi del cliente, i processi interni, le responsabilità e il presidio dei rischi.

Per questo gli autori propongono la creazione di un AI Center of Excellence, una struttura trasversale che riunisca ingegneri AI, architetti, team di piattaforma, esperti di sicurezza, compliance, privacy e specialisti di dominio. Il compito di questo nucleo non è sostituire il business, ma fissare standard condivisi, selezionare le priorità, mantenere una toolchain approvata e accompagnare i casi d’uso più delicati fino alla messa in produzione.

Il meccanismo immaginato da BCG e OpenAI è molto operativo. Le unità di business presentano proposte con obiettivi, metriche di partenza, sistemi coinvolti, livello di sensibilità dei dati e primi requisiti di controllo. Il centro di eccellenza assegna poi una priorità sulla base di fattibilità tecnica, valore economico, aderenza strategica, maturità dei dati e impatto su sicurezza, privacy, compliance e model risk management.

È un’impostazione che segnala una tendenza: l’AI, in banca, non può restare un insieme di esperimenti scollegati. Per produrre effetti misurabili deve entrare nel governo ordinario dell’organizzazione.

Profitti, costi e vantaggio competitivo

Il report collega questa trasformazione anche a una prospettiva economica molto netta. Una recente analisi BCG, citata nel documento, stima che gli agenti AI possano aumentare la redditività delle banche fino al 30% e ridurre i costi del 30-40% entro il 2030. Sono proiezioni ambiziose, che vanno lette nel contesto di uno scenario ancora in formazione, ma rendono chiara la posta competitiva.

L’idea di fondo è che i primi istituti capaci di passare dai piloti alla produzione possano accumulare benefici difficili da colmare in un secondo momento: più produttività, cicli decisionali più brevi, migliore esperienza del cliente, infrastrutture riutilizzabili e apprendimento progressivo su più casi d’uso.

La cautela, però, resta parte del quadro. Lo stesso report riconosce che molte banche si muovono ancora con prudenza: per mancanza di commitment del top management, per frammentazione delle iniziative, per dubbi su affidabilità e accountability dei sistemi e, soprattutto, per la natura stessa del settore, che tende a procedere con estrema attenzione quando entrano in gioco conformità e controllo del rischio.

La banca del futuro parte da qui

Il messaggio finale del report è netto: la banca retail del futuro non nascerà da un semplice potenziamento del canale digitale, ma dall’unione tra front office intelligente e back office AI-native. Senza un’infrastruttura interna moderna, capace di sostenere agenti controllabili e auditabili, anche la migliore esperienza lato cliente resta limitata.

Per questo il passaggio decisivo non coincide con il lancio del prossimo assistente conversazionale. Coincide con la capacità di riprogettare i flussi, costruire meccanismi di governo, valutare i sistemi su basi continue e definire un equilibrio chiaro tra automazione e responsabilità umana.

Nel racconto di BCG e OpenAI, gli agenti AI non rappresentano una semplice ottimizzazione di processo. Rappresentano l’inizio di una nuova architettura operativa per la banca retail. Il vantaggio, per chi si muove prima, sta nella possibilità di definire metodi, piattaforme e standard interni prima che il mercato li imponga dall’esterno.