Anthropic ha introdotto Claude Mythos Preview, un modello di intelligenza artificiale progettato per individuare vulnerabilità informatiche su larga scala. L’annuncio, diffuso il 7 aprile 2026, arriva pochi giorni dopo la pubblicazione accidentale online di documenti tecnici e codice sorgente legati alla stessa tecnologia.

La decisione di limitare l’accesso al modello segna una discontinuità rispetto alle strategie precedenti del settore: l’azienda sostiene che le capacità di Mythos siano tali da rendere rischiosa una distribuzione pubblica.

Indice degli argomenti:

Accesso ristretto e coalizione industriale

Anthropic ha scelto di rendere il sistema disponibile solo a un consorzio di oltre 40 organizzazioni, riunite nel progetto Glasswing. Tra i partecipanti figurano Amazon, Apple, Microsoft e Google, oltre a fornitori infrastrutturali come Cisco e Broadcom e società specializzate come CrowdStrike.

Al progetto partecipano anche organizzazioni che gestiscono software open source critici, tra cui la Linux Foundation. Anthropic ha stanziato fino a 100 milioni di dollari in crediti per incentivare l’utilizzo del modello e raccogliere feedback operativo.

Le fughe di dati e la credibilità della sicurezza

Il debutto di Mythos è accompagnato da interrogativi sulla sicurezza interna della società. A marzo 2026, una cache pubblica ha reso accessibili descrizioni tecniche del modello. Nei giorni successivi, parte del codice sorgente dell’assistente Claude Code è stata diffusa online.

Anthropic ha attribuito entrambi gli episodi a errori umani. Tuttavia, la sequenza ravvicinata degli incidenti ha sollevato dubbi tra osservatori e operatori del settore sulla gestione dei dati sensibili, soprattutto considerando la natura strategica delle tecnologie sviluppate.

Claude Mythos: capacità tecniche e ricerca automatizzata

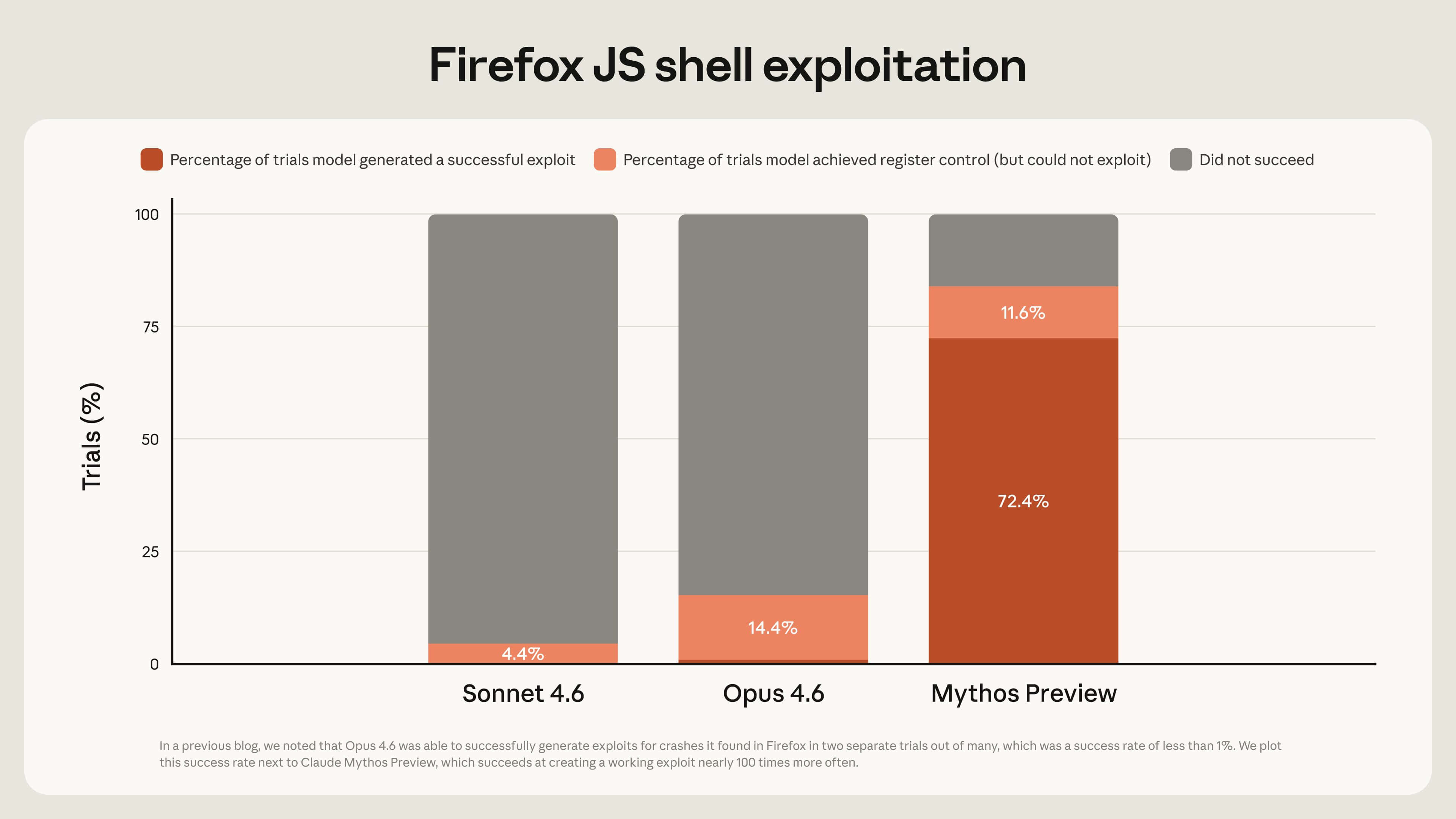

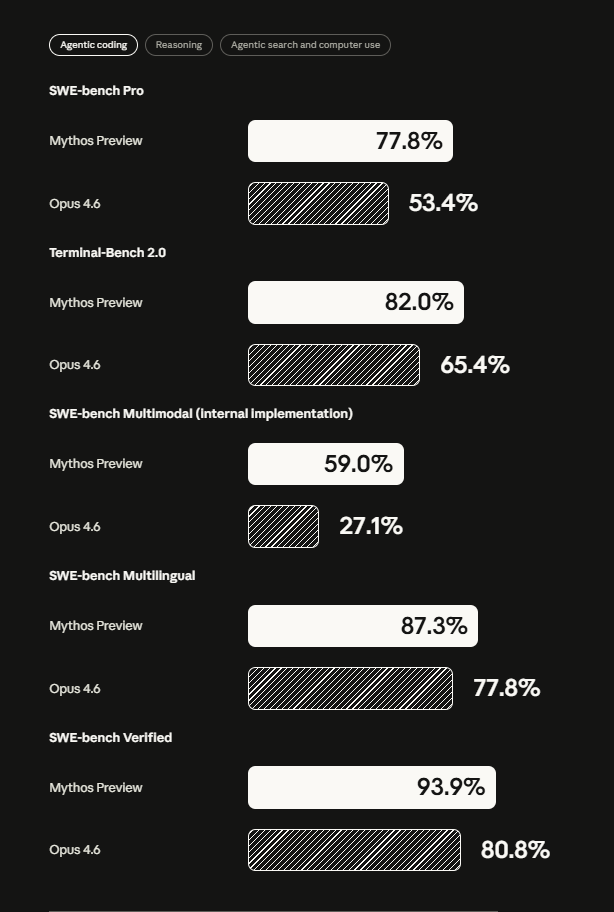

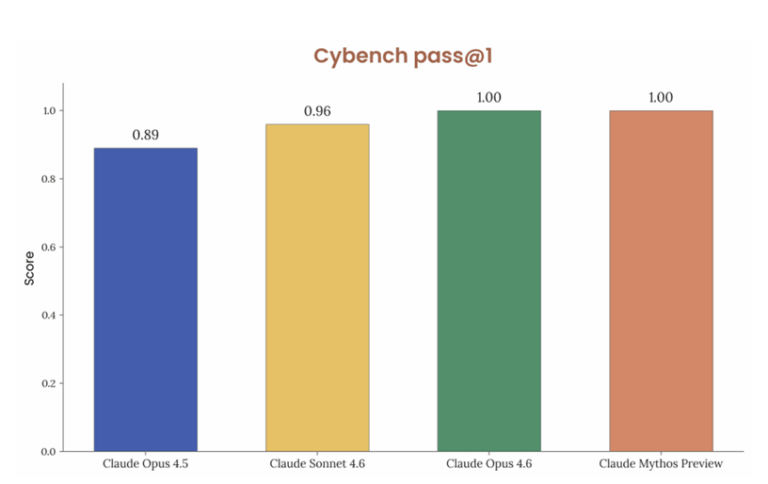

Claude Mythos è descritto dai suoi sviluppatori come un sistema in grado di condurre attività autonome di ricerca sulla sicurezza informatica. Il modello può analizzare codice, individuare vulnerabilità e, in alcuni casi, sviluppare exploit funzionanti.

Secondo i dati diffusi da Anthropic, nelle prime settimane di utilizzo il sistema ha identificato migliaia di vulnerabilità “zero-day”, cioè falle sconosciute anche agli sviluppatori dei software colpiti. Il perimetro delle analisi include sistemi operativi, browser e applicazioni ampiamente diffuse.

Tra gli esempi citati figura una vulnerabilità presente da 27 anni in OpenBSD, sistema operativo open source progettato per essere altamente sicuro, e un errore in software video rilevato dopo milioni di test automatici senza esito.

Il doppio uso della tecnologia

La stessa capacità di individuare vulnerabilità rappresenta il principale elemento di rischio. Anthropic riconosce che strumenti come Mythos possono essere utilizzati sia per rafforzare la sicurezza sia per attaccare infrastrutture digitali.

Jared Kaplan, direttore scientifico di Anthropic ha dichiarato in un’intervista che l’obiettivo è fornire un vantaggio iniziale agli attori impegnati nella difesa dei sistemi informatici, accelerando l’individuazione e la correzione delle falle.

Allo stesso tempo, il responsabile dei test interni, Logan Graham, ha definito il modello un punto di svolta per l’intero settore, con implicazioni dirette sull’equilibrio tra difensori e attaccanti nel cyberspazio.

Il confronto con precedenti nel settore

La scelta di non rilasciare pubblicamente il modello richiama precedenti nel settore dell’intelligenza artificiale. Nel 2019, OpenAI aveva inizialmente limitato la diffusione del modello GPT-2, citando rischi legati alla generazione automatica di contenuti manipolativi.

Nel caso di Mythos, Anthropic sostiene che il livello di rischio sia più immediato, perché legato a infrastrutture critiche e alla sicurezza dei sistemi informatici globali.

Project Glasswing

Il Project Glasswing è stato creato sulla base delle capacità osservate nel nuovo modello di frontiera sviluppato da Anthropic, Claude Mythos2 Preview. Un modello generalista – non ancora rilasciato – che evidenzia un dato rilevante: i sistemi di intelligenza artificiale hanno raggiunto un livello tale nella scrittura e analisi del codice da superare quasi tutti gli esseri umani nell’individuazione e nello sfruttamento delle vulnerabilità software.

Il progetto prende il nome dalla farfalla dalle ali di vetro, la Greta oto. La metafora può essere interpretata in due modi: le ali trasparenti della farfalla le consentono di mimetizzarsi in piena vista, proprio come le vulnerabilità di cui si parla in questo post; le permettono inoltre di sfuggire al pericolo, proprio come la trasparenza che sosteniamo nel nostro approccio.

Le conseguenze per economia, sicurezza pubblica e stabilità nazionale potrebbero essere rilevanti. Project Glasswing nasce come iniziativa per indirizzare queste capacità verso finalità difensive.

Nell’ambito del progetto, i partner coinvolti utilizzano Mythos Preview per attività di sicurezza difensiva. Anthropic condivide i risultati ottenuti per favorire benefici estesi all’intero settore.

Project Glasswing viene presentato come un punto di partenza. Nessuna singola organizzazione è in grado di affrontare da sola le sfide della sicurezza informatica: sviluppatori di AI avanzata, aziende software, ricercatori, comunità open source e governi sono tutti chiamati a contribuire.

Il rafforzamento delle difese delle infrastrutture digitali globali richiederà anni, mentre le capacità dell’intelligenza artificiale sono destinate a progredire rapidamente nel breve periodo.

Secondo i promotori, un’azione immediata è necessaria per consentire ai sistemi di difesa di mantenere un vantaggio.

Crescita economica e strategia aziendale

Anthropic si trova in una posizione particolare nel mercato dell’intelligenza artificiale. Da un lato sviluppa modelli sempre più avanzati e genera ricavi crescenti; dall’altro evidenzia pubblicamente i rischi associati alle proprie tecnologie.

Secondo dati comunicati dalla società, i ricavi annuali previsti per il 2026 superano i 30 miliardi di dollari, rispetto ai 9 miliardi dell’anno precedente. La crescita è legata soprattutto all’adozione del sistema Claude come strumento per la programmazione.

L’ottimizzazione delle capacità di coding ha effetti diretti sulla sicurezza: un sistema in grado di scrivere codice complesso è anche in grado di analizzarlo e individuarne le debolezze.

Impatti sul mercato della cyber sicurezza

L’introduzione di modelli come Mythos modifica i tempi e le modalità della sicurezza informatica. Attività che richiedevano mesi di lavoro umano possono essere eseguite in pochi minuti da sistemi automatizzati.

Secondo Elia Zaitsev, chief technology officer di CrowdStrike, azienda di cybersecurity, accesso al modello dimostra come le capacità difensive possano scalare rapidamente, ma allo stesso tempo suggerisce che attori malevoli cercheranno di sfruttare strumenti analoghi.

Il rischio, evidenziato anche da operatori del settore, è che la scoperta sistematica delle vulnerabilità diventi un processo continuo e automatizzato, aumentando la pressione su aziende e istituzioni per aggiornare costantemente i propri sistemi.

Il nodo delle infrastrutture legacy

Una delle questioni aperte riguarda la sicurezza dei sistemi basati su codice obsoleto. Molte infrastrutture critiche, dai servizi digitali ai sistemi industriali, utilizzano componenti sviluppati anni fa.

Secondo Graham, questi sistemi erano considerati relativamente sicuri perché richiedevano competenze elevate e tempi lunghi per essere attaccati. L’automazione introdotta dall’intelligenza artificiale potrebbe modificare questo equilibrio, rendendo vulnerabili anche piattaforme finora ritenute protette.

Investimenti e sostegno all’open source

Oltre ai crediti destinati ai partner, Anthropic ha annunciato un finanziamento di 4 milioni di dollari per gruppi che sviluppano software open source, con l’obiettivo di rafforzarne la sicurezza.

Il tema è rilevante perché molti sistemi critici si basano su componenti open source, spesso mantenuti da comunità ristrette e con risorse limitate.

Una corsa tecnologica destinata ad accelerare

Secondo i dirigenti dell’azienda, le capacità di Mythos non sono il risultato di un addestramento specifico sulla cyber sicurezza, ma una conseguenza generale dell’aumento delle prestazioni dei modelli di intelligenza artificiale.

Questo implica che funzionalità simili potrebbero emergere rapidamente anche in altri sistemi sviluppati da concorrenti. La competizione tra attori pubblici e privati per sfruttare queste tecnologie è destinata a intensificarsi.

Implicazioni sistemiche

L’introduzione di strumenti in grado di individuare e sfruttare vulnerabilità su scala globale pone interrogativi sulla tenuta delle infrastrutture digitali. La possibilità che attori non specializzati possano avviare analisi avanzate con semplici comandi riduce le barriere all’ingresso nel campo degli attacchi informatici.

Allo stesso tempo, la disponibilità di questi strumenti per le organizzazioni impegnate nella difesa potrebbe migliorare la capacità di prevenzione e risposta.

La scelta di Anthropic di limitare la diffusione del modello segnala la percezione di un rischio elevato, ma non elimina la prospettiva che tecnologie simili diventino accessibili in futuro.

Keyword: Claude Mythos

Titolo SEO (60 caratteri)

Claude Mythos, AI Anthropic tra cyber rischio globale

Meta description (130 caratteri)

molto interessante se scritto in modo più accessibile grazie