La Casa Bianca si è opposta al piano di Anthropic per ampliare l’accesso a Mythos, uno dei modelli di intelligenza artificiale più sensibili oggi in circolazione per le sue capacità di individuare e sfruttare vulnerabilità software. La decisione aggiunge un nuovo elemento di tensione nel rapporto tra l’amministrazione statunitense e una delle società più osservate nel settore dell’AI, proprio mentre Washington prova a tenere insieme due obiettivi difficili da conciliare: accelerare l’innovazione e contenere i rischi per la sicurezza nazionale.

Secondo persone informate sui fatti, Anthropic aveva proposto di consentire l’uso di Mythos a circa altre 70 aziende e organizzazioni, portando a circa 120 il numero complessivo dei soggetti autorizzati.

L’amministrazione ha comunicato la propria contrarietà per ragioni legate alla sicurezza. A pesare, secondo una delle fonti citate, c’è anche un timore più operativo: Anthropic potrebbe non avere potenza di calcolo sufficiente per servire una platea così ampia senza ridurre l’efficacia dell’accesso riservato al governo.

Il punto non riguarda soltanto una disputa commerciale o un normale confronto regolatorio. Mythos è considerato un modello capace di trovare falle nei software e di agevolarne lo sfruttamento. Per questo la sua distribuzione non viene trattata come il lancio di un normale prodotto digitale, ma come un dossier che incrocia cybersicurezza, infrastrutture critiche, rapporti con il Pentagono e controllo pubblico su tecnologie a doppio uso.

Indice degli argomenti:

Perché Mythos preoccupa Washington

Il coinvolgimento diretto della Casa Bianca nel rollout di Mythos nasce dal profilo di rischio attribuito al modello. Nelle ultime settimane, la sua capacità di individuare e sfruttare vulnerabilità avrebbe allarmato sia agenzie federali sia aziende private. Il timore è chiaro: un sistema del genere può essere utile ai difensori per trovare bug e correggerli prima che vengano usati contro reti e servizi, ma può anche abbassare la soglia tecnica necessaria per avviare attacchi informatici o per generare interruzioni su larga scala online.

È il nodo classico delle tecnologie dual use, ma su scala molto più ampia. Se un modello diventa abbastanza efficace nell’automatizzare la ricerca delle falle, il vantaggio non si limita più ai team di sicurezza ben finanziati. Si estende anche a soggetti ostili, criminali o statali, che possono sfruttare la velocità e la capacità di analisi della macchina per moltiplicare il numero dei tentativi e ridurre i tempi tra scoperta della vulnerabilità e attacco.

Da qui la prudenza della Casa Bianca. L’amministrazione ha lasciato intendere che il tema non sia soltanto chi ottiene l’accesso, ma come quell’accesso viene gestito, con quali priorità e con quali garanzie sulla capacità di risposta del fornitore.

In altre parole: non basta limitare il numero degli utenti o selezionare organizzazioni affidabili, se poi l’infrastruttura tecnica non regge o se il controllo sulle attività non è ritenuto sufficiente.

Un rapporto difficile tra governo Usa e Anthropic

Il rifiuto opposto alla richiesta di Anthropic mostra che il rapporto con Washington resta instabile nonostante i tentativi di allentare le tensioni. Le discussioni su Mythos, almeno nelle intenzioni, servivano anche a ricostruire un canale di fiducia tra l’azienda e il governo. Ma il contesto politico e legale resta segnato da attriti precedenti.

L’amministrazione Trump, secondo quanto riferito, aveva provato a prendere le distanze dalla società dopo uno scontro con il Pentagono sull’uso militare degli strumenti di intelligenza artificiale sviluppati da Anthropic. La controversia non è rimasta sul piano politico: si starebbe infatti muovendo in sede giudiziaria in due cause distinte. Questo dettaglio è importante perché segnala che le frizioni non riguardano solo singole decisioni industriali, ma il perimetro stesso della collaborazione tra Stato e imprese private in un settore strategico.

A complicare ulteriormente il quadro c’è una dimensione apertamente politica. L’amministrazione ha criticato Anthropic per i suoi legami con organizzazioni che sostengono cause liberal, come le richieste di una regolazione rigorosa dell’intelligenza artificiale.

La società è stata contestata anche per la presenza nel proprio organico di diversi ex funzionari dell’amministrazione Biden. In un contesto del genere, le decisioni tecniche finiscono per essere lette anche come atti politici.

Accesso limitato, niente rilascio pubblico

Anthropic aveva inizialmente concesso l’accesso a circa 50 aziende e organizzazioni che gestiscono infrastrutture critiche. Non risultano piani per un rilascio pubblico di Mythos. Alcune agenzie governative hanno già accesso al modello, e l’amministrazione Trump starebbe lavorando per ampliarlo ulteriormente all’interno del settore pubblico.

Questa architettura selettiva conferma che Mythos non è trattato come un prodotto da distribuire su larga scala, almeno in questa fase. Il modello viene invece gestito come una risorsa sensibile, da mettere nelle mani di soggetti considerati strategici o capaci di utilizzarlo in ambiti di difesa. Il fatto che la Casa Bianca si opponga a un’estensione relativamente circoscritta, circa 70 entità in più, indica quanto il margine di tolleranza resti stretto.

Un funzionario della Casa Bianca ha spiegato che l’amministrazione sta cercando un equilibrio tra innovazione e sicurezza, collaborando con il settore privato per garantire che i modelli di AI vengano distribuiti in modo sicuro.

È una formula che fotografa il dilemma di Washington: gli Stati Uniti non vogliono rallentare la corsa nell’intelligenza artificiale, ma non intendono neppure lasciare che i modelli più avanzati si diffondano senza filtri in ambiti che possono avere ricadute immediate sulla sicurezza nazionale.

Anthropic Mythos e la Casa Bianca: il fattore cyber e il rischio valanga di bug

Le preoccupazioni si sono rafforzate dopo che Anthropic ha dichiarato di stare indagando su un possibile accesso non autorizzato a Mythos. L’episodio ha alimentato i timori di un effetto valanga nella scoperta di bug software. Se un modello del genere venisse consultato o copiato senza autorizzazione, il rischio non sarebbe solo quello di una violazione aziendale, ma di una moltiplicazione della capacità offensiva in rete.

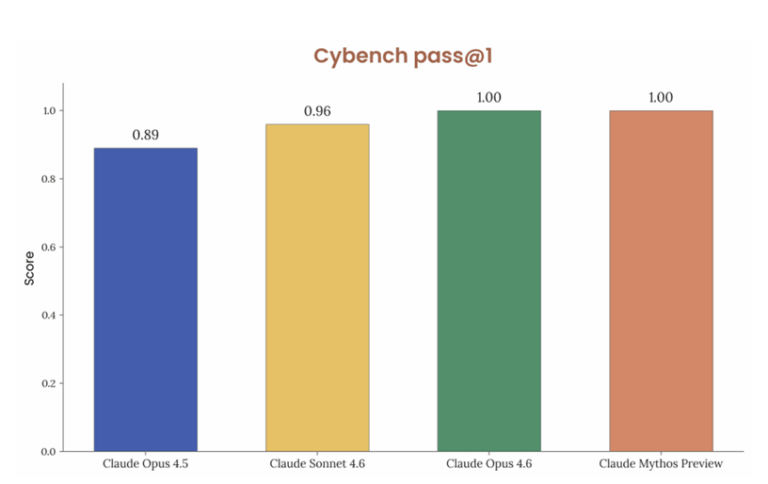

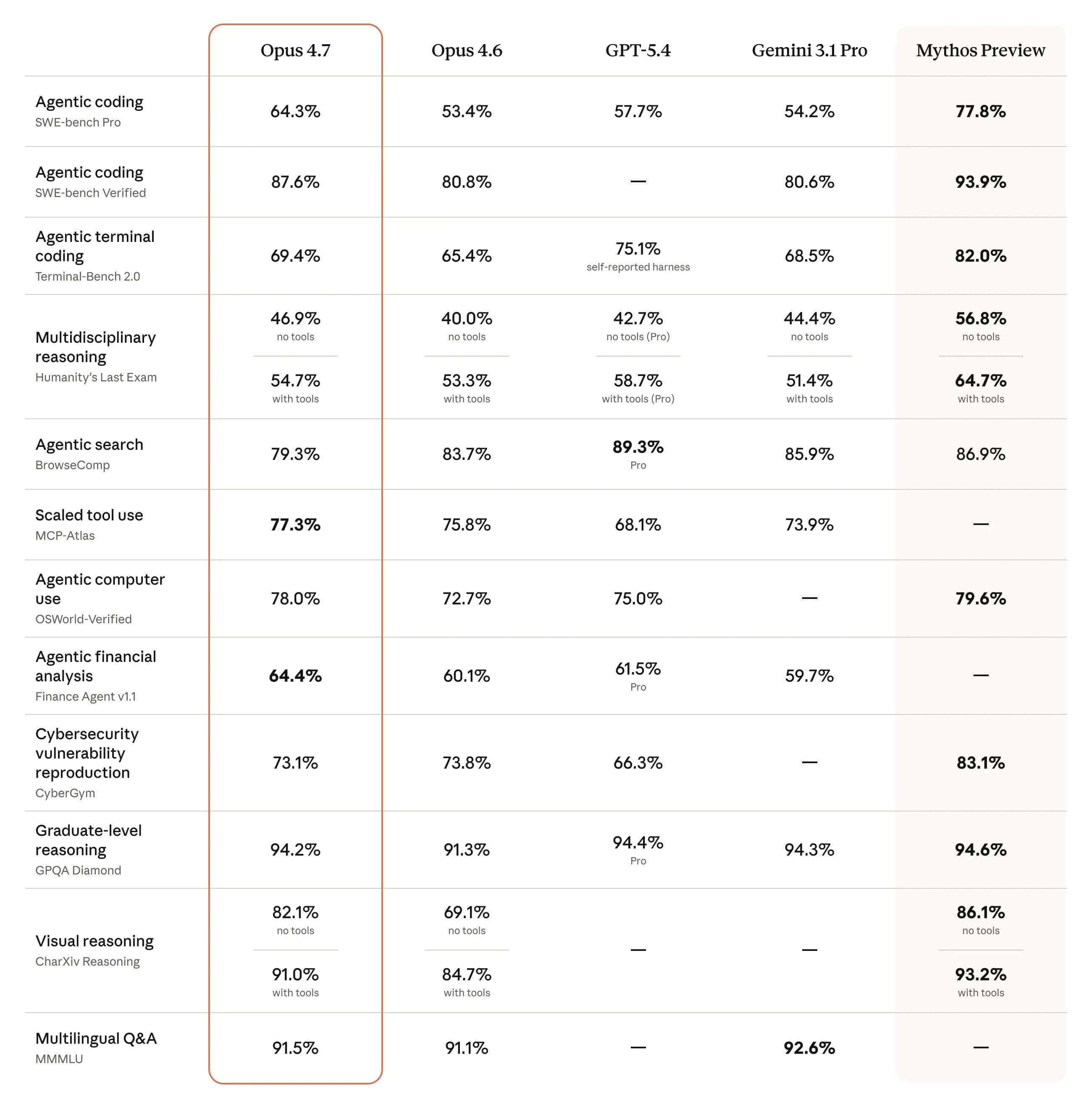

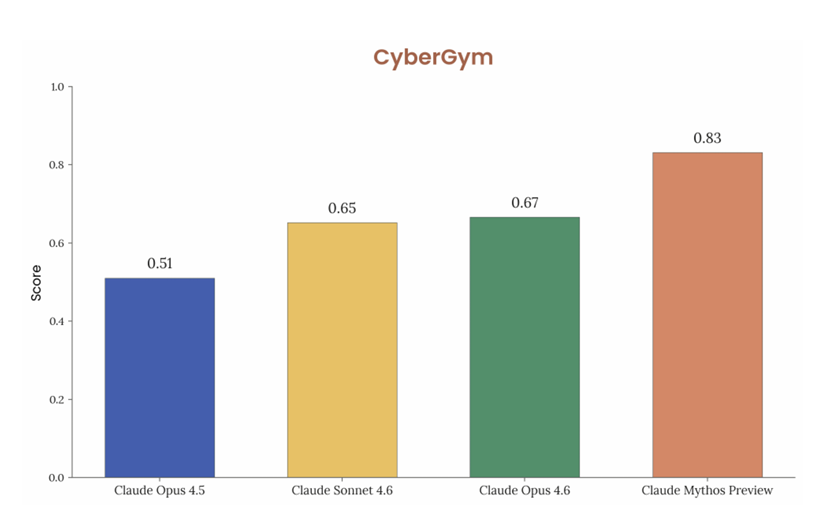

Gli esperti di cybersicurezza citati nel testo osservano che Mythos, insieme ai modelli di frontiera sviluppati da OpenAI e da Google, sta raggiungendo un livello tale da rendere molto più efficiente la ricerca e lo sfruttamento delle vulnerabilità. Questo non significa automaticamente che i cyberattacchi aumenteranno, ma rende più facile per un numero maggiore di attori avvicinarsi a strumenti prima riservati a gruppi altamente specializzati.

Tutte e tre le aziende hanno già avviato programmi di accesso anticipato ai propri modelli per i ricercatori di sicurezza, con l’obiettivo di trovare e correggere i bug prima che vengano sfruttati. Ma qui emerge un altro problema economico e industriale: anche quando la scoperta delle falle serve a proteggere i sistemi, la quantità di vulnerabilità individuate può diventare difficile da gestire.

Creare, testare e installare le patch richiede tempo, personale e coordinamento. Se la velocità di individuazione supera la capacità di correzione, il sistema entra in tensione.

Il collo di bottiglia della potenza di calcolo

Uno dei punti più delicati della vicenda riguarda la disponibilità di potenza di calcolo. Alcuni consiglieri della Casa Bianca sull’intelligenza artificiale hanno ipotizzato che una delle ragioni del rollout limitato di Mythos sia la minore disponibilità di capacità computazionale rispetto ai concorrenti. Per i modelli di frontiera, il compute non è un dettaglio tecnico: è un fattore produttivo decisivo, quasi una materia prima.

La questione conta per almeno due ragioni. La prima è industriale. Senza sufficiente capacità di calcolo, un’azienda non può servire molti utenti ad alte prestazioni, soprattutto se il modello è impiegato in compiti complessi e continui. La seconda è politica. Se il governo considera strategico l’uso di Mythos per attività di sicurezza o difesa, vorrà evitare che l’apertura a clienti aggiuntivi riduca la qualità del servizio a disposizione delle agenzie federali.

Anthropic, da parte sua, ha stretto di recente accordi con Amazon, Google e Broadcom per aumentare l’accesso alla capacità di calcolo. Ma questi progetti richiedono tempo prima di entrare a regime. Nel frattempo, le aziende dell’AI possono dare priorità ad alcuni utenti, per esempio al governo, nella distribuzione delle risorse computazionali.

Molti nel settore sperano anche che modelli più efficienti riducano nel tempo i vincoli, ma al momento il collo di bottiglia resta uno dei principali fattori di selezione competitiva.

Sicurezza nazionale e mercato dell’intelligenza artificiale

La partita su Mythos mostra con particolare chiarezza come il mercato dell’AI stia assumendo tratti sempre più vicini a quelli dell’industria della difesa o dell’energia: pochi operatori, forti barriere all’ingresso, dipendenza da infrastrutture costose, ruolo attivo del governo e forte intersezione tra strategia industriale e sicurezza nazionale.

Per Anthropic, poter ampliare l’accesso a Mythos significherebbe consolidare il proprio posizionamento presso aziende e organizzazioni considerate strategiche. In termini economici, un allargamento della base utenti può aumentare ricavi, influenza tecnologica e raccolta di feedback utili a migliorare il prodotto.

Ma per la Casa Bianca l’allargamento comporta un costo potenziale in termini di esposizione al rischio. Più soggetti accedono a uno strumento potente, maggiore è la complessità del controllo e più elevata è la probabilità di usi impropri o di incidenti operativi.

È in questo spazio che si misura il nuovo equilibrio tra Stato e imprese dell’AI. Le aziende chiedono margini per crescere, attrarre partner e recuperare gli investimenti in infrastrutture. Il governo vuole beneficiare dell’innovazione privata, ma pretende un livello di supervisione coerente con la natura strategica di questi strumenti. Mythos, in questo senso, non è solo un prodotto: è un test sulla futura governance dell’intelligenza artificiale avanzata negli Stati Uniti.

Le tensioni interne all’amministrazione

La diffidenza verso Anthropic emerge anche da un altro episodio. Un ex ricercatore della società, Collin Burns, era stato indicato per guidare un ufficio governativo incaricato di valutare i migliori modelli di AI. L’amministrazione avrebbe poi cambiato bruscamente linea, scegliendo un altro profilo.

Secondo le fonti, alcuni alti funzionari della Casa Bianca non erano stati informati della decisione iniziale e non volevano affidare un ruolo così delicato a una persona proveniente da una delle principali aziende del settore, proprio perché quel ruolo richiede contatti stretti con le società leader. Il caso segnala che, dentro l’amministrazione, esiste una sensibilità elevata sul rischio di conflitti di interesse o di eccessiva vicinanza tra regolatori e regolati.

Anche questo passaggio ha un rilievo economico. In un settore dominato da pochi gruppi con risorse immense e relazioni sempre più profonde con il potere pubblico, la credibilità delle istituzioni dipende anche dalla distanza percepita rispetto agli operatori che dovrebbero essere valutati o controllati.

Anthropic e Casa Bianca: un conflitto destinato a pesare sul settore

Diversi analisti, fra cui Dean Ball, già consigliere sull’AI nell’amministrazione Trump e oggi senior fellow alla Foundation for American Innovation, ritengono controproducente uno scontro aperto tra Anthropic e la Casa Bianca.

La ragione è pragmatica: su dossier come la cybersicurezza, governo e aziende tecnologiche hanno bisogno di cooperare. Nessuno dei due può gestire da solo una fase in cui i modelli diventano abbastanza potenti da cambiare tanto la difesa quanto l’offesa informatica.

Il caso Mythos, però, mostra che la cooperazione non elimina il conflitto. Lo rende più strutturale. Le imprese private sviluppano strumenti che lo Stato considera essenziali ma al tempo stesso potenzialmente pericolosi. Il governo dipende dall’innovazione industriale, ma teme di perdere controllo sui suoi effetti.

Le società tecnologiche cercano riconoscimento politico e accesso ai contratti pubblici, ma resistono quando la supervisione rischia di rallentare il business o di limitarne l’autonomia.

La decisione della Casa Bianca di opporsi all’ampliamento dell’accesso a Mythos non chiude la questione. Segna però un punto fermo: per Washington, i modelli di AI capaci di incidere direttamente sulla sicurezza delle reti e delle infrastrutture non possono essere distribuiti con le stesse logiche con cui si allarga il mercato di un normale software enterprise.

È una linea che pesa sui conti, sulle alleanze industriali e sulla velocità della competizione. E che dice molto su come gli Stati Uniti intendono governare la prossima fase dell’intelligenza artificiale.