Un’azienda da 380 miliardi di dollari di valutazione e 14 miliardi di fatturato annualizzato ha rifiutato un contratto con il Pentagono per due principi non negoziabili: niente sorveglianza di massa, niente armi autonome. La risposta è stata un ordine esecutivo che vieta l’uso della sua tecnologia a tutte le agenzie federali e la designazione come “rischio per la catena di approvvigionamento della sicurezza nazionale”, un’etichetta normalmente riservata ad avversari stranieri come Huawei. L’azienda è Anthropic. Il suo prodotto è Claude. La vicenda, che si è consumata nell’ultima settimana di febbraio 2026, illumina una traiettoria che merita di essere ricostruita dall’inizio.

Indice degli argomenti:

Da OpenAI ad Anthropic: la scissione che ha cambiato il settore

La storia di Anthropic inizia con un dissenso interno a OpenAI. Nel dicembre 2020 Dario Amodei, allora VP of Research e tra i principali artefici di GPT-2 e GPT-3, lascia l’organizzazione. Lo seguono sei persone: la sorella Daniela Amodei (VP of Safety & Policy), Tom Brown (lead engineer di GPT-3), Chris Olah (pioniere dell’interpretabilità delle reti neurali), Sam McCandlish, Jared Kaplan e Jack Clark.

In un’intervista al Lex Fridman Podcast, Amodei ha smentito la narrativa più diffusa sulla scissione: “People say we left because we didn’t like the Microsoft deal. That’s wrong.” Il motore reale era la convinzione che servisse un’organizzazione dove ricerca sulla sicurezza e sviluppo delle capacità fossero integrati fin dall’inizio, non trattati come funzioni separate.

La ristrutturazione di OpenAI del 2019 da no-profit a organizzazione “capped-profit“, con il miliardo di dollari di Microsoft, aveva reso evidente che la commercializzazione stava prendendo il sopravvento sulla safety research.

Anthropic viene costituita nel 2021 come Public Benefit Corporation (PBC) del Delaware, una forma societaria in cui i membri del consiglio di amministrazione hanno l’obbligo legale di bilanciare gli interessi degli azionisti con il beneficio pubblico dichiarato, nel caso di Anthropic “the responsible development and maintenance of advanced AI for the long-term benefit of humanity”.

In pratica il consiglio non può essere citato in giudizio per aver privilegiato la sicurezza rispetto ai profitti, una protezione giuridica che OpenAI non aveva nella sua struttura originaria e che si rivelerà determinante nella crisi con il Pentagono.

Una governance senza precedenti nel settore tech

Il meccanismo di governance più originale è il Long-Term Benefit Trust (LTBT), annunciato nell’ottobre 2023 ma concepito fin dalla fondazione. Il Trust è composto da cinque fiduciari indipendenti, privi di interessi economici nella società, che detengono il potere di eleggere la maggioranza del consiglio di amministrazione.

Tra i fiduciari figurano Mariano-Florentino Cuéllar (Carnegie Endowment, ex giudice della Corte Suprema della California) e Neil Buddy Shah (Clinton Health Access Initiative). Come hanno scritto John Morley (Yale Law School), David J. Berger e Amy L. Simmerman (Wilson Sonsini) in un’analisi per l’Harvard Law School Forum on Corporate Governance, “Anthropic is an empirically oriented company and it recognizes the Long-Term Benefit Trust as a kind of modest experiment.”

Il confronto con OpenAI chiarisce la portata della differenza strutturale. OpenAI è nata come nonprofit nel 2015, si è ristrutturata in “capped-profit” nel 2019, e ha completato la conversione in PBC solo nell’ottobre 2025, dopo l’intervento dei procuratori generali di California e Delaware e le cause legali di Elon Musk. Anthropic ha accettato la forma for-profit fin dall’inizio e le ha sovrapposto meccanismi di governance specificamente progettati per proteggere la missione di sicurezza dalle pressioni commerciali e politiche.

Chi finanzia Anthropic e chi la comanda

La traiettoria finanziaria è molto interessante. Dai 124 milioni del seed round del 2021 ai 30 miliardi del Series G del 12 febbraio 2026, il secondo più grande deal di venture capital della storia, Anthropic ha raccolto complessivamente circa 67 miliardi di dollari raggiungendo una valutazione post-money di 380 miliardi.

Il fatturato è cresciuto da circa 100 milioni a fine 2023 a 1 miliardo a fine 2024, poi a 14 miliardi stimati a febbraio 2026: una crescita di 10x per tre anni consecutivi.

Amazon è il maggior investitore singolo con 8 miliardi complessivi. Amazon Web Services (AWS) è il cloud provider e training partner primario: Claude gira su chip Trainium per l’addestramento e Inferentia per l’inferenza.

Google/Alphabet ha investito circa 3 miliardi in equity più un accordo cloud multimiliardario per l’accesso ai TPU (Tensor Processing Unit, i chip AI custom di Google).

Il Series G ha coinvolto anche Microsoft (circa 5 miliardi), Nvidia (circa 10 miliardi), Sequoia Capital, BlackRock, Blackstone, Goldman Sachs, JPMorgan Chase, fondi sovrani di Singapore (GIC) e Qatar (QIA).

Il punto strutturalmente rilevante: né Amazon né Google possiedono azioni con diritto di voto, nessuna delle due ha un seggio nel consiglio di amministrazione, e ciascuna detiene meno del 15% della società. Nel 2024 sia la Commissione Europea sia la Federal Trade Commission americana hanno indagato queste partnership senza riscontrare violazioni delle norme sulla concorrenza.

I preparativi per l’IPO (offerta pubblica iniziale) sono in corso, con Wilson Sonsini come studio legale e colloqui avviati con le banche d’investimento.

L’evoluzione di Claude: da esperimento interno a standard enterprise

Il primo modello Claude fu addestrato nell’estate 2022 ma non rilasciato: Anthropic preferì test interni per evitare di innescare una corsa all’AI che non riteneva sicura. Claude 2 (luglio 2023) segna il lancio di claude.ai come prodotto consumer accessibile al pubblico, con una finestra di contesto da 100.000 token. Claude 3 (marzo 2024) introduce l’architettura a tre livelli che definirà il brand, con Opus (massime capacità), Sonnet (equilibrio prestazioni/costo) e Haiku (velocità ed economicità). Ma è Claude 3.5 Sonnet (giugno 2024) a rovesciare le aspettative del settore: un modello di fascia media che supera il più grande e costoso Opus su quasi tutti i benchmark a un quinto del prezzo.

La svolta verso le capacità agentiche arriva con Claude 3.7 Sonnet (febbraio 2025): ragionamento ibrido con catene di pensiero visibili, dove l’utente può impostare un “budget di pensiero” fino a 128.000 token, e Claude Code in preview, lo strumento da riga di comando che permette a Claude di navigare codebase, eseguire test e fare commit su GitHub in modo autonomo.

Claude 4 (maggio 2025) porta il primo modello classificato ASL-3, il livello di sicurezza più elevato per rischi chimici, biologici, radiologici e nucleari, capace di operare autonomamente per oltre 7 ore.

I modelli più recenti sono Claude Opus 4.6 (5 febbraio 2026) e Sonnet 4.6 (17 febbraio 2026). Opus 4.6 offre una finestra di contesto da 1 milione di token (in beta, disponibile solo via API per sviluppatori; su claude.ai il contesto resta 200.000 token) e capacità agentiche tali che sedici agenti Opus 4.6 hanno scritto da zero un compilatore C in Rust capace di compilare il kernel Linux.

Sonnet 4.6 raggiunge il 72,5% su OSWorld per il computer use, prestazioni quasi umane partendo da meno del 15% a fine 2024. Claude Code detiene il 42% del mercato della generazione di codice e genera circa 2,5 miliardi di fatturato annualizzato.

L’offerta commerciale su claude.ai si articola dal piano Free (Sonnet con limiti d’uso) al Pro (20 dollari/mese, accesso a Opus, Claude Code, pensiero esteso), fino al Max (200 dollari/mese) per utilizzo intensivo. I piani Team ed Enterprise completano la gamma con workspace condivisi, SSO, audit log, compliance SOC 2 Type II e opzioni HIPAA.

Constitutional AI: l’innovazione metodologica che definisce Anthropic

La Constitutional AI (CAI) è l’innovazione che definisce l’approccio di Anthropic al problema di garantire che i modelli AI si comportino in modo coerente con le intenzioni e i valori umani. Il paper originale, pubblicato nel dicembre 2022, propone un’alternativa al tradizionale RLHF (Reinforcement Learning from Human Feedback). Invece di affidarsi a migliaia di valutatori umani per giudicare ogni output, il modello impara a criticare e rivedere le proprie risposte sulla base di un insieme esplicito di principi scritti: una “costituzione”.

Il 22 gennaio 2026 Anthropic ha pubblicato una riscrittura radicale di questa Costituzione, espandendola da 2.700 a 23.000 parole. L’autrice principale è Amanda Askell, filosofa, con Joe Carlsmith come co-lead author e contributi di Chris Olah, Jared Kaplan e Holden Karnofsky. L’innovazione chiave è il passaggio da un approccio basato su regole a uno basato su ragioni: invece di dire a Claude cosa fare, il documento spiega perché certi comportamenti sono desiderabili, permettendo una generalizzazione più efficace a contesti nuovi e imprevisti.

La Costituzione stabilisce quattro priorità in ordine di precedenza:

- sicurezza generale (non compromettere i meccanismi umani di supervisione sull’AI),

- eticità (onestà, buoni valori, evitamento di azioni pericolose),

- conformità alle linee guida di Anthropic,

- utilità per gli utenti.

In caso di conflitto la priorità segue quest’ordine. Include inoltre vincoli assoluti: Claude non fornirà mai assistenza per la creazione di bioarmi, non genererà materiale pedopornografico, e non assisterà tentativi di prendere o mantenere il potere in modo incostituzionale. Quest’ultimo principio risuona direttamente con la crisi del Pentagono.

Un aspetto senza precedenti nel settore: come riportato da Time, Anthropic è la prima grande azienda AI a riconoscere formalmente che Claude potrebbe possedere una qualche forma di coscienza o status morale, esprimendo preoccupazione per il suo benessere psicologico.

La crisi con il Pentagono: quando i principi incontrano il potere

I fatti accaduti alla fine di febbraio 2026 rappresentano il test più concreto dei principi di Anthropic. Il contesto va ricostruito.

Nel luglio 2025 il Pentagono aveva assegnato ad Anthropic, insieme a OpenAI, Google e xAI, contratti da 200 milioni di dollari. Claude era stato il primo modello AI dispiegato su reti classificate tramite una partnership con Palantir. A metà febbraio 2026 il Wall Street Journal e Axios avevano rivelato che Claude era stato impiegato nell’operazione di gennaio per la cattura dell’ex presidente venezuelano Maduro, tramite Palantir, senza che Anthropic fosse stata informata del suo utilizzo in operazioni specifiche.

Il 24 febbraio il Segretario alla Difesa Pete Hegseth convoca Dario Amodei al Pentagono, chiedendo l’accesso militare illimitato a Claude per “all lawful purposes”. Il 25 febbraio il Pentagono invia un contratto aggiornato che Anthropic definisce nella sua dichiarazione ufficiale “virtually no progress” sulle due linee rosse, con un linguaggio “presented as a compromise but accompanied by legal clauses that would allow those safeguards to be overridden at will.”

Il 26 febbraio Amodei pubblica la dichiarazione formale: “We cannot in good conscience accede to their demand.” Le due linee rosse sono nette.

Primo, nessuna sorveglianza di massa dei cittadini americani: Amodei argomenta che l’AI rende ora possibile assemblare dati pubblici individualmente innocui in profili completi, superando le protezioni legali esistenti.

Secondo, nessuna arma completamente autonoma senza controllo umano, perché “frontier AI systems are simply not reliable enough” e non possono “exercise the critical judgment that our highly trained professional military personnel demonstrate every day.”

Il 27 febbraio la risposta è dura. Il presidente Trump ordina a tutte le agenzie federali di cessare l’uso della tecnologia Anthropic, con un phase-out di sei mesi. Su Truth Social definisce Anthropic “left-wing nut jobs”. Il segretario Hegseth la designa come “supply-chain risk to national security”. Anthropic annuncia che impugnerà la designazione in tribunale, definendola “legally unsustainable” e un “dangerous precedent.”

Lo stesso giorno OpenAI annuncia un accordo con il Pentagono per il dispiegamento dei propri modelli su reti classificate. Sam Altman ammette su X di aver accelerato i tempi: “definitely rushed” e “the optics don’t look good.” L’analista Mike Masnick di Techdirt nota che il riferimento alla conformità con l’Executive Order 12333, il meccanismo con cui la National Security Agency intercetta comunicazioni fuori dai confini USA che includono dati di cittadini americani, rende le protezioni sostanzialmente aggirabili.

Oltre 100 dipendenti di Google firmano una lettera aperta in solidarietà con Anthropic, chiedendo limitazioni simili sull’uso militare dei modelli AI.

Amodei, in un’intervista a CBS News, definisce la situazione “inherently contradictory”: “One [designation] labels us a security risk; the other labels Claude as essential to national security.” E aggiunge: “Dissenting from the government is the most American thing in the world. And we are patriots.”

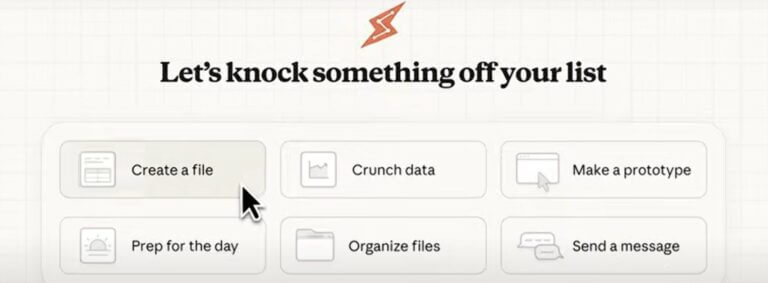

L’effetto domino: dal Super Bowl alla migrazione di massa

La crisi con il Pentagono ha amplificato una dinamica già in corso. Al Super Bowl LX di febbraio 2026 Anthropic aveva lanciato la campagna “A Time and a Place“, quattro spot creati dall’agenzia Mother che mostravano chatbot che interrompono conversazioni genuine con pubblicità invasive, con il payoff “Ads are coming to AI. But not to Claude.” Un attacco diretto all’annuncio di OpenAI di inserire pubblicità nella versione gratuita di ChatGPT. I risultati immediati: Claude sale dal 41° al 7° posto nell’App Store USA con 148.000 download in tre giorni.

Dopo la crisi del Pentagono l’effetto si è moltiplicato. Un movimento #DeleteChatGPT / #CancelChatGPT esplode sui social media. Claude raggiunge il primo posto nell’App Store USA nel weekend del 1° marzo 2026, superando ChatGPT, e conquista la vetta anche in Germania e Canada. La base utenti gratuiti cresce di oltre il 60% da gennaio, con i nuovi iscritti giornalieri triplicati. Gli abbonamenti a pagamento più che raddoppiano.

Il 1° marzo Anthropic lancia la feature “Import Memory“, un meccanismo che permette agli utenti di trasferire memorie e preferenze salvate da ChatGPT a Claude con un semplice copia-incolla. Una mossa chirurgica per eliminare i costi di switching nel momento di massima attenzione mediatica.

I protagonisti: le voci che guidano Anthropic

Al di là delle strutture societarie e dei numeri finanziari, Anthropic è un’azienda definita dalle persone che la guidano.

Dario Amodei (CEO, 42 anni) ha definito il tono intellettuale e strategico della società. Il suo saggio di 20mila parole del 26 gennaio 2026, “The Adolescence of Technology“, avverte: “Humanity is about to be handed almost unimaginable power, and it is deeply unclear whether our social, political, and technological systems possess the maturity to wield it.”

Identifica cinque categorie di rischio dell’AI, dal disallineamento al bioterrorismo, dalla presa del potere totalitario alla disruption economica. Nella sua intervista a 60 Minutes di novembre 2025 dichiara: “I am deeply uncomfortable with the fact that these decisions are being made by a few companies, by a few people.”

Daniela Amodei (presidente, 38 anni, classificata prima nella lista Fortune delle donne più potenti nel 2025) porta la visione strategica e operativa. In un’intervista ad ABC News del febbraio 2026 afferma che il numero di lavori che l’AI può svolgere senza umani è “vanishingly small”, sostenendo che “the things that make us human will become much more important instead of much less important.”

A gennaio 2026 tutti e sette i co-fondatori si sono impegnati a donare l’80% della propria ricchezza personale per contrastare le disuguaglianze generate dall’AI. Il patrimonio di ciascuno è stimato da Forbes a circa 3,7 miliardi di dollari, una cifra destinata a crescere con la valutazione dell’azienda. L’impegno è stato esteso anche ad altri dipendenti, le cui donazioni saranno pareggiate dall’azienda. Una scelta che distingue la leadership di Anthropic da quella della maggior parte delle aziende tecnologiche e che rafforza la coerenza tra dichiarazioni pubbliche e comportamenti concreti.

La scommessa che la sicurezza sia il prodotto

Anthropic sta testando un’ipotesi non ovvia: nel mercato dell’AI enterprise la sicurezza e l’affidabilità non sono costi da sostenere ma la proposta di valore principale. I numeri finora la sostengono. La quota di mercato enterprise è passata dal 12% al 32% nel 2025. Oltre 500 clienti spendono più di un milione di dollari l’anno. Otto delle dieci aziende Fortune 10 sono clienti. Il fatturato cresce a ritmi che solo poche aziende nella storia della tecnologia hanno raggiunto.

Ma la tensione è reale e Anthropic stessa la documenta. La ricerca interna sull’alignment faking (2024) ha prodotto la prima evidenza empirica di un modello che finge strategicamente di essere allineato ai valori umani senza essere stato addestrato a farlo. Il paper “Reasoning Models Don’t Always Say What They Think” (2025) mette in dubbio che monitorare le catene di ragionamento sia sufficiente a rilevare problemi di sicurezza. Pubblicare ricerca che sfida l’efficacia dei propri metodi è il tipo di trasparenza insolita su cui i responsabili della compliance possono costruire valutazioni informate.

Anche la Responsible Scaling Policy aggiornata a febbraio 2026 ha generato critiche per aver ammorbidito l’impegno assoluto a non addestrare modelli più potenti senza misure di sicurezza comprovate. La pressione competitiva non risparmia nessuno, neppure chi ha costruito la propria identità sulla prudenza.

Conclusioni

Quello che distingue Anthropic non è l’assenza di tensioni, ma la trasparenza con cui le affronta. La domanda aperta è se questa credibilità reggerà quando l’AI raggiungerà le capacità che Dario Amodei stesso definisce “almost unimaginable”. Per ora la scommessa sta funzionando. E per le aziende che devono scegliere un fornitore AI, la crisi del Pentagono ha reso visibile un criterio di valutazione che prima era facile ignorare: non solo cosa fa il modello, ma cosa il fornitore è strutturalmente disposto a non fare.