Il centro di gravità dell’intelligenza artificiale si sta spostando dal training all’inference, cioè dall’addestrare modelli enormi al farli lavorare in modo continuo, rapido e redditizio per utenti e imprese.

Un po’ lo si era capito da qualche mese, sì, ma ora si vedranno le conseguenze. Sul mercato e i suoi attori principali. C’è tutta una filiera che cresce ed evolve attorno a questo nuovo baricentro.

E’ forse questo il passaggio chiave emerso a San Jose, nelle prime giornate della conferenza Nvidia Gtc 2026 del 16-19 marzo.

Jensen Huang, il capo di Nvidia, ha legato questo cambio di fase alla crescita degli agenti software, che consumano calcolo in modo molto più costante e distribuito rispetto ai grandi cicli di training.

Alcuni dati.

Nvidia, nelle sue comunicazioni ufficiali, ha presentato la piattaforma Vera Rubin come infrastruttura per “agentic AI” ed ha alzato ad almeno 1.000 miliardi di dollari entro il 2027 la stima dell’opportunità di ricavi per i chip Blackwell e Rubin.

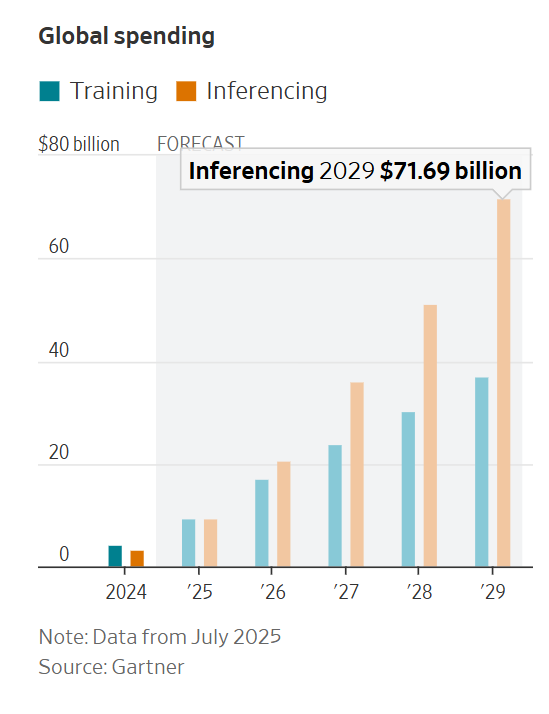

La spesa per infrastruttura di inference secondo Gartner supererà quella per il training nel 2026 e nel 2029 la doppierà.

Indice degli argomenti:

Non conta più solo chi ha il modello migliore: ecco l’era dell’inferenza

Significa una maturazione per l’intero ecosistema.

Per due anni la gara è sembrata semplice: vinceva chi addestrava il modello più potente e comprava più GPU.

Gtc 2026 racconta un’altra gerarchia. Adesso contano almeno quattro livelli insieme: chip, memoria e rete; software che orchestra l’inference; cloud e data center; applicazioni che trasformano i token in ricavi.

Dynamo 1.0

Nvidia ha cercato di presidiare tutti e quattro i piani con nuovi chip, CPU dedicate (che sono più utili per inference che per training), rack completi, networking, storage e reference design per “AI factory”. In questo quadro, il tassello che mancava nel pezzo originale è il software: Nvidia ha presentato Dynamo 1.0 come software open source per inference generativa e agentica su larga scala, e lo descrive apertamente come il sistema operativo distribuito delle AI factory. Nelle note ufficiali sostiene anche che, insieme alle ottimizzazioni TensorRT-LLM, Dynamo può aumentare fino a 7 volte le prestazioni di inference su Blackwell, riducendo il costo per token.

Adesso quindi conta la capacità di trasformare il calcolo in un servizio industriale continuo, con latenza bassa, costi prevedibili, memoria disponibile, rete efficiente e software capace di coordinare tutto il sistema.

Nvidia non si presenta più solo come un produttore di semiconduttori: prova a essere il layer che tiene insieme la produzione stessa dei token. L’idea è confermata sia dal linguaggio usato sul palco, sia dal fatto che l’azienda ha messo al centro AI factory, orchestrazione e sistemi completi, non solo singoli acceleratori.

Nvidia resta il baricentro, ma cambia terreno. Vera Cpu

Il punto più interessante è che Nvidia non difende più il suo vantaggio soltanto con le GPU classiche. A Gtc ha spinto la piattaforma Vera Rubin, ha presentato Vera CPU come processore costruito per carichi agentici e di reinforcement learning, e ha mostrato una coppia Rubin-Groq pensata esplicitamente per l’inference disaggregata: Rubin nella fase di prefill, Groq nella fase di decode.

Reuters ha raccontato questa architettura come il cuore della nuova offensiva di Nvidia nell’inference; l’azienda, da parte sua, descrive Vera CPU come il primo processore progettato per l’età dell’agentic AI.

Questa parte andava rafforzata anche con una precisazione utile: la stima da oltre 1.000 miliardi di dollari entro il 2027 riguarda Blackwell e Rubin, ma non include CPU, networking, Groq, Rubin Ultra né le vendite H200 alla Cina.

È un dettaglio importante, perché mostra due cose insieme: da un lato quanto il nucleo del business resti gigantesco; dall’altro quanto Nvidia stia cercando di allargare il perimetro oltre il numero simbolico che ha comunicato al mercato.

La fragilità di Nvidia

Qui c’è anche il lato più fragile della sua posizione. Se il mercato si misura sempre di più sul costo unitario dell’inference, i margini eccezionali costruiti nell’era del training potrebbero essere più difficili da difendere. Non è affatto detto che Nvidia perda la leadership, ma il terreno competitivo è meno favorevole a un solo fornitore dominante.

Notevole inoltre la pressione di storici attori delle cpu (Amd, Intel); ci sono anche nuovi attori come Cerebras e hyperscaler come Amazon, Google che fanno chip proprietari custom.

La partita si sta spostando verso architetture miste e criteri di prezzo-prestazione più severi.

Il software conta ormai quanto il silicio nell’era dell’inferenza

C’è un punto che il Gtc 2026 rende molto più chiaro di quanto non apparisse fino a pochi mesi fa: l’inference non è una categoria “più leggera” del training, ma una nuova forma di complessità. Significa orchestrare memoria, cache, rete, modelli, strumenti e agenti in tempo reale.

Ecco perché Nvidia insiste su software come Dynamo, su runtime come OpenShell e su toolkit che permettono di costruire agenti con guardrail di sicurezza e privacy. La tesi industriale non è solo “servono più chip”, ma “serve un sistema che sappia usare bene il calcolo minuto per minuto”.

Il software di orchestrazione è ciò che rende credibile la formula “sistema operativo industriale dell’AI”.

Senza quello, l’AI factory resta una metafora. Con quello, diventa una catena produttiva in cui throughput, utilizzo delle risorse, costo per token e tempo al primo ricavo entrano nella stessa equazione. È anche per questo che Nvidia ha accompagnato Rubin con il reference design DSX, con blueprint per digital twin delle AI factory e con librerie che collegano compute, raffreddamento, energia, rete e operations.

I nuovi vincitori potrebbero essere i fornitori di efficienza

Se il 2024 e il 2025 sono stati gli anni della scarsità di GPU, il 2026 può diventare l’anno del costo per risposta utile. Questo favorisce attori che fino a poco fa sembravano comprimari.

C’è la nuova architettura Nvidia-Groq per l’inference; rileva anche l’accordo tra AWS e Cerebras per combinare Trainium3 e i chip wafer-scale di Cerebras in un servizio cloud dedicato proprio all’inference, dividendo il lavoro tra prefill e decode in modo simile alla strategia mostrata da Nvidia.

Non è più un’eccezione: è il segno che l’inference sta premiando specializzazione, modularità e valore economico per token.

Anche i produttori di memoria, storage e interconnessione escono rafforzati. Micron ha annunciato l’avvio delle spedizioni in volume della sua HBM4 36GB 12H progettata per Vera Rubin, con banda superiore a 2,8 TB/s e oltre il 20% di efficienza energetica in più rispetto a HBM3E. Nello stesso annuncio ha collegato direttamente memoria, SSD PCIe Gen6 e moduli SOCAMM2 al funzionamento della piattaforma Rubin.

Nell’inference avanzata, soprattutto con agenti e contesti lunghi, la memoria è un collo di bottiglia strategico tanto quanto il processore.

La stessa Nvidia ha reso esplicito questo punto nella presentazione di Vera Rubin. La piattaforma comprende non solo GPU e CPU, ma anche BlueField-4 STX per lo storage AI-native e Spectrum-6 SPX Ethernet per il traffico est-ovest tra rack. Secondo le note ufficiali, BlueField-4 STX è pensato per gestire il key-value cache dei grandi modelli e dei workflow agentici, e può aumentare il throughput di inference fino a 5 volte rispetto ad architetture storage general purpose; Spectrum-6, con fotonica integrata, punta invece a ridurre latenza, consumi e colli di bottiglia di rete.

In altre parole: il vantaggio competitivo non è più il chip isolato, ma l’integrazione di compute, memoria, storage e interconnessione.

Gli hyperscaler tornano arbitri

C’è un altro messaggio politico-industriale nel Gtc 2026: cresce il potere negoziale dei grandi clienti di gpu ovvero hyperscaler fornitori di AI in cloud.

Alphabet, Amazon, Meta e Microsoft investiranno circa 650 miliardi di dollari in infrastruttura AI nel 2026, in forte aumento rispetto ai 410 miliardi del 2025. Quando la domanda diventa così grande e così strutturale, gli hyperscaler non sono più semplici acquirenti di capacità: diventano architetti del mercato, perché possono combinare chip proprietari, componenti di terzi e software di orchestrazione per difendere margini e differenziarsi.

Questo si vede già nei fatti. AWS ha annunciato l’integrazione di Cerebras nei suoi data center insieme a Trainium3, mentre Nvidia ha indicato tra i collaboratori per Vera CPU nomi come Meta, Oracle Cloud Infrastructure, CoreWeave, Lambda e Nebius. Il punto non è che Nvidia esca di scena; il punto è che il suo potere di prezzo dipende sempre più dalla capacità di convivere con stack misti, dove il cliente finale decide quali componenti ottimizzano meglio costo, velocità e disponibilità. Il monopolio tecnico non è finito, ma assomiglia meno a un monopolio chiuso.

Nvidia al tempo stesso cerca di affrancarsi dagli hyperscaler. Ha stretto accordi nell’automotive con Mercedes-Benz e nel farmaceutico con Eli Lilly integrando le sue infrastrutture e modelli nei loro sistemi.

A questo si aggiunge la dimensione distribuita dell’inference. Nvidia e i partner telco hanno presentato le AI grids come infrastrutture geograficamente diffuse, capaci di portare inference più vicino a utenti, reti e dispositivi.

Nel blog ufficiale, Nvidia scrive che telco e cloud distribuiti operano circa 100.000 data center di rete nel mondo, con abbastanza potenza inutilizzata da offrire oltre 100 gigawatt di nuova capacità AI nel tempo.

Così l’infrastruttura non si allarga solo verso mega cluster più grandi; si diffonde anche verso il bordo della rete.

Modelli OpenAI, Anthropic e gli altri: da laboratori a utility

Sul lato dei modelli, la novità implicita del Gtc è che OpenAI, Anthropic e gli altri leader non sono più valutati solo per la qualità del modello. Pesano almeno altre due variabili: la capacità di far lavorare agenti in modo affidabile e la struttura dei costi per servire volumi crescenti di token.

L’enfasi di Huang sull’inference va collegata alla necessità di sostenere servizi AI per centinaia di milioni di utenti. È qui che la partita si sposta dal modello al servizio: non basta essere i migliori in laboratorio, bisogna erogare un prodotto continuo a costi sostenibili.

Ci sono già segnali concreti di questo spostamento. A gennaio OpenAI ha firmato un accordo da oltre 10 miliardi di dollari con Cerebras per capacità di calcolo orientata all’inference, fino a 750 megawatt in tre anni. Il senso del deal non è simbolico: mostra che anche il campione software per eccellenza sta diversificando il mix di compute per far rispondere i suoi sistemi più velocemente e in modo più efficiente. È esattamente il tipo di pressione economica che il tuo pezzo individuava, ma che ora va resa più esplicita.

Questo cambia anche la posizione dei campioni del software. OpenAI e Anthropic restano centrali perché controllano interfacce, modelli e domanda. Ma sono più esposti di prima alla struttura dei costi dell’inference e ai rapporti con i fornitori di calcolo. Se i margini si spostano dal modello al servizio, la partita si gioca tra chi monetizza meglio gli agenti e chi abbassa il costo per token mantenendo qualità, affidabilità e disponibilità.

In questo quadro, gli hyperscaler e i nuovi specialisti dell’inference diventano più importanti, non meno.

Modelli opensource

C’è poi un altro fronte su cui Nvidia prova a spostare gli equilibri: quello dei modelli aperti. Jensen Huang ha annunciato la Nemotron Coalition, un’alleanza che riunisce sviluppatori e laboratori come Mistral, Perplexity, LangChain, Cursor, Black Forest Labs, Sarvam e Thinking Machines Lab per costruire modelli di frontiera condividendo dati, competenze e capacità di calcolo.

Il primo risultato atteso dovrebbe sostenere la futura famiglia Nemotron 4.

Nvidia ha già rilasciato diverse famiglie di modelli di IA open source. Si tratta di modelli specializzati e destinati a settori specifici, tra cui Alpamayo per le auto a guida autonoma, GR00T per la robotica e BioNeMo per la ricerca biomedica. Questi modelli occupano spesso le prime posizioni nelle classifiche dell’IA open source. Nvidia intende investire miliardi per espandere le proprie capacità in questo livello dello stack.

Se l’AI entra nella fase dell’inference di massa, cresce la domanda di modelli più piccoli, personalizzabili e meno costosi rispetto ai grandi sistemi chiusi di OpenAI e Anthropic.

Per Nvidia è una mossa doppiamente utile: da un lato favorisce trasparenza, sovranità e adattabilità per le imprese; dall’altro allarga il mercato delle applicazioni che girano sulla sua infrastruttura. Non significa che i modelli proprietari perdano centralità, ma che l’equilibrio tra chiuso e aperto diventa più importante proprio mentre le aziende chiedono strumenti più controllabili, specializzati e sostenibili nei cost

L’agente conta più del chatbot. Nemoclaw

Al Gtc Nvidia ha presentato anche NemoClaw per la comunità OpenClaw e, più in generale, un Agent Toolkit che aggiunge runtime, guardrail e infrastruttura di sicurezza per agenti autonomi.

Nelle note ufficiali, NemoClaw è descritto come uno stack che installa in un solo comando modelli Nemotron e OpenShell, con controlli di privacy e sicurezza, e che può girare dal cloud all’on-premise fino ai PC RTX e ai sistemi DGX. Questo non prova che gli agenti siano già un business maturo su larga scala, ma mostra che l’industria sta spostando l’attenzione dal chatbot come interfaccia al sistema che esegue compiti e usa strumenti in autonomia controllata.

Anche qui conviene distinguere i fatti dalle promesse. Il fatto è che tutto il settore sta investendo per rendere gli agenti più operativi, più locali, più sicuri e più persistenti. La promessa è che tutto questo si traduca presto in produttività affidabile e margini robusti settore per settore.

Il Gtc 2026 mostra molto chiaramente la direzione industriale; dimostra meno, almeno per ora, l’uniformità dei risultati economici. Le stesse note Nvidia sono piene di annunci, partnership e roadmap, e vanno lette come indicazioni di traiettoria più che come prova definitiva di adozione generalizzata.

Dall’agente software all’AI fisica

Se il Gtc 2026 dice “uso industriale”, non parla solo di software da ufficio e servizi cloud. Parla anche di physical AI: robotica, visione artificiale, veicoli autonomi, digital twin e manifattura. Nvidia ha annunciato una Physical AI Data Factory Blueprint come architettura aperta per generare, aumentare e valutare dati di training per robot, vision AI agents e auto autonome, con l’obiettivo dichiarato di ridurre tempi, costi e complessità dello sviluppo.

Tra i partner e gli early user citati compaiono Microsoft Azure, Nebius, Uber, Skild AI, Teradyne Robotics e altri.

La stessa giornata di annunci ha mostrato quanto questa ambizione sia ampia. Nvidia ha comunicato collaborazioni con Cadence, Dassault Systèmes, Siemens e Synopsys per agenti che pianificano, ottimizzano e verificano workflow complessi di progettazione, e ha indicato FANUC, HD Hyundai, Honda, JLR, KION, Mercedes-Benz, PepsiCo, Samsung, SK hynix e TSMC tra le aziende che stanno usando CUDA-X, Omniverse e software industriale accelerato per design, engineering e manufacturing.

In questa parte del Gtc si vede meglio che altrove il passaggio dall’AI come “modello” all’AI come infrastruttura produttiva.

Conta anche la geopolitica

C’è poi il nodo geopolitico.

Nvidia ha ottenuto da Pechino il via libera per vendere H200 in Cina e sta preparando anche una variante dei chip Groq compatibile con quel mercato. Il dato va letto insieme al Gtc: se l’inference diventa la nuova frontiera, la capacità di servire mercati separati da export control, licenze e vincoli nazionali diventa ancora più importante. Non basta avere il chip migliore; serve una gamma di prodotti compatibili con regimi politici e normativi differenti.

Questo è un punto strategico perché l’inference tende a essere più diffusa, più vicina agli utenti e più intrecciata con servizi continui rispetto ai cicli di training concentrati in pochi cluster. In un mercato così, la frammentazione geopolitica pesa ancora di più: determina cosa si può vendere, dove lo si può vendere, con quali componenti e dentro quali stack.

Per Nvidia, quindi, la sfida non è solo tecnologica o commerciale. È anche diplomatica e regolatoria.

Che cosa ci dice davvero il Gtc 2026

La risposta più solida è questa: il futuro dell’intelligenza artificiale assomiglierà meno a una corsa lineare verso modelli sempre più grandi e più a una filiera industriale fatta di agenti, inferenza continua, infrastrutture ibride, energia, storage, rete e costi sotto pressione. Nvidia resta il regista più forte, ma deve difendere il primato in un mercato che premia efficienza e integrazione più della potenza pura. I nuovi attori decisivi non sono soltanto i laboratori che addestrano modelli, ma anche chi costruisce memoria, interconnessioni, CPU, sistemi edge, cloud e software per orchestrare agenti e AI factory.

Il valore tenderà a distribuirsi lungo tutta la catena. Nel 2023 bastava quasi chiedersi chi vendesse le GPU. Nel 2026 bisogna chiedersi chi controlla il costo, la latenza, la distribuzione, l’energia, la sicurezza e la capacità di far lavorare l’AI dopo l’addestramento.

È la nuova economia dell’AI che prende forma.