Google accelera sulla costruzione dell’infrastruttura per l’intelligenza artificiale e presenta l’ottava generazione delle proprie Tensor Processing Unit (TPU). L’annuncio arriva durante l’evento Google Cloud Next ‘26, con due nuove architetture distinte:

- TPU 8t, progettata per l’addestramento dei modelli,

- TPU 8i, pensata per l’inferenza.

Si tratta del risultato di oltre dieci anni di sviluppo. L’obiettivo è sostenere una nuova fase dell’intelligenza artificiale, caratterizzata da agenti autonomi in grado di eseguire compiti complessi, ragionare e apprendere in modo continuo.

Indice degli argomenti:

Una risposta alla crescita dell’intelligenza artificiale

Negli ultimi anni i modelli AI hanno richiesto sempre più potenza di calcolo. L’evoluzione verso sistemi agentici – capaci di pianificare, eseguire azioni e migliorarsi nel tempo – ha introdotto nuovi requisiti infrastrutturali.

Secondo Google, i modelli di nuova generazione non si limitano più a rispondere a richieste, ma gestiscono flussi di lavoro articolati e iterativi. Questo implica un aumento della domanda sia in fase di addestramento sia in fase di utilizzo operativo.

Le TPU di ottava generazione nascono per rispondere a questa doppia esigenza, separando le funzioni tra due chip specializzati.

Due architetture per funzioni diverse

Google ha scelto di sviluppare due processori distinti invece di una soluzione unica.

TPU 8t è ottimizzata per l’addestramento dei modelli su larga scala, dove serve massima capacità di calcolo.

TPU 8i, invece, è progettata per l’inferenza, cioè per l’utilizzo dei modelli in tempo reale, con particolare attenzione alla latenza e alla gestione delle richieste.

Questa divisione riflette un cambiamento nella domanda del mercato. Negli ultimi anni, con il passaggio dalla sperimentazione alla produzione, le aziende hanno aumentato l’utilizzo dell’inferenza su larga scala.

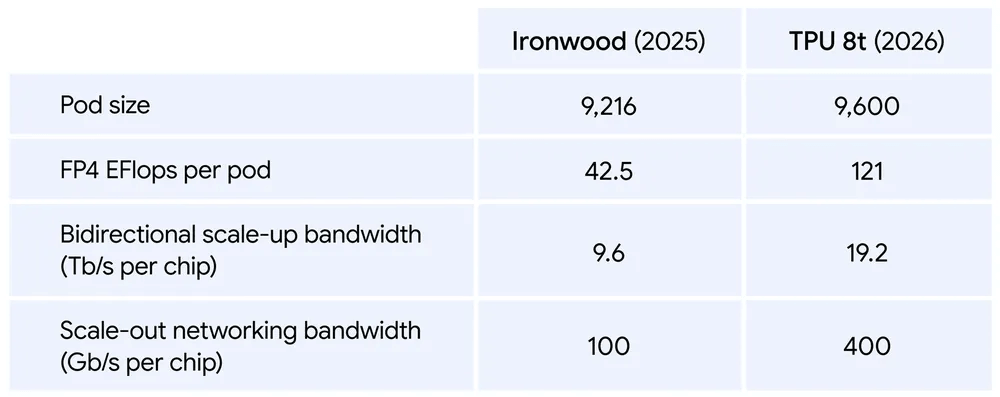

TPU 8t: accelerare lo sviluppo dei modelli

TPU 8t punta a ridurre i tempi di sviluppo dei modelli più avanzati, passando da mesi a settimane.

Il sistema offre prestazioni di calcolo quasi triplicate rispetto alla generazione precedente. Ogni “superpod” può arrivare fino a 9.600 chip e due petabyte di memoria condivisa ad alta velocità.

La capacità complessiva raggiunge 121 ExaFlops, un livello che consente di addestrare modelli estremamente complessi utilizzando un’unica infrastruttura integrata.

Un elemento centrale è l’ottimizzazione dell’utilizzo delle risorse. L’accesso allo storage è stato accelerato fino a dieci volte, mentre il sistema TPUDirect consente di trasferire dati direttamente al processore, riducendo i tempi morti.

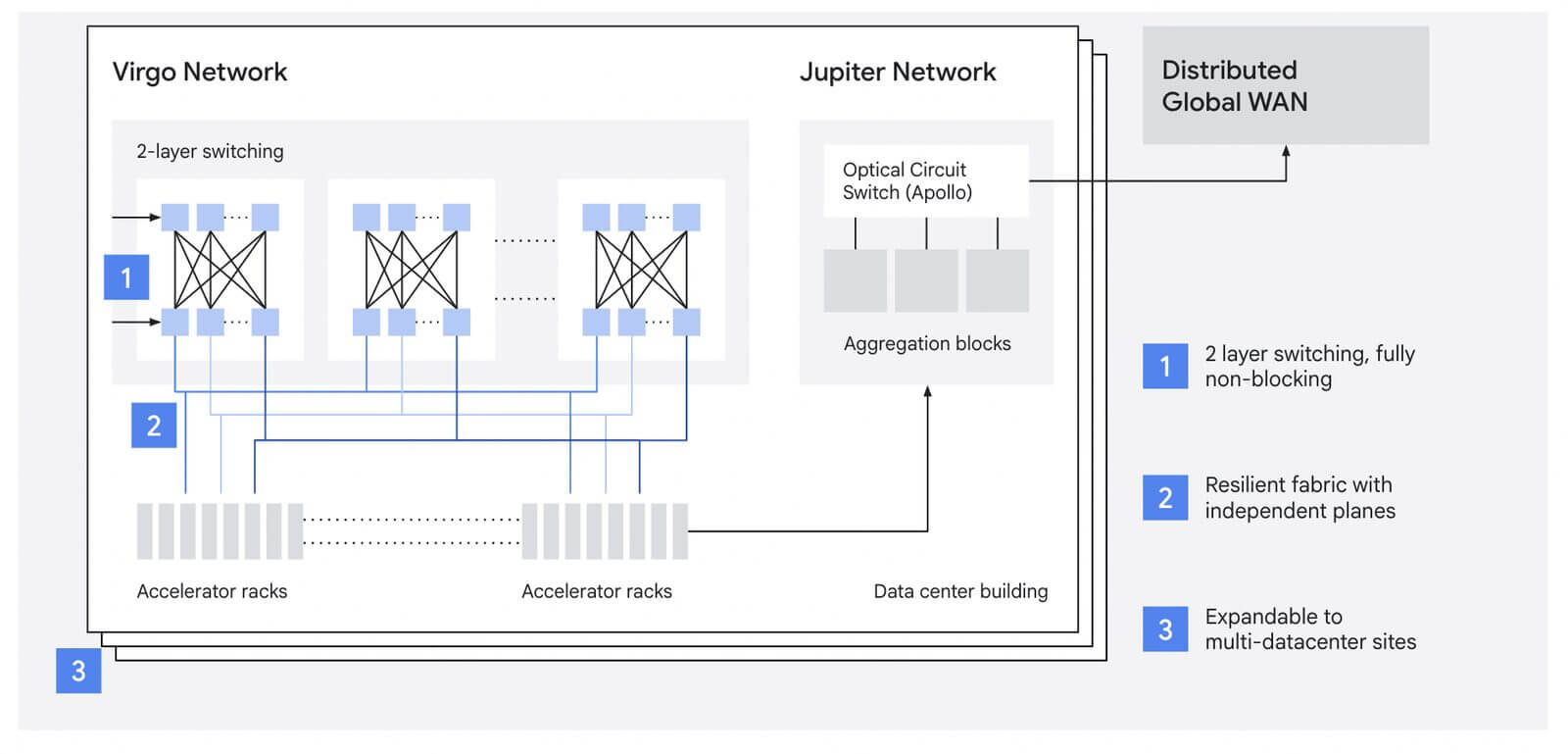

Google introduce anche una nuova rete, chiamata Virgo Network, che permette una scalabilità quasi lineare fino a un milione di chip in un unico cluster logico.

Affidabilità e continuità operativa

Nel supercomputing, anche piccole interruzioni possono incidere sui tempi di addestramento.

Per questo TPU 8t è progettata per raggiungere oltre il 97% di “goodput”, cioè tempo effettivamente dedicato al calcolo utile. Il sistema integra funzionalità avanzate di monitoraggio e gestione automatica dei guasti.

Tra queste, la telemetria in tempo reale su decine di migliaia di chip, la capacità di aggirare automaticamente connessioni difettose e sistemi di riconfigurazione hardware senza intervento umano.

Ogni miglioramento percentuale, su scala, può tradursi in giorni di addestramento risparmiati.

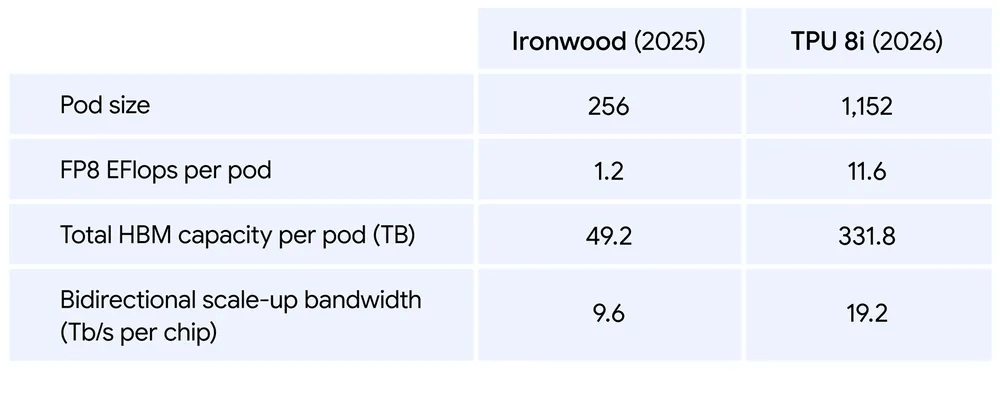

TPU 8i: inferenza e agenti intelligenti

Se TPU 8t è pensata per costruire modelli, TPU 8i è progettata per utilizzarli.

L’obiettivo è gestire sistemi composti da molti agenti AI che operano in parallelo, collaborando tra loro per risolvere problemi complessi. In questi scenari, anche piccoli ritardi possono amplificarsi.

Per questo Google ha ridisegnato l’architettura per ridurre la latenza e migliorare l’efficienza.

Superare il limite della memoria

Uno dei principali colli di bottiglia nei sistemi AI è la cosiddetta “memory wall”, cioè la difficoltà di alimentare il processore con dati alla velocità necessaria.

TPU 8i affronta questo problema combinando 288 GB di memoria ad alta banda con 384 MB di memoria SRAM integrata nel chip, tre volte superiore alla generazione precedente.

Questo consente di mantenere i dati più utilizzati direttamente sul chip, riducendo i tempi di accesso.

Nuovi processori e architetture di rete

Google ha introdotto anche CPU proprietarie basate su architettura Arm, chiamate Axion. Il numero di host per server è stato raddoppiato, migliorando la gestione complessiva del sistema.

Per i modelli Mixture of Experts (MoE), sempre più diffusi, la banda di interconnessione è stata portata a 19,2 terabit al secondo.

La nuova topologia di rete, denominata Boardfly, riduce di oltre il 50% la distanza massima tra i nodi, migliorando la velocità di comunicazione.

Ridurre la latenza nelle operazioni

Un’altra innovazione riguarda la gestione delle operazioni collettive tra chip.

TPU 8i integra un motore dedicato, chiamato Collectives Acceleration Engine, che alleggerisce il carico del processore principale e riduce la latenza fino a cinque volte.

Il risultato è un miglioramento dell’80% nel rapporto tra prestazioni e costo rispetto alla generazione precedente.

Secondo Google, questo permette di servire quasi il doppio degli utenti a parità di spesa.

Co-progettazione con i modelli AI

Le nuove TPU sono state sviluppate in parallelo con i modelli di intelligenza artificiale, in particolare con quelli di Google DeepMind.

Alcune scelte progettuali riflettono esigenze specifiche dei modelli più avanzati. La capacità della memoria SRAM, ad esempio, è calibrata per gestire le cache dei modelli di ragionamento.

Allo stesso modo, la rete Virgo è dimensionata in base ai requisiti di parallelismo dei modelli con trilioni di parametri.

Per la prima volta, l’intero sistema – dal processore alla CPU host – è progettato internamente, consentendo un controllo più preciso sulle prestazioni.

Compatibilità e apertura agli sviluppatori

Google punta anche sull’adozione da parte della comunità di sviluppatori.

Le nuove TPU supportano framework diffusi come JAX, PyTorch e altri strumenti utilizzati per l’addestramento e l’inferenza.

È previsto anche l’accesso diretto all’hardware (bare metal), senza livelli di virtualizzazione, per ridurre overhead e migliorare le prestazioni.

Tra i progetti open source, Google cita MaxText e Tunix, pensati per facilitare il passaggio dalla ricerca alla produzione.

Il nodo dell’energia nei data center

Uno dei vincoli principali per l’espansione dell’intelligenza artificiale è il consumo energetico.

Secondo Google, oggi nei data center il limite non è solo la disponibilità di chip, ma anche la capacità di alimentazione elettrica.

Le TPU 8t e 8i sono progettate per migliorare l’efficienza energetica fino al doppio rispetto alla generazione precedente.

Questo risultato è ottenuto attraverso una gestione dinamica dell’energia e una progettazione integrata di hardware e software.

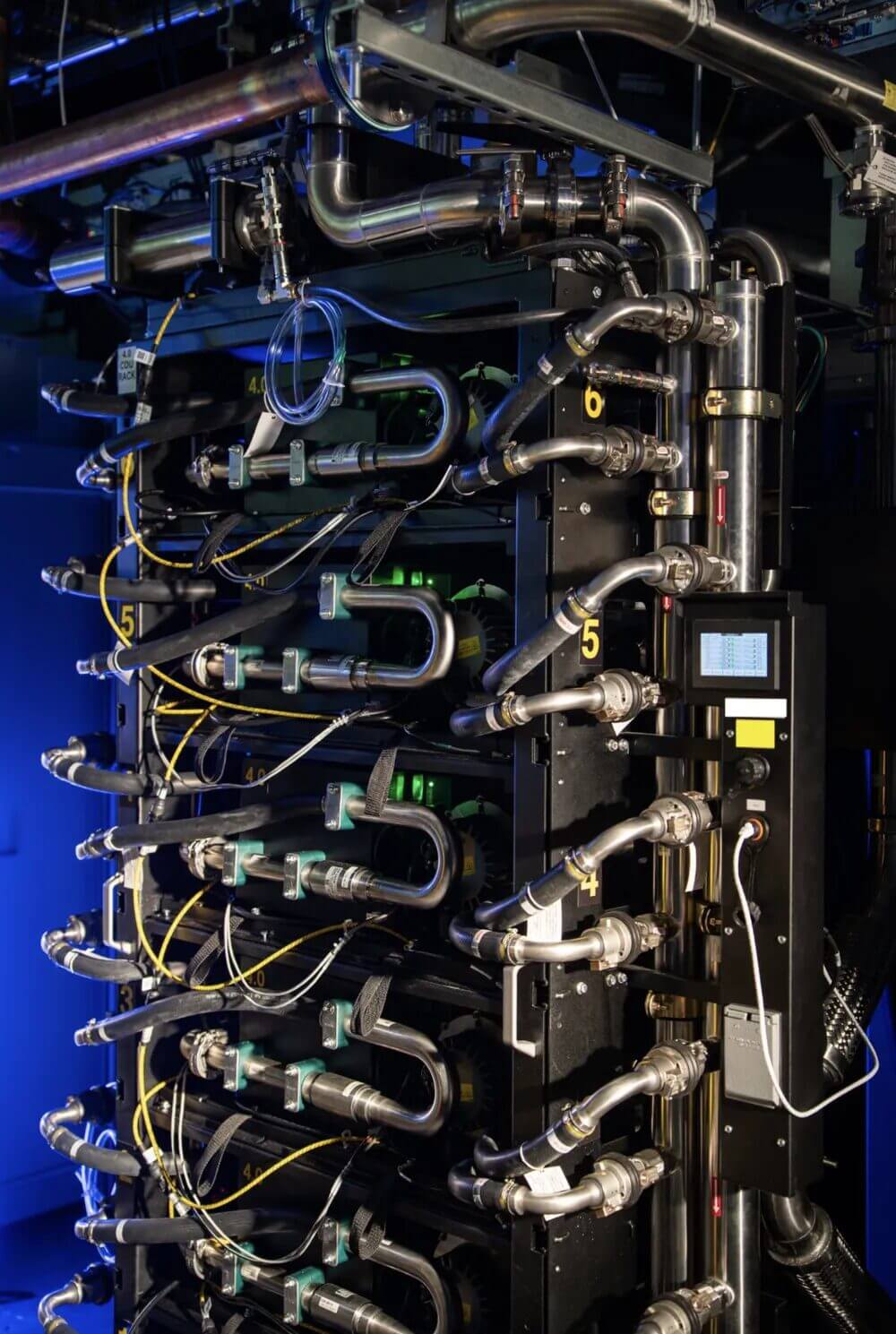

Raffreddamento e infrastrutture

Le nuove TPU utilizzano sistemi di raffreddamento a liquido di quarta generazione, in grado di sostenere densità di calcolo più elevate rispetto al raffreddamento ad aria.

Google ha lavorato anche sull’architettura dei data center, aumentando di sei volte la potenza di calcolo per unità di energia negli ultimi cinque anni.

L’integrazione tra chip, rete e infrastruttura fisica è uno degli elementi distintivi della strategia dell’azienda.

Il ruolo nel cloud e nel supercomputing

TPU 8t e TPU 8i saranno disponibili all’interno dell’offerta Google Cloud entro la fine dell’anno.

I chip faranno parte della piattaforma AI Hypercomputer, che combina hardware, software e strumenti di gestione in un unico sistema.

L’obiettivo è offrire alle aziende un’infrastruttura completa per sviluppare e distribuire applicazioni di intelligenza artificiale su larga scala.

Implicazioni per il mercato

L’introduzione di due chip distinti segnala un cambiamento nella competizione tra fornitori di infrastrutture AI.

La separazione tra addestramento e inferenza riflette la maturazione del settore, dove l’uso operativo dei modelli sta diventando centrale quanto la loro creazione.

Aziende come Citadel Securities, citata da Google tra i clienti, utilizzano già queste tecnologie per applicazioni avanzate.

Conclusione

Con TPU 8t e TPU 8i, Google rafforza il controllo sull’intera filiera dell’intelligenza artificiale, dal silicio ai data center.

La strategia punta su specializzazione, efficienza energetica e integrazione verticale. L’obiettivo è sostenere una fase in cui gli agenti AI diventano strumenti operativi, con impatti diretti su imprese e servizi.

La disponibilità su larga scala dei nuovi chip sarà un test per verificare quanto queste innovazioni riusciranno a tradursi in vantaggi concreti per il mercato.