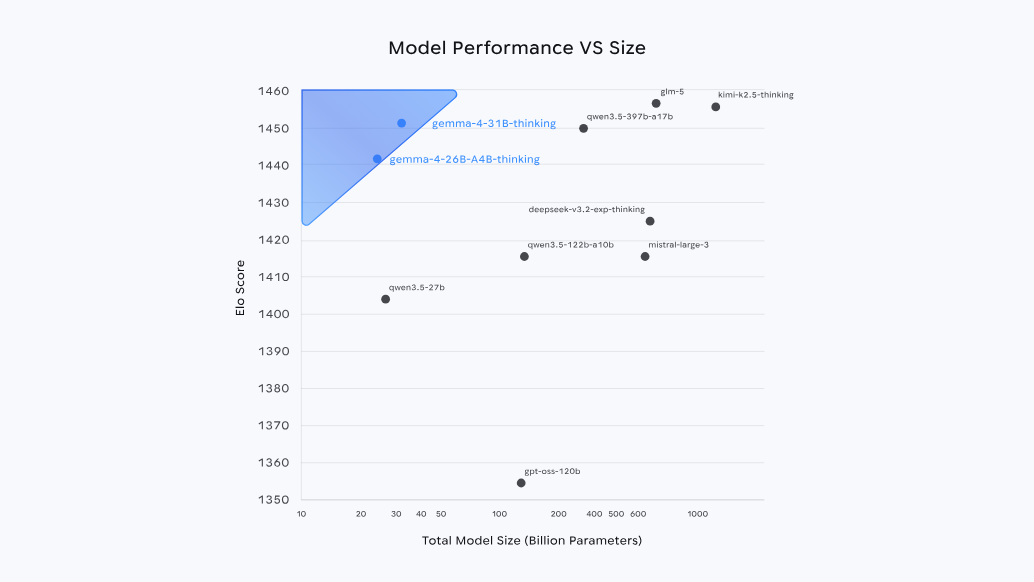

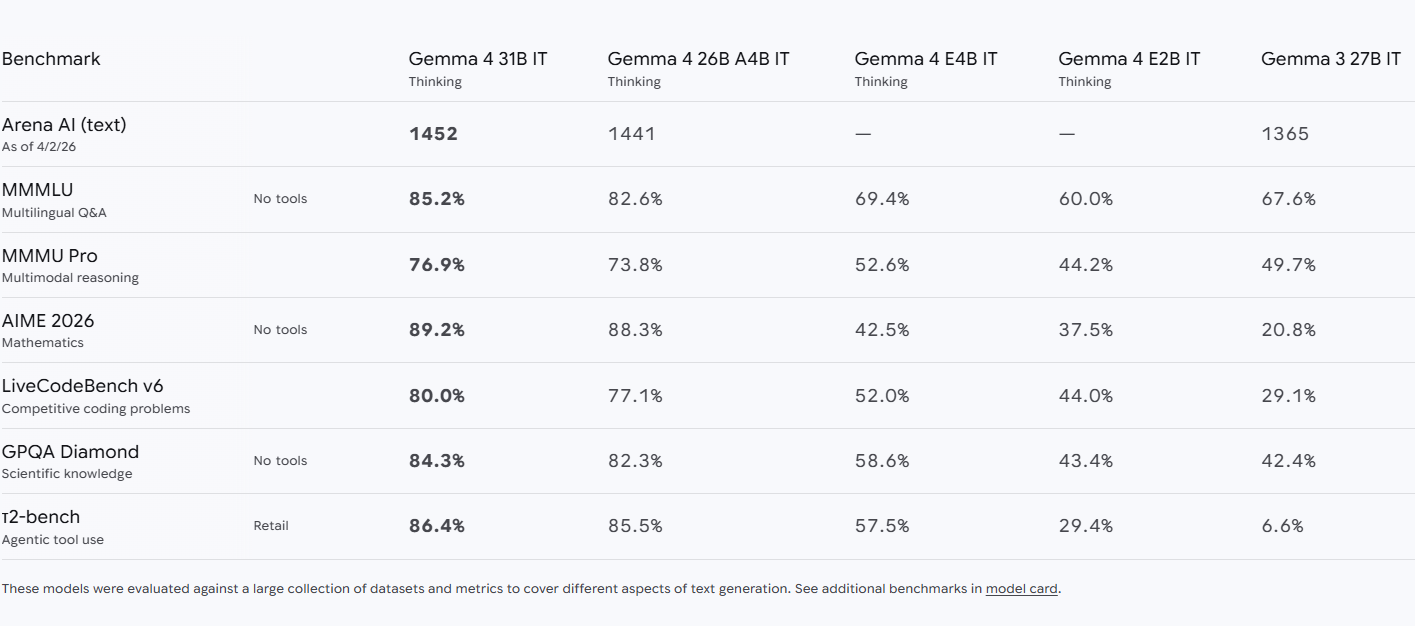

Google ha rilasciato Gemma 4 il 2 aprile 2026, quattro modelli open weight derivati da Gemini 3, e il primo riflesso è guardare i benchmark. Terzo posto nella classifica Arena AI con il modello da 31 miliardi di parametri, sesto con il 26B MoE, numeri che battono modelli venti volte più grandi. Ma fermarsi ai benchmark sarebbe un errore, perché la notizia che pesa di più non sta nelle tabelle di confronto, sta in una riga del comunicato che molti hanno letto di fretta: licenza Apache 2.0, nessuna restrizione d’uso, nessun limite di utenti attivi mensili.

Chi segue questo mercato sa che la licenza è stata il punto debole di Gemma fin dall’inizio. Le versioni precedenti imponevano condizioni proprietarie che rendevano ogni deployment aziendale un esercizio di revisione legale.

Apache 2.0 cambia il gioco completamente, perché mette Gemma sullo stesso piano di Llama, Qwen e Mistral dal punto di vista della libertà d’uso, e lo fa nel momento in cui i modelli aperti cinesi stanno erodendo terreno a velocità impressionante.

Indice degli argomenti:

L’architettura che porta l’AI sul dispositivo

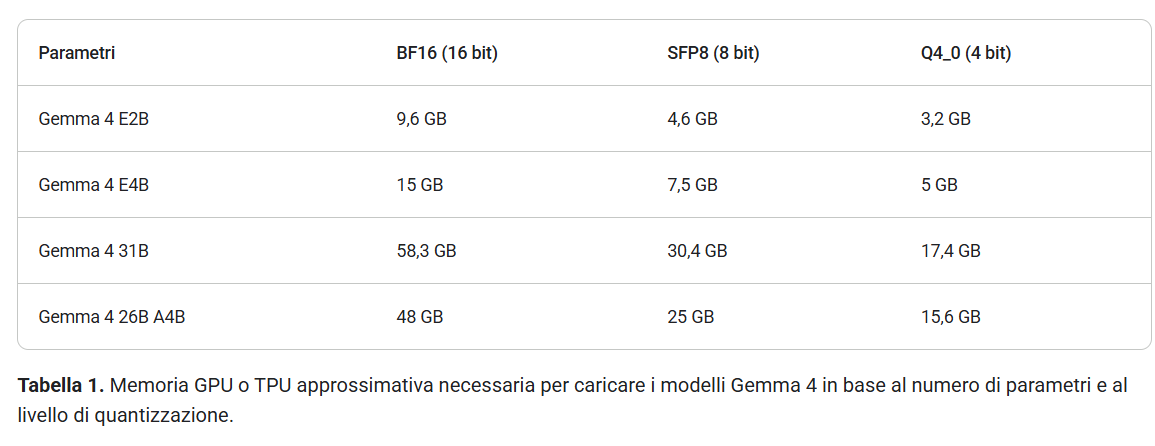

Gemma 4 esce in quattro taglie: E2B, E4B, 26B MoE e 31B Dense. Le prime due usano una tecnica chiamata Per-Layer Embeddings che merita attenzione, perché il modello E2B (la “E” sta per parametri “efficaci”) attiva 2,3 miliardi di parametri ma porta con sé la profondità rappresentazionale di 5,1 miliardi, il tutto in meno di 1,5 GB di memoria con quantizzazione. In pratica: un modello che gira su uno smartphone e ragiona come uno molto più grande.

Il 26B MoE usa 128 piccoli esperti, ne attiva 8 più uno condiviso per ogni token, con 3,8 miliardi di parametri in gioco per ogni forward pass. Il risultato è un modello che a 4 bit sta dentro una GPU consumer da 24 GB, una RTX 4090 o una AMD RX 7900 XTX, con framework come Llama.cpp o Ollama.

I numeri dicono qualcosa di preciso: il 26B MoE segna 88,3% su AIME 2026, 77,1% su LiveCodeBench, 82,3% su GPQA Diamond.

L’E4B arriva a 42,5% su AIME e 52% su LiveCodeBench. L’E2B a 37,5% e 44%. Audio e video nativi sui modelli edge completano un pacchetto che punta con decisione all’inferenza locale.

Sei laboratori, una corsa che accelera

Ecco dove la riflessione si allarga. Gemma 4 non è un evento isolato, è l’ultimo tassello di una convergenza che nel giro di pochi mesi ha cambiato la struttura del mercato dei modelli aperti.

Oggi sei laboratori producono modelli open weight competitivi con i migliori modelli proprietari:

- Google con Gemma 4,

- Alibaba con Qwen 3.6 Plus,

- Meta con Llama 4,

- Mistral con Small 4,

- OpenAI con gpt-oss-120b,

- Zhipu AI con GLM-5.

Un anno fa la competizione era tra due o tre famiglie di modelli, con distacchi ampi e aggiornamenti semestrali. Ora i cicli di rilascio si misurano in settimane, i distacchi nei benchmark in frazioni di punto percentuale, e ogni modello ha un vantaggio specifico che lo rende il migliore in un contesto e non in un altro.

Qwen 3.5 domina sul coding, vincendo o pareggiando in 5 delle 8 categorie di benchmark incluse LiveCodeBench e SWE-bench.

Llama 4 Scout offre una finestra di contesto da 10 milioni di token che nessun altro eguaglia. Gemma 4 eccelle nel rapporto qualità per parametro e nella capacità di girare su hardware accessibile.

La parola chiave non è più “quale modello è il migliore” ma “quale modello è il migliore per questo compito, su questo hardware, con questi vincoli di latenza e costo”.

Perché la licenza conta più del benchmark

Il passaggio ad Apache 2.0 merita un ragionamento separato perché tocca direttamente le decisioni aziendali. Le licenze proprietarie di Google per Gemma 1, 2 e 3 imponevano limiti sugli utenti attivi mensili, una acceptable use policy controllata da Google e condizioni che potevano cambiare. Per un’azienda questo significava rischio legale, dipendenza dalle decisioni future del licenziante, complessità nella catena di approvvigionamento software.

Apache 2.0 elimina tutto questo. L’azienda può modificare il modello, redistribuirlo, incorporarlo in prodotti commerciali senza chiedere permesso e senza temere che Google cambi le regole a partita in corso.

Google lo fa perché deve farlo: i modelli cinesi, Qwen in testa, usano Apache 2.0 da tempo e stanno conquistando quote di adozione tra gli sviluppatori enterprise proprio grazie alla semplicità della licenza.

La lezione è più ampia del singolo caso. Nel mercato dei modelli aperti la licenza sta diventando infrastruttura competitiva esattamente come il benchmark, perché un modello tecnicamente superiore con una licenza ambigua perde contro un modello leggermente inferiore con una licenza chiara, soprattutto quando chi decide è un ufficio legale e non un data scientist.

L’edge come nuovo terreno di gioco

Arm ha pubblicato un post dedicato all’ottimizzazione di Gemma 4 sui propri processori, Google stessa parla di agentic skills to the edge, e i modelli E2B e E4B con supporto audio e video nativo puntano con chiarezza al dispositivo personale. Qui la partita si fa trasversale, perché l’edge AI non è solo una questione di latenza o privacy, è una questione di architettura del valore.

Quando un modello capace gira su uno smartphone, su un robot, su un dispositivo industriale, il dato non deve più viaggiare verso il cloud per essere elaborato, la risposta arriva dove serve nel momento in cui serve, e il costo marginale dell’inferenza crolla.

Per le imprese che lavorano su flotte di dispositivi, punti vendita, linee produttive, veicoli, il passaggio dal cloud all’edge ridisegna l’economia del deployment AI in modo radicale.

Gemma 4 non è l’unico modello a puntare sull’edge: Mistral Small 4 e Qwen E-series fanno lo stesso, ma Google ha un vantaggio di ecosistema: Android, Chrome, Tensor, i dispositivi Pixel. La distribuzione conta, e Google controlla più punti di contatto con l’utente finale di qualsiasi altro produttore di modelli aperti.

Cosa guardare se si decidono strategie

Per chi prende decisioni tecnologiche in azienda Gemma 4 non è un modello da valutare in isolamento, è un segnale di mercato da leggere insieme agli altri. Il messaggio complessivo dice che i modelli aperti hanno raggiunto una qualità che li rende utilizzabili in produzione per una gamma crescente di casi d’uso, che la competizione tra laboratori comprime i cicli di miglioramento, che il costo di accesso all’AI di qualità sta scendendo verso lo zero marginale.

Le domande operative restano le stesse: su quale hardware devo girare, con quale latenza, con quali vincoli di privacy, con quale budget per il fine-tuning, con quale team di manutenzione.

Gemma 4, Llama 4, Qwen 3.6, Mistral Small 4 rispondono a queste domande in modo diverso, e la risposta giusta cambia a seconda del contesto.

La corsa ai modelli aperti non ha un vincitore stabile, ha un ecosistema che matura. Per le imprese questo è il dato che importa: la scelta non è più se usare modelli aperti, è come governare un portafoglio di modelli che cambiano ogni trimestre, su hardware che va dal datacenter al telefono, con licenze che finalmente lo permettono.

Fabio Lalli, imprenditore, advisor e autore di “Pelle Digitale” e “Spatial Shift”