Google annuncia l’introduzione di Gemini 3.1 Flash-Lite, il modello più veloce ed economico della serie Gemini 3.1. Progettato per gestire carichi di lavoro ad alto volume, garantisce qualità elevata in rapporto al prezzo e alla fascia di appartenenza.

Gemini 3.1 Flash-Lite è disponibile in anteprima per gli sviluppatori tramite l’API Gemini su Google AI Studio e per le aziende attraverso Vertex AI.

Indice degli argomenti:

Efficienza dei costi senza compromessi

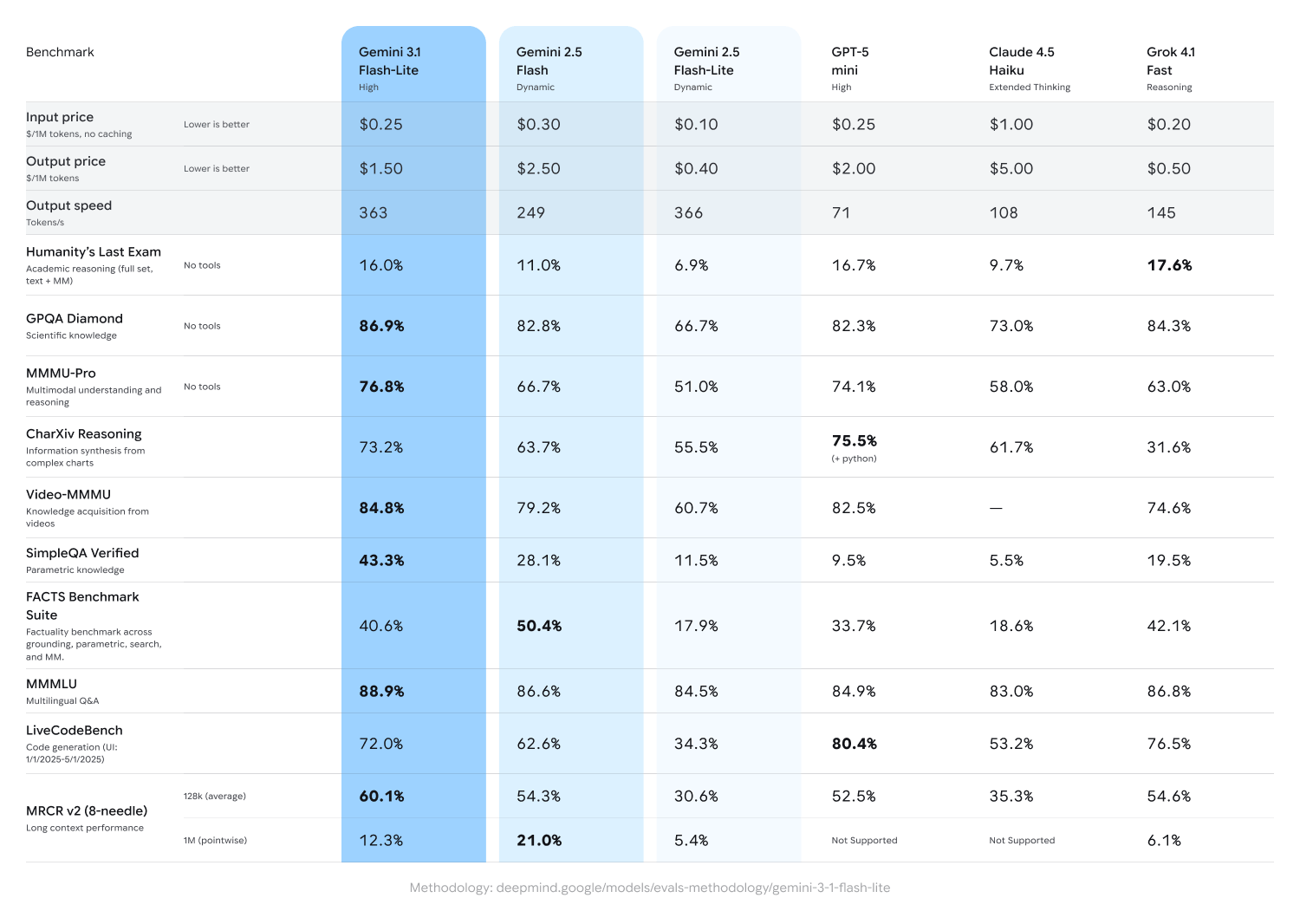

Il modello viene proposto a un prezzo di 0,25 dollari per milione di token in input e 1,50 dollari per milione di token in output. Nonostante il costo contenuto, offre prestazioni potenziate rispetto ai modelli precedenti.

Secondo i benchmark di Artificial Analysis, Gemini 3.1 Flash-Lite supera Gemini 2.5 Flash con un tempo alla prima risposta 2,5 volte più rapido e un incremento del 45% nella velocità di generazione dell’output, mantenendo qualità simile o superiore. Questa bassa latenza lo rende ideale per flussi di lavoro ad alta frequenza e per applicazioni in tempo reale.

Sul piano delle valutazioni, il modello raggiunge un punteggio Elo di 1432 nella classifica Arena.ai e ottiene risultati di rilievo nei benchmark di ragionamento e comprensione multimodale, con l’86,9% su GPQA Diamond e il 76,8% su MMMU Pro, superando anche modelli Gemini di generazioni precedenti.

Intelligenza adattiva per sviluppatori

Oltre alle prestazioni pure, Gemini 3.1 Flash-Lite integra livelli di “thinking” configurabili su AI Studio e Vertex AI. Questa funzionalità consente agli sviluppatori di controllare il grado di elaborazione del modello in base al compito richiesto, un aspetto cruciale per la gestione di carichi di lavoro intensivi.

Il modello si dimostra efficace nella traduzione su larga scala e nella moderazione dei contenuti, dove la priorità è il contenimento dei costi, ma riesce anche ad affrontare attività più complesse. Tra queste figurano la generazione di interfacce utente e dashboard, la creazione di simulazioni e l’esecuzione di istruzioni articolate.

Le prime applicazioni sul mercato

Gli sviluppatori con accesso anticipato su AI Studio e Vertex AI, insieme ad aziende come Latitude, Cartwheel e Whering, stanno già utilizzando Gemini 3.1 Flash-Lite per risolvere problemi complessi su larga scala.

I primi tester sottolineano l’efficienza e le capacità di ragionamento del modello, evidenziando come riesca a gestire input complessi con la precisione tipica di modelli di fascia superiore, mantenendo al tempo stesso un’elevata aderenza alle istruzioni.

Una nuova fase per l’AI scalabile

Con Gemini 3.1 Flash-Lite, Google rafforza la propria strategia orientata a rendere l’intelligenza artificiale sempre più accessibile, scalabile e sostenibile economicamente. Il modello si propone come soluzione di riferimento per sviluppatori e imprese che necessitano di prestazioni elevate, tempi di risposta rapidi e costi ottimizzati in ambienti ad alto volume.