Dopo il debutto in beta a ottobre 2024, Realtime API entra in disponibilità generale. Pensata per sviluppatori e imprese, permette di costruire voice agent affidabili e pronti per la produzione. Tra le novità spiccano:

- supporto ai server MCP remoti,

- input di immagini

- connessioni via Session Initiation Protocol (SIP), aprendo l’ecosistema a strumenti e contesti aggiuntivi.

Indice degli argomenti:

gpt-realtime: il nuovo standard della conversazione vocale

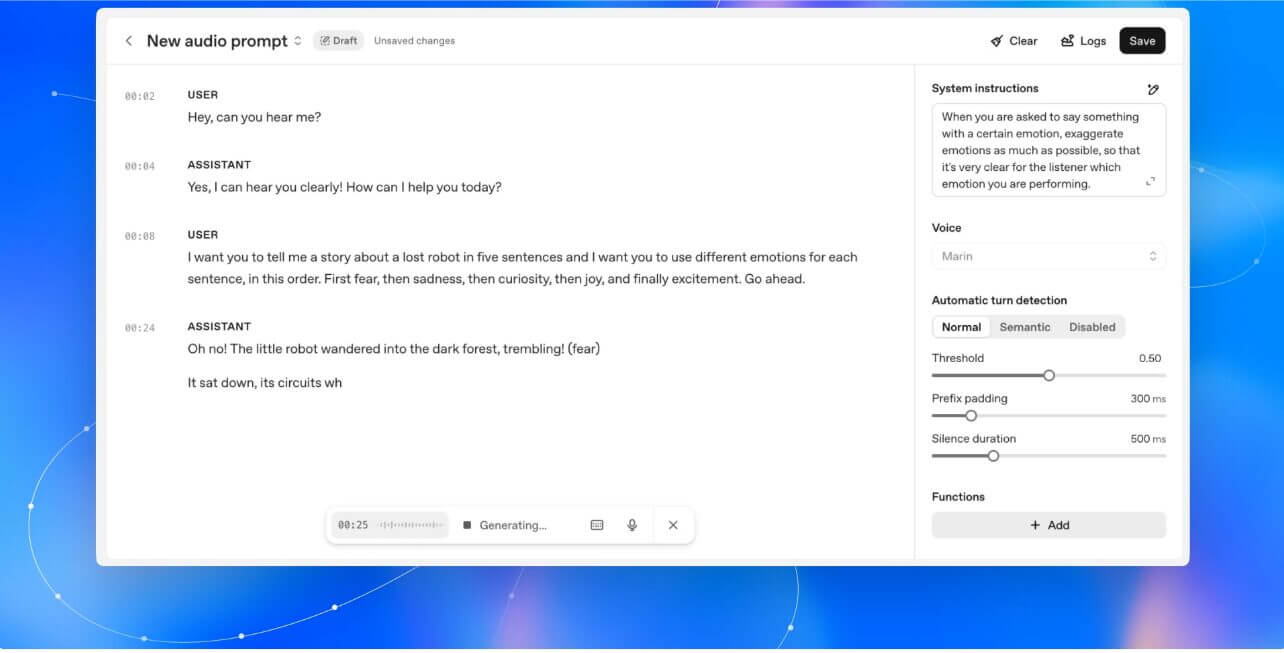

Al centro dell’annuncio c’è gpt-realtime, il nuovo modello speech-to-speech capace di gestire istruzioni complesse, chiamare strumenti con precisione e generare una voce più naturale ed espressiva. È stato progettato per scenari reali: assistenza clienti, personal assistant e formazione. Due nuove voci, Cedar e Marin, arricchiscono l’esperienza, mentre le otto già esistenti ricevono miglioramenti significativi.

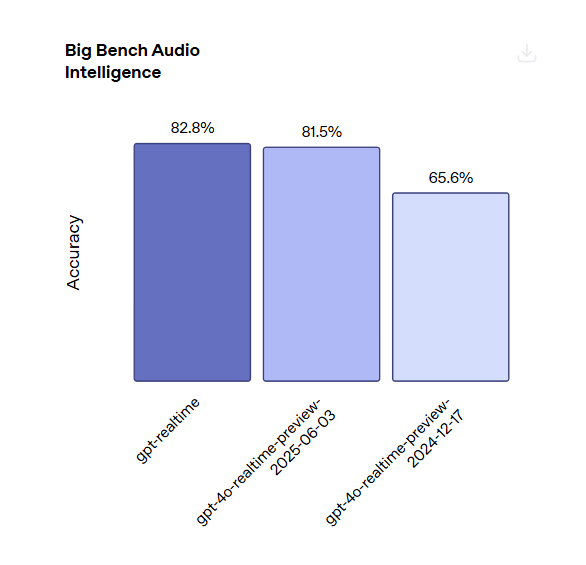

Qualità audio e intelligenza potenziata

La naturalezza è cruciale per la diffusione degli agenti vocali. gpt-realtime introduce intonazioni più umane e la capacità di modulare lo stile: dall’empatico al professionale, fino a cambi di lingua nella stessa frase. Secondo i benchmark interni, il modello raggiunge l’82,8% di accuratezza nel Big Bench Audio, superando di oltre 17 punti la versione del 2024.

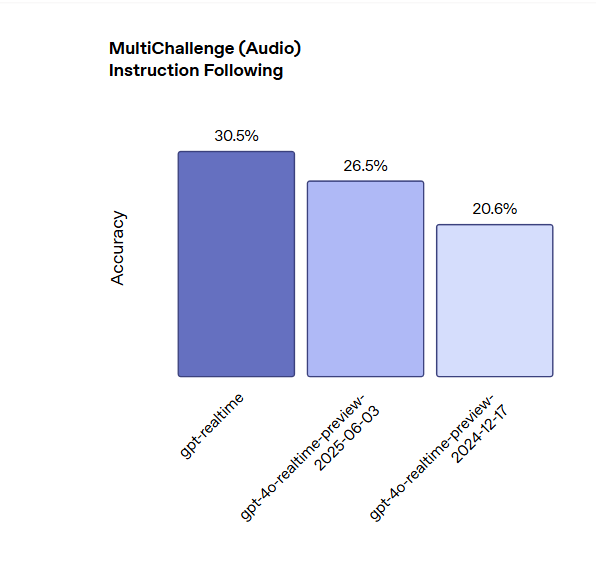

Maggiore aderenza alle istruzioni

Il nuovo modello mostra progressi anche nell’esecuzione delle istruzioni degli sviluppatori. Nei test MultiChallenge, pensati per valutare la gestione di conversazioni multi-turno, gpt-realtime ha raggiunto il 30,5% di accuratezza, contro il 20,6% della versione precedente. Ciò consente di definire con maggiore precisione toni, risposte e comportamenti.

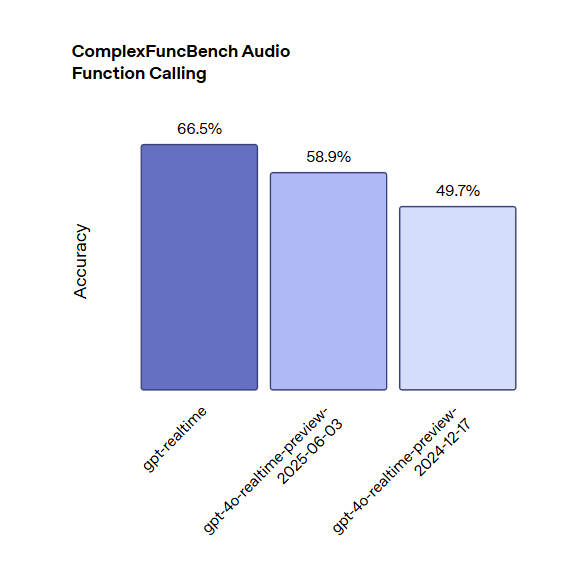

Function calling evoluto

Uno degli aspetti più critici per l’uso in produzione è la capacità di chiamare strumenti in modo tempestivo e corretto. gpt-realtime ha raggiunto il 66,5% di accuratezza nel benchmark ComplexFuncBench, con miglioramenti anche nella gestione asincrona: le conversazioni restano fluide anche durante l’attesa dei risultati di funzioni complesse.

Nuove funzionalità API

Oltre al modello, la Realtime API si arricchisce di nuove opzioni:

- Server MCP remoti: estendono rapidamente le capacità degli agenti.

- Input di immagini: consente di integrare screenshot e foto per contestualizzare la conversazione.

- Supporto SIP: permette di collegare l’AI a centralini, telefoni fissi e reti pubbliche.

- Prompt riutilizzabili: semplificano lo sviluppo e la scalabilità dei progetti.

Sicurezza, privacy e compliance UE

OpenAI integra salvaguardie multilivello per ridurre rischi di abuso e garantisce conformità con le normative europee sulla residenza dei dati. Le voci preimpostate limitano il rischio di impersonificazione, mentre gli sviluppatori possono aggiungere ulteriori barriere di sicurezza tramite l’Agents SDK.

Prezzi e disponibilità

gpt-realtime è disponibile a tutti gli sviluppatori, con un prezzo ridotto del 20% rispetto alla versione precedente: 32 dollari per 1M token audio in input e 64 dollari per 1M token audio in output. Inoltre, la gestione avanzata del contesto conversazionale consente di ridurre i costi delle sessioni lunghe.

Per iniziare, consulta la documentazione sull’API in tempo reale, testa il nuovo modello nel Playground e consulta la guida alla richiesta dell’API in tempo reale.