L’AI corre, ma la filiera dell’hardware non riesce a stare al passo. Negli ultimi mesi la corsa all’intelligenza artificiale ha assunto i tratti di una competizione industriale sempre meno governabile. Nella Silicon Valley si è diffusa perfino una pratica informale, il cosiddetto “tokenmaxxing”: sviluppatori, start-up e aziende cercano di consumare il maggior numero possibile di token, cioè le unità di testo elaborate dai modelli di AI, per dimostrare di essere tra i più avanzati nell’adozione di questi strumenti.

Tra gennaio e marzo, i token elaborati ogni settimana da OpenRouter, marketplace che consente l’accesso a diversi modelli, sono quadruplicati.

Il dato segnala un punto preciso: la domanda di potenza di calcolo legata all’AI sta crescendo più rapidamente della capacità dell’industria di sostenerla.

I laboratori che sviluppano i modelli, le grandi piattaforme cloud e i produttori di chip stanno aumentando gli investimenti, ma il sistema nel suo complesso mostra segni di saturazione.

Il risultato è un collo di bottiglia che riguarda l’intera filiera: data center, energia, gpu, memorie ad alta larghezza di banda, cpu, componenti di rete e sistemi di raffreddamento.

Indice degli argomenti:

I primi segnali di stress arrivano dai servizi

La pressione sulla capacità disponibile non è più una previsione. È già visibile nei servizi offerti dalle principali società del settore.

A marzo Anthropic, società i cui modelli sono molto utilizzati dalle imprese, ha iniziato a limitare l’accesso ai propri strumenti nelle ore di punta. In seguito ha modificato i piani di abbonamento, in modo che molti osservatori hanno letto come un tentativo di frenare l’uso più intenso della piattaforma. Ad aprile il servizio ha registrato interruzioni medie di circa 30 minuti al giorno.

Anthropic non è un caso isolato.

Sempre a marzo OpenAI ha sospeso bruscamente Sora, il suo strumento per la generazione video, per riallocare una potenza di calcolo diventata troppo scarsa verso impieghi ritenuti più redditizi.

Il 20 aprile GitHub, piattaforma di collaborazione per sviluppatori controllata da Microsoft, ha smesso di accettare nuovi abbonamenti per il proprio assistente di programmazione.

Questi episodi raccontano una dinamica chiara. L’AI non incontra oggi il suo limite principale nella ricerca o nel software, ma nell’infrastruttura fisica necessaria a far funzionare i modelli. La disponibilità di chip, server, memoria e capacità elettrica è diventata una variabile strategica almeno quanto la qualità degli algoritmi.

Le big tech alzano la posta sugli investimenti

Di fronte a questa pressione, la risposta dell’industria è stata finanziaria prima ancora che tecnica: spendere di più, e spendere in fretta.

Il 20 aprile Anthropic ha annunciato una partnership da 100 miliardi di dollari con Amazon per assicurarsi fino a 5 gigawatt di capacità server. Quasi un quinto di questa capacità dovrebbe entrare in funzione entro la fine dell’anno.

Il 24 aprile la società ha inoltre comunicato che Google investirà altri 40 miliardi di dollari per aiutare il laboratorio a coprire il proprio fabbisogno computazionale.

Anche gli hyperscaler, i cinque giganti che dominano il cloud e l’infrastruttura digitale globale — Alphabet, Amazon, Meta, Microsoft e Oracle — stanno investendo somme enormi nei data center.

Alphabet, Amazon e Oracle hanno raccolto insieme oltre 100 miliardi di dollari di debito dall’inizio dell’anno. Meta, per liberare risorse, ha annunciato il taglio del 10% della forza lavoro. Microsoft ha parlato di uscite volontarie per circa il 7% dei dipendenti.

Il messaggio è netto: la capacità di calcolo è ormai un asset industriale critico. Le aziende che vogliono restare nella corsa all’AI stanno sacrificando margini, personale e flessibilità finanziaria per assicurarsela.

Costruire nuovi data center è sempre più difficile

Il problema è che aumentare la capacità non dipende solo dai bilanci. Dipende anche dai tempi, dalle autorizzazioni e dalla disponibilità di energia. Negli Stati Uniti, come in altri Paesi, l’opposizione politica e territoriale alla costruzione di nuovi data center sta crescendo.

In aprile i legislatori del Maine hanno approvato una proposta di legge per vietare fino a novembre 2027 la costruzione di data center superiori a 20 megawatt. Il provvedimento è stato poi bocciato dal governatore, ma il segnale politico resta. In più di dieci altri Stati americani sono in discussione misure simili.

Secondo una stima citata nel testo originale, lo scorso anno negli Stati Uniti progetti di data center per 156 miliardi di dollari sono stati bloccati o rinviati a causa di opposizioni locali e contenziosi.

Le resistenze non riguardano solo gli Stati Uniti. Dall’Irlanda al Brasile cresce la contestazione contro impianti percepiti come energivori e invasivi. Al centro delle critiche c’è soprattutto l’impatto sul costo dell’elettricità. I data center richiedono grandi quantità di energia in modo continuo, e il timore diffuso è che finiscano per spingere in alto le bollette di famiglie e imprese. Se i prezzi energetici dovessero salire ancora, l’ostilità politica potrebbe accentuarsi.

In questo passaggio si vede un altro elemento decisivo: la corsa all’AI non si gioca soltanto nei laboratori californiani, ma anche nelle assemblee legislative, nelle autorità locali e nelle reti elettriche.

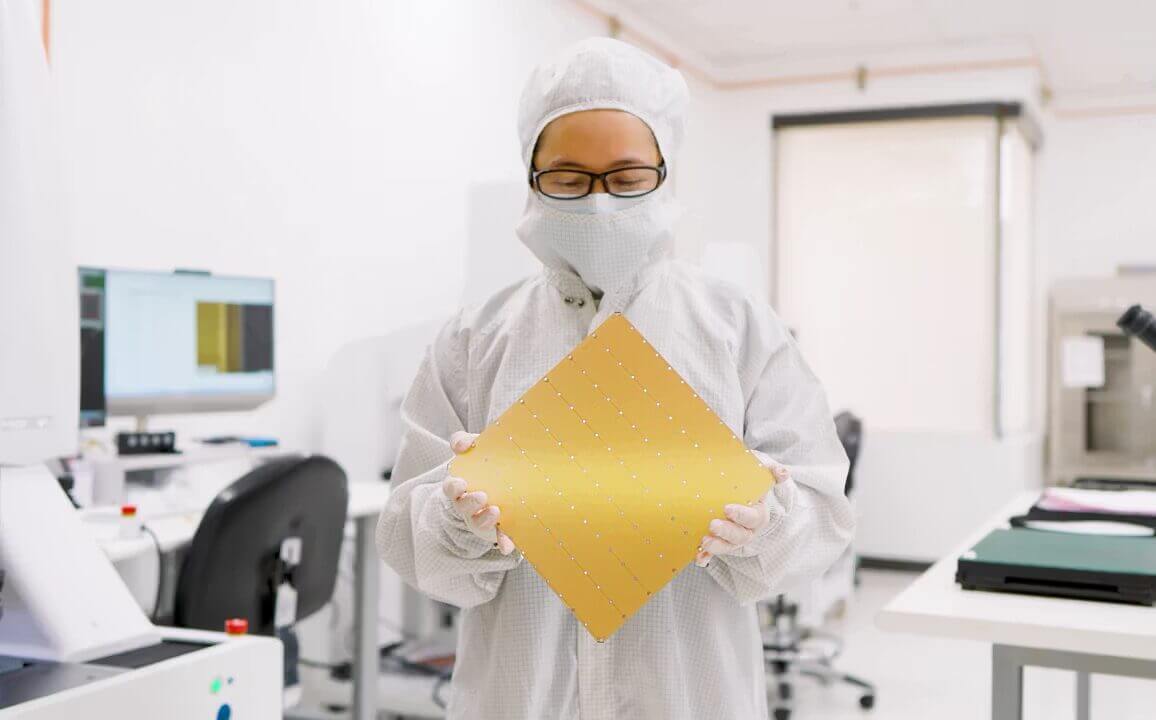

I chip non bastano più

Anche quando i data center ottengono i permessi e trovano un allaccio alla rete, oppure si dotano di sistemi propri di generazione, resta il problema dell’hardware da installare.

Ivan Chiam di SemiAnalysis, società di ricerca specializzata nel settore, osserva che non ci sono abbastanza chip per riempire i data center oggi in costruzione.

Il caso più evidente è quello delle gpu progettate da Nvidia, che da sole forniscono oltre due terzi della potenza di calcolo mondiale destinata all’AI. Il prezzo di noleggio di una gpu H100, lanciata nel 2022, è aumentato di circa il 30% da novembre, perché i clienti che non riescono a procurarsi i modelli più recenti ripiegano sulle generazioni precedenti. In altre parole, la scarsità si sta propagando all’indietro lungo tutta la gamma dei prodotti disponibili.

Le difficoltà non riguardano solo Nvidia. Anche i processori alternativi per AI stanno diventando più difficili da ottenere. Ad aprile Andy Jassy, amministratore delegato di Amazon, ha dichiarato che l’accesso ai chip Trainium2 sviluppati dall’azienda era quasi esaurito. Una quota importante della capacità di Trainium4, attesa per il prossimo anno, risulta già prenotata.

Questo squilibrio tra offerta e domanda ha una conseguenza economica diretta: il valore dell’hardware aumenta, i tempi di consegna si allungano e la capacità computazionale finisce concentrata nelle mani di pochi attori con accesso prioritario alla produzione.

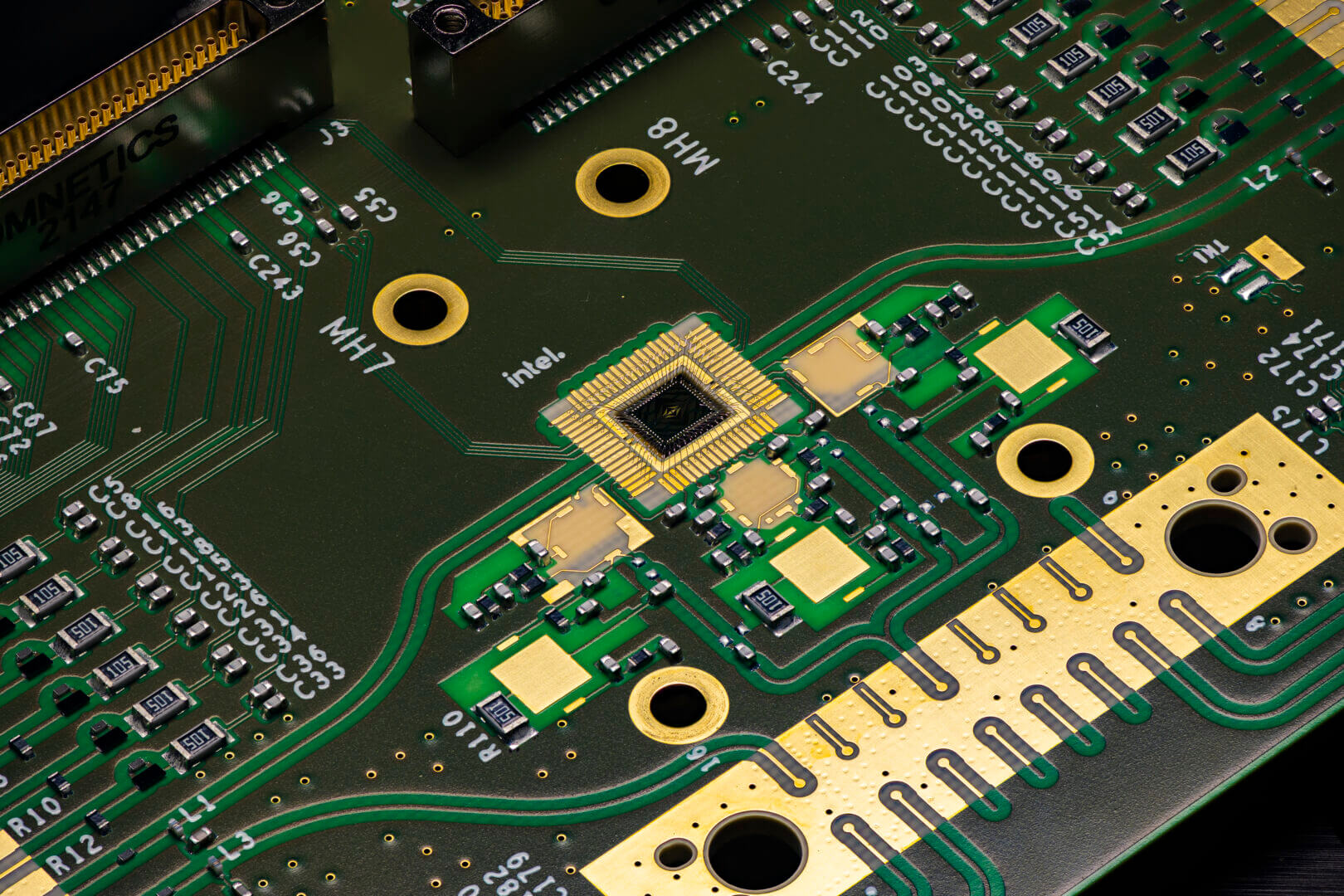

Il nodo della memoria ad alta banda

Il collo di bottiglia non riguarda solo i processori. Si estende alle memorie, in particolare alle hbm, high-bandwidth memory, essenziali per l’addestramento e l’esecuzione dei modelli di AI.

I tre grandi produttori globali — SK Hynix, Samsung e Micron — affermano che gran parte della loro produzione per il 2026 è già venduta.

A marzo 2026 Google ha presentato TurboQuant, un algoritmo pensato per ridurre la quantità di memoria richiesta dai modelli. L’annuncio ha fatto scendere temporaneamente i titoli dei produttori di memoria, perché il mercato ha intravisto la possibilità di un alleggerimento della pressione. Ma l’effetto non sembra sufficiente a cambiare il quadro. La domanda di hbm, secondo le attese riportate nel testo, dovrebbe superare l’offerta almeno per i prossimi tre anni.

Questo dato merita attenzione perché mostra come l’espansione dell’AI non dipenda da un singolo componente. Anche se si trovassero più gpu, senza memorie adeguate le macchine non potrebbero operare ai livelli richiesti. La filiera funziona come una catena: basta un anello debole per rallentare tutto il sistema.

Ora la pressione si sposta anche sulle cpu

La scarsità comincia inoltre a coinvolgere le cpu, i processori centrali. È un passaggio importante perché segnala un’evoluzione nel tipo di applicazioni che l’industria sta spingendo. I sistemi di AI agentica, quelli in grado di pianificare, ragionare e svolgere compiti articolati, dipendono più delle chatbot tradizionali dalle cpu che coordinano il lavoro tra più componenti.

Morgan Stanley stima che i sistemi agentici richiedano una cpu per ogni gpu, mentre per le applicazioni in stile chatbot il rapporto era di una cpu ogni 12 gpu. La differenza è enorme. Significa che l’estensione dell’AI da interfaccia conversazionale a infrastruttura operativa per compiti complessi moltiplica la domanda di componenti diversi da quelli finora considerati centrali.

La forza della domanda ha peraltro ridato slancio a Intel, che fino a poco tempo fa appariva in difficoltà. La capitalizzazione di mercato del produttore americano, tra i principali nel segmento cpu, è più che raddoppiata negli ultimi sei mesi. Anche qui il mercato manda un segnale preciso: chi controlla i nodi industriali più esposti alla nuova domanda torna a essere strategico.

Il vero squilibrio è negli investimenti della filiera

Il punto decisivo, però, non è solo la scarsità attuale. È il divario tra chi compra capacità e chi dovrebbe costruirla. Secondo l’analisi riportata nel testo, i cinque hyperscaler hanno aumentato la spesa in conto capitale del 190%, da 234 a 677 miliardi di dollari, mentre i circa 50 maggiori produttori di chip, macchinari per semiconduttori, server, apparati di rete e sistemi di raffreddamento l’hanno aumentata solo del 45%, da 153 a 223 miliardi.

Il dato descrive una frattura nell’economia dell’AI. Da una parte ci sono i grandi compratori di infrastruttura, che stanno spendendo in modo aggressivo per garantirsi forniture future. Dall’altra i produttori dell’hardware, che continuano a investire ma con prudenza, ben al di sotto del ritmo della domanda.

Le ragioni di questa cautela sono comprensibili. Costruire capacità produttiva per semiconduttori richiede impianti costosi, lunghi tempi di realizzazione e previsioni di domanda molto difficili. Un errore può lasciare in eredità fabbriche sottoutilizzate e margini compressi per anni. Ma questa prudenza, dal punto di vista dell’intero settore, finisce per aggravare la stretta.

Il caso Tsmc e i tempi lunghi dell’industria

Il caso emblematico è Tsmc, il più grande produttore mondiale di semiconduttori conto terzi e fornitore dominante dei chip più avanzati, sia gpu sia cpu. Le sue fabbriche più sofisticate, quelle che producono chip a cinque nanometri o meno, lavorano già a pieno regime. Il numero uno dell’azienda, C.C. Wei, ha ammesso che l’offerta è “molto tirata” e che non esistono scorciatoie: costruire una nuova fab richiede da due a tre anni.

Tsmc prevede di spendere circa 55 miliardi di dollari nel 2026, il 34% in più rispetto all’anno precedente, e gli analisti stimano una crescita fino a 65 miliardi nel 2027. Ma, in rapporto alle vendite, la spesa in capitale è scesa da circa metà del fatturato nel 2022 a un terzo quest’anno.

Questo dettaglio dice molto. Anche il produttore più centrale della filiera non sta accelerando in modo proporzionale all’esplosione della domanda. La capacità aggiuntiva arriva, ma lentamente, e comunque meno di quanto i clienti vorrebbero.

Le pressioni dei clienti e i limiti della realtà industriale

La prudenza di Tsmc ha irritato diversi clienti. Sam Altman, amministratore delegato di OpenAI, ha esortato l’azienda a costruire semplicemente più capacità. A marzo Elon Musk ha annunciato il progetto di una “Terafab”, con l’obiettivo dichiarato di produrre ogni anno più potenza di calcolo dell’intera industria globale dei semiconduttori attuale.

L’ambizione è enorme, ma i vincoli industriali restano. L’impianto, per il quale Musk ha coinvolto Intel, difficilmente inizierà a produrre prima del 2028, e comunque su scala molto inferiore rispetto a quella evocata. Inoltre potrebbe essere complicato procurarsi i macchinari avanzati necessari a far funzionare una struttura di questo tipo, anch’essi oggi in quantità limitata.

Qui emerge la contraddizione che pesa sul futuro dell’AI. Il software migliora in mesi. Le supply chain industriali si espandono in anni. I modelli possono essere aggiornati rapidamente, le fabbriche no. I prodotti si lanciano in settimane, le linee produttive richiedono autorizzazioni, macchinari, personale specializzato, energia e capitale paziente.

Perché la corsa all’AI può rallentare

Il rischio non è la fine del boom dell’intelligenza artificiale, ma una sua frenata materiale. La domanda continua a salire, le aspettative di mercato restano elevate, e le grandi aziende sembrano disposte a spendere somme sempre maggiori pur di garantirsi accesso a chip e capacità server. Ma l’infrastruttura fisica non risponde con la stessa velocità.

Per questo il problema non è solo tecnologico. È economico e industriale. Se i produttori di hardware continueranno a investire con cautela, se la politica locale ostacolerà i data center e se le reti elettriche resteranno sotto pressione, l’AI potrebbe entrare in una fase in cui l’offerta di potenza di calcolo diventa il vero fattore limitante della crescita.

La febbre del “tokenmaxxing” racconta la fiducia, a tratti l’euforia, con cui il mercato guarda all’AI. Ma questa euforia si scontra con una realtà più semplice: i modelli generativi, per funzionare, hanno bisogno di acciaio, silicio, energia, acqua, cavi, memorie e tempo. Finché questi elementi resteranno scarsi, la rivoluzione dell’intelligenza artificiale avrà un confine molto concreto. Non quello dell’immaginazione, ma quello della capacità produttiva.

Keyword:

Titolo Seo:

Meta description: