L’Anthropic rende disponibile in public beta Claude Managed Agents, una suite di API composabili per costruire e distribuire agenti AI in ambienti cloud, gestiti direttamente da Anthropic. Non è un aggiornamento di modello, non è una nuova interfaccia: è un’infrastruttura, e la distinzione conta più di quanto sembri.

Chi vuole portare agenti AI in produzione, fino a ieri, doveva costruirsi da solo tutto il layer operativo: sandboxing sicuro, checkpoint di stato, gestione delle credenziali, permessi granulari, tracing end-to-end. Mesi di lavoro prima che un utente vedesse qualcosa.

Claude Managed Agents trasferisce quel peso ad Anthropic, lasciando ai team il compito di definire gli obiettivi, gli strumenti e i guardrail, mentre il resto viene gestito sull’infrastruttura del provider.

Vale la pena capire cosa significa davvero, e dove si posiziona rispetto a un mercato degli orchestratori già affollato.

Indice degli argomenti:

Cosa ha rilasciato Anthropic, concretamente

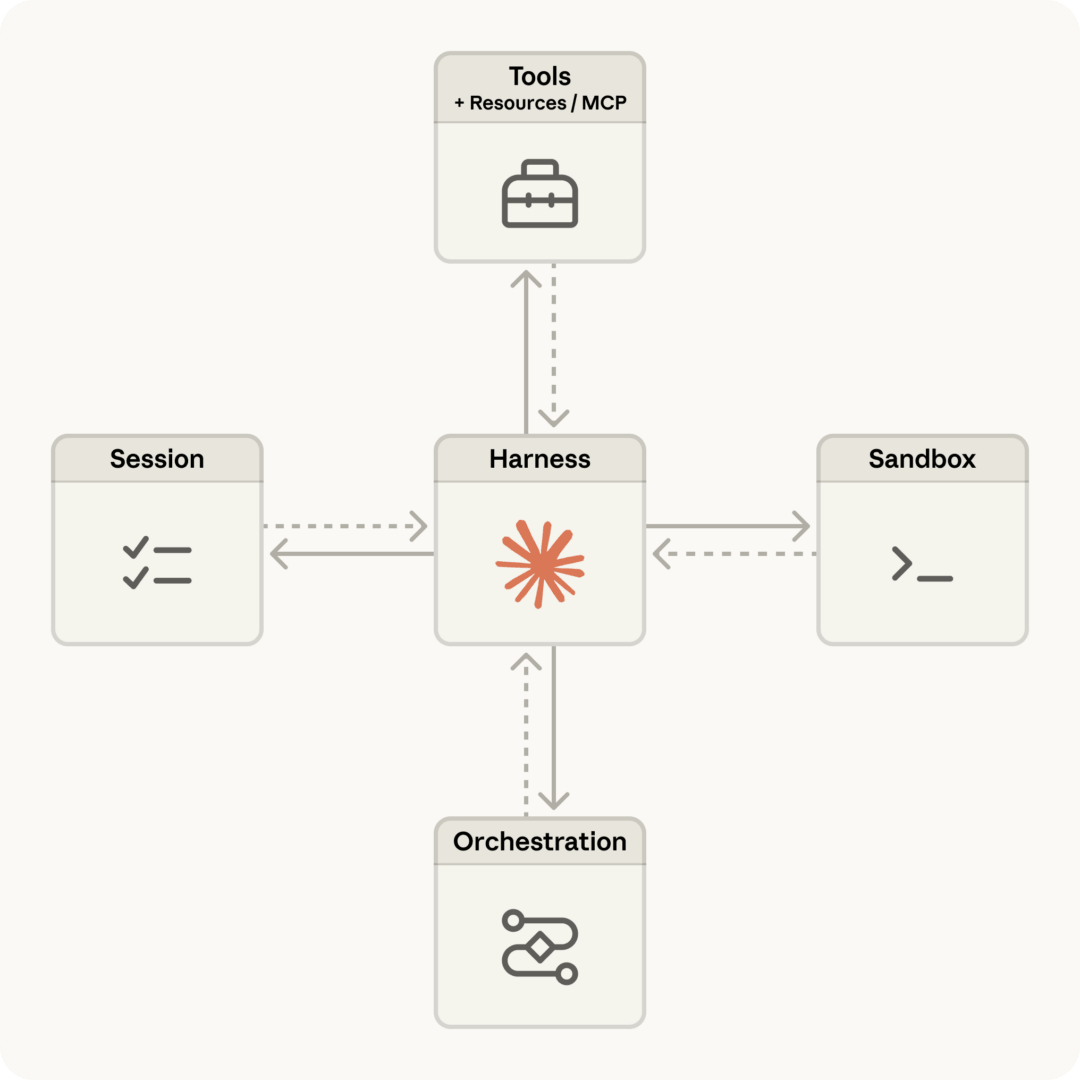

Il comunicato, emesso l’8 aprile 2026, elenca quattro componenti principali.

- I Production-grade agents includono sandboxing sicuro, autenticazione e tool execution gestiti direttamente dalla piattaforma.

- Le long-running sessions consentono agli agenti di operare in autonomia per ore, con output che persistono anche attraverso disconnessioni.

- La multi-agent coordination permette agli agenti di avviare e dirigere altri agenti per parallelizzare lavori complessi: questa funzionalità è in research preview e richiede richiesta di accesso esplicita.

- Il quarto pilastro è la trusted governance, con permessi scopati, gestione delle identità e tracing dell’esecuzione integrati by design.

Sul piano delle performance, Anthropic dichiara fino a 10 punti di miglioramento nel tasso di successo rispetto a un loop di prompting standard, con i guadagni più alti sui problemi più difficili. I test interni riguardavano la generazione strutturata di file: non è il benchmark più robusto che si possa immaginare, ma il segnale è coerente con l’idea che un harness di orchestrazione dedicato faccia la differenza quando la catena di azioni si allunga.

Il pricing è a consumo: tariffe token standard della Claude Platform più 0,08 dollari per session-hour di runtime attivo. Un modello che ha senso per sessioni lunghe e carichi variabili, meno ovvio per chi vuole prevedere i costi su volumi stabili.

Il mercato degli orchestratori: dove siamo arrivati

Il tema dell’orchestrazione multi-agente non è nuovo. Da quando i modelli linguistici hanno iniziato a diventare abbastanza capaci da eseguire azioni in sequenza, il problema di coordinarli è diventato il vero collo di bottiglia per chi vuole portarli in produzione.

LangChain, poi LangGraph, hanno definito un primo linguaggio comune per costruire catene e grafi di agenti.

AutoGen di Microsoft ha introdotto conversazioni multi-agente con pattern di collaborazione configurabili.

CrewAI ha portato un’astrazione orientata ai ruoli, più vicina al modello mentale di un team umano.

OpenAI, con Swarm prima e con le sue API di assistants poi, ha offerto una propria visione dell’orchestrazione managed, integrata nel suo ecosistema.

Ciascuno di questi approcci condivide un nodo irrisolto: o si è molto vicini all’infrastruttura, con tutti i benefici del controllo e tutti i costi della complessità operativa, oppure si è dentro un ecosistema proprietario con vincoli di portabilità che col tempo diventano rilevanti.

Claude Managed Agents si inserisce in questo spazio con una proposta specifica: zero infrastruttura da gestire, modello vincolato a Claude. Non è un framework agnostico, è un prodotto verticale, costruito per massimizzare le performance di Claude in contesti agentici, con la promessa di arrivare in produzione in giorni anziché mesi.

Notion, Asana, Rakuten, Sentry, Atlassian sono già in produzione con casi d’uso reali: coding agents che aprono PR, productivity agents che gestiscono task in parallelo, legal agents che estraggono informazioni da documenti. Il fatto che questi nomi si siano mossi rapidamente dice qualcosa sulla praticabilità del prodotto, anche se è ovviamente un set di early adopter curati.

Gli orchestratori multi-agente in azienda: il vero problema non è tecnico

Lavorando con aziende di dimensioni diverse su temi di AI adozione, la cosa che emerge più spesso non è la difficoltà di scegliere il framework giusto. È quella di capire dove l’orchestrazione multi-agente ha senso, e soprattutto dove non ce l’ha.

Un singolo agente con strumenti ben definiti risolve la maggior parte dei casi d’uso standard: recupero di informazioni, generazione di documenti, analisi di dati. La complessità multi-agente diventa giustificata quando si lavora su task che richiedono parallelismo reale, specializzazione di dominio, o catene di azioni che superano la finestra di contesto gestibile da un modello singolo.

In pratica: un agente che analizza un contratto è un agente. Un sistema che analizza mille contratti in parallelo, estrae clausole, le confronta con un database normativo e produce un report di compliance è un’architettura multi-agente. La distinzione non è solo di scala, è di architettura concettuale.

Il problema successivo è la governance. Agenti con accesso a sistemi reali, cioè quelli che hanno impatto, richiedono permessi granulari, audit log, meccanismi di override umano, non per prudenza eccessiva, ma perché senza questi elementi il rischio operativo diventa non gestibile. Claude Managed Agents include scoped permissions e execution tracing by design, ed è un punto non banale, spesso sottovalutato nelle implementazioni fai-da-te.

C’è poi la manutenzione. Un harness agentici custom costruito in sei mesi di sviluppo è anche un harness da aggiornare ogni volta che il modello sottostante cambia. L’approccio managed trasferisce questo onere al provider, il che è un vantaggio reale, a condizione di accettare il lock-in che ne consegue.

Come integrare agenti AI in azienda: un approccio per fasi

Il percorso più efficace che ho osservato, sia nei progetti seguiti direttamente sia nell’analisi di casi pubblici, procede per stadi distinti, ognuno con i suoi criteri di validazione prima di procedere.

Si comincia dalla mappatura dei processi candidati. Non tutti i flussi si prestano all’automazione agentici. I migliori candidati sono quelli con input strutturabili, output verificabili, bassa tolleranza all’errore umano e alta ripetitività. Un buon esercizio è elencare i task che un collaboratore junior svolge in modo routinario e che richiedono accesso a sistemi diversi: sono lì i candidati naturali.

Poi viene la prototipazione con perimetro stretto: un singolo agente, un singolo strumento, un singolo tipo di output. L’errore classico è voler costruire il sistema completo da subito. La complessità emergente di un sistema multi-agente non si progetta a tavolino, si scopre facendolo funzionare.

L’orchestrazione multi-agente entra in scena solo quando il singolo agente è stabile e i pattern di errore sono compresi. È qui che strumenti come Claude Managed Agents, o alternative come LangGraph o AutoGen in self-hosted, entrano in gioco. La scelta dipende dal profilo di rischio accettabile sul vendor lock-in, dalla competenza interna disponibile per la gestione infrastrutturale, e dal volume di sessioni previsto.

Lo stadio che più spesso viene dimenticato è il design del controllo umano: quali azioni richiedono approvazione, quali output vengono validati prima di propagarsi, come si interviene quando l’agente va fuori binario. Questi meccanismi non si aggiungono dopo, si progettano dall’inizio.

Posizionamento competitivo: i punti di forza e i nodi aperti

Claude Managed Agents compete su un terreno specifico: ridurre il time-to-production per chi vuole agenti AI su Claude senza costruirsi l’infrastruttura. Su questo terreno, la proposta è convincente. Il numero di aziende già in produzione, la qualità del tracing integrato nella Claude Console, il modello di pricing a consumo sono elementi coerenti con una proposta enterprise matura.

I nodi aperti sono altrettanto evidenti. Il lock-in su Claude è totale: chi costruisce su Claude Managed Agents non ha una via di uscita agevole verso altri modelli. La multi-agent coordination è ancora in research preview, il che significa che il caso d’uso più complesso e più interessante non è ancora disponibile per tutti.

Il pricing a session-hour aggiunge una variabile di costo che può diventare rilevante su sessioni lunghe e carichi intensi.

Il confronto più diretto è con le offerte managed di OpenAI, che ha un ecosistema più ampio ma una coerenza agentici costruita nel tempo in modo meno organico. Il confronto con i framework open-source, come LangGraph o AutoGen, è invece su un asse diverso: massimo controllo contro massima velocità di deployment. Non è una gara, sono scelte diverse per profili diversi.

Quello che Anthropic ha dichiarato con questa release è che non vuole solo fornire il modello: vuole essere il layer operativo degli agenti AI in produzione. È una scelta che ridisegna i confini del mercato in modo che i decisori tecnologici farebbero bene a tenere d’occhio.

Perché la domanda vera non è se Claude Managed Agents è il prodotto giusto. È cosa succede al mercato quando il fornitore del modello diventa anche il gestore dell’infrastruttura agentici, e quali implicazioni ha per le scelte architetturali che le aziende fanno oggi.