Un errore nel codice capace di mandare in crash un sistema operativo utilizzato da firewall, server e dispositivi di rete è rimasto nascosto per oltre 27 anni. A individuarlo, nel marzo 2026, non è stato un team umano ma un modello di intelligenza artificiale sviluppato da Anthropic, Mythos.

Il caso è diventato emblematico di una trasformazione in corso nella cybersicurezza. I nuovi modelli di AI sono in grado di analizzare grandi quantità di codice e individuare vulnerabilità con una velocità che fino a pochi anni fa sarebbe stata impraticabile. Il risultato è una crescita esponenziale dei bug scoperti e segnalati.

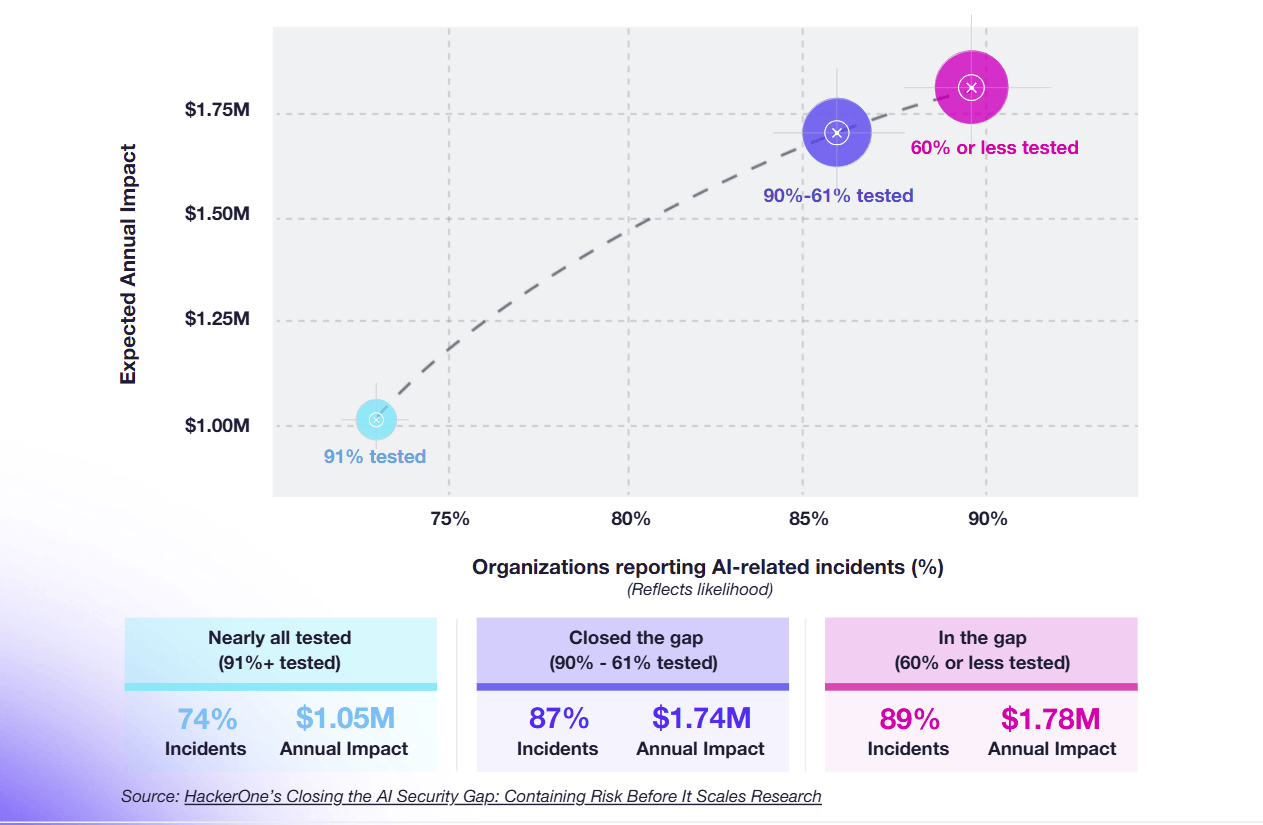

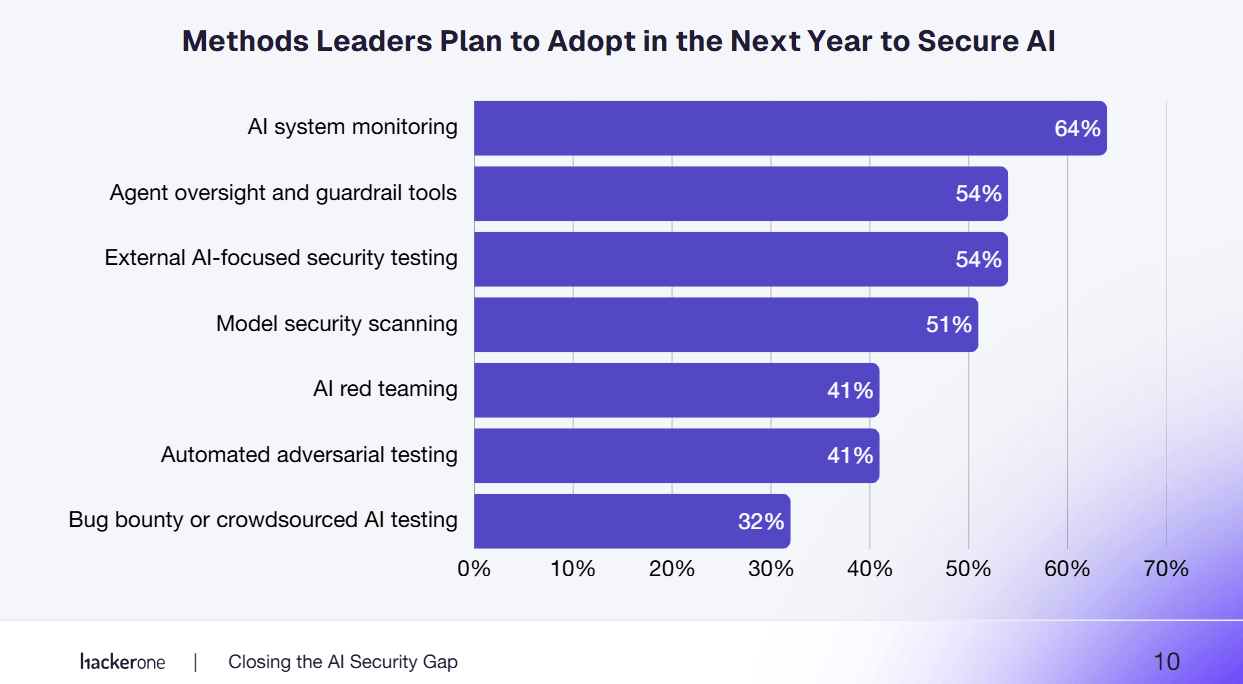

Secondo dati diffusi dalla piattaforma di sicurezza HackerOne, nel 2025 le segnalazioni di vulnerabilità sono aumentate del 76% rispetto all’anno precedente. Nello stesso periodo, il tempo medio necessario per correggerle è passato da 160 a 230 giorni. Una dinamica che apre un divario tra la scoperta delle falle e la loro effettiva risoluzione.

Indice degli argomenti:

Mythos e la nuova corsa alla sicurezza

Il modello Mythos non è un prodotto destinato al pubblico. Anthropic ha dichiarato di lavorare con circa 50 aziende e organizzazioni per individuare e correggere vulnerabilità prima che possano essere sfruttate. Il gruppo, attraverso il suo team Frontier Red Team, valuta i rischi legati all’uso dell’intelligenza artificiale.

Logan Graham, responsabile del team, ha spiegato che la distribuzione del sistema richiede garanzie ancora difficili da ottenere. Il timore è che strumenti di questo tipo, se resi disponibili senza controlli, possano diventare armi nelle mani di attori malevoli.

Anche altri operatori del settore si stanno muovendo.

OpenAI sta sviluppando una versione dei propri modelli orientata alla sicurezza, destinata agli sviluppatori per correggere i sistemi prima che i bug vengano scoperti dai criminali.

Google ha annunciato iniziative simili con accesso anticipato per programmatori.

La competizione non riguarda solo il mercato dell’AI, ma la capacità di controllare gli effetti collaterali di tecnologie sempre più potenti.

Il rischio sistemico: infrastrutture fragili

Il problema non riguarda soltanto la quantità di vulnerabilità individuate, ma la struttura stessa del software moderno. Molti sistemi si basano su componenti open source sviluppati in modo collaborativo, spesso da volontari.

Anthony Alvernaz, cofondatore della piattaforma Numeric, ha descritto questa architettura come una torta a più strati: il codice proprietario rappresenta solo la superficie, mentre sotto si trovano numerosi livelli di software condiviso.

Queste componenti costituiscono l’infrastruttura di base di internet, ma non sempre dispongono delle risorse necessarie per gestire un aumento massiccio di segnalazioni. Il rischio è che gli sviluppatori più piccoli vengano sommersi da richieste di correzione, senza la capacità di intervenire rapidamente.

Quando l’AI trova errori dimenticati

Il bug scoperto nel sistema operativo OpenBSD risale al 1998. A scrivere quella porzione di codice fu il ricercatore di sicurezza Niels Provos, allora dottorando presso l’Università del Michigan.

Dopo la scoperta da parte di Mythos, Provos ha verificato rapidamente e ha confermato che l’errore era effettivamente suo. Ha raccontato di aver trovato la situazione “divertente”, sottolineando come quel codice fosse così vecchio da non essere probabilmente analizzato da anni.

In passato, individuare un errore simile avrebbe richiesto settimane o mesi di lavoro umano altamente specializzato. Oggi, un sistema di AI può farlo in pochi giorni, utilizzando risorse di calcolo relativamente contenute.

Anthropic ha stimato che Mythos ha impiegato circa 20mila dollari di potenza computazionale per trovare decine di vulnerabilità in due giorni.

Dalla scoperta allo sfruttamento

La fase più critica non è la scoperta del bug, ma il tempo che intercorre tra la sua individuazione e il suo sfruttamento.

Otto anni fa, secondo il ricercatore Thomas Ptacek, il tempo medio tra la divulgazione pubblica di una vulnerabilità e il suo utilizzo in un attacco era di 847 giorni. Nel 2025 è sceso a 23 giorni. Nel 2026, molti exploit vengono sviluppati entro 24 ore.

L’intelligenza artificiale accelera anche questa fase. Non solo individua le falle, ma è sempre più efficace nello scrivere codice capace di sfruttarle. Anthropic ha riferito che Mythos è già in grado di generare exploit funzionanti in ambienti di test.

In un caso documentato, il modello ha individuato oltre 100 vulnerabilità nel browser Mozilla Firefox ed è riuscito a sviluppare codice per sfruttarne almeno una. Nella versione reale del software, sistemi di sicurezza aggiuntivi avrebbero impedito l’attacco, ma l’esperimento dimostra la rapidità con cui queste tecnologie possono essere utilizzate.

Hacker e difensori: un equilibrio che cambia

Storicamente, la cybersicurezza è stata una corsa tra chi attacca e chi difende. L’introduzione dell’AI modifica i rapporti di forza.

Sergej Epp, responsabile della sicurezza informatica presso Sysdig, ha raccontato di aver trovato diverse vulnerabilità in breve tempo utilizzando strumenti AI, nonostante non cercasse bug da oltre un decennio.

Durante una conferenza, Epp ha presentato un progetto chiamato “Zero-Day Clock”, ispirato al Doomsday Clock del Bulletin of the Atomic Scientists. Il sito mostra la velocità con cui nuove vulnerabilità vengono trasformate in strumenti di attacco.

Secondo Epp, l’AI sta fornendo “superpoteri agli hacker più che ai difensori”. Una valutazione che riflette una preoccupazione crescente nel settore.

La risposta delle istituzioni

Negli Stati Uniti, la Casa Bianca ha avviato un coordinamento tra settore pubblico e privato per affrontare il problema. Tra i protagonisti c’è il direttore nazionale per la cybersicurezza, Sean Cairncross, impegnato nell’identificazione delle vulnerabilità nei sistemi governativi.

L’obiettivo è anticipare gli attacchi, rafforzare le infrastrutture e sviluppare standard comuni per la gestione dei bug. Il modello richiama, per dimensioni e complessità, lo sforzo globale legato al problema Y2K alla fine degli anni Novanta (cosiddetto “Millenium bug”).

Allora, il rischio riguardava l’incapacità dei sistemi informatici di gestire il passaggio al nuovo millennio. Oggi, la sfida è gestire una quantità crescente di vulnerabilità generate e individuate con strumenti automatizzati.

Impatti economici e mercato

Le implicazioni non sono solo tecnologiche. Gli investitori stanno monitorando il settore con attenzione, temendo effetti strutturali sull’industria del software.

Nella settimana successiva alle prime notizie su Mythos, diversi titoli di aziende di cybersicurezza hanno registrato cali. Il timore è che l’aumento delle vulnerabilità renda più complesso il modello di business tradizionale, basato sulla prevenzione e sulla gestione dei rischi.

Allo stesso tempo, cresce la domanda di strumenti avanzati di sicurezza e di soluzioni basate sull’AI. Le aziende che riusciranno a integrare queste tecnologie potrebbero ottenere un vantaggio competitivo significativo.

Prodotti “minori” nel mirino

Un altro elemento di rischio riguarda i prodotti tecnologici meno diffusi. In passato, molti sistemi di nicchia non venivano presi di mira semplicemente perché non erano abbastanza interessanti per gli hacker.

Con l’AI, questa barriera si riduce. È possibile analizzare automaticamente grandi quantità di software, individuando vulnerabilità anche in prodotti poco conosciuti.

Ptacek sottolinea che diventerà più facile attaccare componenti dell’infrastruttura che in precedenza non erano considerati obiettivi. Le aziende che sviluppano questi prodotti spesso non dispongono delle risorse necessarie per gestire un’ondata di correzioni.

Una sfida logistica globale

Il problema principale non è l’esistenza delle vulnerabilità, ma la capacità di correggerle in tempi adeguati.

La crescita del numero di bug segnalati crea una pressione senza precedenti sui team di sviluppo. Ogni vulnerabilità richiede analisi, verifica, sviluppo della patch e distribuzione dell’aggiornamento.

Molte organizzazioni non hanno processi strutturati per gestire volumi così elevati. Il rischio è che alcune falle rimangano aperte abbastanza a lungo da essere sfruttate.

Nel caso del bug OpenBSD, il problema è rimasto nascosto per decenni senza conseguenze note. In un contesto dominato dall’AI, lo stesso scenario potrebbe portare a un exploit nel giro di ore.

Una trasformazione irreversibile

L’uso dell’intelligenza artificiale nella scoperta delle vulnerabilità segna un punto di svolta nella sicurezza informatica. Le tecnologie che permettono di individuare errori più rapidamente possono anche essere utilizzate per sfruttarli.

Il settore si trova davanti a una doppia sfida: sviluppare strumenti difensivi altrettanto avanzati e riorganizzare i processi di gestione del software.

Le aziende tecnologiche stanno investendo in automazione, test continui e sistemi di risposta rapida. Ma la scala del problema richiede un coordinamento più ampio, che coinvolga governi, industria e comunità open source.

La questione aperta

Il ritmo con cui l’AI individua vulnerabilità supera, per ora, la capacità di correggerle. Questa asimmetria rappresenta il nodo centrale della fase attuale.

Se la tecnologia continuerà a evolversi senza strumenti adeguati di controllo, il rischio è un aumento degli attacchi e una maggiore instabilità delle infrastrutture digitali.

La capacità di colmare questo divario determinerà non solo la sicurezza dei sistemi informatici, ma anche la fiducia nell’intero ecosistema digitale su cui si basa l’economia globale.