Claude Opus 4.7 è il modello più avanzato di Anthropic, ma non è il più potente che possiede: Mythos Preview, che resta chiuso in un circolo ristretto di una quarantina di partner enterprise, e nella comunicazione ufficiale fa capolino come benchmark di riferimento rispetto al quale Opus 4.7, testualmente, si ferma un passo prima.

analisi

Opus 4.7 e il dilemma di Anthropic, l’AI di frontiera che l’azienda ha deciso di non vendere

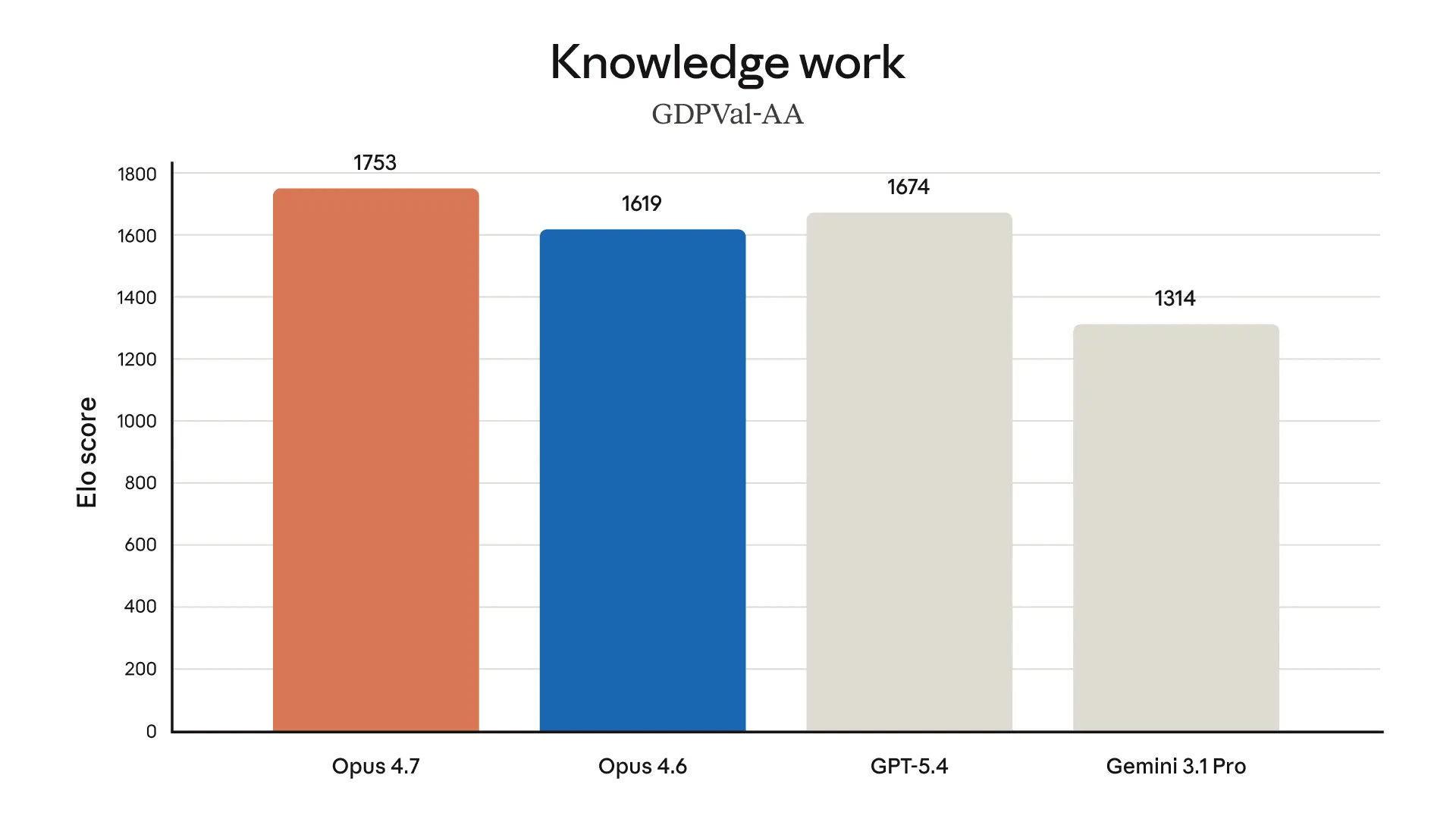

Claude Opus 4.7 segna un upgrade incrementale sul coding agentico e la vision, ma il suo rilascio fa notizia soprattutto per ciò che comunica: esiste un modello più potente, Mythos Preview, che Anthropic ha deciso di rilasciare a un distretto gruppo di aziende. Analisi critica del lancio, della comparazione con GPT-5.4 e Gemini 3.1 Pro, e di cosa accelera davvero questo cambiamento

Consulente in trasformazione digitale – AI & product strategy

Continua a leggere questo articolo

Argomenti

Canali