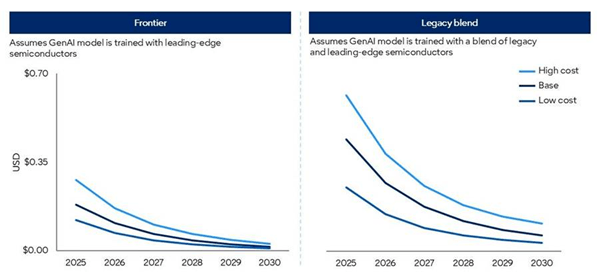

Secondo le previsioni di Gartner, entro il 2030 eseguire inferenze su un large language model (LLM) con un trilione di parametri costerà oltre il 90% in meno rispetto al 2025. Un cambiamento radicale che promette di ridefinire l’economia dell’intelligenza artificiale generativa.

I token, unità fondamentali di elaborazione per i modelli GenAI — equivalenti a circa 3,5 byte o 4 caratteri — diventeranno progressivamente più economici, riducendo drasticamente i costi operativi per i provider.

Indice degli argomenti:

Le leve tecnologiche dietro la rivoluzione

Alla base di questo calo ci sono diversi fattori: miglioramenti nell’efficienza dei semiconduttori, infrastrutture più avanzate, innovazioni nel design dei modelli e un utilizzo più intensivo dei chip.

Come spiega Will Sommer, senior director analyst di Gartner, un ruolo chiave sarà giocato anche dai chip specializzati per l’inferenza e dall’adozione crescente di dispositivi edge per casi d’uso specifici.

Modelli più efficienti: fino a 100 volte meglio

L’evoluzione non riguarda solo i costi assoluti, ma anche l’efficienza. Sempre secondo Gartner, entro il 2030 gli LLM saranno fino a 100 volte più efficienti rispetto ai primi modelli di dimensioni simili sviluppati nel 2022.

Le previsioni si basano su due scenari distinti:

- Frontier: basato su chip di ultima generazione

- Legacy blend: basato su un mix rappresentativo di semiconduttori disponibili

Nel secondo caso, i costi risultano significativamente più elevati a causa della minore potenza computazionale.

Il paradosso dei costi: meno per token, più in totale

Nonostante il crollo dei costi unitari, le aziende non vedranno necessariamente bollette più leggere. I fornitori di GenAI, infatti, potrebbero non trasferire completamente i risparmi ai clienti enterprise.

Inoltre, i modelli più avanzati richiederanno molti più token per funzionare. I modelli agentici, ad esempio, consumano da 5 a 30 volte più token per ogni attività rispetto ai chatbot tradizionali, pur essendo in grado di svolgere compiti molto più complessi.

Il risultato? Anche se ogni token costa meno, il consumo complessivo cresce più rapidamente, facendo aumentare il costo totale dell’inferenza.

Perché l’AI avanzata non sarà davvero democratica

“La riduzione del costo dei token non equivale alla democratizzazione dell’intelligenza avanzata”, avverte Sommer.

Mentre l’intelligenza “commodity” tende verso costi quasi nulli, le risorse necessarie per il ragionamento avanzato — infrastrutture, potenza computazionale e sistemi complessi — restano limitate e costose.

Questo significa che l’accesso alle capacità più sofisticate dell’AI potrebbe rimanere concentrato nelle mani di pochi grandi player.

La strategia vincente: orchestrare modelli diversi

Secondo Gartner, il valore si sposterà verso piattaforme capaci di orchestrare diversi modelli in modo intelligente.

Le attività ripetitive e ad alta frequenza dovranno essere affidate a modelli più piccoli e specializzati, spesso più efficienti ed economici rispetto a quelli generalisti.

Al contrario, i modelli di frontiera — più costosi — dovranno essere riservati a compiti complessi e ad alto valore aggiunto.

Verso un nuovo equilibrio dell’AI

Il futuro della GenAI non sarà definito solo dal costo dei token, ma dalla capacità di bilanciare efficienza, complessità e valore.

La sfida per le aziende non sarà semplicemente spendere meno, ma spendere meglio: scegliendo quando usare l’intelligenza più potente e quando, invece, puntare su soluzioni più snelle e sostenibili.