A poco più di un anno dall’avvio del piano “AI Continent”, la Commissione europea traccia un primo bilancio: l’obiettivo è costruire un ecosistema dell’intelligenza artificiale che coniughi sviluppo industriale, tutela dei diritti e autonomia strategica.

La visione presentata dalla vicepresidente esecutiva Henna Virkkunen si fonda su un approccio che punta a ridurre i rischi senza frenare l’innovazione. Un equilibrio che attraversa l’intero impianto normativo e industriale europeo, mentre si avvicina una scadenza decisiva: l’entrata in vigore, il 2 agosto 2026, degli obblighi per i sistemi ad alto rischio previsti dall’AI Act.

Indice degli argomenti:

Il piano europeo: infrastrutture, dati e competenze

Il piano d’azione della Commissione si articola in cinque pilastri:

- infrastrutture,

- dati,

- competenze,

- adozione

- semplificazione.

Sul fronte infrastrutturale, sono state avviate 19 “AI Factories” integrate nei supercomputer europei. A queste si aggiunge il progetto delle “Gigafactories” dell’intelligenza artificiale, che ha già raccolto 76 manifestazioni di interesse in 16 Stati membri.

L’obiettivo è rafforzare la capacità di calcolo e creare un’infrastruttura comune per lo sviluppo di modelli avanzati. Parallelamente, la Commissione ha mobilitato un miliardo di euro in bandi destinati a settori strategici, tra cui sanità e industria.

Tra le iniziative più concrete figurano i centri di screening oncologico e cardiovascolare basati su AI e una competizione europea per sviluppare modelli di intelligenza artificiale “sovrani”, cioè progettati e gestiti all’interno dell’ecosistema europeo.

L’AI Act e il nodo dell’Omnibus

Accanto alle politiche industriali, l’Unione Europea sta intervenendo sul quadro normativo. Il cosiddetto “AI Omnibus”, presentato nel novembre 2025, punta a rivedere la tempistica di applicazione dell’AI Act e a risolvere criticità emerse nella fase di implementazione.

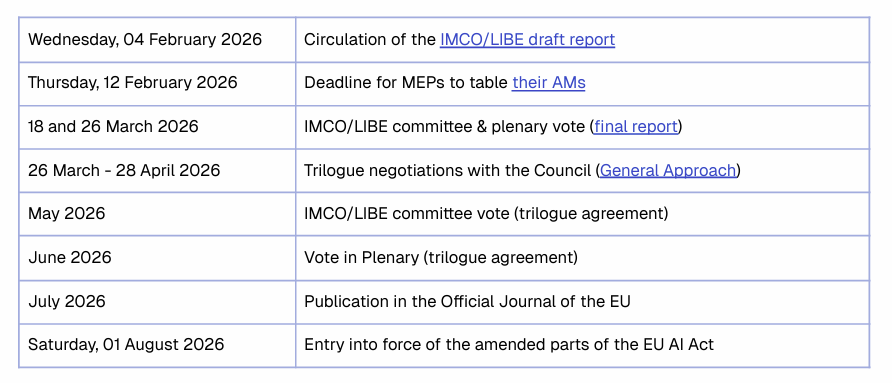

Il calendario legislativo è serrato. Dopo il voto del Parlamento europeo del 26 marzo 2026, i negoziati tra le istituzioni sono entrati nella fase finale.

Gli incontri tecnici si sono svolti per tutto aprile, mentre un passaggio politico chiave è previsto per il 28 aprile.

Secondo la tabella di marcia, un eventuale accordo porterebbe al voto nelle commissioni parlamentari a maggio, al voto plenaria a giugno e alla pubblicazione in Gazzetta ufficiale a luglio, a ridosso dell’entrata in vigore degli obblighi per i sistemi ad alto rischio.

Le regole sui modelli general-purpose

Uno dei nodi più complessi riguarda i modelli di intelligenza artificiale general-purpose, cioè sistemi capaci di svolgere molteplici funzioni e applicazioni. Un gruppo di ricerca dell’Università di Cambridge ha pubblicato il primo commento accademico dedicato esclusivamente a queste disposizioni dell’AI Act.

Il lavoro, avviato dal Leverhulme Centre for the Future of Intelligence insieme all’Institute for Law & AI della Cambridge University, analizza le ambiguità interpretative della normativa. In particolare, si concentra sui modelli che possono generare rischi sistemici.

Gli autori non propongono una lettura unica, ma mappano le diverse interpretazioni possibili, distinguendo tra norme chiare e aree di incertezza. L’obiettivo è fornire una base giuridica solida per l’applicazione delle regole, in un ambito dove le tecnologie evolvono più rapidamente delle leggi.

Un ecosistema sottovalutato

Secondo Kleitia Zeqo, consulente del gruppo Technopolis, l’Europa tende a sottovalutare il proprio ruolo nell’intelligenza artificiale. Il continente ospita un numero rilevante di aziende del settore, una quota significativa della ricerca globale e competenze ingegneristiche concentrate in paesi come Francia, Germania e Regno Unito.

In questo contesto, l’AI Act non rappresenta un ostacolo allo sviluppo, ma una infrastruttura istituzionale. Zeqo individua tre vantaggi principali.

- Il primo è l’esistenza di un quadro normativo unico per 27 Stati membri, a differenza degli Stati Uniti, dove esistono oltre 35 normative a livello statale sull’intelligenza artificiale.

- Il secondo è l’approccio basato sul rischio, che limita gli obblighi ai casi con maggiore impatto, lasciando gran parte delle applicazioni senza regolazione stringente.

- Il terzo è la capacità di adattamento dimostrata attraverso strumenti come il codice di condotta multi-stakeholder per i modelli general-purpose.

Accanto alla competitività, resta centrale il tema dei rischi sistemici e sociotecnici. La governance, secondo Zeqo, serve a mantenere il controllo sull’uso delle tecnologie e a garantire responsabilità e sostenibilità sociale.

Il caso Anthropic e l’accesso ai modelli avanzati

Il dibattito sull’autonomia europea si intreccia con un caso concreto: la decisione della società statunitense Anthropic di limitare l’accesso al suo nuovo modello, denominato Mythos. L’azienda sostiene che il sistema sia in grado di superare la maggior parte degli esseri umani nell’individuare e sfruttare vulnerabilità informatiche.

Anthropic ha selezionato dodici partner tecnologici con sede negli Stati Uniti, tra cui grandi gruppi del settore digitale, e ha concesso accesso anche all’AI Security Institute del Regno Unito per attività di test.

Le autorità europee, invece, sono rimaste in gran parte escluse. Su otto agenzie nazionali di cybersicurezza contattate, solo quella tedesca ha avviato interlocuzioni con l’azienda, senza però ottenere accesso diretto al modello.

Alcuni esperti hanno espresso preoccupazione. Il ricercatore Yoshua Bengio ha definito la situazione “profondamente preoccupante”, sottolineando che decisioni con impatti rilevanti vengono prese da attori privati. L’ex europarlamentare Marietje Schaake ha richiamato il rischio di una governance privata di tecnologie con effetti su larga scala.

Le risorse per la governance europea

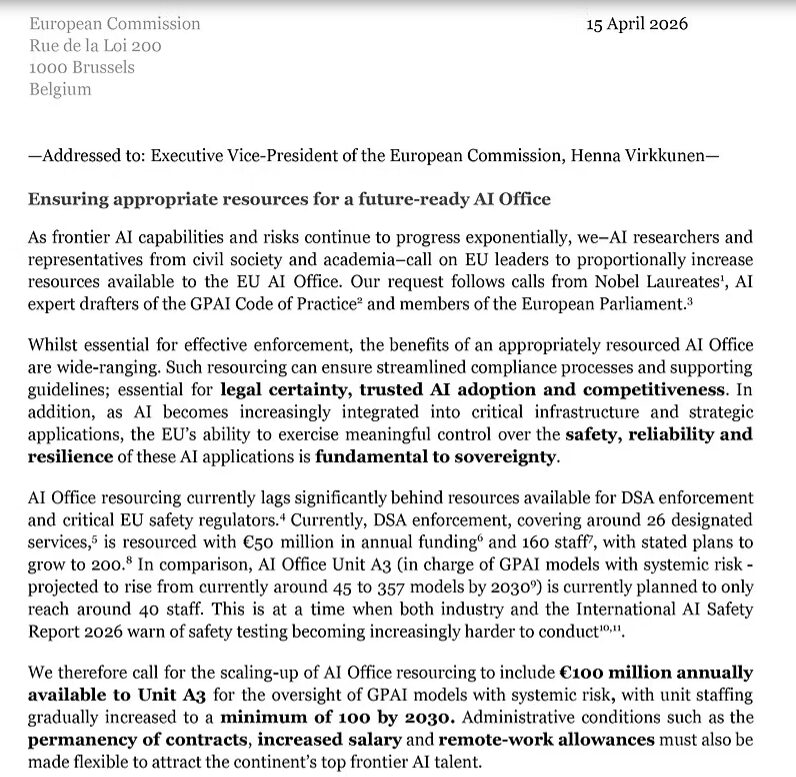

Un altro punto critico riguarda le risorse destinate alla supervisione dell’intelligenza artificiale. Una coalizione di organizzazioni della società civile, imprese ed esperti ha inviato una lettera alla Commissione europea chiedendo un rafforzamento dell’AI Office.

Il confronto con il Digital Services Act è indicativo. L’applicazione di questa normativa coinvolge circa 26 servizi digitali designati, con un budget annuale di 50 milioni di euro e circa 160 dipendenti. L’unità A3 dell’AI Office, incaricata di monitorare i modelli general-purpose con rischi sistemici, dovrebbe invece raggiungere solo 40 addetti.

I firmatari chiedono uno stanziamento di 100 milioni di euro all’anno e un aumento progressivo del personale fino ad almeno 100 unità entro il 2030. Propongono anche condizioni contrattuali più flessibili, salari più competitivi e possibilità di lavoro da remoto per attrarre specialisti nel campo dell’intelligenza artificiale.

Secondo la lettera, il rafforzamento delle risorse non riguarda solo la tutela dei cittadini, ma rappresenta un investimento strategico per la competitività e la sovranità tecnologica europea.

Il dibattito sull’Annex I

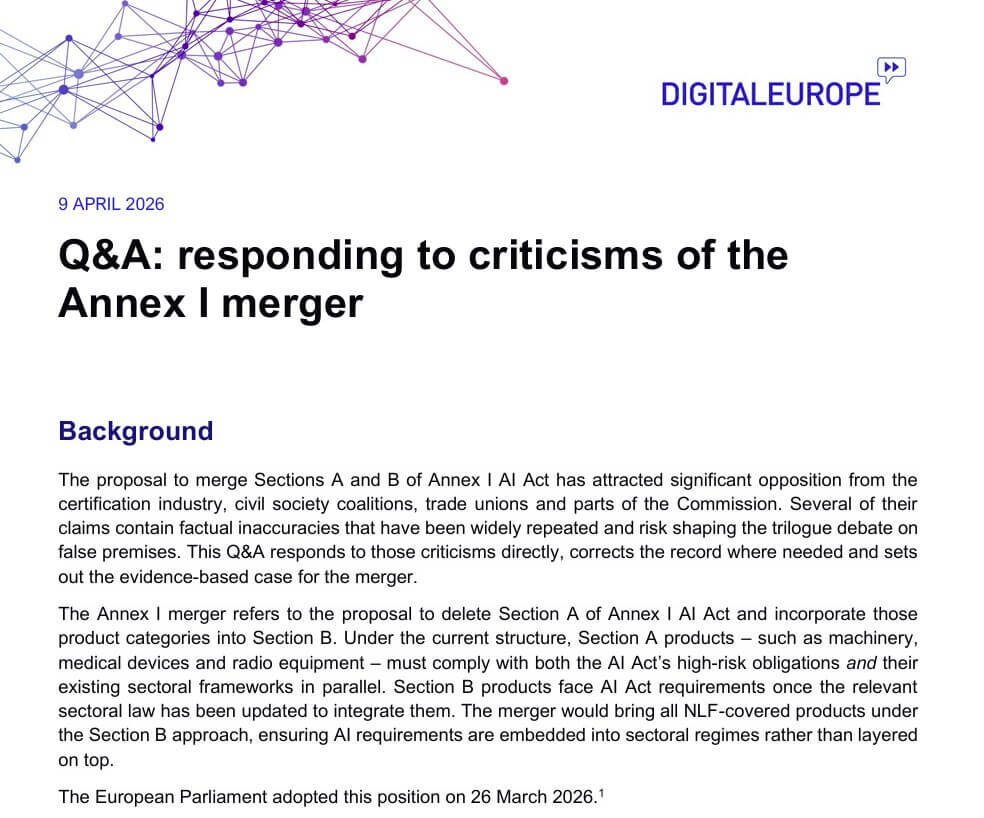

Tra le modifiche più discusse dell’AI Act figura la revisione dell’Annex I, che definisce l’ambito di applicazione delle regole per i sistemi ad alto rischio. L’associazione DIGITALEUROPE ha risposto alle critiche relative alla fusione delle sezioni A e B dell’allegato.

Nella struttura attuale, alcuni prodotti – come macchinari, dispositivi medici e apparecchi radio – devono rispettare sia le norme settoriali esistenti sia gli obblighi dell’AI Act. Altri prodotti sono soggetti alle regole sull’intelligenza artificiale solo dopo l’aggiornamento della normativa di settore.

La modifica approvata dal Parlamento europeo il 26 marzo 2026 prevede l’estensione del secondo approccio a tutti i prodotti coperti dal New Legislative Framework. Secondo DIGITALEUROPE, non si tratta di una deregolamentazione, ma della semplificazione di percorsi normativi sovrapposti, mantenendo invariati gli obblighi per i sistemi ad alto rischio.

Tra sovranità tecnologica e dipendenze globali

L’insieme di questi elementi delinea una tensione strutturale. Da un lato, l’Unione Europea punta a costruire una propria capacità industriale e normativa nell’intelligenza artificiale. Dall’altro, resta esposta alle decisioni delle grandi aziende tecnologiche globali, in particolare statunitensi.

Il tema dell’accesso ai modelli di frontiera diventa centrale. Senza la possibilità di testare e utilizzare queste tecnologie, regolatori e imprese europee rischiano di operare in una posizione di svantaggio.

La Commissione ha annunciato un prossimo pacchetto sulla sovranità tecnologica, con interventi su data center e produzione di chip. Si tratta di un passaggio necessario per ridurre la dipendenza da fornitori esterni e rafforzare la capacità interna.

Una fase decisiva per l’AI Act

L’avvicinarsi dell’agosto 2026 segna un momento di verifica per l’intero impianto dell’AI Act. Le istituzioni europee devono completare il processo legislativo, chiarire le aree di incertezza e dotarsi delle risorse necessarie per l’applicazione delle norme.

Le imprese, dal canto loro, si confrontano con un quadro regolatorio che introduce obblighi specifici per i sistemi ad alto rischio, ma lascia margini di flessibilità per la maggior parte delle applicazioni.

Le scelte dei prossimi mesi incideranno sulla capacità dell’Europa di affermarsi nel campo dell’intelligenza artificiale, non solo come regolatore, ma anche come attore industriale e tecnologico.

Date chiave