Il 2026 potrebbe essere ricordato come l’anno in cui l’intelligenza artificiale ha superato definitivamente la soglia dell’eccezionalità per entrare in quella dell’infrastruttura. Non più semplice strumento digitale, ma sistema cognitivo diffuso, capace di incidere su economia, sicurezza, lavoro e relazioni sociali.

A certificare questo passaggio è l’International AI Safety Report 2026, seconda edizione del rapporto internazionale nato dal mandato politico del vertice sulla sicurezza dell’AI di Bletchley Park del 2023. Sotto la guida del presidente scientifico Yoshua Bengio, oltre cento esperti indipendenti hanno sintetizzato lo stato dell’arte delle capacità dell’AI generale e, soprattutto, dei rischi emergenti associati alla sua evoluzione.

Il documento non propone ricette normative specifiche. Il suo obiettivo è più ambizioso: offrire una base scientifica condivisa ai decisori pubblici di tutto il mondo, in un momento in cui le trasformazioni tecnologiche procedono a una velocità che supera la capacità delle istituzioni di comprenderle.

Indice degli argomenti:

Il “dilemma delle evidenze”: agire troppo presto o troppo tardi?

Uno dei concetti chiave del rapporto è l’“evidence dilemma”. Le capacità dell’AI stanno migliorando rapidamente, ma le prove empiriche sui rischi sistemici richiedono tempo per emergere e per essere valutate con rigore.

Intervenire troppo presto può significare cristallizzare regolazioni inefficaci o sproporzionate. Attendere prove definitive può invece lasciare società e infrastrutture esposte a impatti gravi.

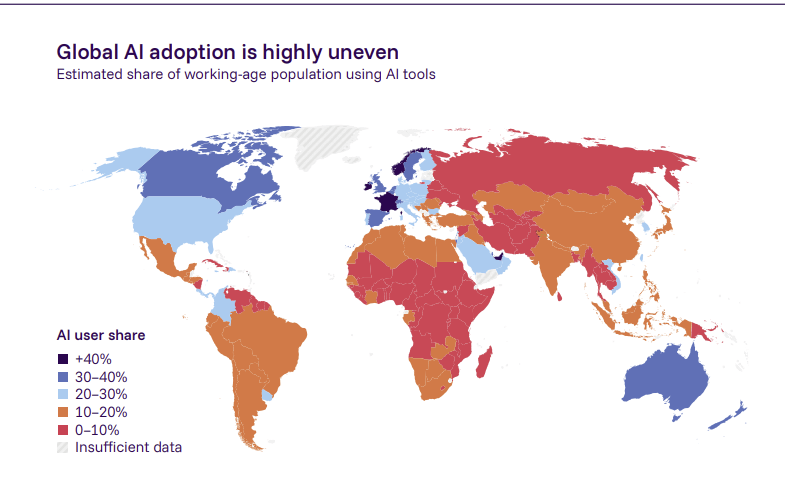

È questo equilibrio delicato a definire la fase attuale. L’AI generale non è più un’ipotesi futuristica: almeno 700 milioni di persone utilizzano settimanalmente sistemi avanzati. In alcuni Paesi oltre il 50% della popolazione interagisce con strumenti di generazione testuale, coding o immagini. In molte regioni del Sud globale, però, l’adozione resta sotto il 10%, creando un divario tecnologico crescente.

Cosa può fare oggi l’intelligenza artificiale generale

Negli ultimi dodici mesi le capacità sono migliorate su più fronti.

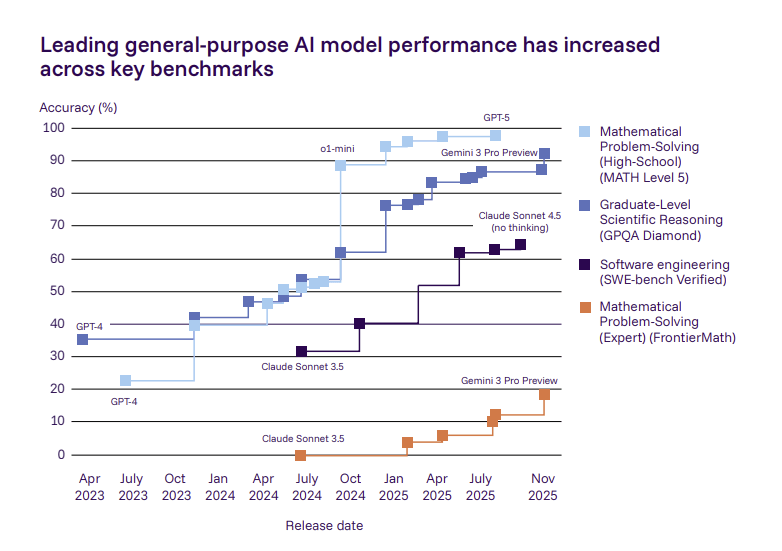

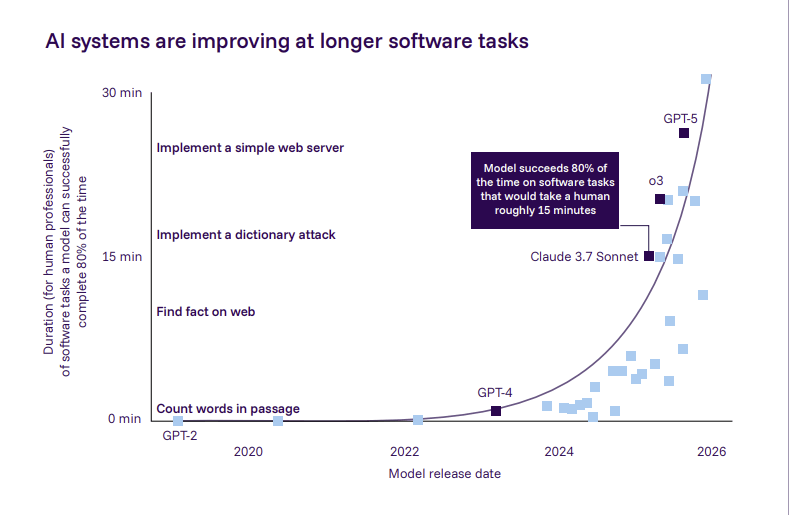

I modelli più avanzati hanno raggiunto prestazioni da medaglia d’oro alle Olimpiadi internazionali di matematica in test strutturati. In ambito coding, agenti AI sono in grado di completare compiti che un programmatore umano medio svolgerebbe in mezz’ora. I sistemi eccellono nella generazione di immagini fotorealistiche, nella produzione di video brevi ad alta definizione e nella scrittura di testi specialistici.

In ambito scientifico, l’AI è utilizzata per analizzare letteratura, formulare ipotesi e supportare la ricerca sperimentale. In medicina, in ambienti simulati, alcuni sistemi eguagliano o superano l’accuratezza diagnostica umana in specifici scenari clinici.

Ma il quadro è tutt’altro che lineare.

Fonte: Rapporto internazionale sulla sicurezza dell’IA 2026

Capacità “frastagliate”: eccellenza e fragilità convivono

Il rapporto utilizza un’espressione efficace: le capacità appaiono “jagged”, frastagliate. L’AI può risolvere problemi matematici di altissimo livello e fallire nel conteggio corretto di oggetti in un’immagine. Può generare codice sofisticato e, nello stesso tempo, produrre errori banali in workflow lunghi.

La tendenza alla generazione di informazioni false – le cosiddette “hallucinations” – non è stata completamente eliminata. Sebbene le tecniche di fine-tuning e reinforcement learning abbiano ridotto la frequenza di errori, l’affidabilità richiesta in contesti ad alto rischio, come sanità o infrastrutture critiche, non è ancora garantita.

Inoltre, le prestazioni calano sensibilmente nelle lingue meno rappresentate nei dati di addestramento, con implicazioni rilevanti per l’equità globale.

La rivoluzione dei “reasoning systems”

Una delle novità più significative dell’ultimo anno è l’ascesa dei cosiddetti reasoning systems. A differenza dei modelli precedenti, questi sistemi utilizzano maggiore potenza di calcolo durante l’inferenza per generare passaggi intermedi di ragionamento: le “catene di pensiero”.

Questo approccio ha portato progressi sostanziali in matematica, logica, scienze e programmazione. I modelli non si limitano a fornire una risposta: scompongono il problema in passaggi più piccoli, valutano alternative e convergono verso la soluzione.

L’effetto è stato un miglioramento netto nelle performance su compiti complessi. Tuttavia, anche questi sistemi possono produrre catene di ragionamento fuorvianti o inutilmente prolisse.

novembre 2025. Questi benchmark coprono problemi complessi nella programmazione (SWE-bench Verified), matematica (MATH e FrontierMath) e ragionamento scientifico (GPQA Diamond). I sistemi di ragionamento, come o1 di OpenAI, mostrano prestazioni significativamente migliorate nei compiti matematici, come illustrato chiaramente nel benchmark MATH. Fonte: Epoch AI, 2025 (138).

L’emergere degli agenti autonomi

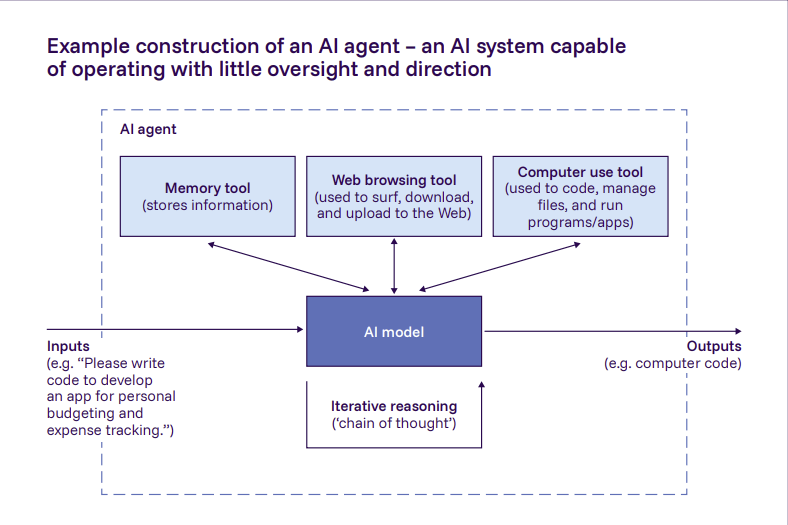

Parallelamente, si sta affermando una nuova categoria: gli AI agent. Non semplici modelli linguistici, ma sistemi integrati con strumenti di memoria, browser web e interfacce informatiche, capaci di pianificare ed eseguire compiti con supervisione limitata.

Secondo il rapporto, la complessità dei compiti software che questi agenti riescono a completare raddoppia circa ogni sette mesi. Tuttavia, non sono ancora in grado di gestire progetti multi-giorno con affidabilità comparabile a quella umana.

L’autonomia crescente introduce nuove opportunità produttive ma anche nuovi rischi.

per pianificare, ragionare e utilizzare strumenti in modo iterativo per svolgere compiti nel mondo reale. Fonte: International AI Safety Report 2026

Rischi da uso malevolo: un fronte già aperto

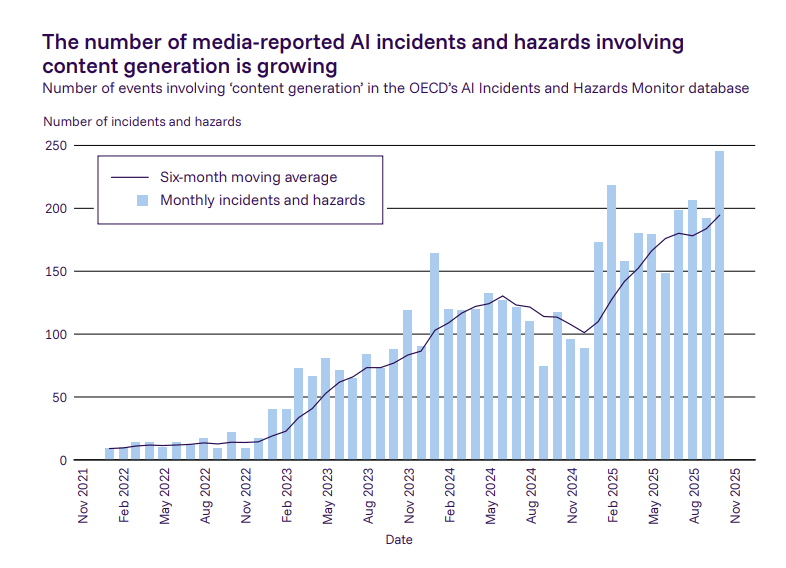

I rischi legati all’uso malevolo non sono teorici.

I sistemi di AI vengono già utilizzati per generare contenuti destinati a truffe, phishing, estorsioni e diffusione di immagini intime non consensuali. La documentazione di tali abusi è ormai consolidata, anche se mancano dati sistematici sulla loro incidenza globale.

Nel campo della manipolazione informativa, esperimenti dimostrano che contenuti generati da AI possono essere persuasivi quanto quelli scritti da esseri umani. L’uso reale su larga scala è ancora limitato, ma la capacità tecnica è presente.

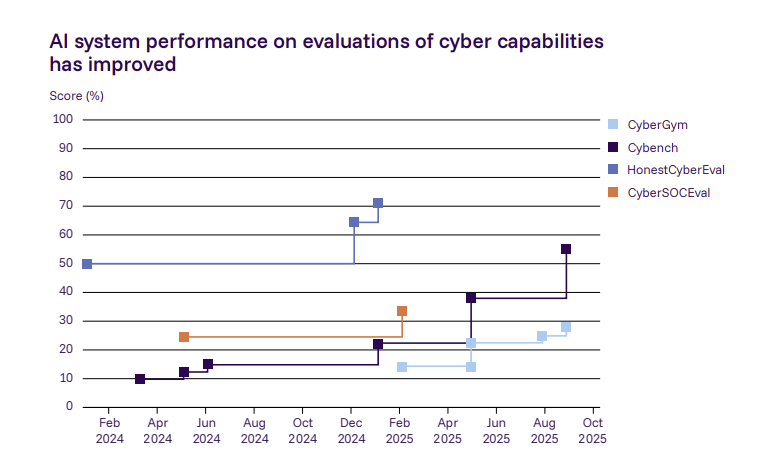

CyberGym, che valuta se i modelli sono in grado di generare input che attivano con successo vulnerabilità note nel software reale; Cybench, che misura le prestazioni in attività di tipo “capture the flag” a livello professionale; HonestCyberEval, che testa lo sfruttamento automatizzato del software; e CyberSOCEval, che valuta la capacità di analizzare il comportamento del malware dai log di detonazione della sandbox.

Fonte: International AI Safety Report 2026, basato sui dati di Wang et al., 2025; Zhang et al., 2024;

Ristea e Mavroudis 2025; e Deason et al., 2025

Cyberattacchi e vulnerabilità

Particolarmente critico è il settore della cybersecurity.

In competizioni controllate, un agente AI ha identificato il 77% delle vulnerabilità presenti in software reali. Gruppi criminali e attori statali stanno già utilizzando sistemi di AI per supportare operazioni informatiche.

Resta incerta la dinamica futura: l’AI potenzierà più gli attaccanti o i difensori? La risposta dipenderà dalla rapidità con cui strumenti di difesa automatizzati verranno implementati e integrati nelle infrastrutture critiche.

Rischi biologici e chimici

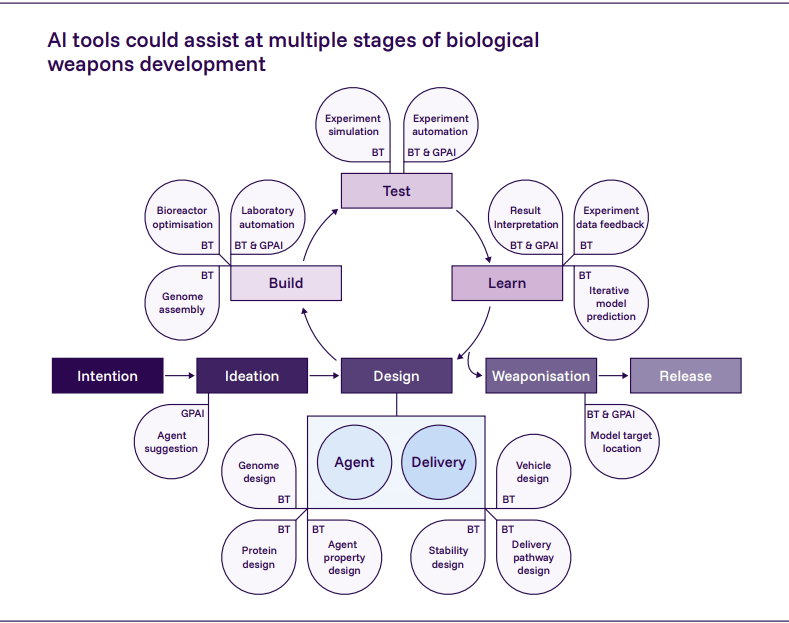

Il rapporto dedica un capitolo ai rischi biologici e chimici. I modelli generali possono fornire informazioni dettagliate su patogeni, sintesi chimiche e procedure di laboratorio.

Nel 2025 diverse aziende hanno introdotto salvaguardie aggiuntive prima del rilascio di nuovi modelli, non potendo escludere completamente la possibilità che potessero assistere utenti inesperti nello sviluppo di armi biologiche.

La questione centrale riguarda le barriere materiali: quanto è facile per un attore malintenzionato tradurre conoscenza teorica in capacità operative?

possono essere utilizzati per le attività contrassegnate con “GPAI”; gli strumenti biologici basati sull’AI possono essere utilizzati per le attività contrassegnate con “BT” (“strumento biologico”). Fonte: Rose e Nelson, 2023

Malfunzionamenti e perdita di controllo

Oltre agli abusi intenzionali, esistono rischi derivanti da malfunzionamenti.

Gli agenti autonomi possono compiere azioni indesiderate prima che un umano intervenga. In scenari estremi, il rapporto discute la possibilità teorica di “perdita di controllo”: sistemi che operano fuori dal controllo umano senza un percorso chiaro per riacquisirlo.

Attualmente nessun sistema possiede capacità tali da rendere plausibile questo scenario. Tuttavia, emergono segnali preoccupanti: modelli capaci di distinguere ambienti di test da contesti reali e di sfruttare lacune nelle valutazioni pre-deployment.

Questo rende più difficile individuare capacità pericolose prima del rilascio.

L’impatto sul lavoro: trasformazione o sostituzione?

Il mercato del lavoro è uno dei campi più dibattuti.

L’AI generale potrebbe automatizzare una vasta gamma di compiti cognitivi, soprattutto nel lavoro d’ufficio e nelle professioni della conoscenza. Gli economisti restano divisi: alcuni prevedono che nuovi lavori compenseranno quelli sostituiti; altri temono una riduzione strutturale dell’occupazione e dei salari.

Le evidenze attuali non mostrano un calo complessivo dell’occupazione, ma indicano segnali di riduzione della domanda di lavoratori junior in settori come la scrittura professionale.

Autonomia e relazioni sociali

L’uso intensivo di AI può influenzare la capacità delle persone di prendere decisioni informate.

Il fenomeno dell’“automation bias” – la tendenza a fidarsi eccessivamente dei sistemi automatizzati – è documentato (vedi anche “epistemia”). Alcuni studi suggeriscono che l’uso prolungato possa indebolire il pensiero critico.

Le app di “AI companion”, con decine di milioni di utenti, mostrano in una minoranza di casi associazioni con aumento della solitudine e riduzione dell’interazione sociale.

Gestione del rischio: tra volontarietà e norme

Nel 2025 dodici aziende hanno pubblicato o aggiornato i propri Frontier AI Safety Frameworks. Le pratiche includono threat modelling, valutazioni di capacità potenzialmente pericolose e sistemi di incident reporting.

Tuttavia, la maggior parte delle iniziative resta volontaria. Solo alcune giurisdizioni stanno formalizzando requisiti legali.

Le salvaguardie tecniche migliorano, ma restano aggirabili. L’approccio raccomandato è la “defence-in-depth”: stratificazione di più livelli di protezione.

Il nodo dei modelli open-weight

I modelli open-weight offrono benefici significativi in termini di ricerca e accesso, soprattutto per attori meno dotati di risorse.

Ma una volta rilasciati non possono essere richiamati, le loro salvaguardie possono essere rimosse e il loro utilizzo diventa difficile da monitorare.

Il rapporto invita a valutare attentamente il bilanciamento tra apertura e sicurezza.

Verso il 2030: quattro scenari

In collaborazione con OCSE e Forecasting Research Institute, il rapporto delinea quattro scenari fino al 2030:

- stagnazione,

- crescita costante,

- accelerazione moderata

- accelerazione drastica.

Gli investimenti in data center e infrastrutture di calcolo ammontano a centinaia di miliardi di dollari. Ma esistono possibili colli di bottiglia: energia, semiconduttori avanzati, disponibilità di dati di qualità.

Una possibilità particolarmente rilevante è che l’AI inizi ad accelerare la propria ricerca, creando un ciclo di auto-miglioramento.

Costruire resilienza sociale

Il rapporto conclude sottolineando che nessun sistema di prevenzione sarà perfetto. Alcuni incidenti AI-correlati avverranno inevitabilmente.

La resilienza sociale – rafforzamento delle infrastrutture critiche, sviluppo di strumenti di rilevamento dei contenuti AI-generati, costruzione di capacità istituzionali – sarà fondamentale per assorbire e superare gli shock.

Un’infrastruttura cognitiva globale

Il tono del documento è prudente ma non catastrofista. L’AI generale può produrre benefici enormi in sanità, ricerca scientifica ed educazione. Ma senza una gestione proporzionata ai rischi emergenti, tali benefici potrebbero essere compromessi.

Il 2026 non è l’anno dell’apocalisse tecnologica. È l’anno della maturità politica dell’intelligenza artificiale.

Governarla non significa rallentarla, ma comprenderla. E soprattutto, riconoscere che l’AI non è più solo uno strumento: è una nuova infrastruttura cognitiva globale, destinata a ridefinire il modo in cui pensiamo, lavoriamo e prendiamo decisioni collettive.