Il Data and AI Impact Report: The Trust Imperative prova a leggere l’evoluzione dell’AI da un’angolazione diversa rispetto alle consuete rilevazioni sull’adozione. Il punto centrale non riguarda solo quante aziende usano strumenti di AI, ma quanto quei sistemi risultino davvero affidabili, spiegabili e governati.

La ricerca, commissionata da SAS con insight IDC, prende in esame 2.375 professionisti tra responsabili IT e business leader, distribuiti tra Nord America, America Latina, Europa, Medio Oriente, Africa e Asia-Pacifico.

Il report introduce due indicatori chiave:

- l’indice di AI affidabile, che misura la solidità di governance, trasparenza, conformità e gestione del rischio,

- l’indice di impatto, che valuta il ritorno concreto degli investimenti in termini di produttività, innovazione, customer experience, efficienza operativa e risultati economici.

Il messaggio di fondo è netto: la fiducia percepita nell’AI non coincide automaticamente con la sua affidabilità reale, e da questo disallineamento nasce quello che gli autori definiscono “dilemma della fiducia”.

Indice degli argomenti:

La fotografia globale: corsa all’AI, governance ancora incompleta

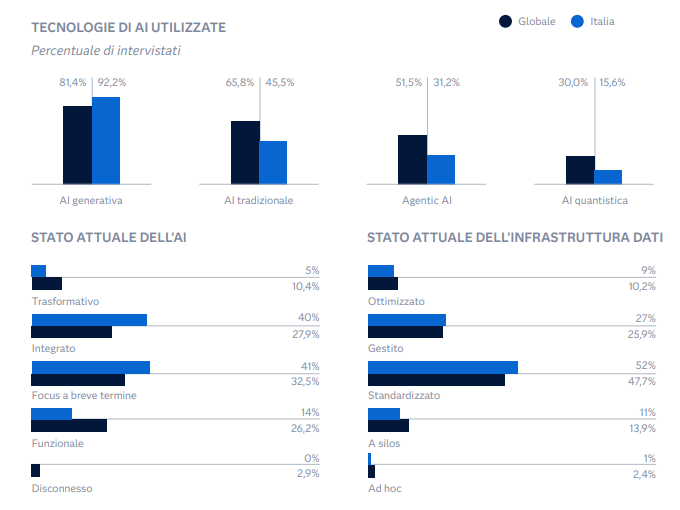

A livello globale, la tecnologia più diffusa è l’AI generativa, adottata dall’81% delle organizzazioni intervistate, davanti all’AI tradizionale al 66%, all’AI agentica al 52% e all’AI quantistica al 30%. Il dato più interessante, però, riguarda lo scarto tra entusiasmo e preparazione: il 78% dichiara piena fiducia nell’AI, ma solo il 40% afferma di avere investito davvero per rendere i sistemi affidabili attraverso governance, spiegabilità e garanzie etiche.

Secondo SAS, le organizzazioni che danno priorità all’AI affidabile hanno il 60% di probabilità in più di raddoppiare il ROI dei progetti di AI. Il problema, quindi, non riguarda l’adozione in sé, quanto la capacità di trasformarla in valore stabile.

Nel quadro globale, il “dilemma della fiducia” coinvolge quasi metà del campione: il report segnala un 35% di casi di eccessiva fiducia verso sistemi non abbastanza affidabili e un ulteriore 11% di sottoutilizzo di sistemi che potrebbero invece offrire valore.

Europa: più disciplina, ma il rischio resta elevato

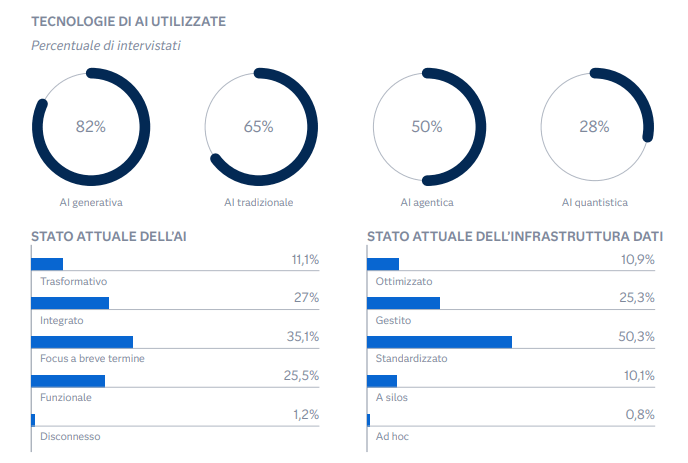

Nel contesto europeo, il quadro appare leggermente più ordinato rispetto alla media mondiale. L’adozione della GenAI si colloca in linea con il dato globale, mentre le imprese europee mostrano una maturità un po’ più alta sia sul fronte AI sia su quello delle infrastrutture dati.

Il report rileva che l’11,1% delle organizzazioni europee si definisce in fase “trasformativa”, contro il 10,4% globale, e che il 10,9% colloca la propria infrastruttura dati al livello “ottimizzato”, sopra il 10,2% mondiale.

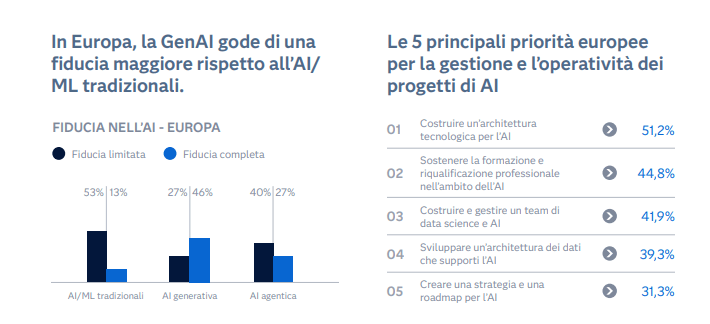

Questo vantaggio relativo, però, non basta a chiudere il gap della fiducia. In Europa la GenAI gode di più fiducia rispetto all’AI tradizionale, ma il 39% delle organizzazioni si trova nella cosiddetta “danger zone”, cioè in una condizione di alta fiducia verso la tecnologia senza un corrispondente livello di affidabilità pratica. Solo l’8% mostra un allineamento positivo tra fiducia e capacità di costruire sistemi davvero affidabili.

È un dato che suggerisce prudenza: anche nei mercati più regolati, la corsa all’AI procede più veloce delle strutture di controllo.

Italia: più avanti dei “piloti”, meno avanti sulla fiducia

Per l’Italia, il report descrive un sistema che ha superato in buona parte la fase dei test isolati. Le organizzazioni italiane risultano meno presenti nelle fasi iniziali e più concentrate nei livelli di “short-term focus” e “integrated”, segnale di un’adozione che ha già iniziato a entrare nei processi aziendali in modo più strutturato.

Anche sul piano dei dati il quadro appare relativamente solido, con una presenza più marcata nei livelli “standardized” e “managed” rispetto alla media globale.

Il problema emerge quando si osserva il rapporto tra fiducia e affidabilità. L’Italia registra un indice di AI affidabile pari a 2,73 su 5 e un indice di impatto di 3,01. In altri termini, il valore di business dichiarato esiste, ma poggia su fondamenta che il report considera ancora deboli.

Nella sezione dedicata al Paese, gli autori parlano esplicitamente di “trust dilemma”: molte organizzazioni italiane mostrano una fiducia elevata nell’AI, ma non dispongono ancora di sistemi, pratiche e controlli abbastanza robusti da giustificare quella fiducia.

Le vere criticità italiane: competenze, governance e qualità del dato

Il report individua con chiarezza i principali ostacoli che rallentano la maturità dell’AI in Italia. Il fattore che pesa di più è la mancanza di personale qualificato in ambito AI, indicata con uno scarto di +12,8% rispetto alla media globale. Seguono la debolezza della data governance, la carenza di competenze diffuse tra i dipendenti e un supporto manageriale ancora insufficiente.

Colpisce, invece, il dato sulla base dati centralizzata: in Italia viene percepita come un problema meno grave della media internazionale, segno che il nodo non è tanto l’infrastruttura pura quanto la capacità organizzativa di usarla bene.

Anche sul terreno normativo il quadro appare complesso. Le imprese italiane segnalano con maggiore frequenza rispetto alla media globale i vincoli che limitano l’uso dell’AI nei processi decisionali automatizzati e le politiche che impongono la permanenza dei dati entro i confini nazionali o regionali.

A questo si aggiunge una criticità che ritorna in modo costante: la qualità dei dati, indicata come sfida principale per costruire fiducia nell’AI, insieme alle difficoltà di accesso alle fonti rilevanti e ai costi di archiviazione ed elaborazione.

Che cosa dice davvero questa fotografia

La lettura più utile del report, anche per il contesto italiano, sta forse qui: il mercato non si trova più nella fase in cui il problema è convincere le aziende a provare l’AI. Quel passaggio, almeno in parte, si è già compiuto. La questione si sposta su un altro piano, più strutturale: chi governa i dati, chi certifica l’affidabilità dei modelli, chi forma il personale e chi si assume la responsabilità delle decisioni.

Per questo il report di IDC va letto come una fotografia utile a capire da dove parte il sistema italiano. L’adozione cresce, l’impatto inizia a vedersi, ma la fiducia resta in parte “scoperta”, perché corre più della governance.

È qui che si gioca il prossimo passaggio: meno enfasi sull’AI come etichetta, più attenzione alla qualità dei dati, alle competenze interne e ai meccanismi che rendono i sistemi verificabili, spiegabili e difendibili nel tempo.