Ricerche recenti hanno evidenziato come i principali modelli di intelligenza artificiale siano in grado di generare copie quasi letterali di romanzi di successo, sollevando nuovi dubbi sulle affermazioni dell’industria secondo cui i sistemi non conserverebbero opere protette da copyright.

Secondo diversi studi, i large language model (LLM) sviluppati da OpenAI, Google, Meta, Anthropic e xAI memorizzerebbero una quantità di dati di addestramento superiore a quanto finora ritenuto.

Indice degli argomenti:

Lo studio di Stanford e Yale: estratti quasi integrali

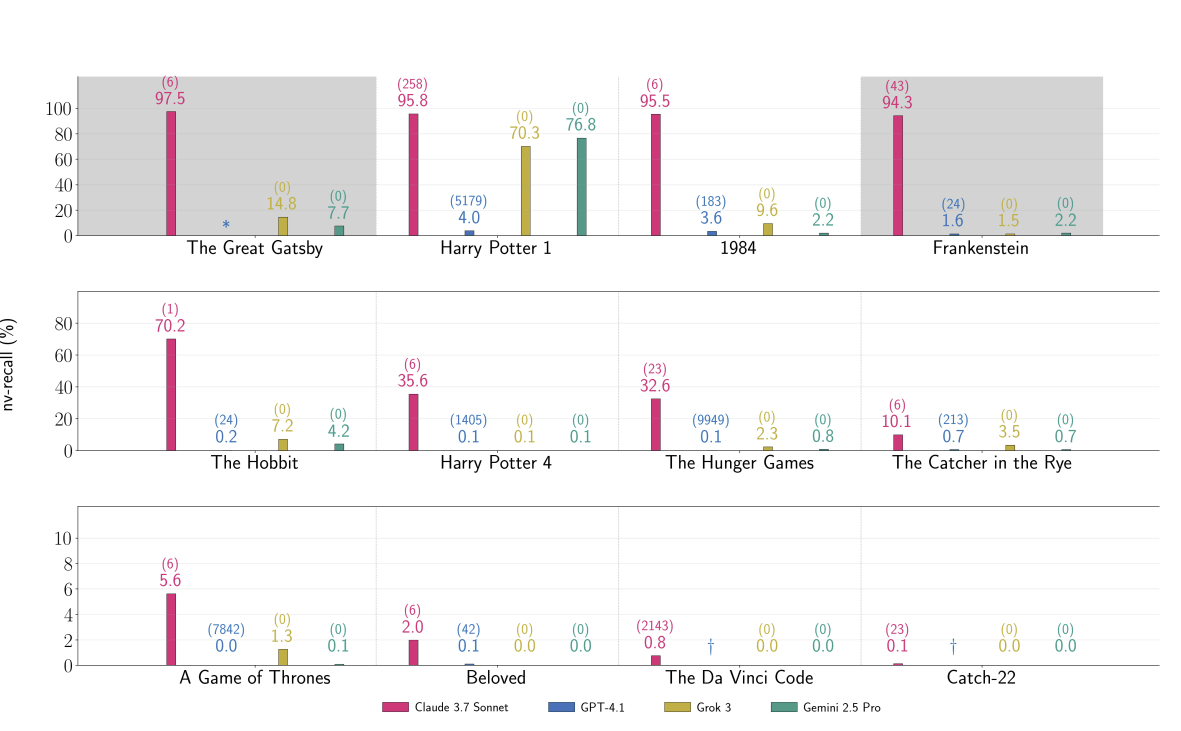

Uno studio pubblicato di recente da ricercatori di Stanford University e Yale University ha dimostrato che, con prompt strategici, è possibile ottenere migliaia di parole tratte da 13 libri noti, tra cui:

- A Game of Thrones

- The Hunger Games

- The Hobbit

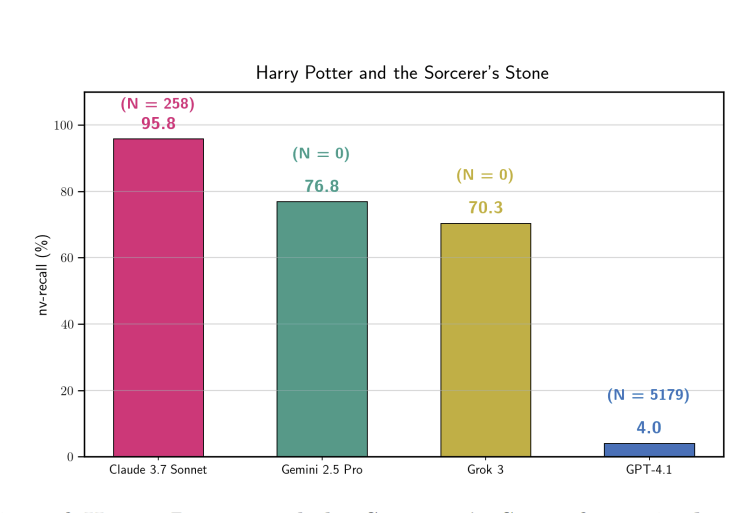

In alcuni casi, i modelli hanno restituito percentuali sorprendentemente elevate di testo corretto. Gemini 2.5 ha rigenerato il 76,8% di Harry Potter and the Philosopher’s Stone con elevata accuratezza, mentre Grok 3 ha raggiunto il 70,3%.

Nel caso del modello Claude 3.7 Sonnet di Anthropic, i ricercatori sono riusciti a estrarre quasi l’intero romanzo in forma “quasi letterale” attraverso tecniche di jailbreak, inducendo il sistema ad aggirare i propri meccanismi di protezione.

Memorizzazione o apprendimento? Il nodo centrale

Per anni le aziende AI hanno sostenuto che i modelli non memorizzano copie dei dati di addestramento. In una lettera del 2023 allo US Copyright Office, Google dichiarava che nel modello “non è presente alcuna copia dei dati di training”.

L’industria difende inoltre l’idea che l’uso di opere protette rientri nel “fair use”, poiché l’AI trasformerebbe il materiale originario in qualcosa di significativamente nuovo.

Tuttavia, secondo Yves-Alexandre de Montjoye dell’Imperial College London, esistono prove crescenti che la memorizzazione sia un fenomeno più esteso del previsto. Anche i modelli “chiusi”, dotati di maggiori salvaguardie, sembrano vulnerabili.

Implicazioni legali: cause miliardarie e sentenze storiche

La questione è centrale nelle numerose cause per violazione del copyright intentate contro le aziende AI.

Negli Stati Uniti, un tribunale ha stabilito che l’addestramento su contenuti protetti potesse essere considerato “trasformativo” e quindi fair use. Tuttavia, ha ritenuto che l’archiviazione di opere piratate fosse “intrinsecamente e irrimediabilmente illecita”, spingendo Anthropic a pagare 1,5 miliardi di dollari per chiudere la controversia.

In Germania, una sentenza di novembre ha stabilito che OpenAI ha violato il copyright per aver memorizzato testi di canzoni, in un caso promosso da GEMA, associazione che rappresenta compositori ed editori. La decisione è stata definita storica per l’Unione Europea.

Oltre il copyright: rischi per privacy e sanità

Il problema della memorizzazione non riguarda solo i libri. In ambiti come sanità ed educazione, la fuoriuscita di dati di training potrebbe comportare gravi violazioni di privacy e riservatezza.

Secondo alcuni esperti, il fatto che i laboratori AI abbiano introdotto salvaguardie per impedire l’estrazione dei dati dimostra la consapevolezza del rischio. Resta inoltre aperto il dibattito sull’effettiva necessità di utilizzare contenuti protetti per sviluppare modelli avanzati.

Il futuro della regolamentazione

La questione non è solo tecnica, ma etica e giuridica. Come ha osservato il professore Ben Zhao dell’Università di Chicago: anche se tecnicamente possibile, bisogna chiedersi se sia opportuno farlo.

Sarà probabilmente il diritto a definire i confini di questa tecnologia, stabilendo fino a che punto l’innovazione possa spingersi senza violare la tutela delle opere creative.