OpenAI amplia gli strumenti di sicurezza di ChatGPT e introduce Trusted Contact, una nuova funzione opzionale pensata per gli utenti adulti. Il meccanismo consente di indicare in anticipo una persona fidata, come un familiare, un amico o un caregiver, che potrà essere avvisata se i sistemi della piattaforma rilevano segnali di possibile autolesionismo associati a una situazione giudicata grave. L’obiettivo è semplice: creare un ponte più rapido tra l’utente e una rete di supporto reale nei momenti di crisi.

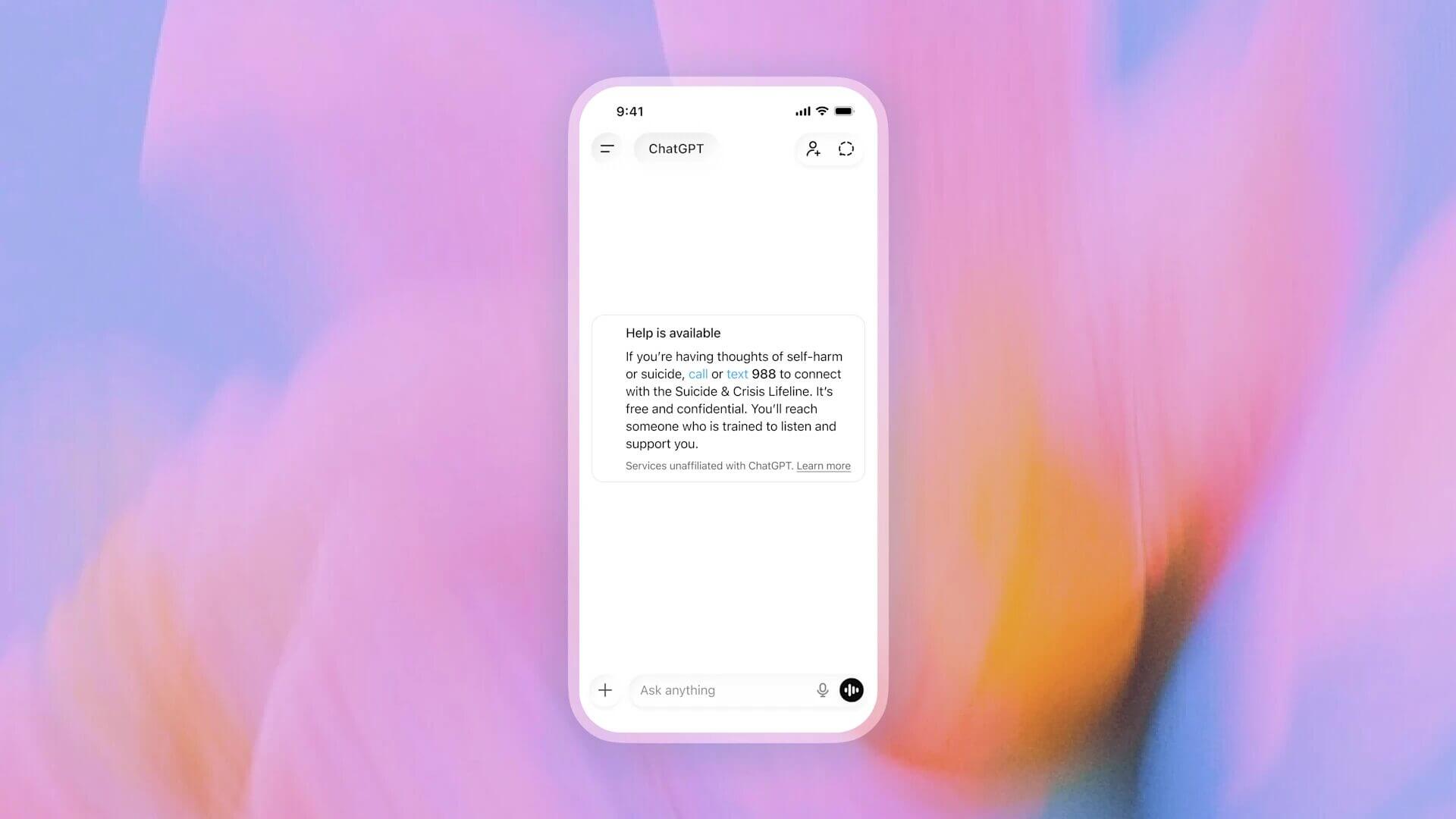

La novità segna un passaggio rilevante nella strategia con cui OpenAI prova a spostare il ruolo dell’intelligenza artificiale da semplice interfaccia conversazionale a strumento che, nei casi più delicati, può favorire il contatto con persone e servizi esterni. Non si tratta di una sostituzione dell’assistenza clinica o dei numeri di emergenza. La stessa azienda chiarisce che Trusted Contact si aggiunge alle linee telefoniche di aiuto già localizzate in ChatGPT e che, quando necessario, il sistema continuerà a invitare l’utente a rivolgersi a professionisti, hotline di crisi o servizi di emergenza.

Indice degli argomenti:

Una funzione opzionale che estende i controlli già esistenti

Trusted Contact nasce come estensione di un impianto già presente. OpenAI ricorda infatti che ChatGPT dispone già di notifiche di sicurezza collegate ai controlli parentali, con cui genitori o tutori possono ricevere avvisi quando un account adolescente associato mostra segnali di forte sofferenza.

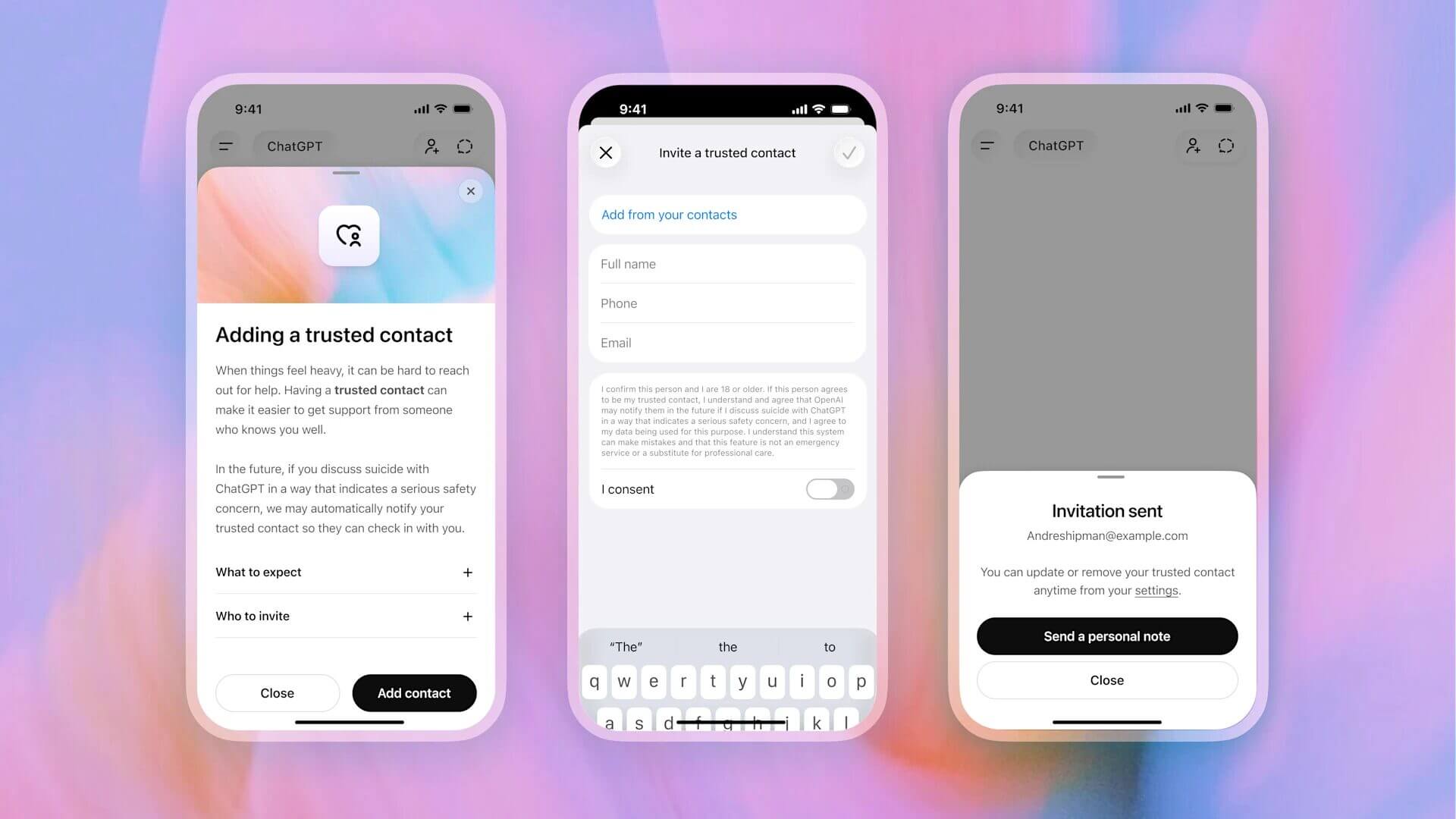

La novità è che questa logica di allerta esce dall’ambito strettamente familiare e viene resa disponibile, su base volontaria, a chi ha più di 18 anni (più di 19 in Corea del Sud).

La scelta di mantenere la funzione facoltativa non è secondaria. Sul piano economico e regolatorio, i sistemi di intelligenza artificiale che operano in contesti sensibili si muovono in un equilibrio stretto tra prevenzione, responsabilità della piattaforma e tutela dell’autonomia individuale.

OpenAI prova a posizionarsi in questo spazio con una soluzione che richiede una decisione preventiva dell’utente: è lui a nominare una persona di fiducia, è lui a poterla modificare o rimuovere in qualsiasi momento, ed è la persona indicata a dover accettare formalmente il ruolo.

Come funziona Trusted Contact

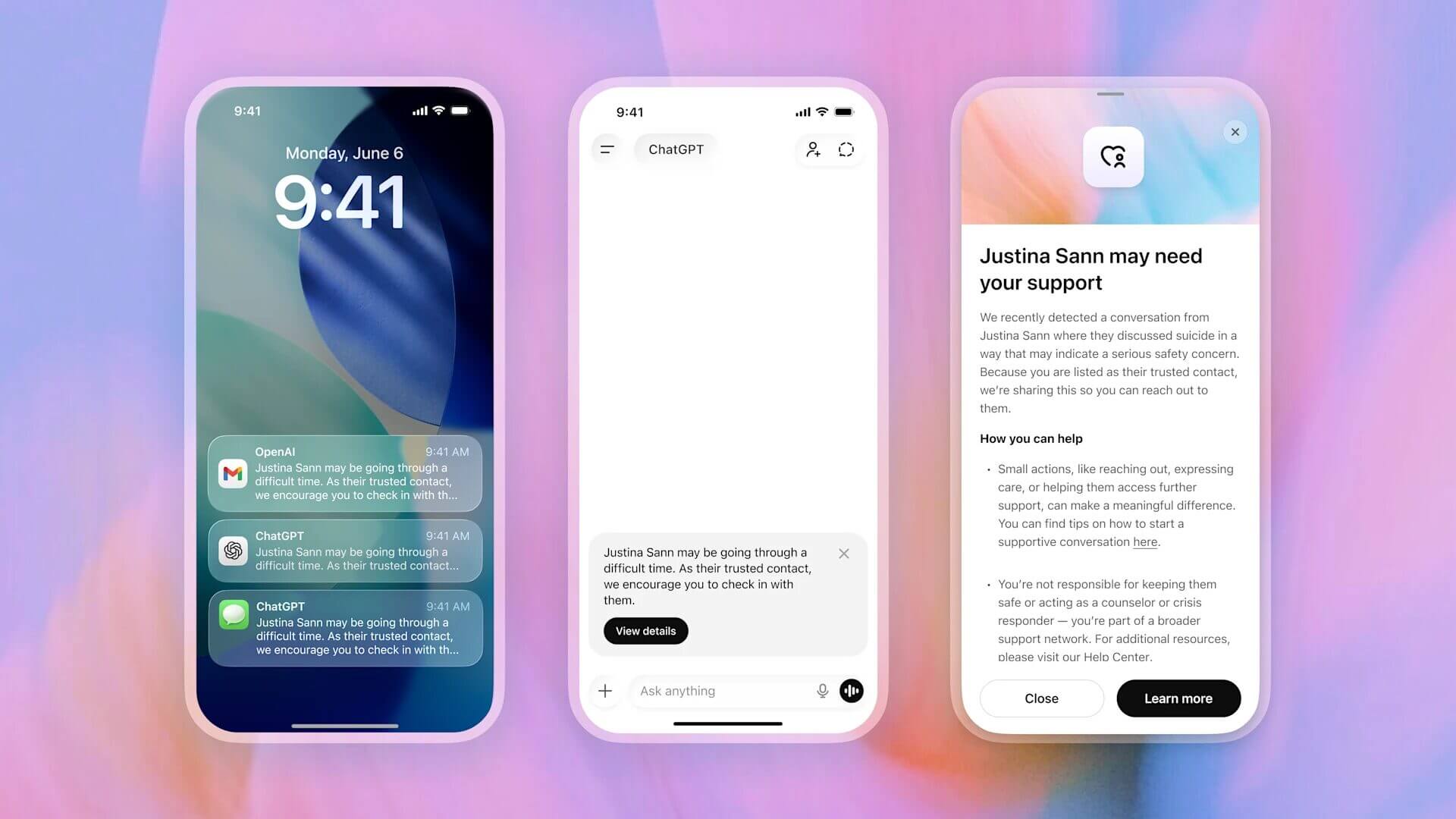

Il funzionamento è costruito in più fasi. L’utente può aggiungere dalle impostazioni di ChatGPT un solo contatto fidato adulto. La persona scelta riceve un invito che spiega il suo ruolo e deve accettare entro una settimana. Senza questa accettazione, la funzione non si attiva. Se l’invito viene rifiutato, l’utente può selezionare un altro adulto.

La seconda fase riguarda il rilevamento del rischio. Se i sistemi automatici di monitoraggio individuano una conversazione in cui l’utente sembra parlare di autolesionismo in termini che suggeriscono una possibile preoccupazione seria per la sicurezza, ChatGPT informa l’utente che il contatto fidato potrebbe essere avvisato. Nello stesso momento, la piattaforma incoraggia la persona a scrivere direttamente al proprio Trusted Contact, proponendo anche formule iniziali di conversazione per facilitare il contatto.

Dopo il passaggio automatico entra in campo la revisione umana. OpenAI spiega che una piccola squadra di operatori appositamente formati esamina il caso. Solo se questi revisori ritengono che la conversazione possa indicare un problema serio di sicurezza, parte la notifica al contatto fidato. L’avviso può arrivare via email, sms o notifica in-app, se il destinatario possiede un account ChatGPT.

Privacy limitata, allerta mirata

Uno degli aspetti più delicati riguarda la quantità di informazioni condivise. OpenAI afferma che la notifica è intenzionalmente limitata. Non contiene dettagli completi della chat né trascrizioni della conversazione. Comunica in modo generale che il tema dell’autolesionismo è emerso in una forma potenzialmente preoccupante e invita il contatto fidato a farsi sentire. Il messaggio include anche un link a indicazioni elaborate da esperti su come gestire conversazioni sensibili.

Questa scelta risponde a una doppia esigenza. Da un lato, rendere utile l’avviso, perché chi lo riceve deve capire che potrebbe essere opportuno intervenire. Dall’altro, ridurre al minimo il trasferimento di contenuti personali. Per un’azienda che gestisce una piattaforma globale basata su interazioni testuali, la protezione della privacy è un punto decisivo anche sotto il profilo reputazionale e normativo. Un sistema di alert più invasivo rischierebbe di frenare l’adozione della funzione e di aprire un contenzioso più ampio sui limiti del monitoraggio automatizzato.

Il valore della connessione sociale

OpenAI fonda la nuova funzione su una letteratura clinica che considera la connessione sociale un fattore di protezione importante nella prevenzione del suicidio. Nel testo di presentazione della funzione, Arthur Evans, chief executive officer dell’American Psychological Association, sostiene che la scienza psicologica mostra con continuità il peso protettivo delle relazioni sociali, soprattutto nei periodi di sofferenza emotiva. Secondo Evans, aiutare una persona a identificare in anticipo qualcuno di fiducia, senza toglierle autonomia di scelta, può rendere più facile cercare un sostegno concreto nel momento in cui serve davvero.

La logica economica della funzione è anche quella della prevenzione tempestiva. Nei servizi digitali, la velocità di risposta può fare la differenza, ma l’intervento non può essere lasciato soltanto alla macchina. Per questo OpenAI insiste su un modello a più livelli: rilevamento automatico, informazione all’utente, incoraggiamento al contatto diretto, revisione umana e poi eventuale notifica. L’azienda dichiara inoltre di puntare a una revisione delle segnalazioni in meno di un’ora, pur precisando che nessun sistema è perfetto e che una notifica può non riflettere in modo esatto tutto ciò che una persona sta vivendo.

La consulenza di clinici e organizzazioni esterne

Nel presentare Trusted Contact, OpenAI sottolinea di aver sviluppato la funzione con il supporto di clinici, ricercatori e organizzazioni specializzate in salute mentale e prevenzione del suicidio. L’azienda cita la propria Global Physicians Network, una rete composta da oltre 260 medici abilitati in 60 Paesi, e l’Expert Council on Well-Being and AI. Tra i soggetti esterni coinvolti figura anche l’American Psychological Association.

Munmun De Choudhury, docente di Interactive Computing al Georgia Tech e membro dell’Expert Council on Well-Being and AI, definisce la funzione un passo in avanti nella capacità dell’intelligenza artificiale di favorire connessioni umane autentiche e sicurezza psicologica, soprattutto nei momenti di vulnerabilità.

Le parole usate dagli esperti che OpenAI ha scelto di citare aiutano a inquadrare il posizionamento della società: la tecnologia non come risposta finale, ma come meccanismo di attivazione di relazioni umane già esistenti.

Per il mercato dell’AI conversazionale, il coinvolgimento di organismi esterni ha anche un valore strategico. Le piattaforme che operano su temi sensibili devono mostrare che le scelte di prodotto non nascono soltanto da obiettivi di crescita o engagement, ma da un confronto con competenze cliniche e standard di sicurezza riconoscibili. In un settore sempre più osservato da autorità, regolatori e opinione pubblica, la credibilità tecnica da sola non basta.

Un modello che guarda alla gestione del rischio

Trusted Contact va letto dentro un quadro più ampio di gestione del rischio. OpenAI ricorda che ChatGPT dispone già di diversi livelli di salvaguardia per le conversazioni sensibili. In presenza di segnali di crisi, il sistema può suggerire di contattare servizi di emergenza, linee di supporto psicologico, professionisti della salute mentale o persone fidate. L’azienda afferma di aver lavorato con oltre 170 esperti di salute mentale per migliorare la capacità del modello di riconoscere possibili segnali di sofferenza, de-escalare le conversazioni e indirizzare gli utenti verso supporti reali quando opportuno.

C’è poi un altro livello, meno drammatico ma comunque rilevante: la gestione del tempo di utilizzo. In alcune situazioni ChatGPT può invitare l’utente a fare una pausa o ad allontanarsi dallo schermo dopo un uso prolungato, con l’obiettivo di promuovere abitudini digitali più sane.

Infine resta il livello più netto, quello del rifiuto. Il sistema, spiega OpenAI, è addestrato a non fornire istruzioni su suicidio o autolesionismo e a reindirizzare verso risposte più sicure e risorse di crisi localizzate.

Dal punto di vista industriale, questo impianto mostra che la sicurezza non viene trattata come una singola funzione, ma come una sequenza di filtri e interventi. È un modello coerente con l’evoluzione dei grandi servizi AI, dove la responsabilità non riguarda solo l’accuratezza delle risposte, ma anche l’effetto che quelle risposte possono avere in situazioni di vulnerabilità.

Le implicazioni per le piattaforme e per il mercato

L’introduzione di Trusted Contact apre una questione che va oltre il singolo strumento. Le piattaforme basate su intelligenza artificiale stanno diventando, per una parte degli utenti, luoghi in cui si cercano consigli, rassicurazioni, ascolto, orientamento. Questo uso amplia la base di mercato, ma aumenta anche il livello di responsabilità. Più una piattaforma viene impiegata in ambiti personali e delicati, più cresce la pressione perché sviluppi protocolli di intervento, controllo e mitigazione del danno.

Per OpenAI, la nuova funzione ha diverse implicazioni. La prima è reputazionale: mostrare che il prodotto non si limita a generare testo, ma incorpora meccanismi di protezione in aree ad alto rischio. La seconda è competitiva: fissare uno standard che potrebbe spingere altri operatori del settore a introdurre dispositivi simili. La terza è regolatoria: presentarsi ai decisori pubblici con un modello che combina consenso dell’utente, revisione umana e minimizzazione dei dati condivisi.

Resta però aperto il nodo dell’efficacia. La stessa azienda ammette che nessun sistema è perfetto. Un rilevamento automatizzato può generare falsi positivi o non cogliere tutta la complessità di una situazione personale. Per questo la presenza di revisori umani e la limitazione delle notifiche sono elementi centrali, ma non eliminano del tutto il problema. Il punto, semmai, è quale soglia di intervento una piattaforma scelga di adottare e con quali garanzie di controllo.

Il confine tra assistenza e responsabilità

Trusted Contact si colloca su un confine sensibile: quello tra supporto tecnologico e responsabilità umana. OpenAI insiste sul fatto che la funzione non sostituisce cure professionali né servizi di emergenza. È una precisazione necessaria, perché la tentazione di attribuire ai chatbot una capacità terapeutica o di presidio continuativo è già visibile nel modo in cui molte persone usano questi strumenti.

La soluzione scelta da OpenAI prova a correggere proprio questo rischio. Invece di spingere l’utente a restare dentro il sistema, Trusted Contact cerca di favorire l’uscita dalla conversazione verso una relazione concreta, già riconosciuta come affidabile. È una differenza importante anche dal punto di vista economico del prodotto: il valore non viene cercato nell’aumento del tempo trascorso sulla piattaforma, ma nella capacità del servizio di orientare verso un supporto esterno nei casi più seri.

Questo approccio potrebbe incidere sul dibattito più ampio sui doveri delle società che sviluppano AI generativa. Se un chatbot viene usato come confidente, consulente o spazio di sfogo, le aziende non possono limitarsi a sostenere che si tratta solo di un software general purpose. Devono dimostrare di aver previsto protocolli adeguati per le situazioni in cui il dialogo entra in un terreno di rischio.

Un passo che pesa oltre la singola funzione

Trusted Contact non cambia soltanto il menu delle impostazioni di ChatGPT. Indica la direzione in cui si sta muovendo una parte del settore: meno enfasi sull’AI come interlocutore autosufficiente, più attenzione alla sua funzione di collegamento con risorse umane, cliniche e territoriali. Il fatto che OpenAI presenti il sistema come un livello aggiuntivo, e non come una soluzione risolutiva, segnala una cautela che sul piano pubblico conta quasi quanto la tecnologia usata.

La funzione arriva in un momento in cui le piattaforme conversazionali devono dimostrare di saper gestire non solo i rischi informativi, come errori o contenuti manipolatori, ma anche quelli relazionali e psicologici. Per gli utenti adulti, la possibilità di designare una persona fidata introduce una forma di protezione personalizzata. Per il mercato, rappresenta un test: capire se la sicurezza può essere integrata nei prodotti di AI senza trasformarsi in sorveglianza e senza compromettere la fiducia.

Il punto decisivo sarà l’uso concreto. Se il sistema saprà mantenere tempi rapidi, notifiche misurate e revisioni affidabili, Trusted Contact potrà diventare un riferimento per il settore. Se invece emergeranno errori, allarmi poco chiari o dubbi sulla privacy, la funzione finirà per alimentare le stesse perplessità che prova a disinnescare. OpenAI, con questa scelta, mette sul tavolo un’idea precisa: nelle situazioni più critiche, il valore dell’intelligenza artificiale non sta nel parlare di più, ma nel far arrivare la conversazione alla persona giusta.