Anthropic estende la sua piattaforma Managed Agents con tre primitive nuove: dreaming, outcomes e multiagent orchestration, rilasciate il 5 maggio 2026 e descritte nel post ufficiale che le inquadra come passi per rendere gli agenti capaci di gestire compiti complessi con minima supervisione.

I numeri delle prime adozioni circolano da subito: Harvey misura un tasso di completamento dei task circa sei volte superiore grazie a dreaming, mentre i benchmark interni Anthropic indicano per outcomes un miglioramento fino a dieci punti percentuali sui problemi più difficili e gain dell’8,4% sulla qualità dei file .docx generati, del 10,1% sui .pptx.

Sono cifre piccole se lette come incremento marginale, grandi se lette per quello che sono: indicatori che gli agenti smettono di essere esecutori a comando e iniziano a comportarsi come sistemi che maturano nel tempo, una direzione che rende meno teorico il termine “collega digitale” e più concreta la domanda su come orchestrarli senza perdere il controllo.

Indice degli argomenti:

Dreaming, la memoria che “si ricompatta” da sola

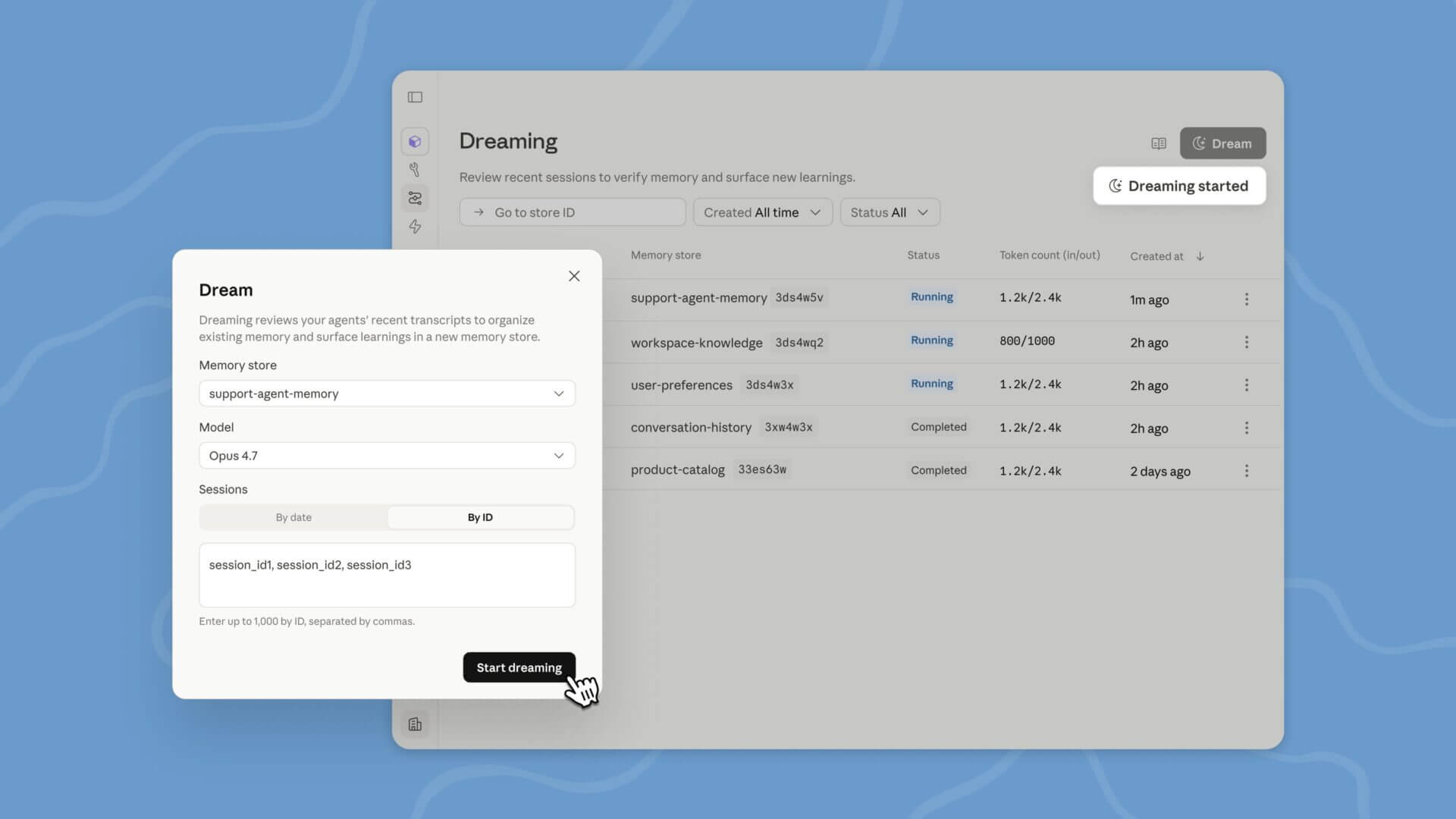

La promessa di dreaming è semplice nella formulazione, complessa nelle implicazioni. Un agente che lavora in produzione accumula sessioni, ognuna lascia tracce nella memoria persistente, e nel giro di qualche settimana quella memoria è popolata da duplicati, valori contraddittori, voci stantie che nessuno ha tempo di ripulire, ed è questo il collo di bottiglia che dreaming attacca, eseguendo un processo schedulato che rilegge le sessioni passate, estrae pattern ricorrenti, riorganizza la memoria e propone una nuova versione consolidata che l’utente può approvare o scartare senza che l’originale venga toccato.

La metafora del “sognare” funziona meglio di quanto sembri. Dreaming non è memoria che cresce, è memoria che “si consolida”, ed è la rifattorizzazione, non l’accumulo, a tenere alto il segnale.

Il caso Harvey lo dimostra in modo tangibile, gli agenti legali della piattaforma usano dreaming per ricordare workaround sui formati file e pattern specifici degli strumenti, e i tassi di completamento dei task sono saliti di circa sei volte nei loro test interni.

Non si tratta di un agente che diventa più intelligente, ma di un agente che smette di sbagliare nello stesso punto due volte. Sembra una sottigliezza, però è il tema che separa un assistente da un collaboratore.

Dreaming resta in research preview, e questo dettaglio editoriale dice qualcosa anche sulla maturità del feature, Anthropic stessa avverte che potrebbero esserci breaking change e raccomanda di non usarlo su workflow critici. La cautela ha senso, perché un sistema che riscrive la propria memoria è anche un sistema che, se sbaglia nel tagliare i rami secchi, può consolidare errori sistemici.

Ed è qui che il controllo umano sulla revisione diventa governance vera, non casella da spuntare.

Outcomes, il giudice separato che decide quando si è finito

La seconda primitiva è più sottile e forse la più rivoluzionaria nell’uso quotidiano. Con outcomes l’utente smette di descrivere all’agente come fare il lavoro e gli descrive invece come dovrebbe essere il risultato, una rubrica esplicita di criteri di successo, dopodiché l’agente lavora e un grader separato, ospitato in una propria finestra di contesto, valuta l’output rispetto alla rubrica senza essere influenzato dal ragionamento di chi ha eseguito il task. Se il grader trova qualcosa di sbagliato, indica con precisione cosa va corretto e l’agente fa un altro passaggio.

L’idea che il valutatore stia in un contesto isolato dal generatore è la mossa di design importante, perché taglia il cortocircuito tipico dei sistemi che si auto-valutano, in cui chi scrive e chi giudica condividono lo stesso pregiudizio. I numeri parlano di un guadagno fino a dieci punti percentuali di task success sui problemi difficili e di miglioramenti specifici nella qualità dei file generati: +8,4% sui documenti Word, +10,1% sulle presentazioni PowerPoint.

Cambia anche la natura del prompt, non si scrive più “fai questo, poi quello, poi quell’altro”, si scrive “il risultato deve avere queste caratteristiche”, e questo sposta la competenza richiesta da chi adotta gli agenti, dal saper guidare passo passo al saper definire stati finali verificabili.

Outcomes si combina con i webhook, e questa combinazione abilita lavoro davvero asincrono, l’utente lancia un task con la rubrica, chiude la sessione, riceve la notifica quando il sistema ha verificato di aver soddisfatto i criteri. Non è la stessa cosa di un agente che gira in background sperando che vada bene, è un agente che restituisce solo lavoro che ha già passato un controllo separato, e questa proprietà cambia il rapporto fra chi delega e chi esegue.

Multiagent orchestration, il lead agent che divide il lavoro

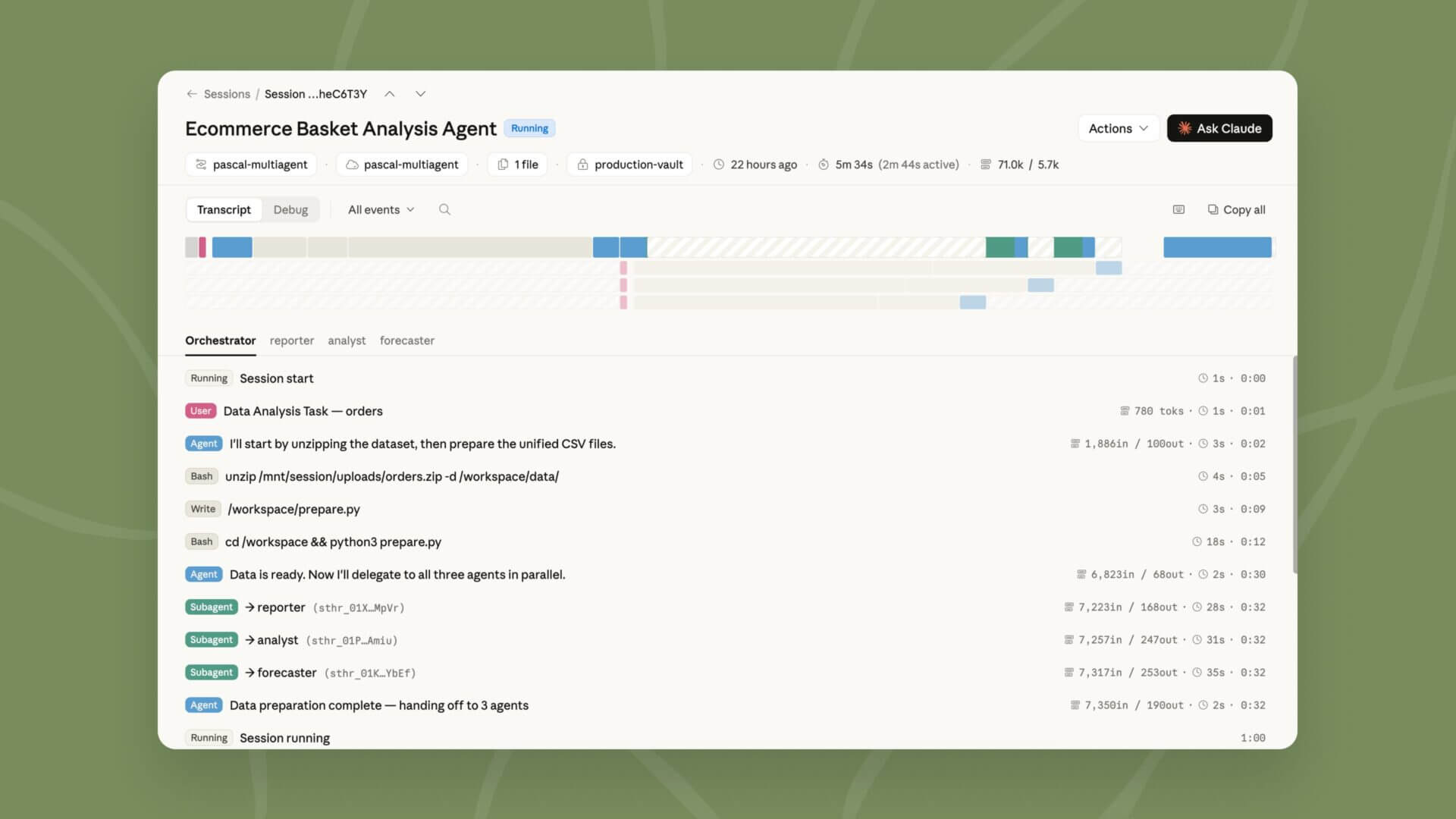

La terza primitiva risponde a un limite noto, un agente singolo va in sofferenza quando il task richiede competenze eterogenee o esplorazione parallela su molte fonti. Multiagent orchestration permette a un agente principale di scomporre un compito in pezzi e affidarli a specialisti, ognuno con il proprio modello, prompt e strumenti, che lavorano in parallelo su un filesystem condiviso e contribuiscono al contesto del lead, mentre la Claude Console permette di tracciare ogni passo, quale agente ha fatto cosa, in che ordine e perché.

L’esempio Netflix è il più chiaro per chi ragiona di scala enterprise. Il team di piattaforma ha costruito un agente di analisi che processa log di centinaia di build provenienti da fonti diverse, e quando una modifica tocca migliaia di applicazioni l’unica cosa che conta è isolare i pattern ricorrenti che meritano attenzione, scartando il rumore.

La parallelizzazione orchestrata fa esattamente questo: analizza batch in parallelo, fa emergere i temi trasversali, riduce il lavoro umano a quello che richiede vero giudizio. Spiral by Every, dall’altro lato dello spettro, mostra l’uso più sottile, un lead agent gira su Haiku e raccoglie le richieste con domande di follow-up rapide, mentre i subagent di scrittura girano su Opus e producono le bozze, e quando l’utente ne chiede più di una i subagent scrivono in parallelo. Modello leggero in regia, modello pesante alla performance, e l’orchestrazione che tiene insieme.

La tracciabilità in Console è il dettaglio operativo che farà la differenza nelle adozioni enterprise, perché senza visibilità su chi-ha-fatto-cosa il debugging di un sistema multiagente è opaco e il rischio di hallucination distribuita aumenta.

Avere un log strutturato delle deleghe rende auditabile l’esecuzione, e questo è il prerequisito perché un sistema così entri in workflow regolati.

Cosa cambia davvero per chi lo adotta

Tre primitive distinte, un’unica direzione: gli agenti smettono di essere singoli runtime stateless e diventano sistemi compositi che memorizzano selettivamente, valutano il proprio output con criteri esterni e si distribuiscono il lavoro fra specialisti.

Il modello mentale che serve per adottarli cambia, non basta più progettare un buon prompt, bisogna progettare la rubrica di successo, decidere la politica di consolidamento della memoria, definire la gerarchia di delega, e ognuna di queste scelte è una scelta organizzativa prima che tecnica.

Il rovescio della medaglia

C’è poi il rovescio della medaglia, che merita una riflessione metodologica esplicita. Un agente che impara dalle proprie sessioni può consolidare anche bias o errori sistemici, e dreaming ha senso solo se accoppiato a una review umana sensata sulle modifiche al memory store, almeno nelle prime fasi e nei domini ad alto impatto.

Un agente con outcomes lavora bene se la rubrica è scritta bene, e una rubrica scritta male produce output che passa il grader e fallisce nel mondo reale, spostando il problema senza risolverlo.

Multiagent orchestration scala il lavoro ma scala anche i costi e la complessità di debug, e va usata dove il task lo giustifica davvero, non come default. La governance, in questo nuovo scenario, smette di essere un layer aggiuntivo e diventa parte del design dell’agente.

Avevo provato a descrivere in Spatial Shift l’autonomia distribuita come la condizione in cui il lavoro non sta più in un’entità sola ma in una coreografia di entità che cooperano, ed è quello che dreaming, outcomes e multiagent orchestration rendono operativo.

Resta da capire quanto velocemente le organizzazioni sapranno ricalibrare i propri processi di delega per sfruttare davvero questa coreografia, e qui il fattore tempo conta più del fattore tecnologia, perché la primitiva è disponibile, la cultura del controllo per rubrica e della memoria curata, no.