OpenAI allarga il raggio della propria distribuzione commerciale e sceglie Amazon Web Services come nuovo canale diretto per i clienti cloud. La decisione segna un passaggio rilevante nel riassetto dei rapporti tra i grandi gruppi dell’intelligenza artificiale: da una parte Microsoft, che resta il principale azionista della società, dall’altra Amazon, che ottiene accesso ai modelli più avanzati del laboratorio guidato da Sam Altman attraverso Bedrock, la propria piattaforma per sviluppatori.

Punti chiave

Gli ultimi modelli di OpenAI sono disponibili in anteprima limitata tramite Amazon Bedrock, offrendo ai clienti accesso a un’intelligenza di frontiera con la sicurezza, la governance e i controlli operativi su cui già fanno affidamento in Aws.

L’agente di coding di OpenAI, Codex, è ora disponibile in anteprima limitata su Amazon Bedrock, portando lo sviluppo software basato sull’IA negli ambienti Aws in cui i team aziendali già progettano e operano.

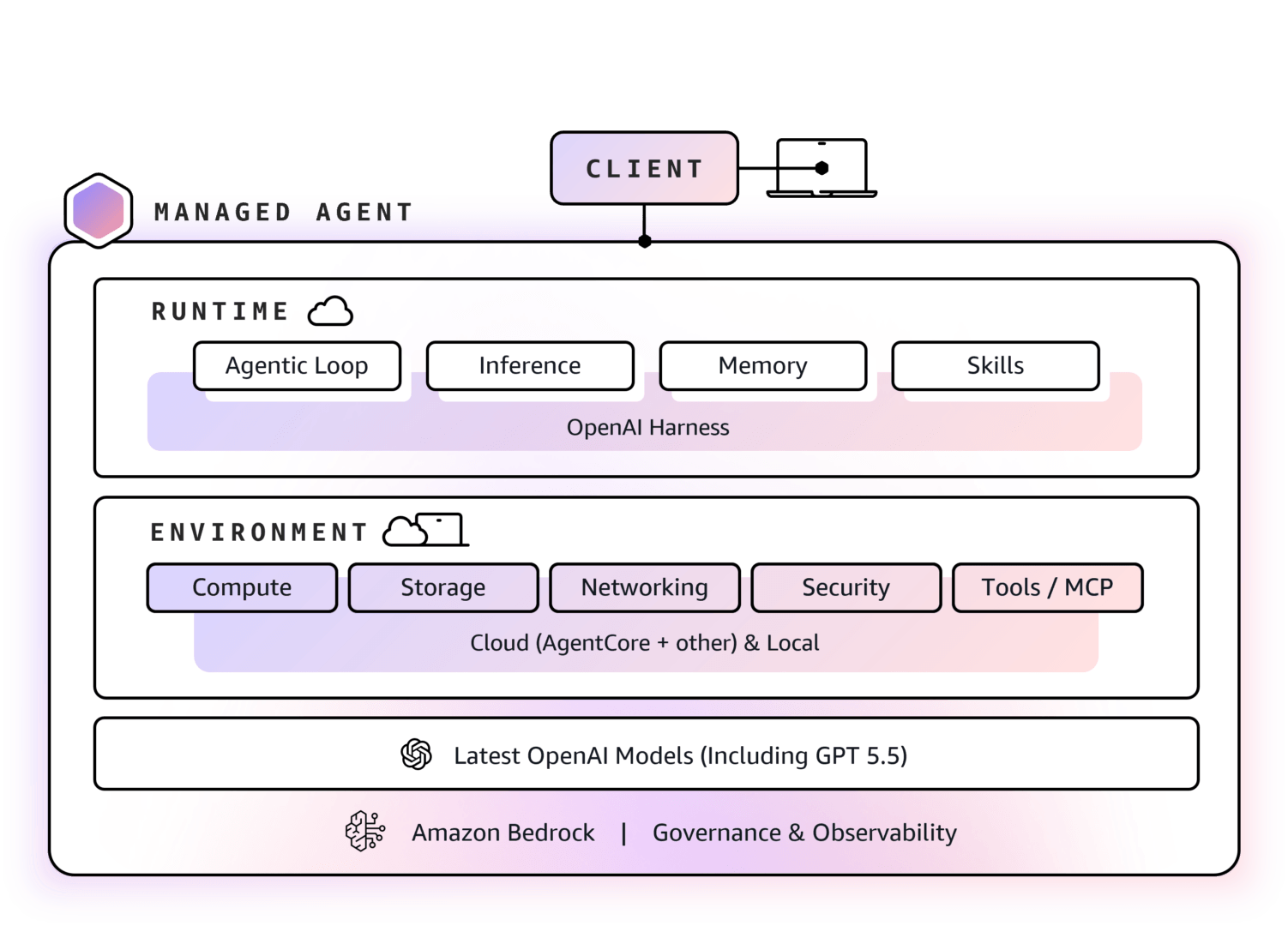

Amazon Bedrock Managed Agents, alimentato da OpenAI e disponibile in anteprima limitata, consente ai clienti di creare nel cloud in modo rapido e semplice agenti basati su OpenAI pronti per la produzione.

L’annuncio arriva dopo una revisione dei termini dell’accordo tra OpenAI e Microsoft, che ha alleggerito i vincoli di esclusiva. È questo il punto che rende possibile l’espansione su Aws: finora il rapporto privilegiato con Microsoft limitava la capacità di OpenAI di distribuire i propri modelli attraverso piattaforme cloud concorrenti.

La rinegoziazione cambia il quadro e apre una fase nuova, nella quale la società punta a vendere le sue tecnologie su più infrastrutture, riducendo la dipendenza operativa e commerciale da un solo partner.

Per Amazon l’intesa ha un valore industriale immediato. Aws potrà offrire ai clienti i modelli di frontiera di OpenAI all’interno del proprio ecosistema, insieme ad altri sistemi già presenti su Bedrock, come quelli di Anthropic, Meta e Mistral. Per OpenAI il vantaggio è duplice: più accesso al mercato enterprise e più capacità di calcolo, in un momento in cui la domanda di data center cresce con una velocità che pochi operatori possono sostenere da soli.

Indice degli argomenti:

Un accordo che modifica gli equilibri nel cloud

Il cuore dell’operazione è semplice: i clienti di Aws avranno accesso diretto ai modelli più avanzati di OpenAI sulla piattaforma Bedrock.

Tra gli strumenti annunciati c’è anche Codex, l’agente per la scrittura di codice sviluppato dalla società.

Amazon introdurrà inoltre un servizio denominato Amazon Bedrock Managed Agents, powered by OpenAI, pensato per consentire alle imprese di distribuire flotte di agenti di intelligenza artificiale incaricati di svolgere compiti operativi.

Il passaggio non è solo tecnico. Fino a poco tempo fa un accordo del genere sarebbe stato esposto a contestazioni legali da parte di Microsoft, secondo quanto già emerso in precedenza. Il nodo riguardava proprio le clausole di esclusiva inserite nel contratto con OpenAI.

La nuova intesa tra le due società, definita il 27 aprile 2026 , consente invece a OpenAI di rendere disponibili i suoi modelli anche su piattaforme cloud rivali. In cambio Microsoft ottiene condizioni migliori sulla condivisione dei ricavi e la rimozione di una clausola particolarmente sensibile, quella legata alla cosiddetta agi, l’intelligenza artificiale generale.

Quel passaggio merita attenzione perché tocca il rapporto di forza tra investitore e società partecipata. Microsoft ha finanziato e sostenuto OpenAI nella fase di espansione più rapida, integrandone i modelli in Azure e in una parte crescente della propria offerta software. Ma OpenAI, man mano che il suo peso commerciale aumentava, ha iniziato a cercare margini di autonomia più ampi.

La scelta di vendere su Aws va letta dentro questa dinamica: più canali, più clienti, meno vincoli.

Da partner esclusivo a socio centrale, ma non unico

Microsoft resta il socio più influente, ma non l’unico attore capace di incidere sul futuro di OpenAI. La società ha lavorato negli ultimi mesi per sganciarsi da una struttura troppo concentrata su un solo rapporto industriale. L’obiettivo è duplice: ampliare la distribuzione dei modelli e assicurarsi l’enorme capacità computazionale necessaria per addestrare e far funzionare sistemi sempre più complessi.

La mossa verso Amazon si inserisce proprio qui. OpenAI, secondo quanto riportato, ha firmato accordi per acquistare dal gruppo una capacità da data center del valore di 138 miliardi di dollari. È una cifra che dà la misura della scala del fabbisogno infrastrutturale dell’azienda. L’intelligenza artificiale generativa richiede enormi investimenti in chip, energia, raffreddamento e costruzione di nuove strutture.

Per un laboratorio che vuole restare in testa nella corsa ai modelli di frontiera, dipendere da un solo fornitore di cloud e calcolo è un rischio strategico.

L’allentamento dell’esclusiva con Microsoft va quindi letto come una normalizzazione del rapporto. OpenAI non rompe con il partner storico, ma ridisegna i confini. Microsoft continua a essere un perno sia sul piano finanziario sia su quello commerciale.

Tuttavia la società guidata da Altman prova a costruire una posizione più simile a quella di un fornitore indipendente, capace di vendere tecnologia a più operatori e di acquistare capacità da più infrastrutture globali.

Amazon rafforza Bedrock e parla alle imprese

Per Amazon l’intesa ha una valenza competitiva evidente. Aws è leader mondiale nel cloud, ma negli ultimi due anni ha dovuto affrontare una trasformazione del mercato: l’intelligenza artificiale non è più un servizio aggiuntivo, è diventata un criterio di scelta per i clienti aziendali. Le imprese non chiedono soltanto potenza di calcolo, ma accesso rapido ai modelli migliori, strumenti di integrazione, sicurezza, governance dei dati e ambienti affidabili per l’uso operativo degli agenti.

Matt Garman, amministratore delegato di Aws, ha detto che i clienti chiedevano da tempo come ottenere i modelli OpenAI all’interno dell’ecosistema Amazon. La frase va oltre la formula di rito. Significa che una parte rilevante della clientela enterprise non vuole essere costretta a cambiare fornitore cloud per utilizzare i modelli più richiesti dal mercato. Vuole restare su Aws e, allo stesso tempo, scegliere OpenAI.

Bedrock nasce proprio per questo: offrire un catalogo di modelli diversi, accessibili dalla stessa piattaforma, così da semplificare il lavoro degli sviluppatori e ridurre il rischio di lock-in. Con l’ingresso di OpenAI, Bedrock diventa ancora più forte come vetrina multi-modello. Amazon non punta solo a vendere capacità cloud, ma a diventare il luogo in cui un’impresa può combinare sistemi diversi a seconda del prezzo, delle prestazioni e dei casi d’uso.

Bedrock Managed Agents e Bedrock AgentCore

Bedrock AgentCore è la piattaforma aperta per creare, connettere e ottimizzare agenti su larga scala usando qualsiasi modello e framework. Bedrock Managed Agents è ottimizzato per sviluppare soluzioni agentiche con i modelli di frontiera di OpenAI e le relative capacità agentiche.

Per chi sviluppa su Bedrock Managed Agents, AgentCore è un complemento naturale. AgentCore fornisce l’ambiente di calcolo predefinito per Bedrock Managed Agents e, man mano che la presenza degli agenti si estende nella tua organizzazione, AgentCore e Bedrock Managed Agents offriranno funzionalità aggiuntive, come l’applicazione delle policy di autorizzazione, la scoperta di agenti e strumenti degli agenti, oltre a capacità di osservabilità e valutazione.

Il mercato passa dalla sperimentazione all’uso operativo

Uno degli elementi più interessanti dell’annuncio riguarda il linguaggio usato da Denise Dresser, chief revenue officer di OpenAI. Durante un evento a San Francisco ha detto che i clienti non sono più nella fase dei test e dei progetti pilota. Stanno passando al dispiegamento degli strumenti agentici nelle attività di impresa.

È un cambio di tono che fotografa una fase nuova del mercato. Negli ultimi due anni molte aziende hanno provato chatbot, copiloti e automazioni su scala limitata, spesso in reparti isolati. Ora la domanda si sposta verso applicazioni più integrate: agenti che leggono documenti, compilano report, scrivono codice, dialogano con sistemi gestionali, eseguono processi sotto supervisione umana.

In questo scenario conta meno la sola disponibilità del modello e molto di più il contesto in cui viene distribuito: sicurezza, conformità, accesso controllato ai dati aziendali, monitoraggio delle attività.

Quando Dresser parla di “trusted environment”, ambiente affidabile, si riferisce proprio a questo. Le imprese sono più disposte a usare modelli di frontiera se possono farlo all’interno di infrastrutture note, con strumenti di controllo già integrati. Aws offre a OpenAI un canale naturale verso questa clientela.

OpenAI offre ad Aws un prodotto che molte aziende chiedono esplicitamente. L’accordo nasce dall’incontro tra queste due esigenze.

Investimenti incrociati e dipendenze reciproche

La relazione tra OpenAI e Amazon non si limita alla distribuzione commerciale. A febbraio Amazon ha investito 15 miliardi di dollari nell’ultimo round di finanziamento della società, nell’ambito di un impegno che potrebbe arrivare fino a 50 miliardi. La struttura prevista lega ulteriori 35 miliardi a due eventi possibili: la quotazione in borsa di OpenAI oppure il raggiungimento di una forma di intelligenza artificiale potente definita agi.

Sono condizioni che mostrano quanto il settore stia ragionando ormai su orizzonti da grande industria infrastrutturale più che da semplice software. Gli investimenti non riguardano solo quote societarie, ma opzioni strategiche sul futuro accesso alle tecnologie e alle capacità di calcolo.

Amazon scommette su OpenAI come fornitore di modelli e come cliente enorme dei suoi data center. OpenAI vede in Amazon un investitore, un distributore e un fornitore di potenza computazionale. Ognuno ha bisogno dell’altro, ma ciascuno cerca anche di evitare una dipendenza totale.

Questo schema si ritrova in tutto il settore. Le grandi società cloud finanziano i laboratori di intelligenza artificiale; i laboratori acquistano infrastrutture dai grandi cloud provider; gli stessi provider cercano poi di vendere alle imprese modelli sviluppati internamente o da partner esterni.

Il risultato è un mercato in cui alleanze e competizione convivono nello stesso perimetro.

Il caso Anthropic e la strategia multi-scommessa di Amazon

La posizione di Amazon è ancora più interessante se si considera che il gruppo è anche azionista di Anthropic, uno dei concorrenti più rilevanti di OpenAI. Dal 2023 ha investito 8 miliardi di dollari nella società e, nello stesso mese dell’annuncio su OpenAI, ha comunicato l’intenzione di investire fino a 25 miliardi aggiuntivi insieme a un contratto cloud da 100 miliardi di dollari.

Non c’è contraddizione industriale. Amazon sta adottando una strategia di portafoglio: sostiene più laboratori, aumenta il traffico e i carichi di lavoro su Aws e si assicura che i suoi clienti trovino sul cloud di casa i modelli più richiesti, qualunque sia il produttore. È un approccio diverso da quello di Microsoft, che ha costruito con OpenAI un rapporto molto più integrato ed esclusivo, almeno fino alla recente revisione.

Per i clienti aziendali questo pluralismo può tradursi in maggiore libertà di scelta. Per i laboratori di AI significa invece accettare un equilibrio più complesso: ottenere capitale e infrastrutture dai colossi del cloud senza finire assorbiti nella loro offerta. OpenAI, con l’accordo su Aws, sembra voler presidiare proprio questo spazio intermedio.

La clausola AGI e il valore politico dei contratti

Tra i dettagli più rilevanti della rinegoziazione con Microsoft c’è la rimozione della cosiddetta “clausola AGI”, definita controversa. Quel passaggio aveva un peso non solo legale ma anche simbolico. Nei rapporti tra OpenAI e i suoi partner, la possibilità che la società dichiari di aver raggiunto una forma avanzata di intelligenza artificiale generale ha sempre avuto implicazioni decisive sull’accesso alla tecnologia e sui diritti economici.

Eliminare o ridefinire quella clausola significa ridurre una fonte di conflitto potenziale e rendere più lineari i rapporti commerciali. Significa anche riconoscere che il settore, oggi, ha bisogno di regole meno legate a scenari teorici e più adatte a gestire flussi di ricavi, infrastrutture e canali di distribuzione molto concreti.

Il lessico dell’AGI resta al centro della narrazione pubblica sull’intelligenza artificiale, ma i contratti mostrano che le priorità immediate riguardano soprattutto accesso al mercato, margini, governance tecnologica e capacità di calcolo.

Che cosa cambia per il mercato

L’intesa tra OpenAI e Amazon produce almeno tre effetti.

- Il primo riguarda la distribuzione: i modelli di OpenAI arrivano a una base enorme di clienti Aws senza passare necessariamente da Azure.

- Il secondo riguarda la concorrenza nel cloud: Amazon rafforza la propria proposta ai clienti enterprise e sottrae a Microsoft una rendita derivante dall’esclusiva.

- Il terzo riguarda la struttura del mercato dell’AI: i laboratori più importanti diventano sempre meno dipendenti da un solo partner, mentre i grandi cloud provider si attrezzano per offrire cataloghi multipli e servizi gestiti attorno agli agenti.

La disponibilità del modello 5.5 su Bedrock nelle prossime settimane va in questa direzione. Per gli sviluppatori significa poter lavorare con i sistemi più recenti senza uscire dall’ambiente Aws. Per Amazon è una leva commerciale. Per OpenAI è un test decisivo sulla propria capacità di comportarsi come fornitore trasversale, non più legato a un solo canale di vendita.

Una partita che vale più della singola alleanza

Dietro l’annuncio non c’è soltanto un nuovo accordo commerciale. C’è il tentativo di ridisegnare la catena del valore dell’intelligenza artificiale. Chi controlla i modelli vuole più canali e più infrastrutture. Chi controlla il cloud vuole più modelli e più clienti enterprise. I confini tra investitore, fornitore e concorrente si sono fatti più labili.

OpenAI entra su Aws in un momento in cui il mercato sta passando dalla fase della dimostrazione a quella dell’adozione. Le imprese non chiedono più soltanto di provare l’AI, chiedono di metterla al lavoro. Per farlo servono modelli potenti, ma servono anche contratti meno rigidi, piattaforme interoperabili e investimenti colossali in data center.

L’accordo con Amazon mostra che la fase delle alleanze esclusive si sta indebolendo. Al suo posto emerge un sistema di relazioni più aperto, ma anche più instabile, in cui ogni intesa può rafforzare un partner e indebolirne un altro. È qui che si misura la posta economica reale dell’intelligenza artificiale: non solo chi costruisce il modello migliore, ma chi riesce a portarlo dentro le aziende, sulle infrastrutture giuste, alle condizioni commerciali più sostenibili.