Mentre Google annuncia il suo Workspace AI dalla tribuna di Next ’26., OpenAI rilascia i workspace agents in ChatGPT, descritti come “evoluzione delle GPT” e spinti dallo stesso motore di Codex.

Il lancio arriva a valle della settimana in cui OpenAI ha rilasciato ChatGPT Images 2, Chronicle in Codex e il Codex per Mac, ed è l’ennesimo tassello di una pressione continua sul mercato degli agenti enterprise che vede Microsoft con Foundry Agent Service, Notion con Custom Agents, Google con Vertex Agent Builder, Anthropic con Claude in ambienti verticali.

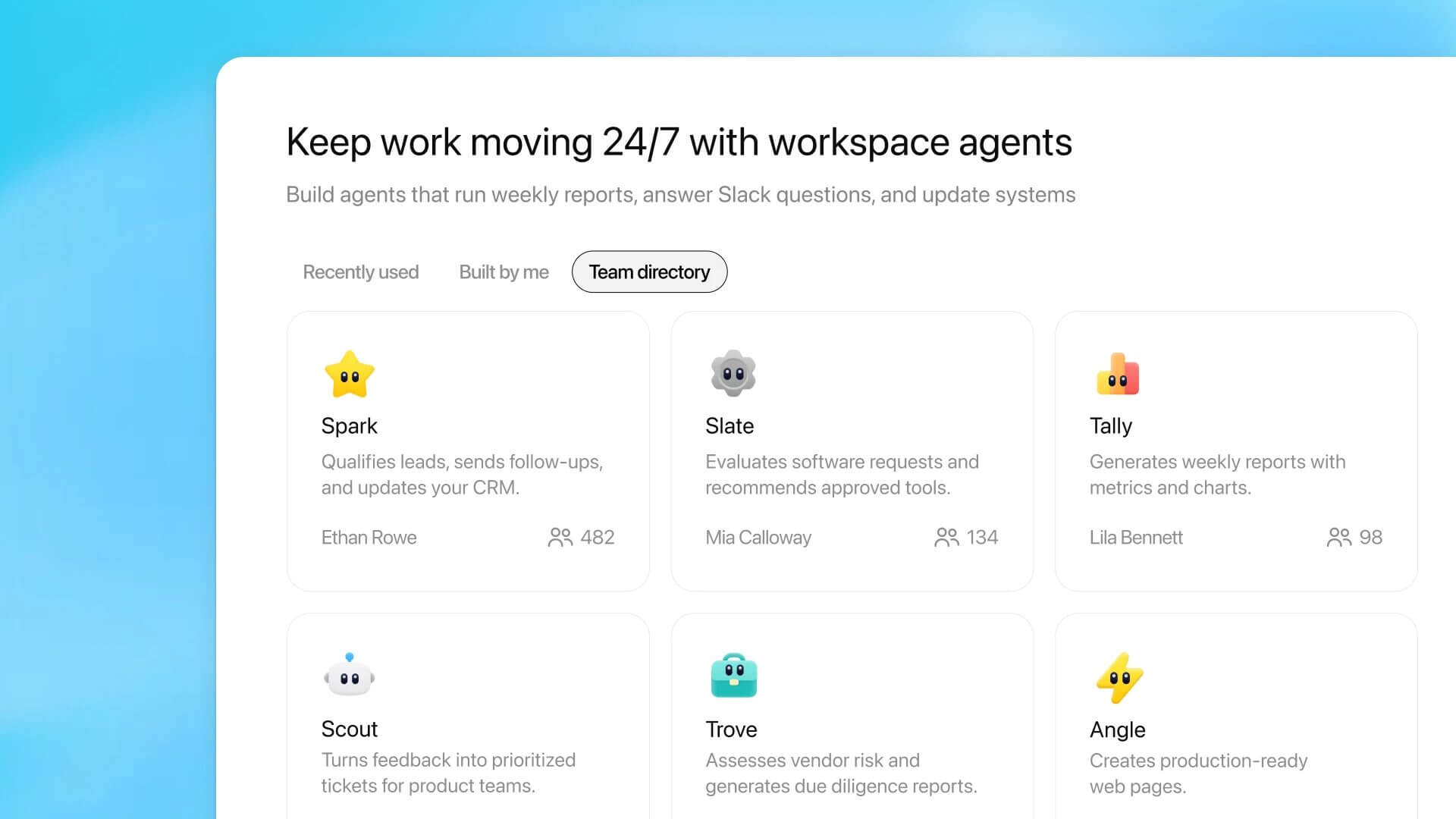

Il punto di rottura rispetto alle Custom GPT è che gli agenti smettono di essere uno strumento individuale con un prompt lungo e qualche file allegato, e diventano oggetti di team. Ognuno con il proprio workspace, la propria memoria persistente, l’accesso a codice, file e tool, il collegamento diretto a Slack dove possono ricevere richieste in autonomia, e un pannello di amministrazione con role-based controls che regolano chi può crearli e condividerli con quali permessi.

Chi costruisce oggi processi interni basati su GPT custom si ritrova davanti a una nuova superficie sostanzialmente diversa, e a una domanda concreta, quando e come vale la pena migrare.

OpenAI dichiara che un convertitore da GPT a workspace agent è in arrivo, ma intanto le due cose convivono, e bisogna capire quale va bene per cosa.

Indice degli argomenti:

Cosa cambia davvero rispetto alle Custom GPT

La differenza architetturale, letta dai comunicati e dai dettagli tecnici pubblicati, si gioca su tre assi. Il primo è la persistenza, una Custom GPT è uno stampo statico che risponde a ogni chat a partire dalle stesse istruzioni, un workspace agent invece ha memoria che attraversa le sessioni, e può accumulare contesto, correzioni, preferenze di un team nel tempo.

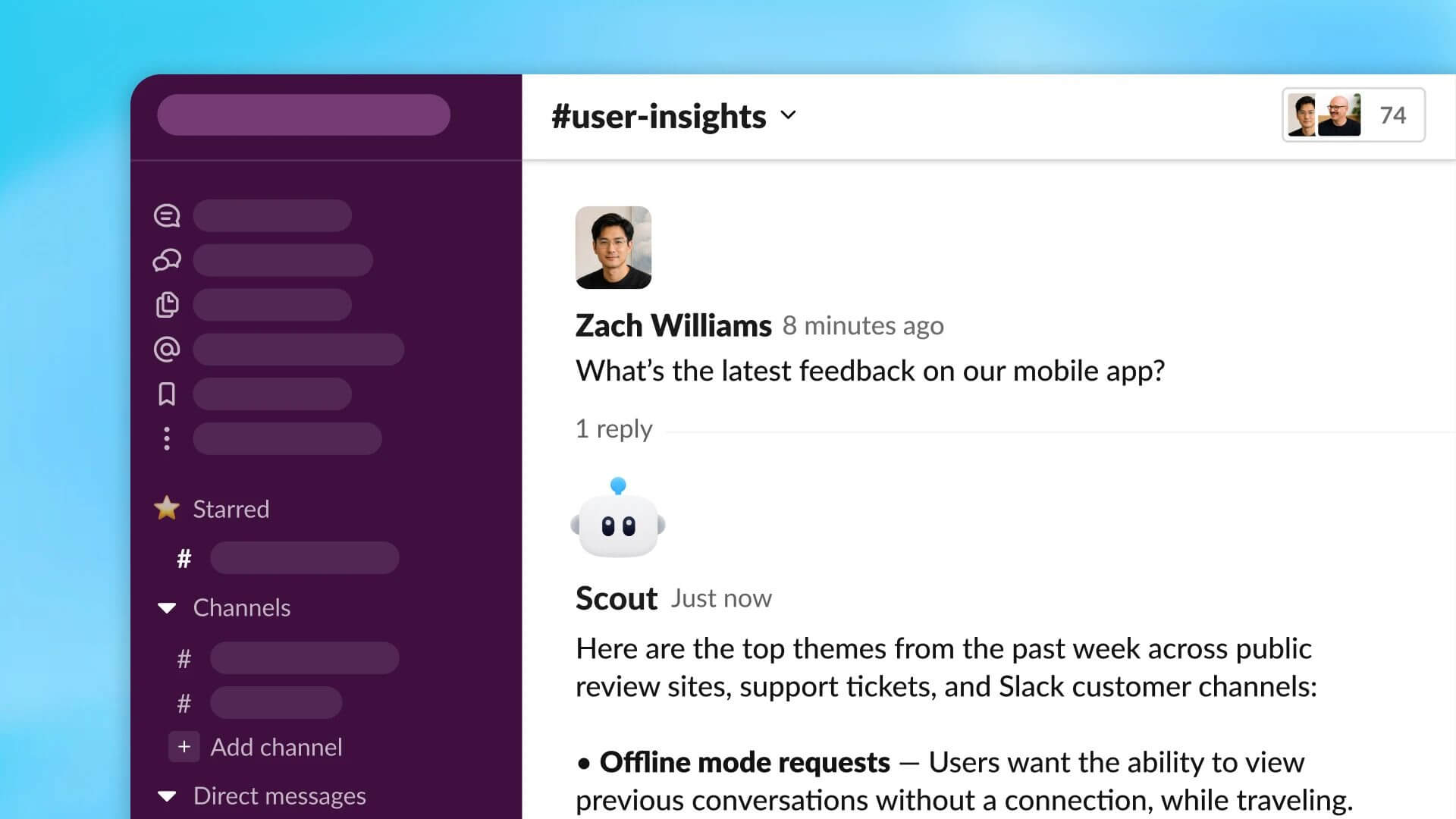

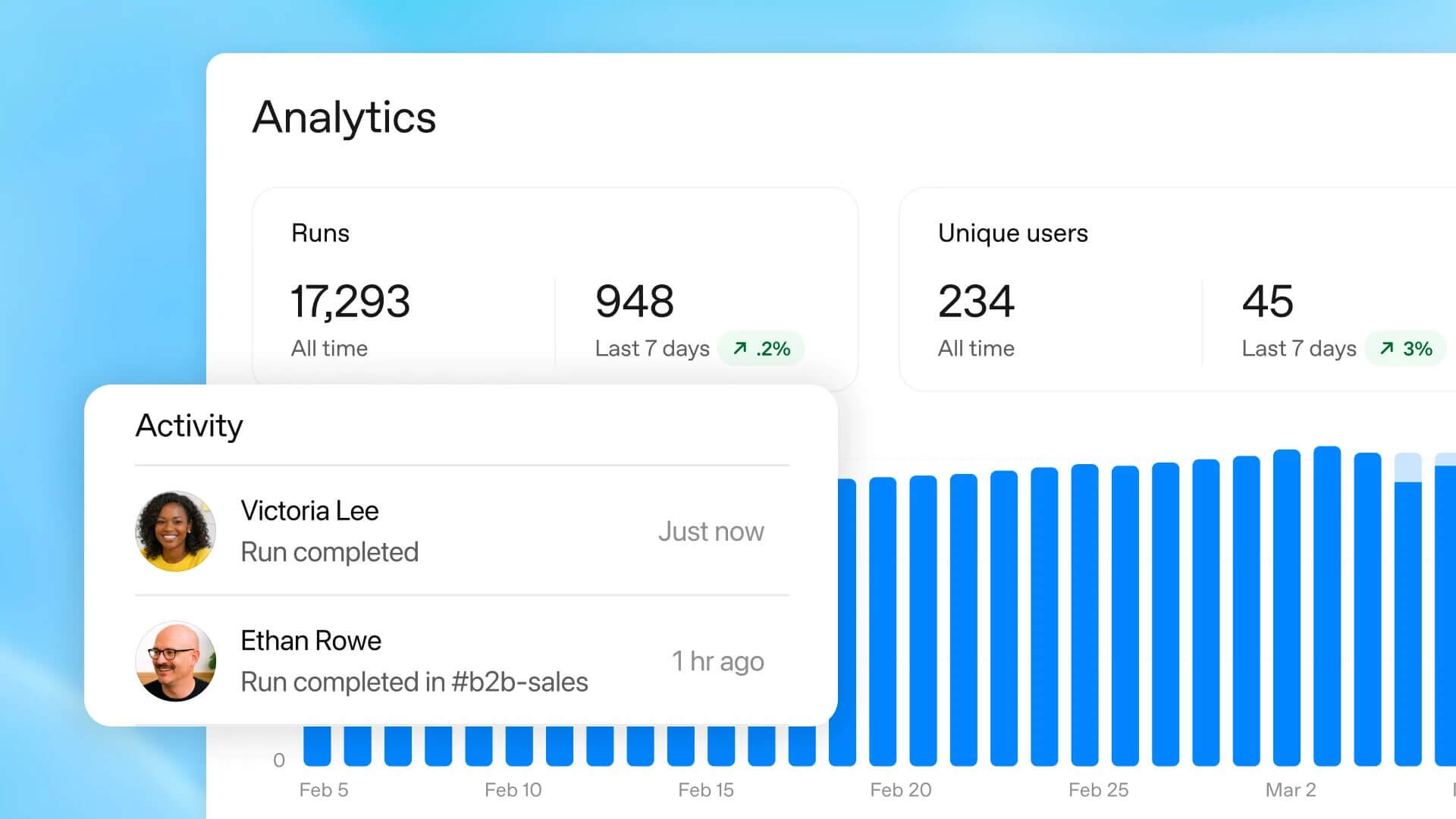

Il secondo asse è l‘autonomia operativa, l’agente può essere messo su schedule o collegato a Slack, e da lì prende in carico richieste senza essere prompt ogni volta dall’utente. Diventa una presenza continua nel flusso di lavoro, non un assistente che si accende solo quando qualcuno apre ChatGPT. Le azioni sensibili, tipo mandare un’email o creare un evento in calendario, richiedono approvazione, e l’admin vede quante volte un agente condiviso viene usato tramite analitiche.

Il terzo asse è l’orientamento al team, non al singolo. Un workspace agent ha accesso controllato a file, tool e connettori definiti dal workspace, segue il workflow di un gruppo, passa le approvazioni attraverso i ruoli giusti, e può essere duplicato o condiviso come template per altri processi simili.

Le Custom GPT facevano qualcosa di simile solo in modo superficiale, perché il concetto di ruolo e di permesso nativo non c’era, e la memoria semplicemente non esisteva.

Codex come motore e la logica dell’always-on

La scelta di far girare i workspace agent su Codex è tecnicamente rilevante e strategicamente coerente. Codex è il motore che OpenAI ha sviluppato per task di lungo orizzonte, con gestione di worktree isolati, capacità di eseguire codice, diff review, e orchestrazione di più task in parallelo. Portarlo sotto ai workspace agent significa ereditare un’infrastruttura pensata per compiti che durano, non per risposte immediate.

Le indiscrezioni emerse nelle settimane precedenti al lancio, riferite al progetto interno “Hermes”, parlavano di agenti always-on, teammates 24/7, pensati per agire su cadenza, eventi e messaggi in arrivo invece di aspettare un prompt. I workspace agents annunciati oggi sembrano la prima incarnazione pubblica di quella direzione, anche se la versione Research Preview lascia aperto quanto le funzionalità di scheduling e trigger siano già mature.

La promessa è ambiziosa, impacchettare la conoscenza che oggi vive dispersa tra persone e sistemi dentro workflow riutilizzabili, che seguano il processo giusto e usino i tool giusti.

Un team definisce un agente una volta, lo raffina nel tempo, lo duplica per casi nuovi. Se la promessa regge, il profilo d’uso somiglia meno a quello di un chatbot e più a quello di un collega che apprende le regole della casa e ci si adegua.

Set up rapido e integrazione con Slack

Il flusso di creazione è volutamente semplice: l’utente descrive un workflow ricorrente o carica un file, e ChatGPT trasforma tutto in un agente definendo step, connettendo tool, aggiungendo skill e testando il risultato. È lo stesso modello conversazionale delle Custom GPT, ma applicato a una cosa più complessa, e con un output che è un oggetto vivo invece che una configurazione statica.

L’integrazione con Slack è probabilmente la feature più pratica del lancio, perché sposta il punto di contatto dove le conversazioni di team avvengono davvero. Un agente configurato per un processo di customer support o di sales ops può essere invocato direttamente da un canale, prendere in carico la richiesta, chiedere conferme quando servono, e chiudere il task senza che nessuno apra ChatGPT. OpenAI anticipa che altre integrazioni arriveranno a valle di questa.

Gli admin hanno controlli granulari su quali tool e quali dati ciascun agente può toccare, e su quando serve un’approvazione umana. Le analitiche d’uso, sebbene non descritte in dettaglio, sono l’indicatore che la redazione aziendale dell’agente è trattata come un prodotto interno, con dashboard d’adozione e metriche di utilizzo continuo nel tempo.

Chi ha gestito piattaforme interne lo sa, se non c’è il dashboard d’uso, la piattaforma muore silenziosa.

Rolling out graduale e modello economico

La distribuzione segue un pattern prudente: research preview su Business, Enterprise, Edu e Teachers, con admin degli Enterprise ed Edu che possono attivare la feature tramite role-based controls. Niente rollout su Plus e Pro al momento del lancio, il che è coerente con un posizionamento B2B, e con la volontà di testare carichi e pattern d’uso su clienti strutturati prima di aprire al pubblico più ampio.

La finestra gratuita fino al 6 maggio 2026 ha concesso un margine di circa due settimane in cui i team hanno potuto sperimentare senza costi, dopodiché è entrato in vigore il modello credit-based.

Non sono pubblici prezzi e soglie, ma l’impostazione a credito lascia intuire un modello di tariffazione a consumo che scala col numero di task eseguiti, non con il numero di agenti creati. Per i team che vogliono valutare seriamente, questa finestra è breve, e richiede di preparare prima un paio di workflow candidati, invece di arrivare il 3 maggio con una GPT da migrare.

Nel più ampio contesto competitivo, questa mossa posiziona OpenAI in modo frontale rispetto a Notion, che ha giocato per prima la carta degli agenti condivisi con Custom Agents, e rispetto a Microsoft, che con Foundry Agent Service opera a un livello infrastrutturale più basso ma con un’integrazione con M365 che OpenAI non ha.

La differenza, dal punto di vista dell’utente aziendale, è che ChatGPT come surface è già nelle mani di decine di milioni di professionisti, e ora quella superficie ospita agenti persistenti con memoria, schedule e Slack integrato.

La domanda di governance che nessuno può più rimandare

Lo spostamento dagli strumenti individuali ai teammates persistenti apre un tema di governance che molte aziende hanno finora potuto rimandare, perché le Custom GPT vivevano dentro l’account singolo e producevano rischi contenuti. Un workspace agent ha memoria condivisa, accesso a connettori aziendali, capacità di eseguire azioni verso sistemi esterni, e un ciclo di vita che va oltre la singola chat.

I responsabili di security e compliance si troveranno a rispondere a domande che prima non si ponevano. Chi possiede i dati che l’agente ricorda? Cosa succede quando un dipendente che ha creato un agente lascia l’azienda? Come si audit-ano le decisioni prese dall’agente in autonomia? Quali DLP policy si applicano sui dati che l’agente muove da Slack a un database e viceversa?

Le risposte di prodotto ci saranno, in parte ci sono già, ma vanno tradotte in policy interne prima di passare in produzione.

La lezione che emerge dai lanci di piattaforma agentica di queste settimane, da Foundry a Notion, da Google a OpenAI, è convergente, gli agenti intelligenti li sa costruire chiunque abbia un buon modello, ma renderli sicuri, tracciabili e governabili è il vero lavoro. Chi adotta questi strumenti oggi senza investire in un framework di governance si troverà domani a dover ricostruire controlli sopra agenti già in produzione, e quello è il momento peggiore per farlo.

Il segnale per chi costruisce su ChatGPT oggi

Per i team che hanno già investito seriamente sulle Custom GPT, il messaggio da leggere è duplice. Da una parte, OpenAI promette un convertitore, il che riduce il rischio di dover rifare tutto, e segnala che la retrocompatibilità è nella roadmap. Dall’altra, la nuova primitiva ha un modello mentale diverso, è un oggetto di team, persistente, integrato, e pretende una redazione diversa degli stessi workflow.

Il consiglio operativo più onesto che si può dare è di non migrare tutto subito, ma di prendere due o tre casi d’uso in cui la memoria persistente, il collegamento con Slack, o lo scheduling fanno davvero la differenza, e costruirli come workspace agents nativi. I casi in cui una GPT classica funziona ancora bene (prompt template, assistenti di scrittura, bot informativi) possono restare dove sono, almeno fino a quando il convertitore non sarà disponibile e testato.

Senza dubbio, la domanda che resta aperta è se questa evoluzione di ChatGPT da strumento per singoli a piattaforma per team si concretizzerà in un’adozione reale nelle aziende, o se la saturazione di annunci sugli agenti finirà per produrre più fatica di adozione che valore operativo per chi deve effettivamente lavorarci dentro?