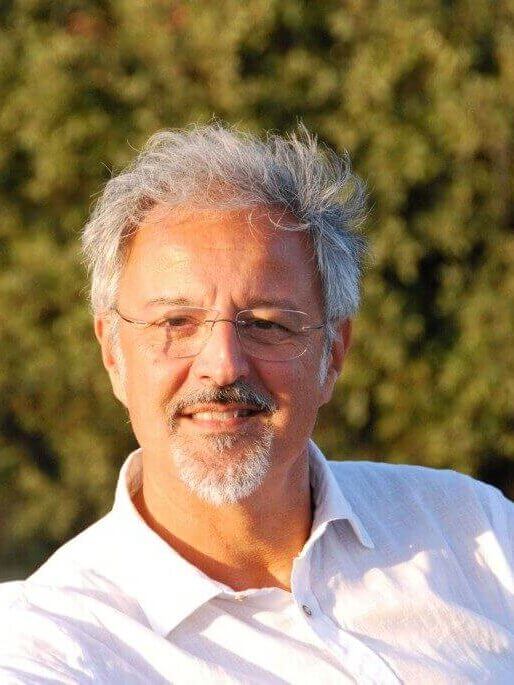

Dino Pedreschi, docente di Informatica all’Università di Pisa, è stato nominato vice-chair del gruppo di lavoro europeo incaricato di sviluppare il Code of Practice on transparency of AI-generated content, uno dei pilastri del nuovo Regolamento europeo sull’Intelligenza Artificiale (AI Act).

La nomina, annunciata dalla Commissione Europea il 5 novembre 2025, segna l’avvio ufficiale dei lavori che porteranno nei prossimi mesi alla pubblicazione della prima versione del codice.

Indice degli argomenti:

Trasparenza e fiducia nell’era dell’AI generativa

Il Code of Practice, promosso dallo European AI Office della Commissione Europea, mira a definire linee guida operative per la marcatura e l’etichettatura dei contenuti generati da sistemi di intelligenza artificiale – testi, immagini, audio e video – rendendoli chiaramente riconoscibili come tali.

Lo strumento è destinato a supportare l’attuazione dell’articolo 50 dell’AI Act, che obbliga fornitori e utilizzatori di modelli generativi a segnalare quando un contenuto è stato prodotto artificialmente. L’obiettivo è contrastare la disinformazione e rafforzare la fiducia dei cittadini nelle tecnologie basate su AI.

Buone pratiche per l’intelligenza artificiale responsabile

Il gruppo di lavoro riunisce esperti accademici, rappresentanti dell’industria e organizzazioni della società civile europea. In qualità di vice-chair, Pedreschi contribuirà alla definizione delle buone pratiche di trasparenza e responsabilità per i sistemi di nuova generazione, con particolare attenzione ai fornitori di modelli di AI generativa.

“Il codice di condotta sulla trasparenza dei contenuti generati dall’IA sarà uno strumento volontario volto ad aiutare i fornitori di sistemi di IA generativa a rispettare i loro obblighi di trasparenza – commenta Pedreschi – Il codice supporterà l’etichettatura dei contenuti generati dall’IA, inclusi audio, immagini, video e testo sintetici, in formati leggibili dalle macchine per consentirne il rilevamento.”

Etichettare per informare e tutelare

Pedreschi sottolinea anche il ruolo del codice nel supportare gli utilizzatori dei sistemi di IA generativa: “Aiuterà anche gli utilizzatori che usano deepfake o contenuti generati dall’IA nel dichiarare chiaramente il coinvolgimento dell’IA, specialmente quando informano il pubblico su questioni di interesse generale.”

Questa iniziativa rappresenta un passo importante verso una cultura della trasparenza e della responsabilità digitale, rafforzando l’impegno dell’Unione Europea nel garantire che l’uso dell’intelligenza artificiale sia etico, tracciabile e al servizio della collettività.