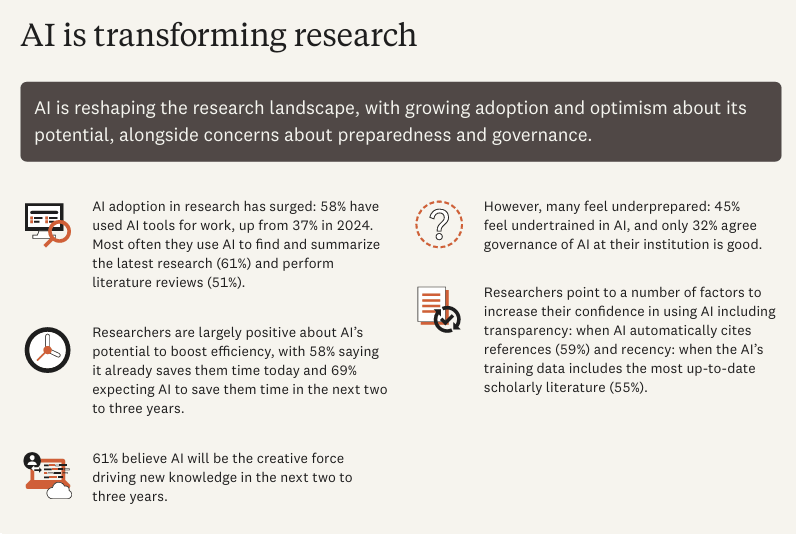

L’intelligenza artificiale è ormai entrata nei flussi di lavoro della ricerca. Serve a cercare e sintetizzare studi, accelerare le literature review, supportare il coding, aiutare nell’analisi dei dati e alleggerire una parte del lavoro preparatorio nelle grant application. Secondo Elsevier, gruppo internazionale attivo nell’informazione scientifica e nell’editoria accademica, nel report 2025 “Researcher of the Future — A Confidence in Research”, basato su oltre 3.200 ricercatori attivi in 113 Paesi, il 58% dei ricercatori usa già strumenti di AI nel proprio lavoro; tra gli impieghi più frequenti:

- il 61% li usa per trovare e sintetizzare nuovi studi,

- il 51% per le literature review

- il 38% per l’analisi dei dati.

L’adozione, però, sta cambiando natura. Non si parla più soltanto di sperimentazione a basso costo o di qualche licenza individuale.

Il 12 maggio 2026 Nature, settimanale scientifico internazionale, ha raccontato il caso del laboratorio guidato a Stanford dal biomedical data scientist James Zou, che nell’ultimo anno ha speso oltre 100 mila dollari in strumenti di AI per attività di ricerca. La soglia è significativa perché sposta l’AI da spesa di produttività a voce di budget strutturale.

Indice degli argomenti:

Dove l’AI crea valore nella ricerca

Il primo vantaggio è la riduzione del tempo sulle attività ad alta intensità informativa. Trovare articoli rilevanti, riassumere letteratura, ripulire dati, preparare codice di supporto o costruire una prima struttura di lavoro sono compiti in cui l’AI può comprimere tempi e passaggi manuali.

Nel report 2025 di Elsevier, il 58% dei ricercatori afferma che l’AI fa già risparmiare tempo, mentre quasi il 70% si aspetta un beneficio ancora maggiore nei prossimi anni.

C’è poi un secondo livello, più ambizioso, che riguarda il supporto alla formulazione di ipotesi e alla progettazione della ricerca.

Nel febbraio 2025, Google Research ha presentato “AI co-scientist”, descritto come un sistema multi-agent costruito per aiutare gli scienziati a generare ipotesi e proposte di ricerca, da sottoporre comunque a validazione sperimentale.

È un segnale importante: l’AI non si limita più a velocizzare compiti accessori, ma punta a entrare anche nelle fasi più qualificate del lavoro scientifico.

Perché i costi reali stanno crescendo

Il punto critico è che il prezzo d’ingresso dice sempre meno sul costo effettivo. Nella ricerca, i workflow sono spesso lunghi, iterativi e multi-sessione: si passa continuamente da prompt, ragionamento, coding, verifica, ritorno sui dati e nuova interrogazione del modello. In questo contesto, il consumo reale cresce molto più in fretta di quanto lasci intuire un canone mensile.

Il mercato sta già correggendo questa distorsione. Il 27 aprile 2026, GitHub ha annunciato ufficialmente che, dal 1 giugno 2026, Copilot passerà a un modello di fatturazione basato sul consumo effettivo tramite AI Credits, spiegando che l’uso agentico e le sessioni multi-step hanno aumentato in modo significativo i costi di inferenza. Il messaggio è questo: più i modelli vengono usati come agenti operativi e non come semplici assistenti, più il costo si sposta dal forfait al consumo.

Anche i piani premium si stanno articolando per intercettare l’uso intensivo. Nella documentazione aggiornata di OpenAI sui piani ChatGPT Pro, disponibile a maggio 2026, i livelli Pro sono indicati a 100 e 200 dollari al mese, con soglie di utilizzo molto più alte rispetto al piano Plus. Questo non prova da solo un aumento generalizzato dei prezzi, ma mostra che l’uso professionale pesante viene ormai segmentato su fasce dedicate.

Il costo nascosto: il lavoro umano di verifica

Il problema non è solo quanto costa l’accesso al modello. È anche quanto costa usarlo in modo affidabile. Nel caso raccontato da Nature, diversi ricercatori segnalano che il collo di bottiglia si sposta sul controllo degli output: verificare se il modello ha interpretato correttamente il contesto, capire quando la risposta comincia a deragliare, rifare parti del lavoro a mano, confrontare risultati.

Questo aspetto riduce il vantaggio economico atteso. Secondo Elsevier, nel report 2025 citato, solo il 22% dei ricercatori che usano AI dichiara di considerare affidabili questi strumenti; il 59% dice di fidarsi di più quando le risposte includono riferimenti chiari, mentre il 49% indica la validazione umana regolare come condizione necessaria.

In pratica, una parte del lavoro che l’AI promette di eliminare ritorna come costo di supervisione, controllo qualità e responsabilità metodologica.

Quando il modello più economico finisce per costare di più

C’è poi un nodo meno intuitivo, ma molto rilevante per chi gestisce budget di ricerca. Nel marzo 2026 un preprint pubblicato su arXiv con il titolo “The Price Reversal Phenomenon: When Cheaper Reasoning Models End Up Costing More” ha osservato che nel 21,8% dei confronti tra coppie di modelli quello con il prezzo di listino più basso genera in realtà un costo totale più alto; in alcuni casi il divario arriva fino a 28 volte.

La ragione, secondo gli autori, sta soprattutto nella grande variabilità del consumo di thinking tokens tra modelli diversi.

Per chi lavora in laboratorio, questo cambia il criterio di acquisto. Non basta più guardare il prezzo per token o il costo dell’abbonamento. Bisogna misurare il costo del task completo, includendo numero di iterazioni, qualità del risultato, tempo umano richiesto per la verifica e continuità del workflow.

Questa lettura emerge bene anche da una sintesi dei segnali più recenti.

| Indicatore | Cosa segnala | Impatto per i team di ricerca |

|---|---|---|

| Oltre 100 mila dollari spesi in un anno da un laboratorio di Stanford | L’AI può diventare una voce di spesa comparabile a personale qualificato | Serve budget dedicato, non più solo spesa accessoria |

| Passaggio di Copilot al billing a consumo dal 1 giugno 2026 | I fornitori stanno spostando il costo verso l’uso effettivo | I workflow intensivi diventano meno prevedibili |

| Piani ChatGPT Pro da 100 e 200 dollari al mese | L’uso pesante viene collocato su fasce premium | Il prezzo base non copre tutti i casi d’uso |

| 58% dei ricercatori usa AI, ma solo il 32% valuta buona la governance | L’adozione corre più veloce delle regole interne | Crescono rischio operativo e uso disomogeneo |

| Solo il 22% degli utilizzatori si fida degli strumenti AI | Il valore non elimina il problema dell’affidabilità | La verifica resta lavoro umano e ha un costo |

Gli altri trade-off: accesso, governance, riservatezza

Il primo trade-off è economico e competitivo. Se le funzioni migliori richiedono piani premium o billing a consumo, l’AI rischia di accentuare una logica di pay-to-win tra gruppi di ricerca con disponibilità molto diverse. Lo stesso articolo di Nature mette in evidenza il timore che il passaggio a modelli più costosi allarghi il divario tra chi può permettersi accesso premium e chi no.

Il secondo trade-off è organizzativo. Sempre secondo Elsevier, nel report 2025 già citato, il 45% dei ricercatori si sente sottoformato sull’uso dell’AI e solo il 32% giudica buona la governance AI della propria istituzione.

Un quadro simile emerge anche da Wiley, editore scientifico internazionale, che nella ricerca “ExplanAItions” diffusa nel febbraio 2025 e costruita su quasi 5 mila ricercatori, segnala che oltre il 60% indica nella mancanza di linee guida e formazione una barriera importante a un uso più esteso dell’AI.

Il problema, quindi, non è soltanto comprare licenze: è creare regole, competenze e processi di utilizzo coerenti.

Il terzo trade-off riguarda la riservatezza. Nelle linee guida per i revisori pubblicate da UK Research and Innovation nel luglio 2025, l’ente britannico chiarisce che l’inserimento di materiale confidenziale in strumenti di generative AI costituisce una violazione della riservatezza e dell’integrità del processo.

Per peer review, grant application, documenti non pubblici, dati proprietari o ricerca soggetta a vincoli contrattuali, il costo di un errore può superare rapidamente il beneficio di produttività.

Quando l’AI conviene davvero

L’AI conviene soprattutto nei task ad alto volume e basso rischio, dove un ricercatore esperto può controllare facilmente il risultato: screening iniziale della letteratura, organizzazione di appunti, sintesi preliminari, supporto al coding, esplorazione di dataset non sensibili, prime bozze operative da rivedere. In questi casi il guadagno di tempo tende a essere concreto.

Conviene molto meno, o richiede regole molto più rigide, quando il workflow pretende tracciabilità forte, accuratezza non negoziabile, riservatezza o solidità metodologica: peer review, valutazioni comparative, grant review, ricerca qualitativa, interpretazione fine dei risultati, documenti che non tollerano errori o fughe di dati.

L’AI, quindi, non va letta né come scorciatoia universale né come costo da evitare in blocco. Sta diventando una capacità infrastrutturale della ricerca, ma con un conto economico diverso da quello che molti avevano immaginato nei primi mesi di adozione. Il vantaggio resta reale.

Il punto è che il costo reale, nel 2026, non coincide più con l’abbonamento: comprende consumo effettivo, ore di verifica, regole di governance, formazione e gestione del rischio. Per laboratori, università e centri R&D, è su questa base che va deciso dove l’AI produce davvero valore netto.