Anthropic si trova a gestire una crisi inattesa dopo aver esposto accidentalmente le istruzioni interne del suo agente AI, Claude Code. L’errore ha reso pubblici elementi chiave del funzionamento del sistema, spingendo l’azienda a intervenire rapidamente.

Nel giro di poche ore, sono state inviate oltre 8mila richieste di rimozione per eliminare copie del codice condivise sulla piattaforma GitHub. L’obiettivo: limitare la diffusione di materiale altamente sensibile.

Indice degli argomenti:

Nessun dato utente, ma danni strategici

Secondo l’azienda, il leak non ha coinvolto dati dei clienti né i modelli matematici più preziosi dell’AI. Si tratterebbe di un errore umano nella fase di pubblicazione del software, non di una violazione informatica.

Tuttavia, il danno è tutt’altro che trascurabile. Il codice rivelato contiene tecniche proprietarie – definite “harness” – utilizzate per guidare e controllare i modelli AI. Questi strumenti rappresentano un vantaggio competitivo cruciale.

Un vantaggio per concorrenti e hacker

La pubblicazione accidentale offre a concorrenti e startup una vera e propria “mappa” per replicare le funzionalità di Claude Code senza doverle sviluppare da zero. In un settore già estremamente competitivo, questo potrebbe accelerare lo sviluppo di alternative simili.

Allo stesso tempo, il leak espone il sistema a potenziali vulnerabilità: hacker potrebbero analizzare il codice per individuare bug o sfruttarlo per manipolare i modelli AI in attacchi informatici.

Il cuore del successo: il “tooling” AI

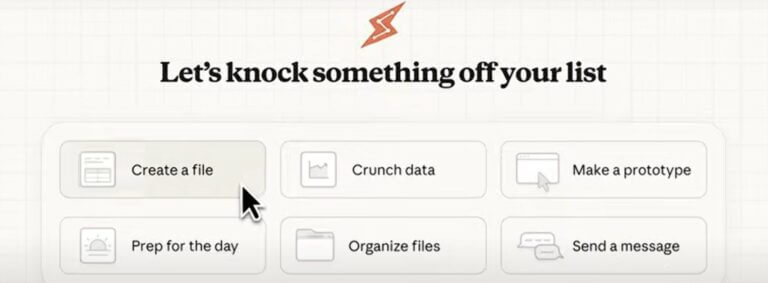

Gran parte del successo di Claude Code deriva dalla sua capacità di orchestrare modelli AI complessi per assistere gli sviluppatori. Questo processo, noto come “tooling”, è considerato tanto un’arte quanto una scienza.

Le informazioni trapelate mostrano alcune strategie sorprendenti:

- sistemi di “memoria” che consolidano informazioni nel tempo (“dreaming”)

- istruzioni per nascondere la natura AI in alcuni contesti

- riferimenti a funzionalità future

- persino un assistente virtuale in stile Tamagotchi chiamato “Buddy”

Una diffusione impossibile da fermare

Nonostante gli sforzi legali, la diffusione del codice si è rivelata difficile da contenere. Alcuni sviluppatori hanno già riscritto le funzionalità in altri linguaggi di programmazione, aggirando di fatto le richieste di rimozione.

Questo ha trasformato la vicenda in un classico gioco del gatto e del topo digitale, dove ogni tentativo di eliminazione genera nuove copie e varianti.

Impatti su reputazione e mercato

Per Anthropic, il danno è duplice: da un lato il rischio reputazionale, soprattutto per un’azienda che punta sulla sicurezza; dall’altro la perdita di segreti industriali in una fase cruciale di crescita.

Il successo virale di Claude Code aveva infatti contribuito a spingere la valutazione dell’azienda fino a 380 miliardi di dollari, in vista di una possibile quotazione in borsa.

Ora, la sfida sarà dimostrare di poter mantenere il controllo tecnologico in una delle competizioni più intense del settore tecnologico globale.