«Il 2023 è stato l’anno della sperimentazione, ma nel 2025 siamo entrati in quella che chiamo l’era del divario dell’AI», ha esordito così Marinela Profi, global AI and Generative AI market strategy lead di SAS, nel suo intervento “LLMs alone don’t solve business problems” durante l’AI Week 2025.

Profi descrive così l’attuale fase storica in cui viviamo, ribadendo che è necessario fare una riflessione sul reale stato di adozione dell’AI e degli AI Agent nelle imprese: «Da un lato, le persone stanno abbracciando l’AI generativa con entusiasmo crescente; dall’altro, le aziende sono bloccate tra le promesse e la difficile realtà dell’adozione».

L’uso individuale è in piena espansione: dalle attività quotidiane come scrivere un testo o fare ricerche, si è passati a impieghi più profondi, come il supporto psicologico e la definizione degli obiettivi personali. Tuttavia, «il salto verso un’adozione efficace dell’AI generativa nelle imprese è ben più complesso», avverte Profi.

Indice degli argomenti:

Perché gli LLM da soli non bastano e bisogna puntare sull’adozione degli AI Agent

Un nodo cruciale nell’adozione degli AI Agent è il fraintendimento del ruolo dei Large Language Models. «Non possiamo aspettarci che un LLM risolva da solo un problema di business – ha detto Profi. Un LLM può scrivere una mail, ma non può sapere quando inviarla se non ha accesso al tuo calendario. È da qui che nasce l’AI agentica, che fornisce assistenti attivi che iniziano a utilizzare strumenti applicativi per prendere decisioni e agire, imparando dall’ambiente e adattandosi».

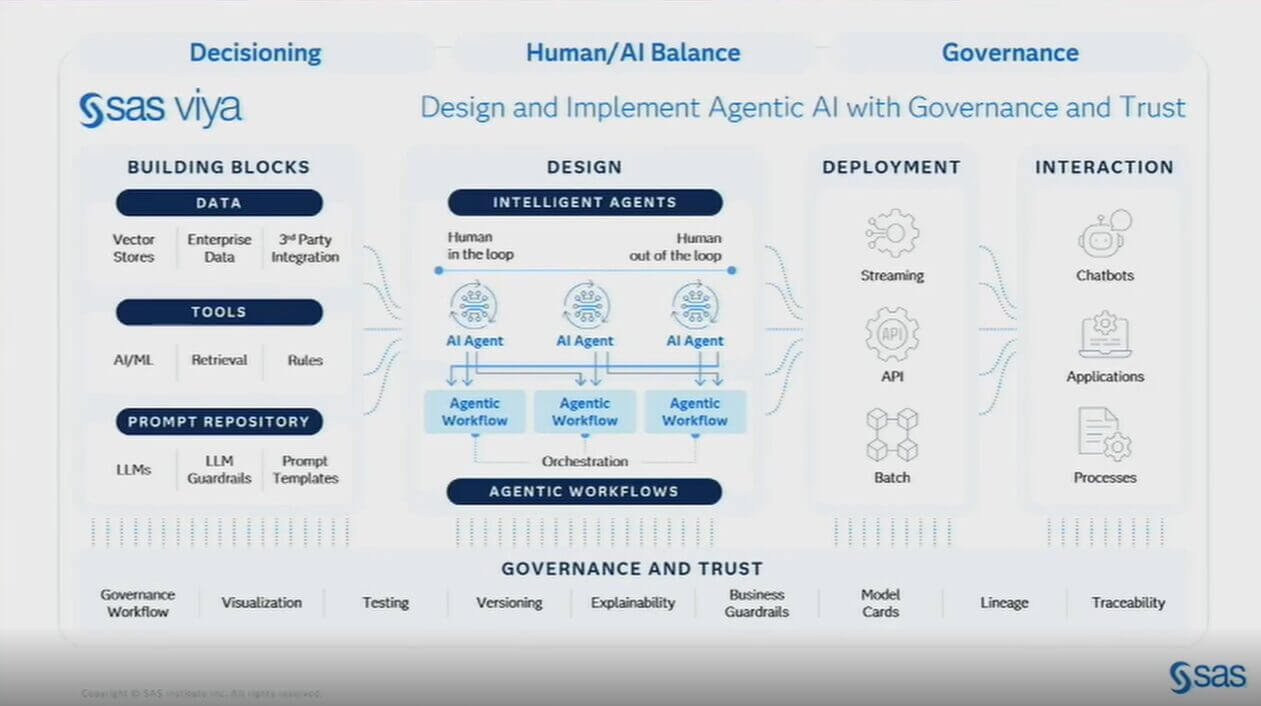

L’AI agentica non è un LLM con un’interfaccia più evoluta, ma un sistema complesso che integra diverse componenti: modelli deterministici, regole aziendali, strumenti di supervisione, memory layer e interazione umana.

Secondo le stime, entro il 2030 verranno investiti oltre 70 miliardi di dollari nello sviluppo e nell’adozione di AI Agent, a conferma di un interesse crescente a livello globale. Tuttavia, l’entusiasmo attuale rischia di concentrarsi su casi d’uso legati alla produttività individuale – come la generazione automatica di contenuti – trascurando le vere priorità aziendali. Le imprese non hanno bisogno di agenti che scrivano testi, ma di sistemi intelligenti capaci di supportare processi critici come l’analisi delle richieste assicurative, il rilevamento delle frodi o l’assistenza ai team di data science.

Tre lezioni fondamentali per l’adozione AI Agent in azienda

Durante l’intervento, Profi ha distillato tre lezioni fondamentali emerse da anni di esperienza sul campo in SAS:

1. Decisioni spiegabili oltre i LLM

L’impiego di LLM in scenari aziendali complessi introduce rischi legati alle “allucinazioni” del modello. «Non è accettabile che un agente AI prenda una decisione su una diagnosi clinica o un’autorizzazione a un prestito senza spiegabilità o validazione – ha ribadito. In questi casi, guardando agli agenti di intelligenza artificiale, emerge la necessità di andare gli LLM: serve un mix di modelli linguistici e deterministici, con sistemi di controllo e audit».

E la manager di SAS lo ha sottolineato portando alcuni esempi: pensando ad esempio alle applicazioni mission-critical – come l’elaborazione di richieste di risarcimento e il rilevamento frodi – non si può accettare alcun margine di errore. Ecco perché è opportuno ricordare che con gli agenti di intelligenza artificiale e i modelli linguistici di grandi dimensioni stiamo introducendo per la prima volta una componente probabilistica in un processo che fino ad oggi era interamente deterministico. In pratica, i modelli linguistici di grandi dimensioni non riescono ancora a dare il pieno supporto alle decisioni aziendali per le quali non si può accettare alcun livello di errore

2. L’autonomia non è sufficiente

Profi ha messo in guardia da una visione ingenua degli agenti AI come entità autonome e magiche. «Nelle imprese, l’autonomia deve essere affiancata da governance, verificabilità del perché una cosa è stata fatta in un certo modo e supervisione umana. Servono elementi come la mitigazione del rischio e il controllo, per assicurarsi che l’agente operi in conformità con i regolamenti e le responsabilità etiche. È una combinazione di tre elementi: la capacità di prendere decisioni accurate, l’equilibrio tra uomo e AI e la governance, appunto».

A supporto della sua analisi, ha poi condiviso un caso concreto sviluppato da SAS per un importante istituto bancario statunitense. L’agente AI realizzato per la valutazione del credit scoring integra tutte le componenti fondamentali di un sistema enterprise-grade: modelli linguistici di grandi dimensioni, regole di business personalizzate, guardrail aziendali, meccanismi di escalation verso operatori umani e strumenti di spiegabilità delle decisioni.

Tra questi, spicca un modulo di explainability visiva, progettato per tracciare ogni passaggio del processo decisionale e identificare eventuali errori o bias. A supporto della governance, viene utilizzata una model card che consente il monitoraggio continuo delle prestazioni del modello impiegato dall’agente.

«Quando parliamo di agenti AI per le imprese – ha sottolineato Profi – non possiamo limitarci a pensare in termini di un compito, un obiettivo, un LLM e un’azione. Serve una struttura articolata e controllabile, capace di adattarsi al contesto aziendale e di garantire affidabilità e trasparenza».

3. La qualità dei dati è il fondamento dell’AI agentica

«La verità è che tutti i problemi che avevamo con i dati 10 anni fa li abbiamo ancora oggi – e ora sono amplificati – ha spiegato. Con l’adozione degli AI Agent, la qualità dei dati testuali è diventata una sfida strategica». Profi ha presentato un caso d’uso di un’agenzia governativa USA: ottimizzando i dati testuali dell’LLM, sono passati da 6.000 a 600 ore di lavoro su un progetto: «Ecco quindi l’importanza di applicare e dare priorità alla qualità dei dati quando si tratta di modelli linguistici di grandi dimensioni».