Arm, azienda britannica attiva nella progettazione di microprocessori e architetture per semiconduttori, ha annunciato il lancio del suo primo chip proprietario per data center dedicati all’intelligenza artificiale. È un cambio netto rispetto al modello seguito da Arm finora, vendere progetti, non prodotti. Il primo cliente sarà Meta, che ha partecipato allo sviluppo del chip, seguita da OpenAI.

Indice degli argomenti:

Dal licensing al prodotto: una svolta strategica

La novità conferma quanto il boom dell’AI sia dirompente, al punto da mettere in discussione equilibri storici tra gli attori. Arm ha costruito il proprio successo su un modello unico: progettare architetture e concederle in licenza a centinaia di aziende, da Qualcomm ad Amazon e Microsoft. Questo approccio ha reso i suoi design lo standard di fatto per smartphone e sempre più per server.

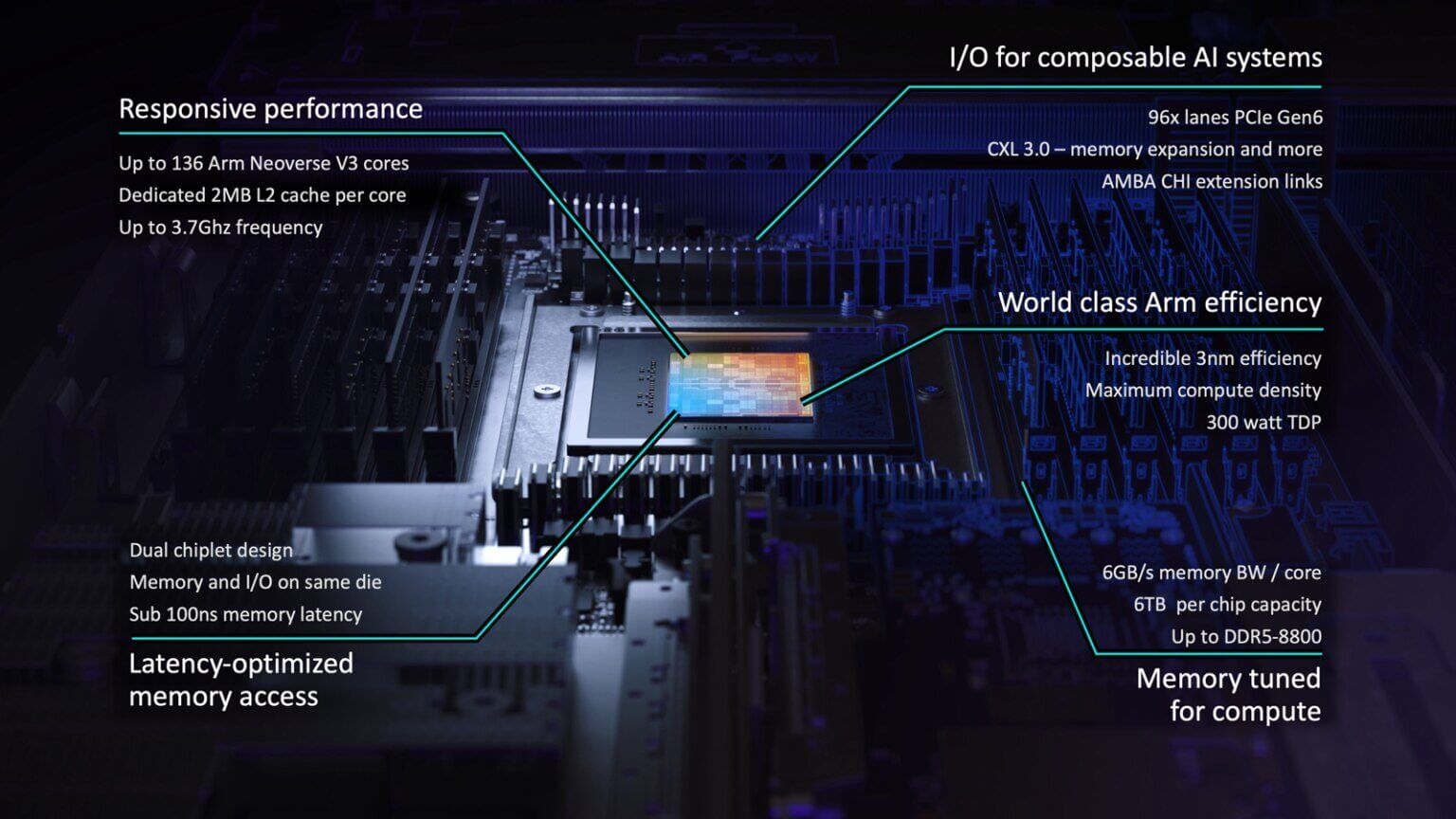

Con il nuovo chip – indicato come “Arm AGI CPU” – l’azienda entra direttamente nella vendita di silicio. Il processore, secondo i dati forniti dalla società, può arrivare fino a 136 core e promette un miglioramento significativo nel rapporto tra prestazioni e consumo energetico.

Pierre Ferragu, analista di New Street Research, ha definito questa scelta “la svolta strategica più importante nella storia di Arm”.

Il contesto: l’economia dei chip AI

Negli ultimi due anni com’è noto il mercato è stato dominato da Nvidia, i cui chip GPU sono diventati lo standard per l’addestramento dei modelli. La crescita è stata tale da portare l’azienda ai vertici mondiali per capitalizzazione.

Ma l’attenzione si sta spostando anche su altri componenti dell’infrastruttura AI:

- cpu per orchestrare carichi complessi;

- chip specializzati per inferenza;

- architetture ottimizzate per agenti autonomi.

Secondo dichiarazioni recenti del CEO di Nvidia Jensen Huang, i chip per gestire agenti AI potrebbero diventare un mercato da miliardi di dollari. Questo spiega perché Arm abbia deciso di presidiare direttamente una parte della catena del valore.

Clienti o concorrenti: la tensione con l’ecosistema

La scelta di vendere chip crea d’altro canto un conflitto potenziale. Le stesse aziende che oggi pagano Arm per usare le sue architetture sviluppano chip propri basati su quelle tecnologie.

Tra queste:

- Amazon con i chip Graviton

- Microsoft con le soluzioni Azure

- Ampere Computing nel cloud enterprise

Entrare nello stesso mercato significa, di fatto, competere con i propri clienti.

Mohamed Awad, responsabile cloud AI di Arm, sostiene che il nuovo prodotto si rivolge a una nicchia molto avanzata, grandi data center che pochi operatori possono progettare autonomamente. È una distinzione strategica, ma non elimina il rischio di attriti.

Jim McGregor, analista di Tirias Research, osserva che la pressione per aumentare i ricavi rende inevitabile questa tensione.

Efficienza energetica e costi: la leva economica

Uno degli elementi centrali dell’annuncio riguarda i costi dei data center AI. Arm stima che l’adozione del nuovo chip possa far risparmiare fino a 10 miliardi di dollari nella costruzione di un’infrastruttura da 50 miliardi.

Il punto è il consumo energetico. I data center AI sono sempre più limitati non solo dalla disponibilità di chip, ma anche dall’energia necessaria per alimentarli. Migliorare il rapporto prestazioni/watt diventa quindi un vantaggio competitivo decisivo.

Questo è coerente con il posizionamento storico di Arm, che ha sempre puntato sull’efficienza rispetto alla pura potenza. Il momento è giusto perché l’AI si sta spostando di più sull’inferenza, che richiede migliori efficienze, al punto da potersi spostare anche su dispositivi utente.

In generale la mossa di Arm si inserisce in una fase di forte accelerazione dell’AI industriale:

- lo sviluppo di agenti autonomi sta aumentando la domanda di calcolo distribuito;

- le grandi aziende tecnologiche stanno verticalizzando sempre più l’hardware;

- le tensioni geopolitiche e regolatorie, come le iniziative della Casa Bianca sulle politiche AI (marzo 2026), stanno influenzando le catene di approvvigionamento.

L’effetto più immediato riguarda il mercato delle CPU per data center. Arm presenta il nuovo chip come un processore costruito per “l’agentic AI”, con fino a 136 core, prodotto da Tsmc a 3 nanometri e orientato all’efficienza energetica. Reuters e The Verge riportano che l’azienda promette un rapporto prestazioni-per-watt superiore alle piattaforme x86 tradizionali. Se queste promesse reggeranno nelle installazioni reali, la pressione cadrà soprattutto su Intel e Amd, che oggi presidiano il grosso del mercato server general purpose.

Verso architetture più efficienti

Nvidia resta il punto di riferimento per le GPU usate nell’addestramento dei modelli e in molta inferenza AI. Però l’ascesa di nuovi carichi di lavoro, inclusi gli agenti, aumenta il peso della CPU come componente che coordina memoria, rete, storage e acceleratori.

Meta spiega che i suoi data center “stanno superando le capacità delle CPU tradizionali” e che svilupperà con Arm più generazioni di processori per supportare AI e calcolo generale. In altri termini, la CPU torna a essere una leva strategica, non un pezzo secondario accanto alla GPU.

Se Arm riuscirà davvero a offrire più prestazioni per watt, il mercato andrà verso architetture più efficienti. Si accelererà il passaggio da x86 a server Arm in alcune classi di workload AI e cloud. Il boom dell’AI potrà continuare oltre gli attuali bottleneck energetici, dentro l’AI agentica, anche locale.

L’arrivo del chip di Arm non toglie a Nvidia il ruolo dominante nelle GPU, né ribalta in pochi mesi il mercato server. Però sposta una linea di confine: da adesso Arm non è più soltanto la tecnologia usata da altri per costruire processori, ma un venditore diretto di hardware per data center AI. Aumenta così la competizione nelle CPU, rafforza la spinta verso infrastrutture progettate su misura dai grandi gruppi cloud e rende più teso il rapporto tra Arm e una parte dei suoi clienti storici.

Una delle conseguenze è che mercato dei chip AI si potrebbe chiudere attorno a pochi attori che controllano pezzi sempre più ampi dell’intera macchina. Gli ultimi annunci Nvidia vanno in questa stessa direzione.

Scheda: CPU Arm AGI, efficienza agentica su scala rack

I carichi di lavoro di AI agentica richiedono prestazioni costanti su vasta scala. La CPU Arm AGI è progettata per garantire elevate prestazioni per attività con carichi sostenuti su migliaia di core in parallelo, il tutto entro i limiti di alimentazione e raffreddamento dei moderni data center.

Ogni elemento della CPU Arm AGI – dalla frequenza operativa all’architettura di memoria e I/O – è stato progettato per supportare carichi di lavoro agentici massicciamente paralleli e ad alte prestazioni in un’implementazione rack ad alta densità.

La configurazione del server di riferimento di Arm è un design 1OU a 2 nodi – che racchiude due chip con memoria e I/O dedicati per un totale di 272 core per blade. Questi blade sono progettati per popolare completamente un rack standard raffreddato ad aria da 36 kW: 30 blade che forniscono un totale di 8160 core. Arm ha inoltre collaborato con Supermicro su un design raffreddato a liquido da 200 kW in grado di ospitare 336 CPU Arm AGI per oltre 45.000 core.

In questa configurazione, la CPU Arm AGI è in grado di fornire più del doppio delle prestazioni per rack rispetto ai più recenti sistemi x86*, grazie ai vantaggi fondamentali dell’architettura Arm e all’attento abbinamento delle risorse di sistema alla potenza di calcolo:

La larghezza di banda di memoria leader della categoria delle CPU Arm AGI si traduce in thread di esecuzione più efficaci per rack; le CPU x86 subiscono un degrado quando i core competono sotto carico prolungato.

I core della CPU Arm Neoverse V3, single-threaded, efficienti e ad alte prestazioni, superano le architetture legacy; ogni thread Arm svolge più lavoro.

Un maggior numero di thread utilizzabili e una maggiore quantità di lavoro per thread si traducono in enormi guadagni di prestazioni per rack.