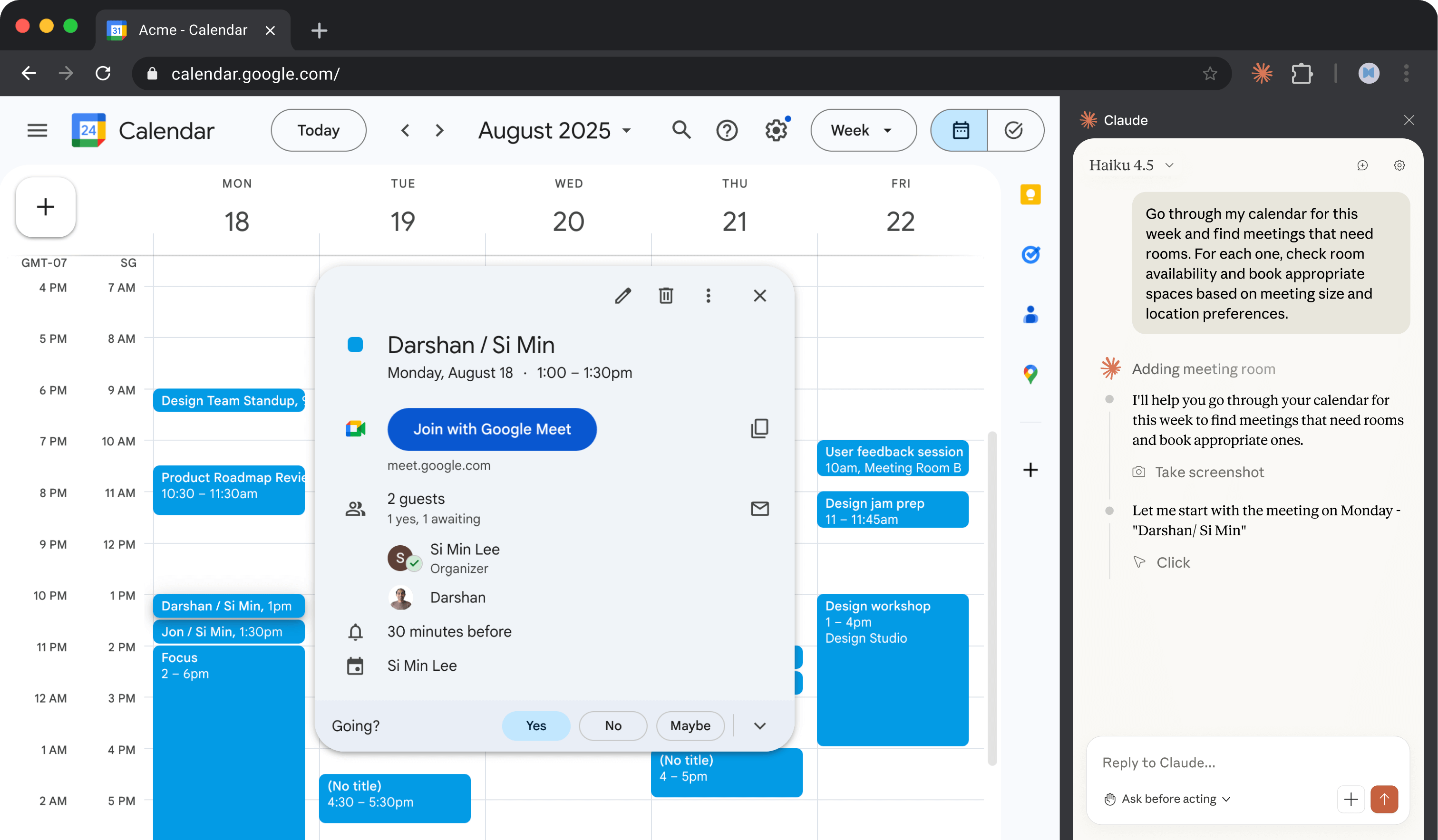

Dopo tre mesi di sperimentazione, Anthropic rilascia la beta di Claude per Chrome a tutti gli abbonati Max. L’obiettivo è verificare come un’AI possa operare direttamente nel browser mantenendo alti standard di sicurezza. Dalla prima anteprima sono arrivate funzioni come task programmati, workflow multi-tab e una navigazione più intelligente sui siti usati quotidianamente.

ai generativa

Claude per Chrome: l’AI direttamente nel browser

Anthropic avvia il beta test pubblico dell’estensione Claude per Chrome. Dopo mesi di test interni, la versione pilota introduce nuove funzioni, ma anche rischi di sicurezza come attacchi di prompt injection. L’azienda punta a sviluppare difese robuste prima del rilascio globale, coinvolgendo utenti fidati nel processo

Continua a leggere questo articolo

Aziende

Argomenti

Canali