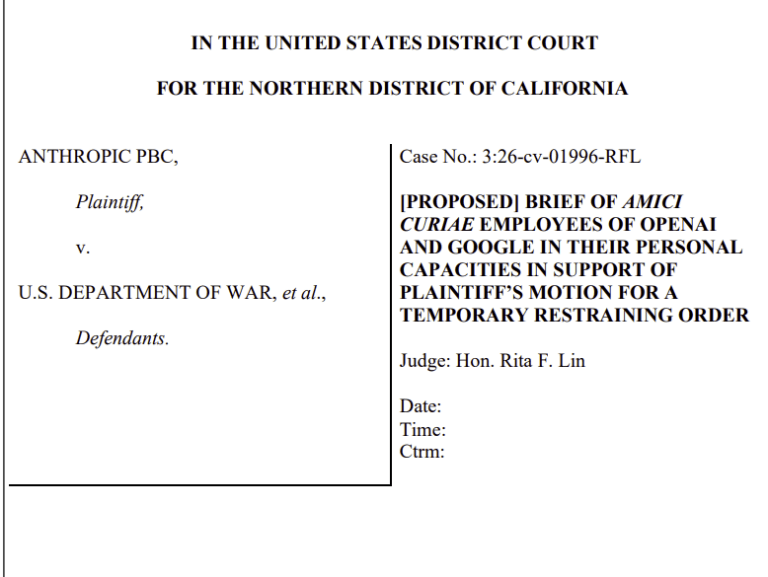

Un giudice federale degli Stati Uniti ha impedito all’amministrazione di sanzionare Anthropic per aver rifiutato l’uso senza restrizioni della propria tecnologia in ambito militare.

La giudice Rita Lin, del tribunale distrettuale della California settentrionale, ha stabilito che i danni finanziari e reputazionali derivanti dalla classificazione dell’azienda come “rischio per la catena di approvvigionamento” avrebbero potuto comprometterne l’attività.

La misura è stata sospesa in via temporanea: le agenzie federali non potranno applicarla nell’immediato. Secondo Lin, la decisione del governo appare “probabilmente arbitraria e capricciosa” e in contrasto con la legge.

Indice degli argomenti:

Lo scontro tra l’azienda e il Pentagono

Il contenzioso nasce dopo il fallimento delle trattative tra il Dipartimento della Difesa e Anthropic. L’azienda aveva rifiutato di consentire l’uso della propria intelligenza artificiale per:

- armi autonome letali

- sorveglianza di massa

Da qui la rottura con il Pentagono e la successiva decisione dell’amministrazione di Donald Trump di etichettare la società come rischio per la sicurezza nazionale, una misura finora applicata solo a imprese legate a paesi ostili.

Le conseguenze economiche e industriali

La designazione avrebbe avuto effetti immediati sul business dell’azienda. Secondo quanto dichiarato da Anthropic in tribunale, il rischio era quello di perdite fino a miliardi di dollari su base annua.

Il governo aveva inoltre:

- vietato alle agenzie civili di collaborare con la società

- invitato i fornitori militari a interrompere i rapporti commerciali

Diversi gruppi tecnologici hanno sostenuto Anthropic in tribunale, sostenendo che la misura stava causando danni “immediati e sostanziali” all’intero settore.

Le motivazioni del giudice

Nell’ordinanza, Lin ha chiarito che il Pentagono ha piena discrezionalità nella scelta dei fornitori tecnologici. Tuttavia, ha contestato il metodo utilizzato.

Secondo il giudice, la legge non consente di trattare un’azienda americana come un potenziale nemico solo per aver espresso disaccordo con il governo.

La decisione richiama anche possibili violazioni del Primo Emendamento, legate alla libertà di espressione, tema sollevato dall’azienda nella causa.

I prossimi passaggi

L’amministrazione ha sette giorni per presentare ricorso. Fino a quel momento, l’ingiunzione non entrerà pienamente in vigore.

Nel frattempo, i rapporti commerciali tra Anthropic e i contractor militari possono proseguire, almeno per attività non direttamente legate al Dipartimento della Difesa.

Anthropic ha dichiarato di voler continuare a collaborare con il governo per garantire uno sviluppo “sicuro e affidabile” dell’intelligenza artificiale.

Un precedente per il rapporto tra AI e difesa

Il caso introduce un elemento nuovo nel rapporto tra industria tecnologica e apparato militare statunitense. Per la prima volta, un’azienda ha contestato apertamente l’uso bellico della propria tecnologia, subendo una risposta istituzionale così ampia.

La decisione del tribunale non chiude il conflitto, ma definisce un limite: il dissenso pubblico di un’azienda non può, da solo, giustificare misure punitive di sicurezza nazionale.