OpenAI annuncia un rafforzamento significativo delle protezioni di sicurezza per ChatGPT, introducendo la modalità di blocco e nuove etichette coerenti di “rischio elevato”.

Con l’aumento della complessità dei sistemi di intelligenza artificiale – soprattutto quando interagiscono con il web e con applicazioni connesse – emergono nuove vulnerabilità. Tra queste, una delle più rilevanti è l’iniezione di prompt, tecnica con cui un attaccante tenta di manipolare un sistema conversazionale per ottenere dati sensibili o indurlo a eseguire istruzioni dannose.

OpenAI interviene con due strumenti distinti ma complementari:

- un’impostazione di sicurezza avanzata destinata agli utenti più esposti

- un sistema di etichettatura più chiaro sui rischi associati ad alcune funzionalità.

Indice degli argomenti:

Modalità di blocco: una protezione avanzata per utenti ad alto rischio

La modalità di blocco è un’impostazione opzionale pensata per una platea ristretta: dirigenti, team di sicurezza e figure operative in organizzazioni di rilievo, potenzialmente bersaglio di attacchi sofisticati. Non è destinata alla maggior parte degli utenti.

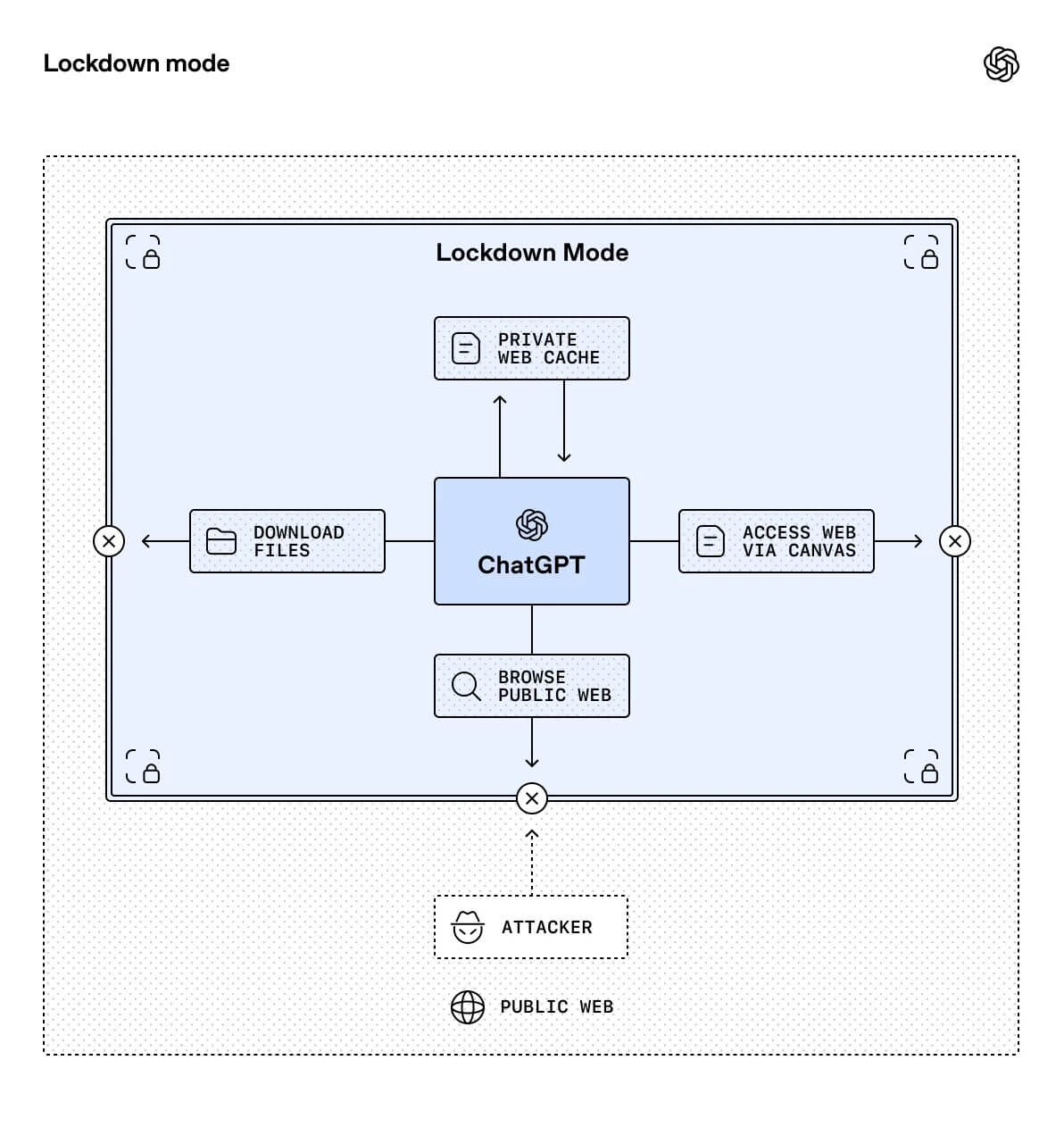

Quando attivata, la modalità di blocco limita in modo deterministico le modalità con cui ChatGPT può interagire con sistemi esterni. L’obiettivo è ridurre drasticamente il rischio di esfiltrazione dei dati attraverso iniezioni di prompt.

Ad esempio, la navigazione web viene confinata a contenuti memorizzati nella cache: nessuna richiesta in tempo reale lascia la rete controllata da OpenAI. Alcune funzionalità vengono completamente disabilitate qualora non sia possibile garantire solide tutele deterministiche sulla sicurezza dei dati.

Questa nuova impostazione si aggiunge alle protezioni già esistenti a livello di modello, prodotto e sistema, tra cui sandboxing, difese contro l’esfiltrazione via URL, monitoraggio continuo, controlli aziendali con accesso basato sui ruoli e log di audit.

Disponibilità per i piani enterprise e controllo amministrativo

La modalità di blocco è disponibile per:

- ChatGPT Enterprise

- ChatGPT Edu

- ChatGPT per il settore sanitario

- ChatGPT per insegnanti

Gli amministratori possono abilitarla dalle impostazioni dell’area di lavoro creando ruoli dedicati. Una volta attiva, la modalità applica restrizioni aggiuntive rispetto alle policy amministrative standard.

Gli amministratori mantengono inoltre un controllo granulare sulle app connesse: possono decidere quali applicazioni e quali azioni specifiche restano disponibili agli utenti in Modalità di blocco. In parallelo, la piattaforma di log API per la conformità offre visibilità dettagliata sull’utilizzo delle app e sui dati condivisi.

OpenAI prevede di estendere la modalità di blocco anche ai consumatori nei prossimi mesi.

Etichette “rischio elevato”: maggiore trasparenza per gli utenti

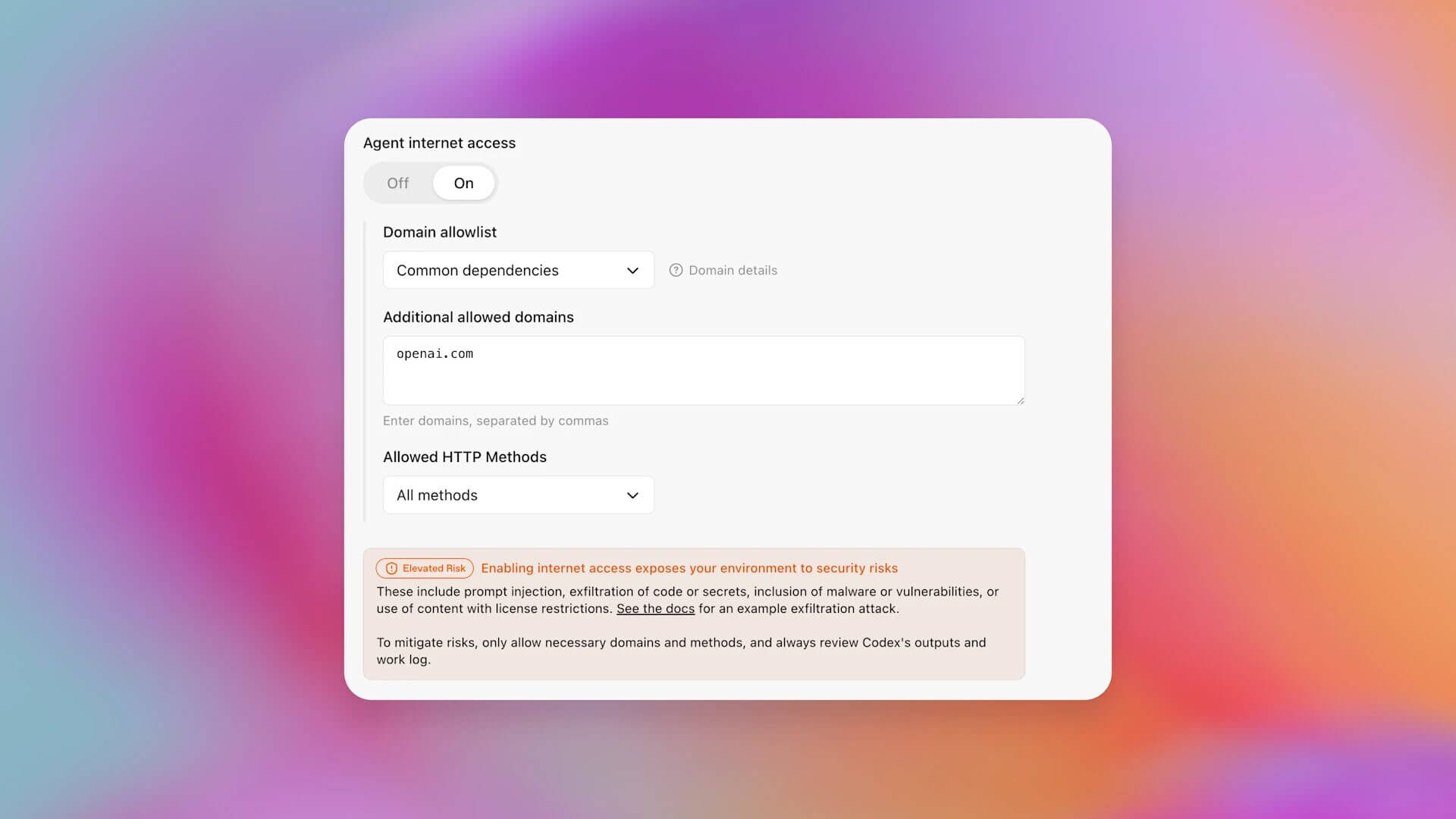

Accanto alla modalità di blocco, OpenAI introduce un sistema uniforme di etichettatura delle funzionalità potenzialmente più esposte a rischi. Alcune capacità presenti in ChatGPT Atlas e in Codex saranno ora contrassegnate dalla dicitura “rischio elevato”.

L’obiettivo è offrire agli utenti indicazioni coerenti e comprensibili ovunque incontrino queste funzionalità, favorendo scelte informate, soprattutto quando vengono coinvolti dati privati o accessi alla rete.

Un esempio riguarda Codex, l’assistente di programmazione: gli sviluppatori possono concedergli accesso a Internet per consultare documentazione o interagire con servizi esterni. L’impostazione include ora un’etichetta visibile di “rischio elevato”, accompagnata da una spiegazione chiara dei cambiamenti operativi e dei potenziali rischi di sicurezza.

Un approccio dinamico alla sicurezza

OpenAI sottolinea che l’etichetta di “rischio elevato” non è permanente. Man mano che le misure di sicurezza verranno rafforzate e i rischi mitigati in modo soddisfacente per un utilizzo generale, l’etichetta verrà rimossa.

L’azienda continuerà inoltre ad aggiornare nel tempo l’elenco delle funzionalità contrassegnate, per garantire una comunicazione trasparente e allineata all’evoluzione delle minacce informatiche.

Con queste iniziative, OpenAI conferma un approccio proattivo: proteggere gli utenti più esposti, aumentare la consapevolezza sui rischi e rafforzare il controllo sulle interazioni tra intelligenza artificiale, web e sistemi esterni.

Una maggiore maturità nella gestione dei rischi legati all’AI connessa al web.

Le nuove misure introdotte da OpenAI rappresentano un passo significativo verso una maggiore maturità nella gestione dei rischi legati all’IA connessa al web. La modalità di blocco in ChatGPT segnala la consapevolezza che le minacce, come l’iniezione di prompt, non sono più scenari teorici ma rischi operativi concreti, soprattutto per organizzazioni sensibili.

L’approccio deterministico – con limitazioni tecniche chiare e verificabili – appare particolarmente solido: invece di affidarsi solo a filtri “intelligenti”, OpenAI introduce barriere strutturali che riducono la superficie d’attacco. È una scelta che privilegia la sicurezza rispetto alla massima flessibilità, almeno per gli utenti ad alto rischio.

Anche le etichette di “rischio elevato” mostrano un cambio culturale importante: maggiore trasparenza e responsabilizzazione dell’utente. Tuttavia, resta aperta una questione critica. Etichettare un rischio non equivale a risolverlo: molto dipenderà da quanto le spiegazioni saranno comprensibili e da quanto gli utenti – specialmente in ambito aziendale – sapranno valutare correttamente le implicazioni operative.

In sintesi, le innovazioni rafforzano l’architettura di sicurezza e la comunicazione del rischio, ma spostano anche una parte della responsabilità decisionale sugli utenti e sugli amministratori. La vera prova sarà l’equilibrio tra protezione, usabilità e fiducia nel lungo periodo.