Immaginate 720 persone. Ognuna sdraiata dentro una macchina fMRI, immobile, con gli occhi aperti su uno schermo. Guardano film. Ascoltano podcast. Osservano immagini. Mentre lo fanno, la macchina registra in tempo reale come cambia l’attività cerebrale, milioni di voxel, migliaia di misurazioni al secondo, per ore. Alla fine si accumulano oltre 1.000 ore di dati neurali grezzi: una biblioteca silenziosa di come il cervello umano risponde al mondo.

Questo laboratorio esiste davvero. Si chiama Courtois NeuroMod, è basato a Montreal, e Meta FAIR lo ha usato come dataset fondante per costruire qualcosa che fino a pochi anni fa sarebbe sembrato fantascienza: un modello di intelligenza artificiale capace di predire con alta precisione come qualsiasi cervello umano reagisce a qualsiasi stimolo audiovisivo, anche un cervello che il modello non ha mai “visto” prima.

Si chiama Tribe v2.

Indice degli argomenti:

Il problema che nessuno vi ha raccontato

Per capire perché questa pubblicazione è importante davvero, bisogna partire da un dato scomodo che il paper ufficiale mette nero su bianco fin dall’abstract: la neuroscienza cognitiva è un campo frammentato.

Non è un’autocritica di cortesia. È una diagnosi precisa. Decenni di ricerca sul cervello hanno prodotto migliaia di modelli specializzati, uno per la visione, uno per l’elaborazione del linguaggio, uno per la risposta uditiva, uno per la memoria di lavoro. Ognuno funziona bene nel proprio dominio, ognuno costruito attorno a paradigmi sperimentali specifici. Il problema è che il cervello umano non funziona così. Il cervello integra tutto simultaneamente: vede, sente, interpreta, ricorda, anticipa, tutto insieme, tutto il tempo.

La frammentazione della neuroscienza non è un difetto dei ricercatori. È una conseguenza della complessità del problema. Costruire modelli unificati della cognizione umana è uno dei problemi più difficili della scienza. Ed è esattamente il problema che Tribe v2 prova ad attaccare.

La dichiarazione che chiude l’abstract del paper è, a questo proposito, una delle frasi più ambiziose che Meta abbia mai pubblicato in un contesto scientifico:

“These results establish artificial intelligence as a unifying framework for exploring the functional organization of the human brain.”

L’intelligenza artificiale come framework unificatore della neuroscienza. Non come strumento. Come framework. Come lingua comune che i diversi silos della ricerca sul cervello possono finalmente condividere. Questo non è un aggiornamento di modello. È una proposta di paradigma.

Cosa fa Tribe v2 in concreto

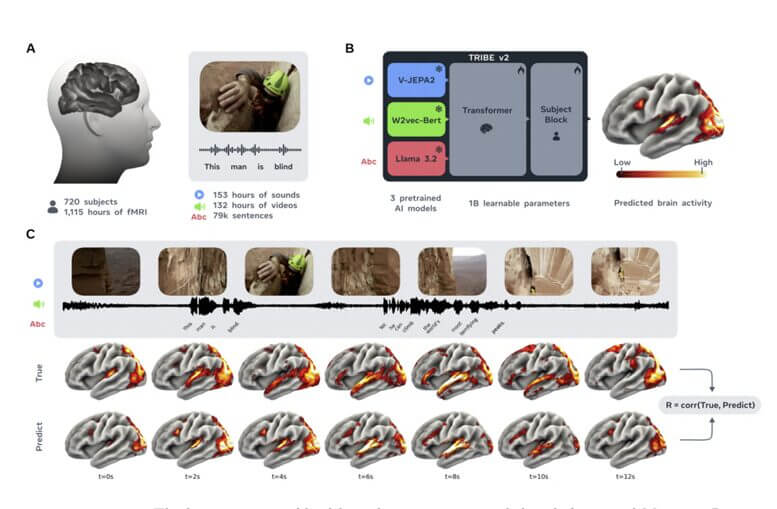

Tribe è l’acronimo di Trimodal Brain Encoder. Trimodale significa che elabora tre tipi di input in modo simultaneo e integrato: video, audio, linguaggio. Non in sequenza, non in parallelo e poi concatenati, ma fusi in una rappresentazione unificata che viene poi usata per predire l’attività cerebrale.

Per costruire questa fusione, Meta ha combinato tre dei propri modelli fondazionali: Llama 3.2 per il testo, Wav2Vec2-BERT per l’audio, V-JEPA 2 per il video. Tre sistemi che già da soli sono tra i migliori nel loro dominio, connessi attraverso un’architettura transformer che impara a correlare le rappresentazioni sensoriali con i pattern di attività fMRI registrati nei soggetti reali.

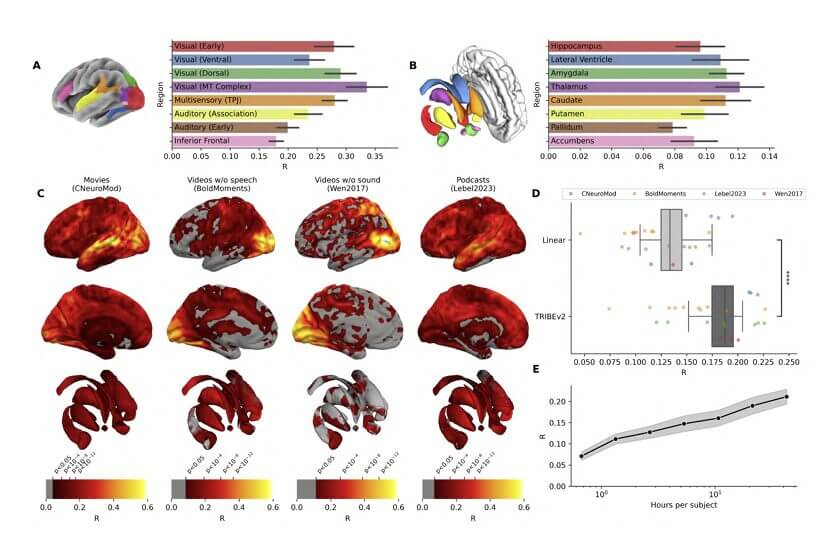

Il risultato è un modello che, dato un contenuto audiovisivo, genera una predizione di come il cervello umano lo elaborerebbe, regione per regione, con una risoluzione spaziale 70 volte superiore ai modelli predecessori, e con una capacità di generalizzazione che i sistemi precedenti non avevano.

Questa capacità di generalizzazione è il punto tecnico più rilevante. I vecchi modelli di encoding cerebrale erano essenzialmente sistemi di memorizzazione sofisticata: imparavano a predire le risposte di specifici individui a specifici tipi di stimoli. Fuori da quel perimetro, le performance crollavano.

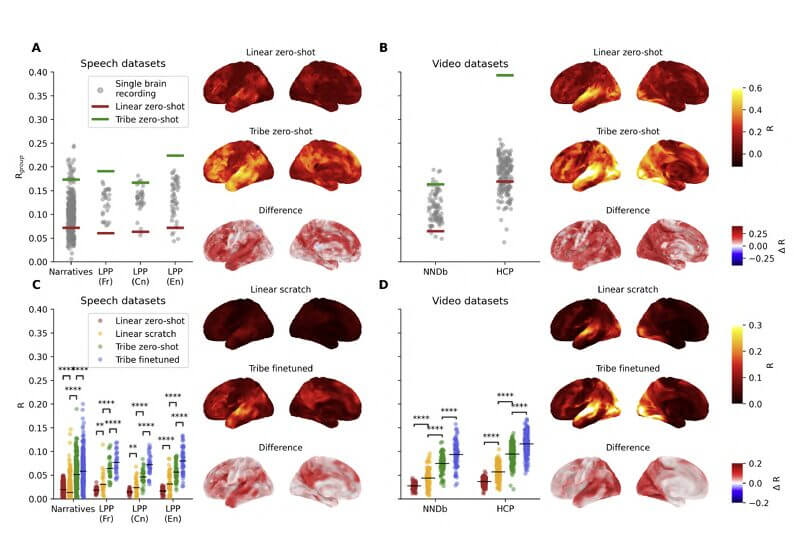

Tribe v2 invece funziona in modalità zero-shot: esposto a un soggetto nuovo, a una lingua nuova, a un tipo di stimolo mai visto nel training, mantiene prestazioni consistenti. Non sta recuperando pattern memorizzati. Sta generalizzando una comprensione.

Il miglioramento quantitativo è quasi 2-3x rispetto ai metodi precedenti. Ma il salto qualitativo è ancora più grande: per la prima volta esiste un sistema che può essere usato come strumento di ricerca generale, non come modello costruito ad hoc per uno specifico esperimento.

La parola che vale un paragrafo da solo: in silico

C’è un termine tecnico nel titolo del paper che merita di essere estratto e spiegato, perché contiene la notizia pratica più rilevante di tutta la pubblicazione: in-silico neuroscience.

In vivo significa su organismi viventi. In vitro significa in laboratorio, su colture cellulari. In silico significa nel computer, simulato digitalmente, senza coinvolgere nessun soggetto biologico.

Quello che Tribe v2 abilita è la possibilità di fare neuroscienza in silico. Un ricercatore che vuole testare come il cervello umano risponde a una specifica sequenza visiva, un taglio di montaggio, una variazione di ritmo narrativo, una combinazione di stimoli sonori e visivi, non ha più bisogno di reclutare soggetti, ottenere consensi, prenotare ore di fMRI, aspettare mesi per raccogliere dati sufficienti.

Può farlo. In minuti.

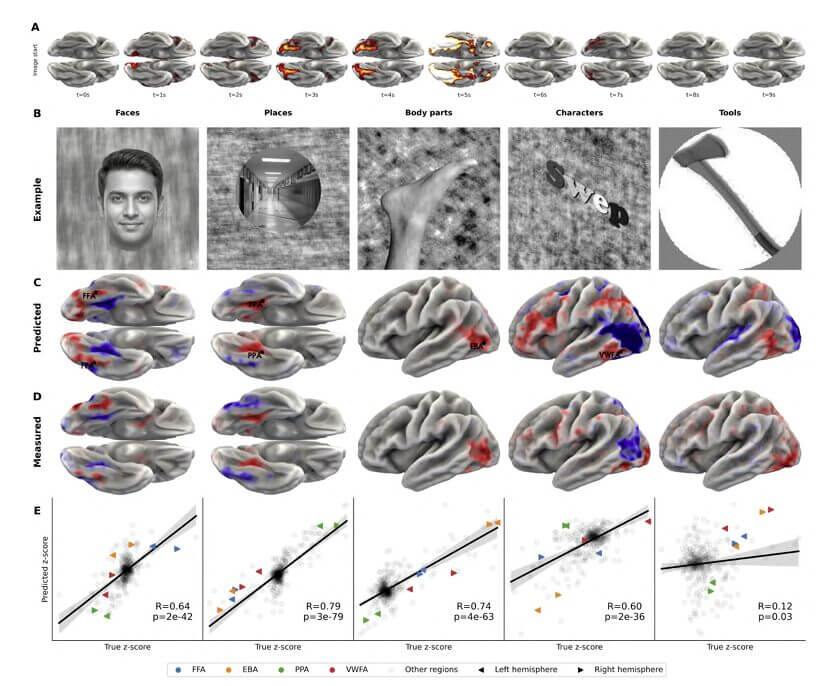

(fMRI), mentre venivano sottoposti a condizioni naturalistiche (film, podcast) e sperimentali (ad es. oggetti lampeggianti, parole isolate). B. Tribe v2 è addestrato a prevedere la fMRI ad alta risoluzione a partire da qualsiasi stimolo audio, video e/o testuale, utilizzando gli embedding di modelli di AI preaddestrati Grattafiori et al. (2024); Chung et al. (2021); Assran et al. (2025) C. Esempio della risposta cerebrale media (media su 176 soggetti) a una clip di un film (Van Essen et al., 2013) e della corrispondente previsione zero-shot di Tribe v2

Il paper lo dimostra su un test particolarmente significativo: Tribe v2 è stato testato su paradigmi sperimentali classici della neuroscienza, esperimenti che hanno richiesto decenni di lavoro empirico per essere stabiliti, e ha replicato i risultati autonomamente, senza che nessuno gli avesse fornito quei dati. Il modello, avendo imparato la logica di fondo del funzionamento cerebrale, “ritrova” da solo risultati che la comunità scientifica ha costruito in sessant’anni di ricerca.

Questo non vuol dire che la sperimentazione su esseri umani diventa obsoleta. Vuol dire che il ciclo della ricerca può accelerare radicalmente: le ipotesi vengono prima filtrate in silico, e solo quelle più promettenti vengono portate in laboratorio. Il collo di bottiglia della neuroscienza, il costo enorme di ogni esperimento su soggetti reali, si allarga.

tra i partecipanti di tutti gli studi. C. Punteggi di codifica mediati per soggetto nelle regioni corticali e subcorticali per le quattro condizioni nel set di dati di addestramento. D. Punteggi medi di codifica dei singoli soggetti (punti) per TRIBE v2 e una linea di base lineare classica. E. Leggi di scala della codifica cerebrale. Punteggio di codifica medio di TRIBE v2 sul set di dati Algonauts, all’aumentare del numero di ore di dati di addestramento utilizzati per partecipante. La barra di errore indica la SEM tra i soggetti.

Meta non fa questo per caso

Fin qui la scienza. Adesso l’analisi.

Meta FAIR, il braccio di ricerca fondamentale di Meta, produce lavoro scientifico genuino e di altissimo livello. Non c’è ragione di dubitarne. Ma Meta è anche una delle più grandi macchine pubblicitarie della storia, costruita interamente sulla capacità di catturare e mantenere l’attenzione umana attraverso contenuti audiovisivi.

Tenere questi due fatti separati sarebbe ingenuo.

Il primo punto è tecnico, e vale la pena sottolinearlo: i tre modelli che compongono TRIBE v2, Llama, Wav2Vec-BERT, V-JEPA, non sono stati scelti perché erano i migliori in assoluto sul mercato. Sono stati scelti perché sono i modelli di Meta. Tribe v2 è costruito interamente sull’infrastruttura tecnologica di Meta. E quella stessa infrastruttura alimenta Instagram, Reels, Facebook, WhatsApp.

Il paper dichiara esplicitamente uno degli obiettivi del progetto: usare gli insight del cervello umano per costruire sistemi di intelligenza artificiale migliori. È scritto senza ambiguità nel blog di annuncio: “apply brain insights to build better AI systems”. Il loop è chiaro: l’AI studia come funziona il cervello, e quello che impara torna dentro l’AI per renderla più efficace.

Più efficace a fare cosa? Dipende da chi la usa. Per un medico che lavora su disturbi neurologici, significa diagnosi più precisa. Per un ricercatore, significa esperimenti più veloci. Per un sistema di raccomandazione di contenuti, significa capire meglio quale stimolo audiovisivo genera quale risposta cerebrale, e ottimizzare di conseguenza.

Nessuno sta accusando Meta di nulla. La ricerca è pubblica, il codice è rilasciato sotto licenza CC BY-NC, il paper è su ArXiv. È tutto trasparente. Ma la domanda strutturale rimane, e sarebbe disonesto non porla: l’azienda che possiede la piattaforma di distribuzione di contenuti audiovisivi più grande al mondo ha appena costruito il modello più avanzato esistente per predire come il cervello umano risponde ai contenuti audiovisivi. È una coincidenza? O è una direzione?

La scoperta che nessuno aveva pianificato

C’è un dettaglio nel paper che ho trovato il più affascinante di tutti, e che nelle sintesi di oggi è quasi completamente sparito.

Quando i ricercatori hanno analizzato le feature latenti interne a Tribe v2, le rappresentazioni che il modello costruisce internamente mentre elabora gli input, hanno trovato qualcosa che non stavano cercando: una mappa dettagliata di come il cervello umano integra i segnali multisensoriali. Una topografia fine dell’integrazione tra vista, suono e linguaggio.

Questa non era l’ipotesi di ricerca originale. Era un risultato emergente. Il modello, imparando a predire le risposte cerebrali, aveva da solo organizzato internamente le proprie rappresentazioni in modo coerente con la struttura funzionale del cervello. Aveva “scoperto” qualcosa sulla neuroanatomia dell’integrazione sensoriale come effetto collaterale del proprio training.

È uno dei pattern più interessanti che l’era dei grandi modelli ha portato alla scienza: i modelli che imparano da dati reali a sufficiente scala tendono a internalizzare strutture del mondo che nessuno ha esplicitamente insegnato loro. GPT ha “scoperto” strutture grammaticali che i linguisti dibattevano da decenni. AlphaFold ha risolto il problema del folding proteico che la biologia non riusciva ad affrontare. Tribe v2 ha trovato la mappa dell’integrazione multisensoriale come sottoprodotto di un task predittivo.

Questo suggerisce qualcosa di più profondo: che il confine tra modellazione e scoperta scientifica si sta assottigliando. Un modello sufficientemente generale, addestrato su dati sufficientemente ricchi, non si limita a predire, comincia a capire.

La domanda che dobbiamo porci

Meta ha rilasciato tutto: modello, pesi, codice sorgente, paper, demo interattiva. Il gesto è generoso, o almeno, lo è nella forma. La sostanza è più complessa: rilasciare sotto CC BY-NC significa che chiunque può usarlo per ricerca accademica, ma non per applicazioni commerciali. Meta rimane libera di usarlo come meglio crede nelle proprie piattaforme.

L’open science come strategia di ecosistema non è una novità. Meta lo fa sistematicamente con Llama, con PyTorch, con decine di altri progetti FAIR. Il rilascio pubblico crea community, attira talenti, genera contributi esterni, costruisce reputazione scientifica. È una mossa intelligente, non necessariamente disonesta, ma non neutrale.

La domanda finale è questa: se un sistema può simulare con precisione crescente come il tuo cervello risponde a un contenuto, a un video, a una sequenza sonora, a una combinazione di stimoli linguistici e audiovisivi, prima ancora che tu lo veda, dove finisce la comprensione del comportamento umano e dove inizia la sua ingegnerizzazione?

Non è una domanda retorica. È la domanda che la neuroscienza computazionale, l’etica dell’AI e la regolamentazione dei media dovranno affrontare nei prossimi anni. Tribe v2 non è la risposta. È il momento in cui la domanda diventa urgente.

Fonti

• Paper ufficiale Meta FAIR: “A foundation model of vision, audition, and language for in-silico neuroscience” (ArXiv, 26 marzo 2026)

• Blog Meta AI: ai.meta.com/blog/tribe-v2-brain-predictive-foundation-model

• Demo interattiva: aidemos.atmeta.com/tribev2