L’intelligenza artificiale, in particolare i grandi modelli generativi, ha trasformato il cybercrimine in un business semplice, industrializzato e scalabile. L’ultimo rapporto operativo di OpenAI in materia di cybercrimine – “Disrupting malicious uses of our models” – risulta interessante, a tratti anche preoccupante. Descrive come gruppi criminali organizzati, reti di disinformazione statali e truffatori di ogni livello stiano utilizzando l’AI generativa come amplificatore dell’efficacia degli attacchi informatici.

La concretezza di questa nuova famiglia di minacce AI-powered impone un’analisi che permetta di capire nel dettaglio il fenomeno, individuando le potenziali azioni di contrasto in grado di massimizzare la sicurezza del perimetro informatico aziendale.

Il dato più rilevante che emerge dal rapporto è di natura strutturale. Gli attori delle minacce agiscono su più strumenti e canali, usando modelli di AI in combinazione con siti web, account social media, app di messaggistica cifrata e annunci pubblicitari a pagamento. L’intelligenza artificiale rende gli attacchi più efficienti, più scalabili e più difficili da individuare.

Indice degli argomenti:

Un caso proveniente dalla Cina

I criminali possono utilizzare modelli AI diversi in vari punti del loro flusso di lavoro. Un caso documentato da OpenAI, relativo a operazioni di influenza condotte dalla Cina, ha dimostrato che gli operatori utilizzavano ChatGPT per alcune funzioni, come la revisione di report interni e la pianificazione di campagne, e modelli open-weights cinesi, come DeepSeek e Qwen, per altre attività, quali il monitoraggio dei social media, la profilazione dei bersagli e la creazione di contenuti in lingue locali. In sostanza, l’ecosistema criminale ha già adottato un approccio multi-agentico, esattamente come fanno le aziende più avanzate nei fronti applicativi legittimi dell’AI.

La cybersecurity è sempre stata una questione strategica che riguarda i processi decisionali, la formazione del personale, la gestione dei fornitori e la capacità di riconoscere segnali di allarme e pattern anomali. Se gli attori di tali crimini industrializzano e scalano i processi, la questione diventa ancora più centrale.

Il cyber-attacco 3.0: il modello “ping-zing-sting“

OpenAI, nei due anni in cui ha pubblicato report sulle minacce, ha identificato un pattern ricorrente nel modo in cui le truffe sfruttano l’intelligenza artificiale. Il modello è stato sintetizzato in tre fasi: ping, zing, sting. Queste fasi rappresentano l’architettura fondamentale di qualsiasi attacco informatico, dalla truffa sentimentale alla frode B2B. Comprendere questa struttura è probabilmente il singolo elemento di security awareness più utile che sia possibile acquisire oggi.

La prima fase è il ping, ovvero il contatto a freddo. Il truffatore genera contenuti progettati per attirare l’attenzione del potenziale bersaglio, facendo leva sui suoi interessi specifici. In questa fase l’AI interviene in modo decisivo, consentendo di produrre messaggi più coinvolgenti e meno riconoscibili come tentativi di truffa rispetto a quelli tradizionali.

Un esempio concreto viene dalla cosiddetta truffa del pig butchering documentata nel rapporto OpenAI: l’operazione prendeva di mira uomini americani quarantenni che lavoravano nel settore medico, rispondendo ai loro post su Facebook relativi al golf.

Altre operazioni hanno utilizzato SMS a freddo, falsi messaggi di recruitment o annunci pubblicitari mirati sui social media. In ogni caso, il ruolo dell’AI era generare messaggi calibrati sul profilo della vittima, scritti in un inglese (o nella lingua locale) fluente e naturale, eliminando quegli errori grammaticali e stilistici che in passato rappresentavano il segnale d’allarme più immediato.

La seconda fase è lo zing, vale a dire la generazione di emozione. Il truffatore produce contenuti destinati a innescare reazioni emotive forti nel bersaglio, rendendolo più vulnerabile alla manipolazione. Nelle truffe sentimentali, lo zing mira a far innamorare la vittima. In altri scenari, l’obiettivo può essere generare entusiasmo per un affare apparentemente irripetibile, paura di perdere un’opportunità, allarme per un presunto rischio legale o per una fattura non pagata. L’AI consente di personalizzare il tono emotivo con una precisione che i truffatori non erano in grado di raggiungere in passato, adattando il registro a seconda del profilo psicologico del target.

La terza fase è lo sting, l’estrazione. Il truffatore genera contenuti progettati per convincere la vittima a cedere denaro o informazioni sensibili. Le motivazioni addotte sono estremamente variabili. Una truffa sentimentale può chiedere alla vittima di investire nell’attività del presunto partner oppure di coprire una crisi finanziaria improvvisa. Un task scam convince il bersaglio a rivelare informazioni personali per sbloccare presunti guadagni fittizi che crede di aver maturato. L’AI consente di produrre comunicazioni che risultano formali, coerenti e credibili, riducendo drasticamente la probabilità che la vittima si insospettisca prima di completare l’azione.

Falsi professionisti e ingegneria sociale

Le truffe sentimentali potrebbero (forse) essere lontane dalla realtà quotidiana di un’impresa. I casi documentati nel rapporto OpenAI che riguardano direttamente il mondo professionale sono però più immediati e inquietanti. Due operazioni, in particolare, illustrano come l’AI venga utilizzata per costruire identità aziendali fittizie, impersonare professionisti e condurre attacchi di ingegneria sociale di alto livello che possono colpire qualsiasi manager o dirigente.

False witness

La prima è l’operazione False witness. OpenAI ha bannato un cluster di account ChatGPT che utilizzavano i modelli per spacciarsi per studi legali fittizi, oltre a impersonare avvocati reali e forze dell’ordine statunitensi, nell’ambito di una cosiddetta recovery scam, una truffa che prende di mira le vittime di frodi precedenti, promettendo di recuperare il denaro perduto. I truffatori utilizzavano ChatGPT per creare contenuti che sembravano provenire da almeno sei studi legali fittizi. Parte di questi contenuti veniva poi pubblicata da account sui social media e attraverso annunci online che promuovevano servizi inesistenti di recupero fondi.

L’elemento che rende questa operazione particolarmente rilevante per il contesto aziendale è il livello di sofisticazione nella costruzione della credibilità. Un sottoinsieme degli account della truffa utilizzava i modelli AI per creare materiali ingannevoli specificamente progettati per rafforzare la legittimità percepita, generando falsi registri di iscrizione all’albo degli avvocati e finte tessere associative di ordini forensi.

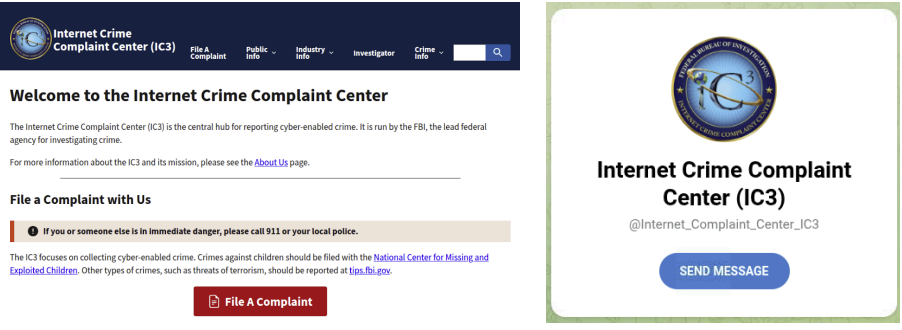

In un caso, i truffatori avevano creato un sito web che impersonava l’IC3 (Internet Crime Complaint Center) dell’FBI. I dettagli di contatto pubblicati sui vari siti truffa indirizzavano i visitatori verso app di messaggistica privata, come Telegram. Nei messaggi ai bersagli, redatti con ChatGPT, i truffatori affermavano falsamente di operare sotto la supervisione della Corte Penale Internazionale e dichiaravano che nessuna commissione sarebbe stata addebitata fino al completo recupero dei fondi della vittima.

Silver Lining Playbook

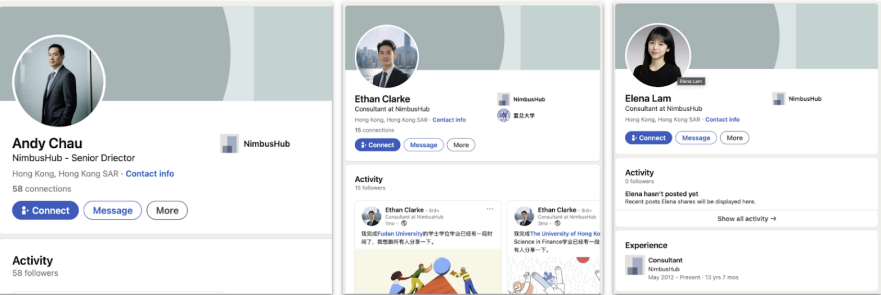

La seconda operazione interessante, denominata Silver Lining Playbook, è ancora più sofisticata dal punto di vista dell’ingegneria sociale. OpenAI ha bannato un piccolo gruppo di account ChatGPT, molto probabilmente originati in Cina, che utilizzavano i modelli per richiedere informazioni su cittadini statunitensi, ottenere localizzazioni di edifici federali e altre informazioni sensibili. Le bozze di email generate si presentavano come comunicazioni inviate da dipendenti di una società di consulenza con sede a Hong Kong. Erano indirizzate a funzionari statali statunitensi o analisti politici operanti nei settori del business e della finanza. Invitavano i destinatari a partecipare a consulenze retribuite, descritte come attività di interpretazione delle politiche e fornitura di consigli strategici per i clienti della società.

La struttura delle email seguiva un protocollo preciso. Il primo obiettivo era stabilire legittimità, presentandosi come una società di consulenza strategica professionale con competenze autorevoli in geopolitica e politiche transnazionali, includendo un link al sito web della società. Nella seconda fase l’attacker cercava di personalizzare la conversazione e lusingare il bersaglio, citando esplicitamente il background nel settore pubblico del destinatario come prova che fosse la persona perfetta per il ruolo.

In un caso, l’account ha caricato screenshot del profilo LinkedIn di un cittadino statunitense basato a Shanghai, istruendo il modello a personalizzare la bozza dell’email sulla base delle esperienze personali e il background dell’individuo. La terza fase era quella dell’incentivo, in cui l’offerta di consulenza veniva presentata come un’opportunità lucrativa e flessibile, con bonus di performance e premi per referral, restando volutamente vaghi sul lavoro effettivo. Nell’ultima fase le comunicazioni erano disegnate per tentare di spostare il dialogo fuori dall’email, verso una videochiamata iniziale su piattaforme come WhatsApp, Zoom o Teams.

Le tecniche impiegate in questo attacco ben orchestrato sono le stesse che potrebbero essere usate per prendere di mira un responsabile acquisti, un CFO o un amministratore delegato. L’AI consente di generare comunicazioni impeccabili dal punto di vista linguistico, personalizzate sulla base di informazioni pubblicamente disponibili (come i profili LinkedIn), e strutturate secondo protocolli di persuasione sofisticati. Chiunque abbia un profilo pubblico e competenze specifiche può diventare un bersaglio.

Perché l’infrastruttura umana conta ancora

L’uso di contenuti generati dall’AI, preso da solo, non sembra essere il fattore decisivo per l’impatto di una truffa o di un’operazione di influenza. L’AI potenzia le operazioni criminali, ma non le rende automaticamente efficaci.

L’AI abbassa significativamente la barriera d’ingresso per i criminali informatici:

- consente a un truffatore che non parla italiano di generare email linguisticamente impeccabili;

- a un’operazione con poche risorse di produrre contenuti personalizzati su larga scala;

- a un singolo operatore di gestire decine di identità fittizie contemporaneamente. Ma il successo di un attacco dipende ancora da fattori tradizionali, come la credibilità dell’identità dietro la comunicazione, la qualità della rete di distribuzione e la capacità di raggiungere il bersaglio giusto attraverso il canale giusto. Questo significa che le difese tradizionali, come la verifica dell’identità del mittente, il controllo incrociato delle informazioni e la validazione attraverso canali indipendenti, restano efficaci, a patto di essere applicate con maggior rigore e consapevolezza.

Contromisure operative

L’intelligenza artificiale ha trasformato il cybercrimine in termini di qualità, scalabilità e velocità di esecuzione. Le truffe seguono gli stessi schemi di sempre, ma ora possono farlo con un livello di personalizzazione, coerenza linguistica e professionalità che le rende molto più difficili da riconoscere. È quindi necessario aggiornare le policy di sicurezza e le pratiche operative aziendali.

Un intervento importante riguarda la formazione continua del personale. Ogni dipendente che gestisce comunicazioni esterne, transazioni finanziarie o relazioni con fornitori e clienti deve essere formato sul modello ping-zing-sting e sulle sue varianti. La formazione deve essere un processo ricorrente, aggiornato con gli scenari di attacco più recenti.

I dipendenti devono saper riconoscere i segnali di un contatto a freddo sofisticato e sapere esattamente quale procedura seguire quando li identificano.

L’approccio zero-trust nelle comunicazioni finanziarie

Un’altra azione necessaria è l’adozione rigorosa di un approccio zero-trust nelle comunicazioni finanziarie. Nessun pagamento dovrebbe essere autorizzato sulla base di una singola email o telefonata, indipendentemente da quanto il mittente appaia legittimo. Qualsiasi richiesta di trasferimento fondi, modifica di coordinate bancarie o pagamento urgente deve essere verificata attraverso un canale indipendente, preferibilmente una telefonata a un numero già noto e verificato, non a quello fornito nella comunicazione sospetta.

La gestione dell’identità digitale aziendale e personale è altrettanto importante nella lotta al cybercrimine. I profili social di dirigenti e manager sono una miniera d’oro per gli attaccanti che praticano l’ingegneria sociale. Bisogna quindi essere consapevoli che ogni informazione pubblica può essere utilizzata per confezionare un attacco su misura. Le aziende dovrebbero stabilire linee guida su quali informazioni i dipendenti possono condividere pubblicamente e formare il personale a riconoscere le comunicazioni che fanno un uso sospetto di dettagli personali reperiti online.

Ogni azienda dovrebbe anche disporre di un protocollo chiaro per la segnalazione di comunicazioni sospette, che sia semplice, rapido e non punitivo. Il protocollo dovrebbe includere la conservazione della comunicazione originale, la segnalazione immediata al responsabile IT o della sicurezza e l’interruzione di qualsiasi interazione con il presunto attaccante fino al completamento della verifica. La verifica dell’identità multi-fattore deve essere applicata con criterio e su ogni tipo di accesso aziendale, anche quelli che possono sembrare meno sensibili.

L’infrastruttura umana resta il fattore critico. E su questo terreno, un’azienda ben organizzata, con processi robusti e personale formato, mantiene un vantaggio difensivo significativo.