Secondo il Best Practice Report di Forrester, entro il 2026 l’intelligenza artificiale potrà automatizzare tra l’80% e il 99,9% delle attività quotidiane in alcune funzioni aziendali. Una prospettiva che impone a CEO, HR e data leader una revisione profonda del concetto stesso di lavoro.

Il 2025 ha segnato un punto di rottura. Molte organizzazioni hanno sospeso le assunzioni per comprendere se un nuovo ruolo dovesse essere affidato a una persona o a un agente digitale. La conseguenza è stata una paralisi decisionale accompagnata da timori diffusi.

I dati Forrester mostrano che il 62% degli adulti online che conoscono la generative AI teme un impatto diretto sull’occupazione. In diversi settori si sono già registrate riduzioni di organico a favore di piattaforme di digital labor.

Tuttavia, la trasformazione non coincide con la sostituzione. Forrester stima che entro il 2030 la generative AI influenzerà un numero di posti di lavoro 4,5 volte superiore rispetto a quelli che eliminerà. Il cambiamento riguarda la natura delle attività, non la loro esistenza.

Indice degli argomenti:

Il significato strategico di human in the loop

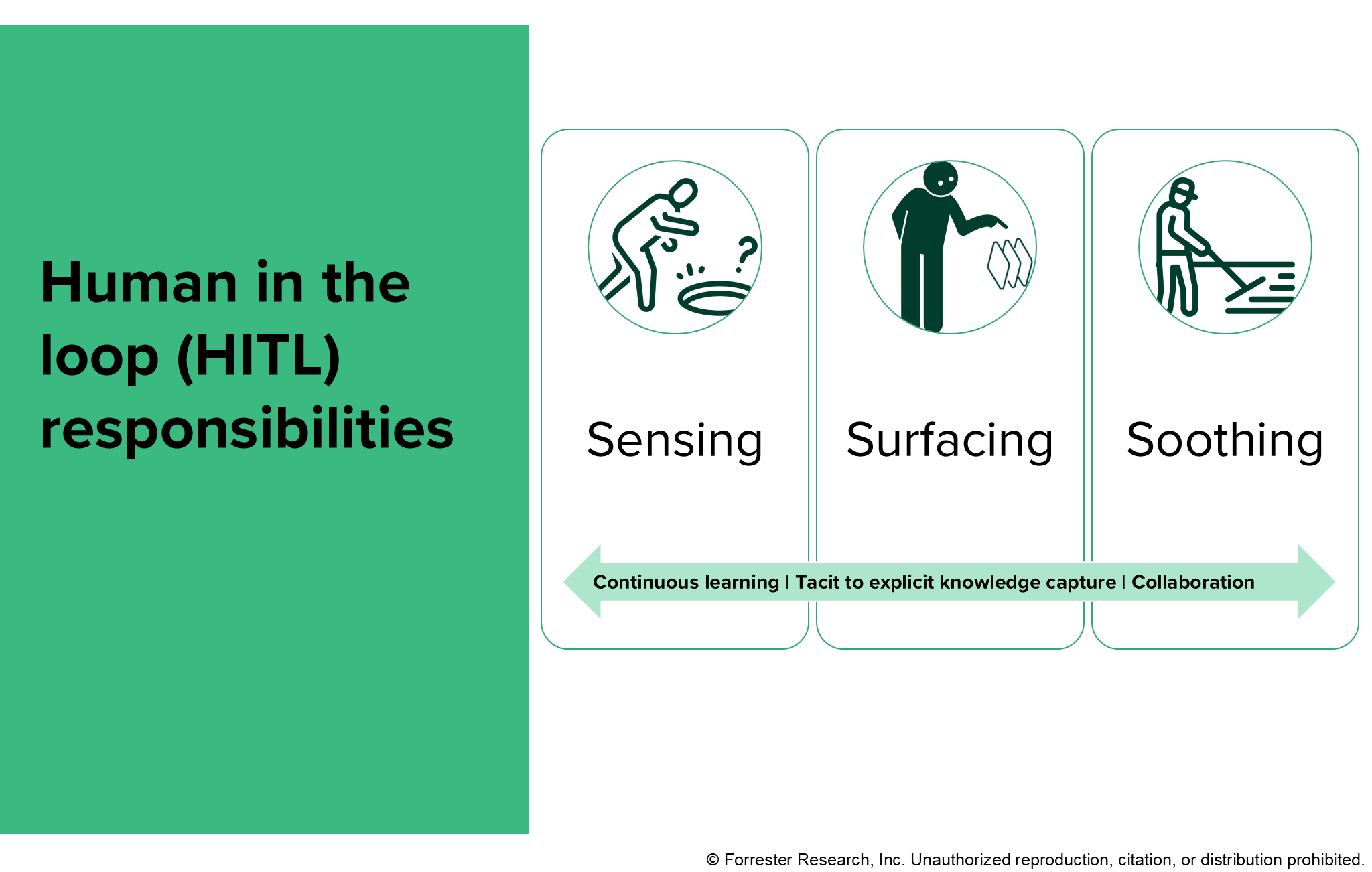

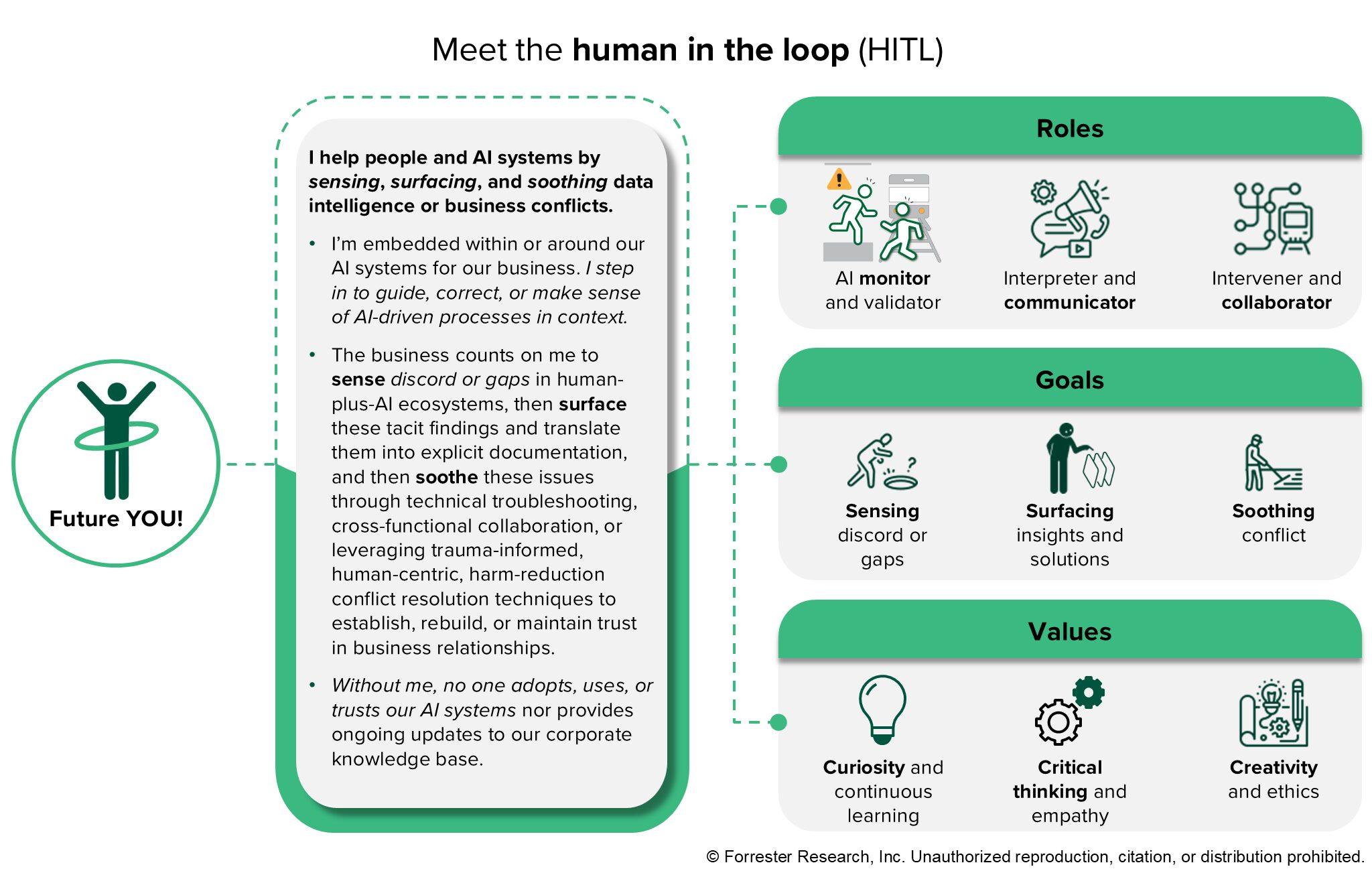

In questo contesto assume centralità il concetto di human in the loop (HITL). Non è una figura residuale, né un semplice controllore tecnico. È un ruolo strutturale inserito dentro, attorno o sopra i sistemi AI, con responsabilità di validazione, interpretazione e intervento. Forrester sintetizza il contributo umano in tre funzioni chiave che definiscono la nuova architettura del lavoro.

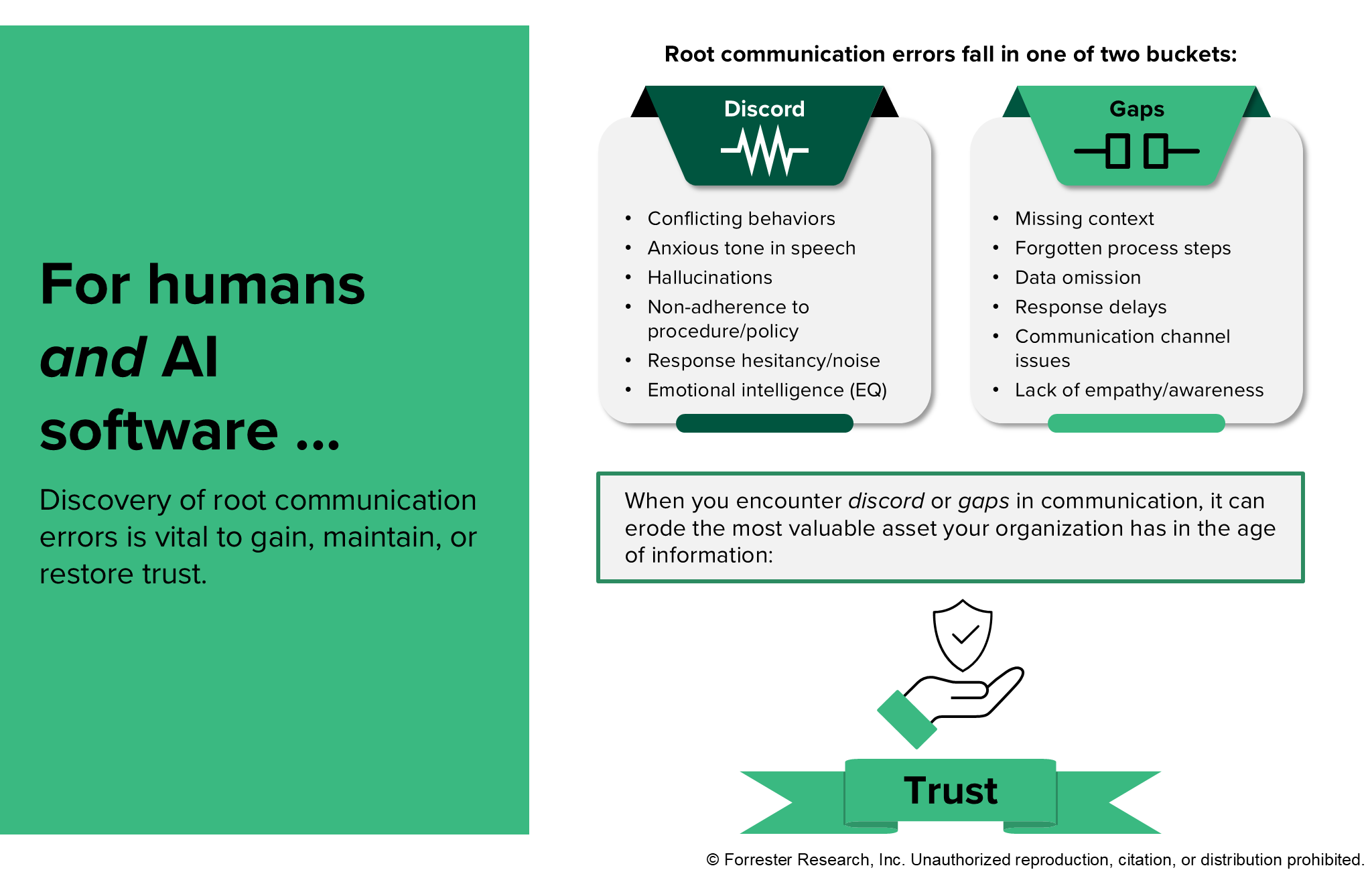

La prima è il sensing. Gli esseri umani restano sensori sofisticati nei sistemi socio-tecnici. Sono in grado di intercettare anomalie che i modelli non riconoscono: tensioni comunicative, incoerenze tra direttive, lacune documentali, errori di contesto, hallucination o segnali deboli che anticipano una frizione organizzativa. L’AI elabora pattern; l’essere umano percepisce disallineamenti culturali, emotivi e relazionali.

La seconda funzione è il surfacing. Una volta individuato il problema, l’HITL lo rende esplicito. Traduce segnali impliciti in documentazione strutturata, porta alla luce bias o criticità operative e le collega agli obiettivi di business. In questo passaggio si evita che una disfunzione rimanga confinata nei log o nelle metriche, trasformandola invece in apprendimento organizzativo.

La terza funzione è il soothing, ossia la capacità di stabilizzare il sistema dopo un errore o una frizione generata dall’AI. Qui entra in gioco la ricostruzione della fiducia. Quando un agente digitale produce un risultato inappropriato o genera insoddisfazione, l’essere umano interviene per spiegare, correggere e ristabilire coerenza. La fiducia rappresenta l’asset più fragile nell’economia dell’informazione: senza fiducia, nessun sistema viene adottato, aggiornato o alimentato con dati di qualità.

Competenze ibride: la vera frontiera

Il profilo HITL richiede una combinazione di competenze tecniche e relazionali che supera le categorie tradizionali. Sul piano umano, servono intelligenza emotiva, capacità narrativa, gestione del cambiamento e abilità nel trasformare conoscenza tacita in documentazione esplicita. L’HITL opera come mediatore tra sistemi e persone, riduce attriti e costruisce continuità operativa.

Sul piano tecnico, è necessaria una solida data literacy, competenza nel prompt engineering, familiarità con la gestione delle knowledge base e comprensione delle logiche di funzionamento dei modelli. Anche una base di coding e matematica conserva rilevanza quando emergono errori complessi o integrazioni tra sistemi.

L’HITL diventa quindi un connettore tra quattro dimensioni: comunicazione tra persone, dialogo con agenti AI, allineamento con il business e integrazione tra sistemi automatizzati. In questa posizione intermedia si gioca la sostenibilità della trasformazione.

La responsabilità condivisa tra data leader e HR

Il report sottolinea la necessità di una collaborazione strutturata tra data leader e funzioni HR. Riduzioni premature del personale possono compromettere la capacità dell’organizzazione di mantenere e aggiornare la propria conoscenza interna, che costituisce materia prima per l’AI stessa.

Una strategia sostenibile privilegia riconversione e riqualificazione rispetto al taglio indiscriminato. Il tempo liberato dall’automazione può essere reinvestito in miglioramento continuo, governance dei dati e sviluppo di nuove competenze. In questo scenario l’organizzazione deve assumere una forma resiliente, capace di riconfigurarsi sotto pressione senza perdere coerenza.

Il rischio maggiore non è l’adozione dell’AI, ma una gestione miope della transizione. L’aumento di produttività può accompagnarsi a un ampliamento delle disuguaglianze se non si investe in alfabetizzazione AI e sviluppo delle competenze interne. L’era degli agenti AI non elimina l’essere umano. Ne ridefinisce la funzione. E quella funzione è meno esecutiva e più sistemica: percepire, rendere visibile e stabilizzare.