DeepSeek, azienda cinese balzata alle cronache per il suo modello R1, ha presentato due nuove varianti, DeepSeek-V3.2 e V3.2-Speciale, introducendo funzionalità progettate per combinare ragionamento avanzato ed esecuzione autonoma di compiti complessi.

Indice degli argomenti:

DeepSeek-V3.2: prestazioni ai livelli di GPT-5

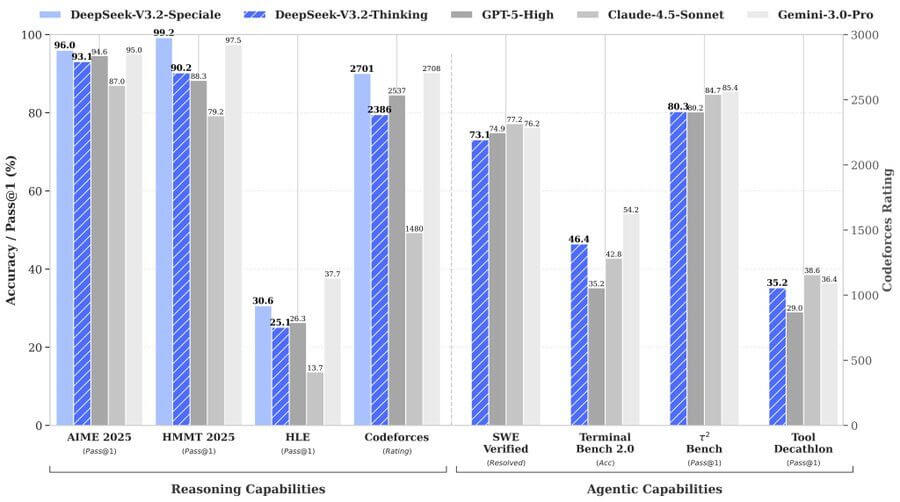

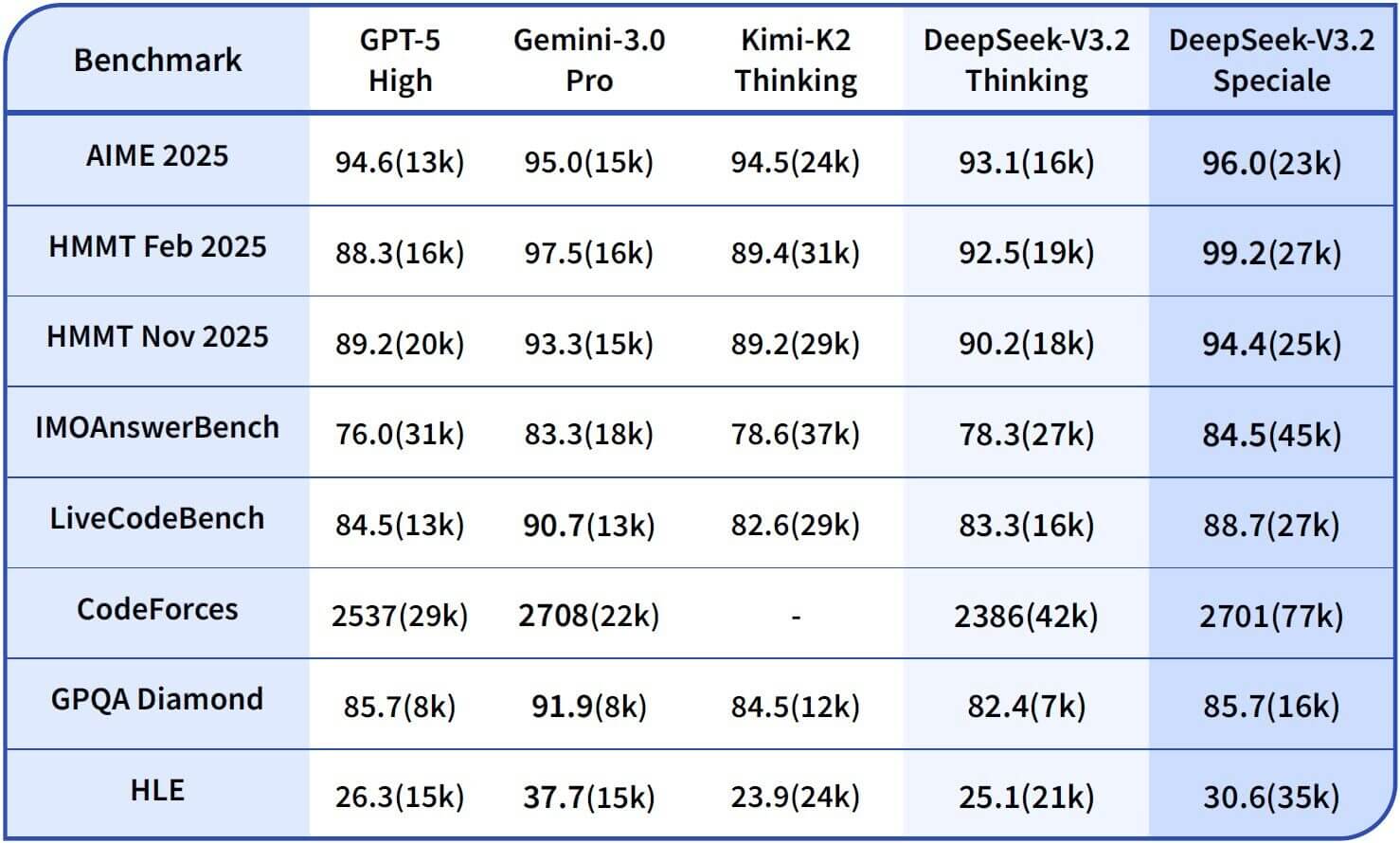

La nuova versione DeepSeek-V3.2 eguaglia, secondo l’azienda, le performance del modello di punta di OpenAI, GPT-5, su numerosi benchmark di ragionamento. Il modello integra capacità di ragionamento “simile a quello umano” e utilizza strumenti come motori di ricerca, calcolatrici e ambienti di esecuzione del codice.

DeepSeek ha spiegato: “DeepSeek-V3.2 è il nostro primo modello che integra il pensiero direttamente nell’uso degli strumenti e supporta l’uso degli strumenti sia in modalità di pensiero che non-pensiero”.

Il modello rappresenta un’evoluzione della versione sperimentale uscita a settembre, chiamata allora DeepSeek-V3.2-Exp.

Un laboratorio che accelera verso la nuova generazione di AI

Il team cinese considera DeepSeek-V3.2 un passo decisivo verso sistemi di intelligenza artificiale di nuova generazione, più veloci ed efficienti.

DeepSeek-V3.2-Speciale: la spinta sul calcolo matematico

Il secondo modello lanciato, DeepSeek-V3.2-Speciale, è dedicato alle capacità di calcolo matematico e ai processi di ragionamento esteso. DeepSeek afferma che l’obiettivo è: “spingere le capacità inferenziali dei modelli open-source ai loro limiti ed esplorare i confini delle capacità dei modelli”.

Questa versione offre prestazioni paragonabili al Gemini-3 Pro di Google e ha raggiunto livelli da medaglia d’oro nelle competizioni internazionali quali l’International Math Olympiad e l’International Olympiad in Informatics.

Una nuova metodologia di addestramento degli agenti AI

DeepSeek dichiara inoltre di aver sviluppato un nuovo metodo di addestramento per agenti AI progettati per agire in autonomia, interagire con l’ambiente, analizzare dati e prendere decisioni senza intervento umano costante.

L’azienda sta sfruttando il forte slancio ottenuto dopo il successo del modello divulgato a gennaio. Solo una settimana fa, DeepSeek aveva rilasciato DeepSeekMath-V2, modello open-source con capacità avanzate di dimostrazione di teoremi.

L’ambizione: competere con i migliori al mondo

Nel rapporto tecnico di accompagnamento, intitolato DeepSeek-V3.2: Pushing the Frontier of Open Large Language Models, la startup riassume così il livello raggiunto dal modello: “DeepSeek-V3.2 raggiunge prestazioni simili a Kimi-k2-thinking e GPT-5 attraverso molteplici benchmark di ragionamento”.

Con questi nuovi rilasci, DeepSeek punta a consolidare la propria leadership nella corsa cinese all’intelligenza artificiale, mostrando che i modelli open-source possono competere con le soluzioni proprietarie più avanzate di Silicon Valley. Dopo Google e Anthropic, una grana in più per OpenAI, arroccata in difesa del suo modello ChatGPT.

Per chi vuole approfondire la conoscenza del modello DeepSeek-V3.2