Con GPT-5.4 il dibattito sui modelli generalisti compie un passaggio importante. Non si tratta soltanto di un incremento prestazionale rispetto alla generazione precedente, ma di una precisa ridefinizione del posizionamento del prodotto. L’obiettivo dichiarato non è più soltanto rispondere meglio o programmare meglio, bensì diventare un’infrastruttura affidabile per il lavoro professionale ad alta intensità cognitiva.

La novità centrale è proprio questa convergenza. Ragionamento, coding, uso di strumenti, interazione con ambienti software e produzione di deliverable come fogli di calcolo, presentazioni e documenti vengono ricondotti a un unico modello di frontiera, distribuito in ChatGPT, API e Codex.

Nel lessico di OpenAI, GPT-5.4 nasce come il modello più capace ed efficiente per il knowledge work. La scelta del nome segnala anche una strategia di semplificazione. Invece di mantenere una separazione netta tra modello di ragionamento e modello di coding, l’azienda incorpora nel core del nuovo sistema le capacità di GPT-5.3-Codex e le unisce a un profilo più forte nell’uso di tool e workflow agentici. In termini industriali, significa ridurre il numero di passaggi necessari per completare un compito articolato e, soprattutto, ridurre l’attrito fra analisi, esecuzione e verifica.

Indice degli argomenti:

Un salto misurabile nei compiti ad alto valore

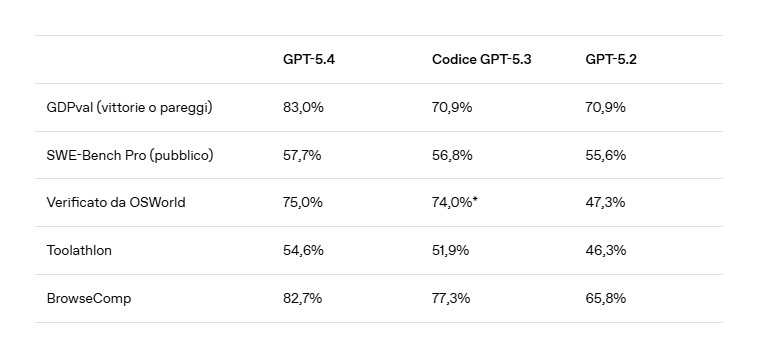

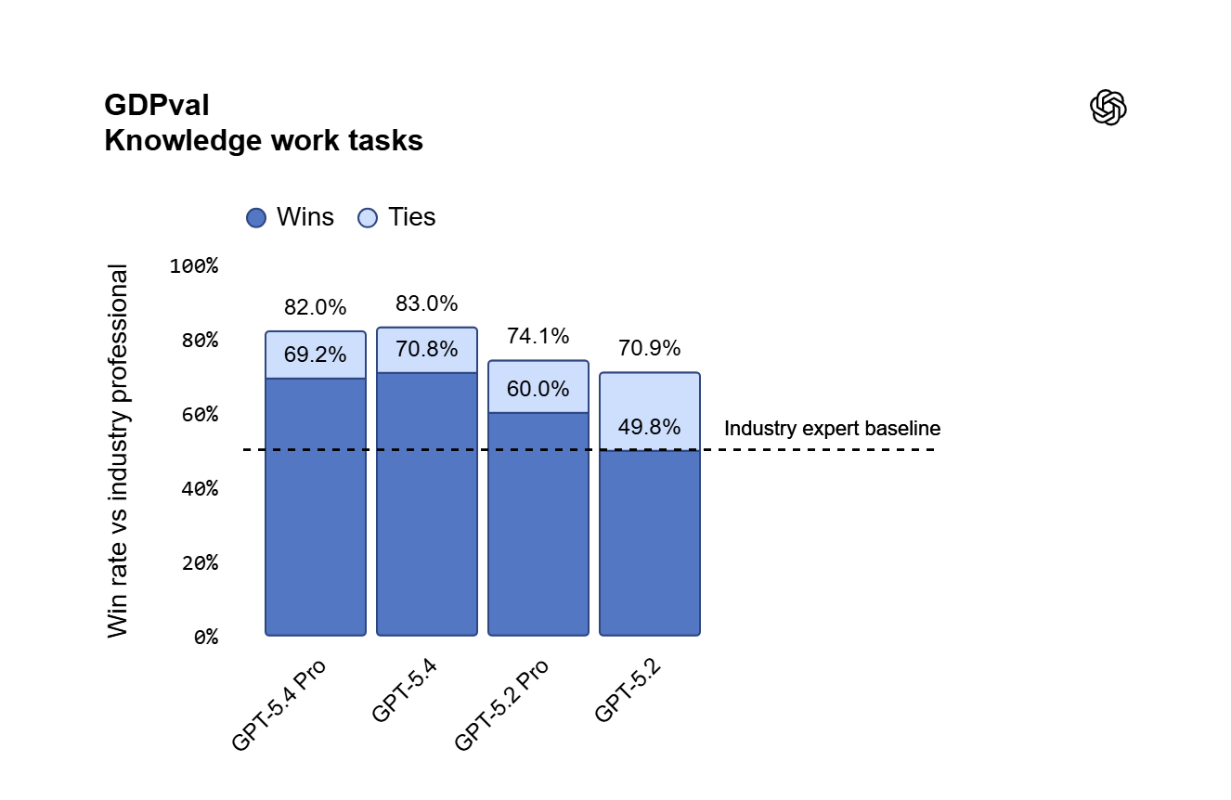

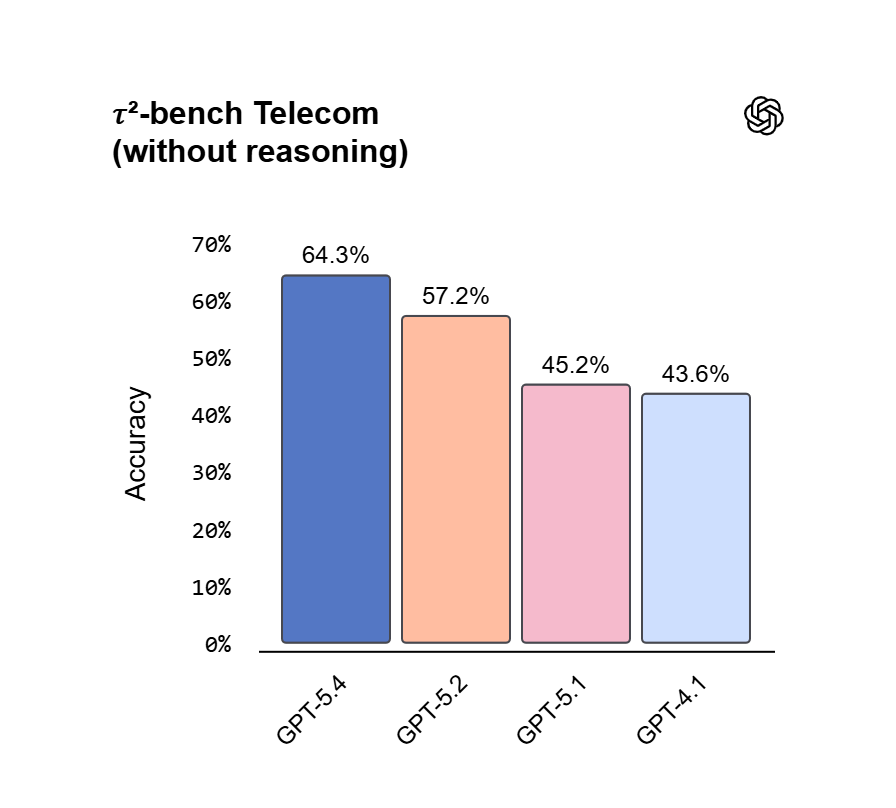

La narrativa del lancio è sostenuta da una batteria di benchmark che non punta solo alla brillantezza accademica, ma a simulare contesti di lavoro concreti. Il dato più citato è GDPval, benchmark dedicato al lavoro di conoscenza ben specificato in 44 professioni distribuite sui principali settori dell’economia statunitense. Qui GPT-5.4 raggiunge l’83,0 per cento di vittorie o pareggi rispetto a professionisti di settore, contro il 70,9 per cento di GPT-5.2. È un salto che va letto con cautela, come sempre accade con le valutazioni proprietarie, ma che indica una direzione chiara. Il modello viene giudicato non solo sulla correttezza puntuale, ma sulla qualità del prodotto finale richiesto.

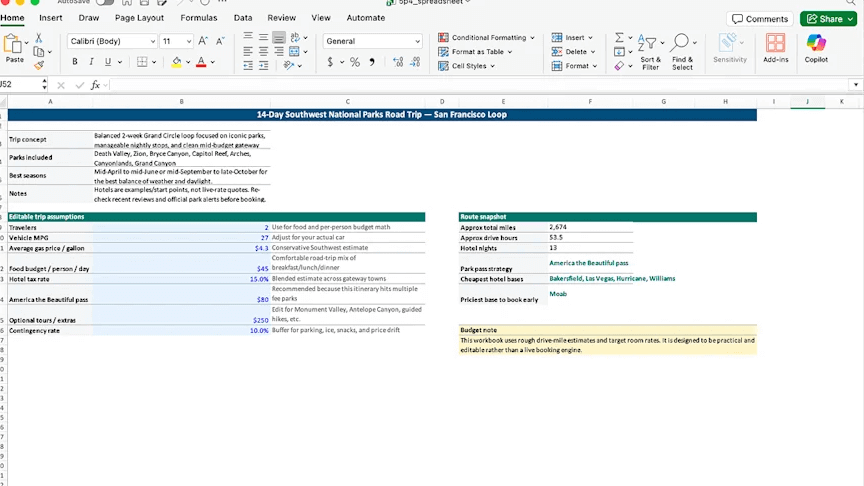

La stessa impostazione emerge nei compiti interni dedicati a fogli di calcolo, documenti e presentazioni. Nelle attività di spreadsheet modeling associate al lavoro di un analista junior di investment banking, GPT-5.4 arriva a un punteggio medio dell’87,3 per cento, contro il 68,4 per cento di GPT-5.2. Anche sul piano visivo il posizionamento è esplicito. Nelle valutazioni sulle presentazioni, i giudici umani hanno preferito gli output di GPT-5.4 nel 68 per cento dei casi, premiando varietà grafica, resa estetica e uso più efficace della generazione di immagini.

Questo elemento è rilevante perché segnala una transizione dell’AI generativa da strumento prevalentemente testuale a piattaforma per la produzione di artefatti professionali completi.

Dall’assistente al collega software-operativo

Il tratto più interessante del lancio è probabilmente l’introduzione nativa dell’uso del computer in un modello general purpose.

OpenAI presenta GPT-5.4 come il primo modello principale capace di operare direttamente su interfacce software, interpretando screenshot, restituendo azioni su mouse e tastiera e lavorando in tandem con librerie come Playwright. Questo passaggio cambia il baricentro del concetto di agente. Non si parla più solo di chiamare API o concatenare tool testuali, ma di eseguire task reali in ambienti desktop e web con un grado di autonomia maggiore.

I benchmark mostrano un avanzamento netto. Su OSWorld-Verified, test dedicato alla navigazione di ambienti desktop tramite screenshot e input da tastiera o mouse, GPT-5.4 raggiunge il 75,0 per cento di successo, sopra il 47,3 per cento di GPT-5.2 e leggermente oltre il riferimento umano riportato dallo stesso benchmark, pari al 72,4 per cento (vedi GPT-5.4: la nuova generazione dell’AI per il lavoro professionale – AI4Business).

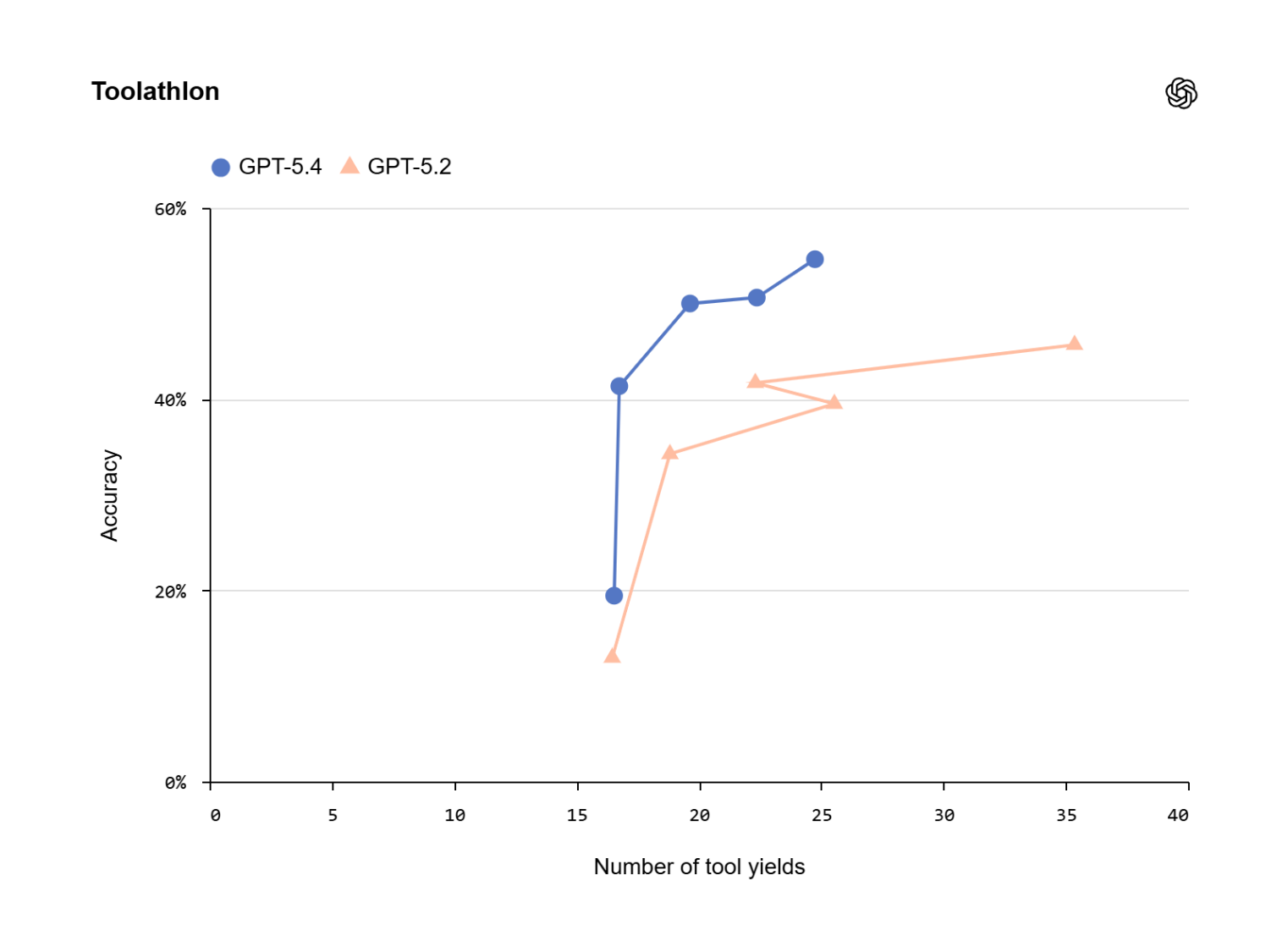

Anche nella navigazione browser le prestazioni crescono, sia su WebArena-Verified sia su Online-Mind2Web. Il dato interessante, tuttavia, non è soltanto la percentuale finale. OpenAI insiste molto sul concetto di tool yields, cioè sul numero di sospensioni necessarie per attendere gli strumenti. È un indicatore meno spettacolare ma più vicino alla produttività reale, perché cattura la latenza effettiva di workflow multi-step e la capacità del modello di parallelizzare o comprimere le operazioni.

A questa dimensione operativa si lega anche il miglioramento della visione. GPT-5.4 arriva all’81,2 per cento su MMMU-Pro senza strumenti e migliora le capacità di parsing documentale su OmniDocBench, dove l’errore medio normalizzato scende da 0,140 a 0,109.

Per i casi in cui la fedeltà dell’immagine è decisiva, OpenAI introduce inoltre un livello di input visivo original, che supporta fino a 10,24 milioni di pixel complessivi o 6000 pixel sul lato massimo. In pratica, il modello viene spinto verso scenari in cui deve leggere interfacce dense, documenti tecnici, schermate complesse e immagini ad alta risoluzione senza perdere precisione di localizzazione.

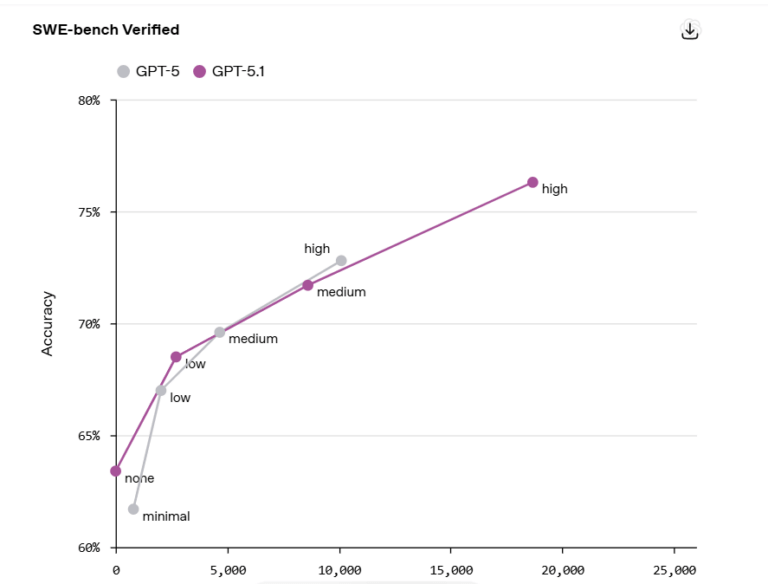

Coding, contesto lungo e ricerca degli strumenti

Sul versante dello sviluppo software, GPT-5.4 eredita le capacità di GPT-5.3-Codex e le porta dentro un profilo più ampio. Su SWE-Bench Pro pubblico ottiene il 57,7 per cento, sostanzialmente in linea ma leggermente sopra GPT-5.3-Codex. OpenAI sottolinea però soprattutto la combinazione fra accuratezza e latenza inferiore, oltre alla disponibilità di una modalità fast in Codex che aumenta la velocità di token fino a 1,5 volte. In altre parole, il valore non è solo nella capacità di risolvere benchmark di coding, ma nella possibilità di restare dentro un ciclo continuo di build, test, correzione e verifica con meno intervento umano.

Qui entra in gioco anche la finestra di contesto da 1,05 milioni di token, disponibile per GPT-5.4 e GPT-5.4 Pro. Una finestra di queste dimensioni apre scenari interessanti per codebase estese, grandi raccolte documentali e traiettorie agentiche molto lunghe, ma introduce anche una questione economica. La documentazione API precisa infatti che le richieste oltre 272 mila token hanno un prezzo superiore, con raddoppio del costo di input e aumento del costo di output sull’intera sessione.

È un dettaglio commerciale tutt’altro che marginale, perché segnala che la capacità di contesto estremo è reale ma non pensata per essere usata in modo indiscriminato.

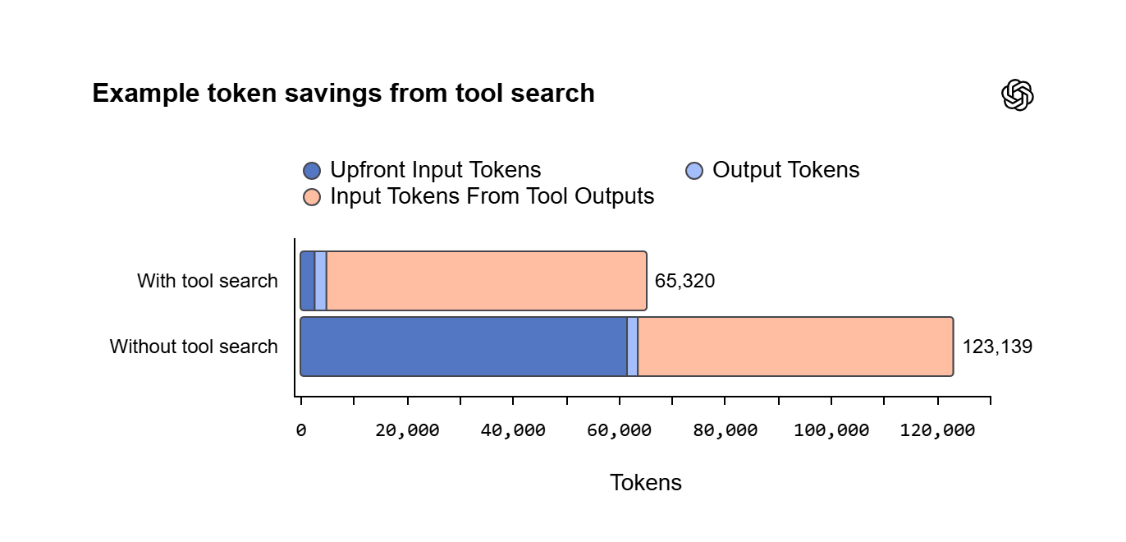

Molto significativa è poi la funzione di tool search. Invece di caricare in prompt tutte le definizioni degli strumenti disponibili, il modello riceve un elenco sintetico e può recuperare solo quelle pertinenti quando servono davvero. Su 250 attività del benchmark MCP Atlas, questa architettura riduce del 47 per cento il consumo totale di token mantenendo la stessa accuratezza.

Dal punto di vista ingegneristico è una mossa importante. Vuol dire che l’espansione degli ecosistemi di strumenti non deve più tradursi automaticamente in prompt giganteschi, costi più alti e contesto sprecato.

Un modello più costoso, ma con una logica economica diversa

Il listino API conferma che GPT-5.4 è più caro di GPT-5.2. Nella tariffazione standard sotto i 272 mila token, il prezzo è di 2,50 dollari per milione di token in input, 0,25 per input in cache e 15 dollari per milione di token in output. GPT-5.4 Pro sale invece a 30 dollari in input e 180 in output. OpenAI difende questo posizionamento sostenendo che la maggiore efficienza del modello riduce il numero complessivo di token necessari per portare a termine molti compiti.

È una tesi plausibile, soprattutto nei flussi multi-step in cui la qualità della prima esecuzione e la scelta degli strumenti hanno un impatto maggiore del puro costo unitario del token.

Anche la disponibilità è stata calibrata in modo da presidiare le fasce professionali. In ChatGPT, GPT-5.4 Thinking sostituisce GPT-5.2 Thinking per gli utenti Plus, Team e Pro, mentre GPT-5.4 Pro è riservato ai piani Pro ed Enterprise. Per le organizzazioni, il segnale strategico è netto. OpenAI considera ormai i modelli reasoning di fascia alta non solo come motori conversazionali, ma come componenti di produttività avanzata da integrare in workflow aziendali, documentali e di sviluppo.

Il vero significato del lancio

Il punto più importante non è stabilire se GPT-5.4 sia il migliore benchmark per benchmark, ma riconoscere il cambio di paradigma che rappresenta. OpenAI sta cercando di trasformare il modello di frontiera in un sistema di lavoro capace di pianificare, usare strumenti, navigare interfacce, produrre output complessi e mantenere coerenza su orizzonti più lunghi.

In questo senso GPT-5.4 non è solo un modello più potente. È un tentativo di consolidare in un’unica architettura le funzioni che finora erano distribuite tra chatbot, copiloti di coding, automazioni documentali e agenti sperimentali.

Resta naturalmente il tema della verificabilità indipendente. Molti numeri del lancio provengono da benchmark interni o da test presentati dall’azienda stessa, e sarà necessario osservare il comportamento del modello in produzione per capire quanto questi vantaggi si traducano in affidabilità quotidiana. Tuttavia la direzione è chiara. Il terreno competitivo non è più soltanto la qualità della risposta, ma la capacità di completare lavoro utile, con meno errori, meno passaggi e maggiore integrazione con gli strumenti reali.

Se questo orientamento reggerà all’uso concreto, GPT-5.4 potrebbe essere ricordato non come l’ennesimo upgrade di performance, ma come il momento in cui l’AI generalista ha iniziato a essere progettata in modo esplicito come infrastruttura professionale.

Bibliografia

OpenAI API, “Images and vision”

OpenAI, “GPT-5.4 Thinking System Card”